把比人还聪明的AI装进口袋有多难?揭秘冲击45%渗透率的"端侧物理方程"

在一个云端AI已经能写论文、编代码、做手术规划的时代,为什么你口袋里的手机跑个语音助手还会发烫掉电?

今天,我们将带你深入芯片底层的微观世界,拆解这场正在重塑智能手机行业的“极限物理战”。

IDC权威预测2026年AI手机的渗透率有望强势冲击45%这意味着,每卖出两部新手机,就有一部将“端侧AI”作为决定消费者购买意愿的核心卖点。

一部手机的物理极限:给它1瓦,还你一个AI

要真正理解端侧AI的难度,我们必须先直面一部智能手机极其严苛的真实物理约束。

|

手机NPU电力预算仅 1-2 瓦 |

|

云端服务器峰值功耗数百瓦 |

除了功耗,手机还需要在毫米级的空间内解决散热问题,同时面临着存储带宽的巨大鸿沟(几十GB/s vs 几TB/s)。计算能力、散热条件、存储带宽,这三座大山划定了端侧AI的物理边界。

端侧AI生存法则:三条布满荆棘的破局之路

面对极端的物理限制,科技巨头们在现有硅基条件下展开了主动优化,探索出三条主流技术路线:

01. 模型压缩

把100公斤的壮汉塞进S码西装

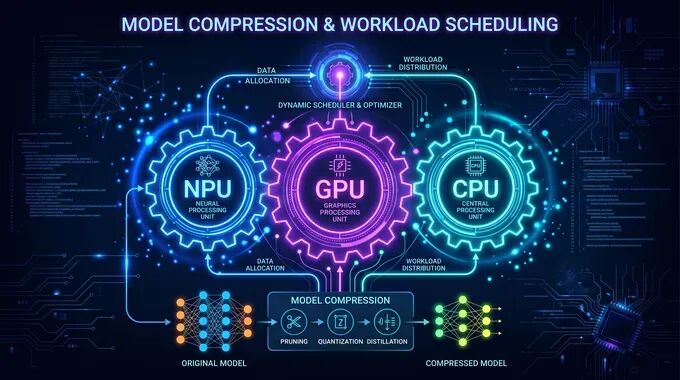

通过量化、剪枝和知识蒸馏,将云端大模型强行压缩到可以塞进手机内存的尺寸。代价是模型能力下降,需要在“减重”和“保住肌肉”间寻找平衡。

02. 异构计算

CPU、GPU、NPU的交响乐

“专人干专事”:通用任务给CPU,AI推理矩阵运算给NPU,图像渲染给GPU。极其考验底层系统的调度功力,避免“一核有难,八核围观”。

03. “跷跷板”策略

端云协同的无缝分流

日常高频轻量任务依赖本地模型(保隐私、低延迟);复杂任务无缝切换至云端大模型。理想状态下,用户对算力切换毫无感知。

巨头角力:端侧AI的“极限制造”现场

高通与80亿参数的端侧奇迹

骁龙8 Elite芯片支持80亿参数生成式AI模型在终端独立运行。实机演示中,Stable Diffusion可离线在几秒内生图,完成了过去依赖云端的创作任务。

苹果的“本地优先”与隐私壁垒

Apple Intelligence 默认优先在本地芯片推理,超出算力极限才发送至私有云。这不仅是技术展示,更是构筑用户数据不出端的隐私壁垒。

“

把AI装进手机,表面上是压缩算法,骨子里是在挑战硅基芯片的物理极限。

“

决定那45%渗透率能否到来的,是工程师们对功耗、模型智能保留率、内存带宽瓶颈的持续攻坚。把比人还聪明的AI塞进你的口袋,不亚于人类工程史上一次静默的登月。

> 评论区聊聊

1. 你觉得手机上的AI功能,哪个对你来说最不可或缺?(实时翻译 / AI计算摄影 / 聪明百倍的语音助手 / 会议文档总结 / 其他)

2. 为了获得“无需联网、绝对隐私”的更强端侧AI体验,你愿意在购买下一部手机时多掏多少预算?

_ 欢迎在评论区留下你的极客洞察!

📩 关注我们,深度科技观察,带你硬核拆解那些藏在硅片里、正在悄然改变你数字生活的底层技术。

夜雨聆风

夜雨聆风