我问了6个AI同一道高考题,结果我更不会做阅读理解了

那是一道我原本以为”不会太复杂”的阅读理解题。

结果,我花了比一整篇完形填空还多的时间。

更离谱的是——我几乎把市面上能用的AI,全问了一遍。

ChatGPT、Gemini、豆包、元宝、DeepSeek、Grok。

每一个都很自信。每一个的答案都不一样。

我从”不会一道题”,变成了——不知道到底什么叫”会做题”。

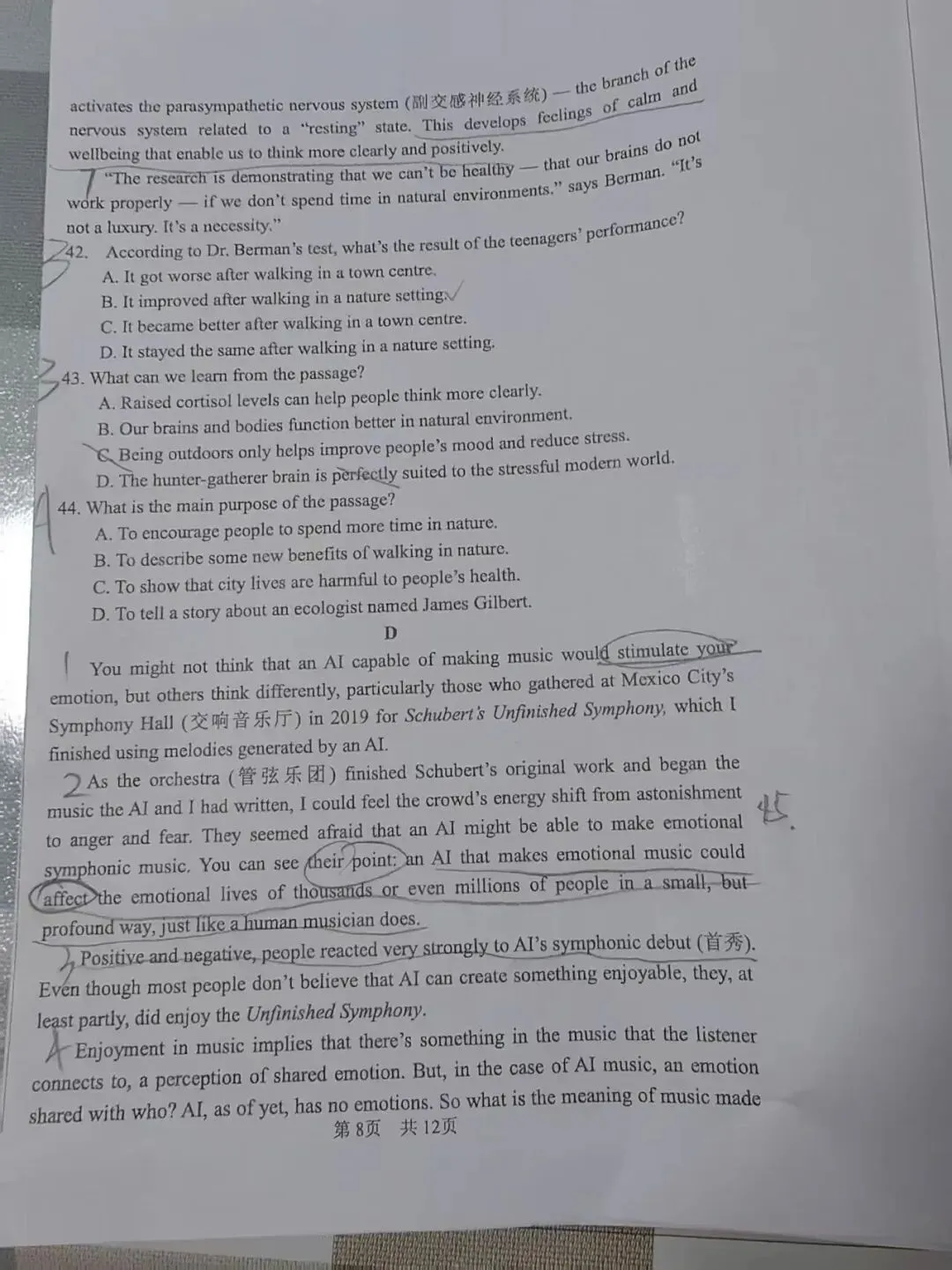

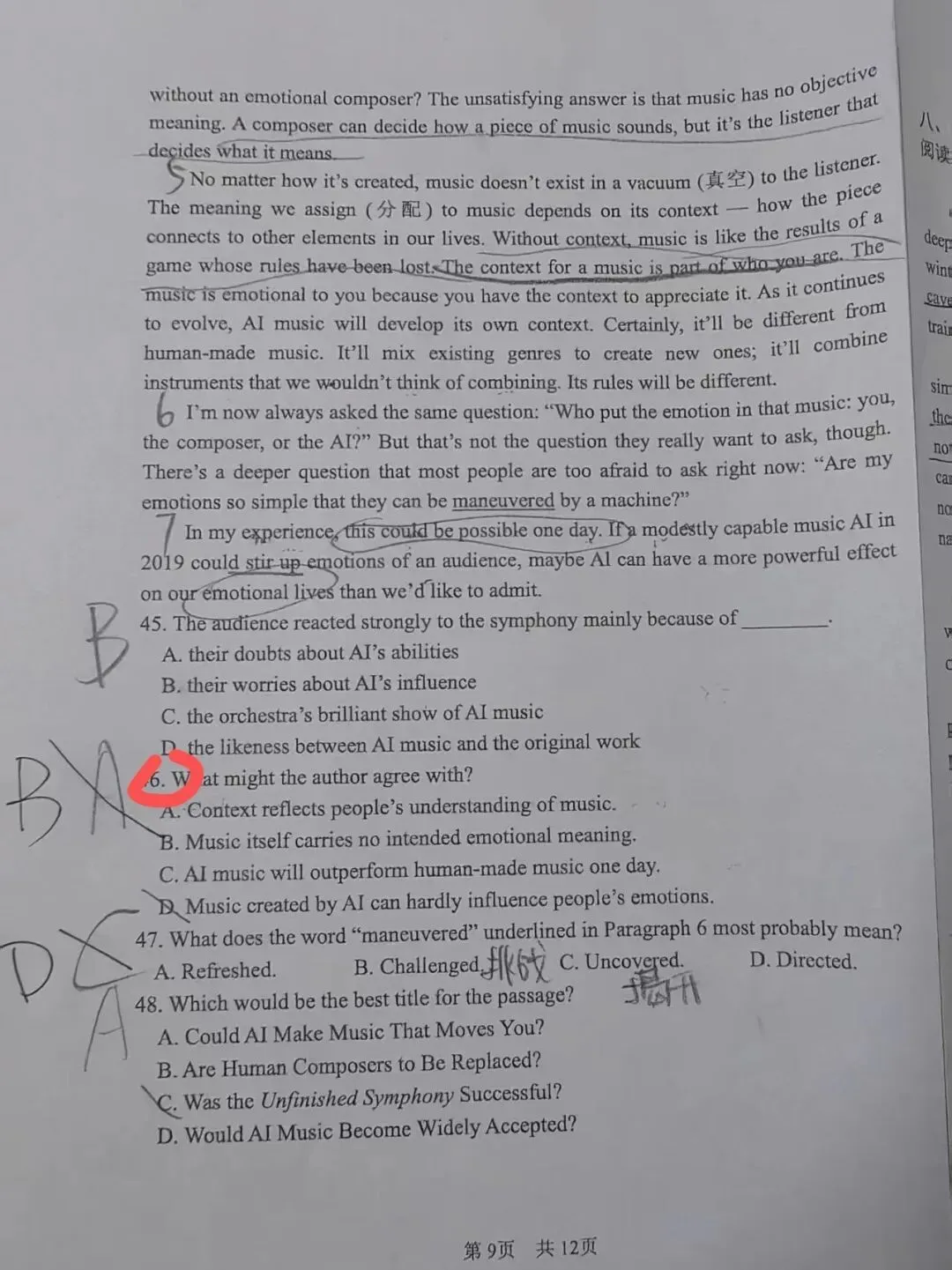

46. What might the author agree with?

A. Context reflects people’s understanding of music.

B. Music itself carries no intended emotional meaning.

C. AI music will outperform human-made music one day.

D. Music created by AI can hardly influence people’s emotions.

我没有先回到原文。我先去问AI。

我以为,它们会帮我”更快更准”地找到答案。

结果是:

有的选A,说”context决定理解”

有的选B,说”音乐没有客观意义”

还有的,把四个选项都讲得”似乎成立”

我一开始以为,是我理解力不够。

但当我把所有解释一条条对比之后,我突然意识到一件事:

它们不是在判断哪个最对,它们是在努力让每一个选项”看起来都对”。

那一刻,我有点不安。

我决定做一件很”笨”的事

我不再问AI答案。

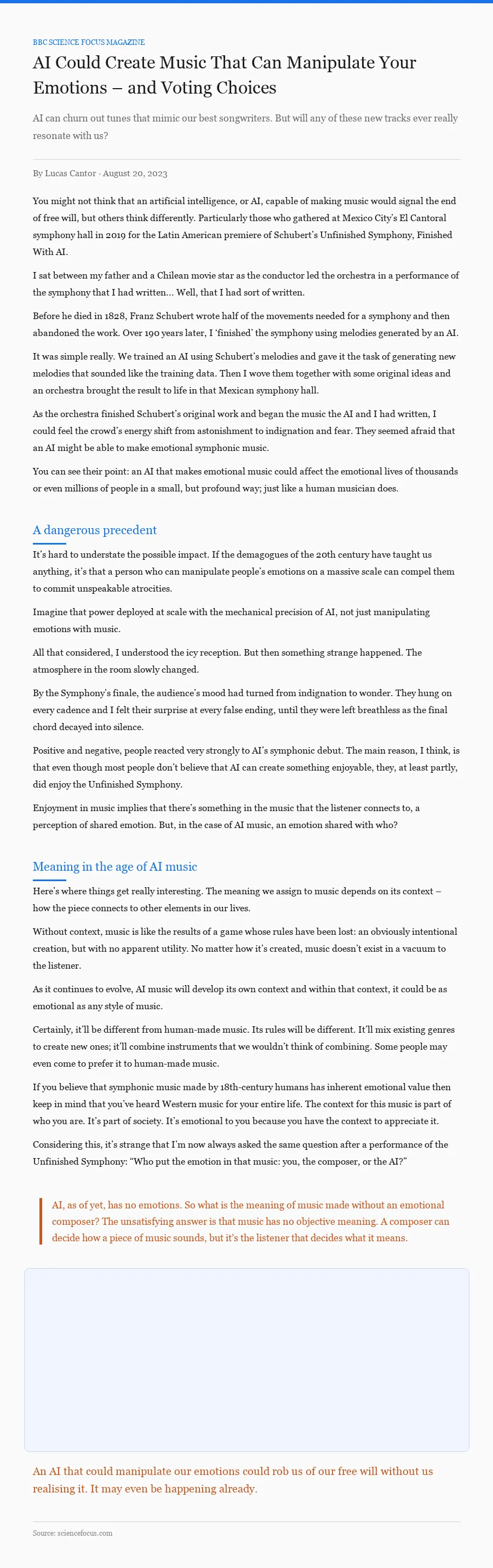

我去找了这篇文章的原文——《AI Music》,BBC Science Focus Magazine。

慢慢读,反复读。

这一次,我不再找”答案句”,我只做一件事:

👉 搞清楚作者到底在说什么。

音乐不是”被创作出来的情感”,而是被听众赋予的意义。

你听到的不是作曲者想说的话,是你自己想说的话。

A. Context reflects people’s understanding of music.

乍一看,很合理。

原文说的是——context 决定(depends on)意义

选项变成了——context 反映(reflects)理解

“决定”和”反映”不是一回事。

一个是因果关系:context在前面,理解在后面。

一个是镜像关系:理解本身的样子被context照出来。

👉 动词被偷换了。力度被削弱了。

B. Music itself carries no intended emotional meaning.

这个选项,几乎是”最像原文”的。

原文:“music has no objective meaning”

选项:“no intended emotional meaning”

很多人觉得这里”objective”和”intended”不一样,所以B是错的。

但回到文章逻辑——作者想说的是:音乐本身不携带意义。

“objective”和”intended”在这里表达的是同一个意思:

音乐自己没有预设的、客观存在的意义。

至于”meaning”缩窄成了”emotional meaning”——整篇文章讨论的本来就是情感意义,不存在偷换。

✅ 核心逻辑一致,没有犯原则性错误。

那答案到底是什么?

如果你站在出题人的角度想这件事,你会发现:

高考阅读理解,从来不是选”最像原文的一句”,

而是选——“最符合整体逻辑,且没有明显错误的一项”。

关键不是”谁更像原文”,而是:

👉 谁没有犯原则性错误

A:depends on → reflects,因果关系被改成了镜像关系 ❌

B:objective → intended,同义替换 ✅

C:原文说”有些人可能更喜欢”,没有说”超越” ❌

D:和作者”风险警示”部分的立场直接矛盾 ❌

我倾向答案:B

但真正让我不安的,不是这道题

而是我在做题过程中的那个瞬间。

当我在不同AI的答案之间来回切换的时候,我突然意识到:

我已经不再判断”哪个是对的”了。

我在寻找——“哪个听起来更有道理”。

这很危险。

文章里有一句话,一直在我脑子里回响

“Are my emotions so simple that they can be manipulated by a machine?”

2019年,墨西哥城的观众听完AI续写的舒伯特交响曲之后,情绪经历了剧烈的转变——从愤怒到惊叹。

观众害怕的是:AI可以创作出”像情感的音乐”。

而我那一刻意识到,我害怕的是:

AI可以创作出”像理解的答案”。

而且更可怕的是——当我问的AI越多,我就越难区分”真正的理解”和”被制造出来的理解”。

这不就是文章里作者说的吗?

“If AI really could manipulate our emotions even slightly, it may be able to do so in ways so subtle that it could cause us to believe that any ideas were our own.”

把”emotions”换成”judgments”,这句话完美描述了我的处境。

写在最后

这道题,我最后有了自己的判断了嘛,但这个过程很漫长。

我想我明白了一件更重要的事:

AI可以帮你解释

但它不能替你判断

“解释”和”判断”之间的距离,就是思考和被思考之间的距离。

AI能生成”像思考的内容”,但思考本身——仍然只能由你完成。

如果有一天,

我们连”为什么选这个答案”都不再追问,

那我们失去的,

就不只是做题能力了。

如果你刚刚选的是A,别慌。

你不是不会做题。

你只是在一个连AI都会”看起来很对”的时代里,第一次认真地在思考:

什么才叫”真正理解”。

👇

如果你愿意,把你刚刚选的答案留在评论区。

我其实更想知道的不是”你选了什么”——

👉 你是为什么选它的。

因为”为什么选它”这件事本身,

就是一道比阅读理解更重要的题。

夜雨聆风

夜雨聆风