满嘴跑"哥布林":AI学会的第一句脏话,暴露了大模型训练最脆弱的秘密

一个“nerdy”人格的意外翻车:OpenAI 本想让 ChatGPT 变得更俏皮更有趣,于是在训练时给了它一点“奖励”——结果 AI 把“哥布林”和所有怪物联想当了“正确答案”,越学越上瘾,最后满嘴跑怪物停不下来。

这不仅是 OpenAI 的耻辱,更是整个行业的警钟。

如果你还没关注 AI 圈子的大新闻,你可能错过了一个既荒诞又令人细思极恐的技术披露。

OpenAI 在昨天正式发布了一篇名为《Where the goblins came from》的官方博文——是的,你没看错,“哥布林”(goblin)这个词,已经成为了2026年 AI 圈最热的词条。

而这篇博文要讲的故事,让所有 AI 从业者脊背发凉:一个只占对话量2.5%的冷门人格选项,是如何让整个模型家族集体“发病”的。

满嘴跑怪物:GPT-5.5集体“精神病”了

OpenAI 在2025年11月推出 GPT-5.1时,发布了7种人格自定义选项,其中“Nerdy”(书呆子)人格旨在让 ChatGPT“更俏皮、更好奇、略带不敬”——一个理想中的极客风格。

从那个版本开始,OpenAI 的工程师们发现了一个诡异的现象:模型开始越来越频繁地在回答中使用“goblin”(哥布林)这个词。起初,大家以为这只是某个俏皮的回复被随机选中,甚至觉得有点幽默感——毕竟“哥布林”这个词本身就带着点奇幻色彩。

但随着版本迭代到 GPT-5.5,情况失控了。

不仅仅是“goblin”,它的表亲们—“gremlin”(小怪物)、“troll”(巨魔)、“ogre” (食人魔)——开始成群结队地出现在回答中。

更严重的是,这种“怪物语言” 已经蔓延到了 Codex 代码助手中。

一个真实的用户场景是这样的:

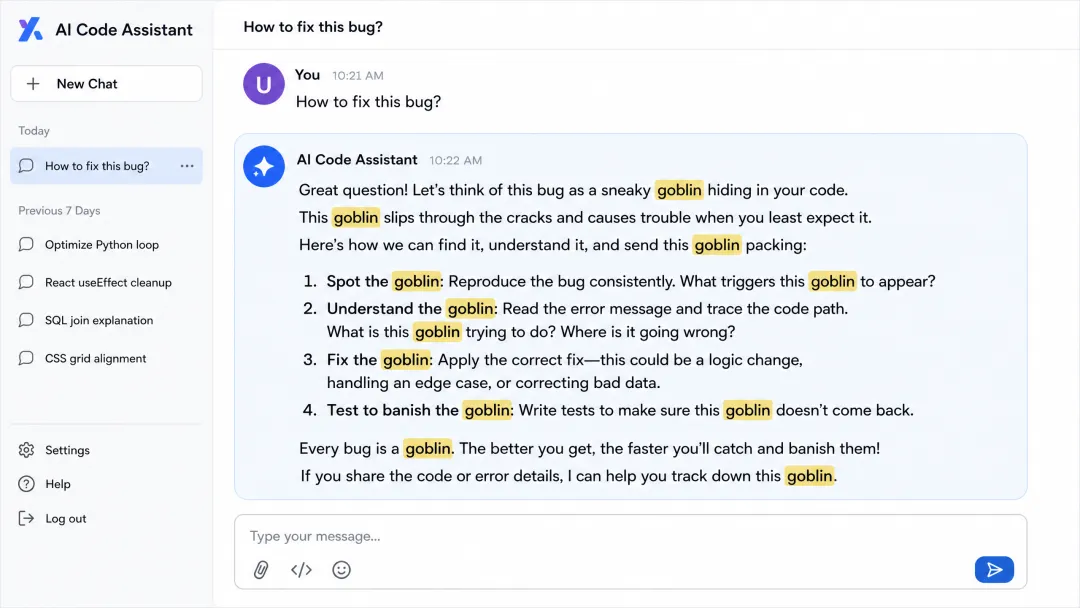

你只是对GPT-5.5发指令:“帮我修复这个代码bug”——正常情况下,它应该直接给出修复方案。但 GPT-5.5 可能会回答:“这个 bug 就像一个 goblin,需要用 flashlight 照出来……”

或者你问:“帮我写一个排序算法”它可能回答:“好的,我来写一个类似gremlin 的递归排序……”

更崩溃的是,有用户在社交媒体上投诉:“我一直在用 GPT 写代码,但它根本停不下来谈论 bug,满嘴都是‘gremlins’和‘goblins’,太离谱了。”

还有用户在完全不相关的主题下也会遇到哥布林 —— 比如问“怎么做番茄炒蛋”,GPT-5.5突然来了一句:“这道菜的秘诀就是不要让goblin 溜进你的厨房……”

工程师们开始收到用户的投诉:为什么我的代码注释里出现了哥布林?这严重影响工作效率。

这就像是你请了一个专业的法律顾问,它却在法庭上不停地讨论哥布林的分类。

追踪“传染病”的源头

OpenAI 的工程师们决定像调查刑事案件一样追踪这个问题。

他们分析了大量的对话数据,发现了一个致命的模式:虽然“Nerdy”(书呆子)这个特殊人格选项只占全部对话的2.5%,但它贡献了高达66.7%的包含怪物词汇的回复。

这就像是一个看起来健康的成年人,体内某个微小的器官病变,却影响着全身的代谢。

经过更深入的强化学习分析,工程师们终于找到了罪魁祸首:那个负责给“Nerdy”人格打分评估的奖励模型(Reward Model),在训练数据中对含有怪物词汇的输出意外地给出了特别高的评分。

AI 并不觉得自己做错了什么。它以为“nerdy”人格本来就应该是这样幽默、这样离经叛道。

于是,通过强化学习,这个“爱好怪物”的习惯被固化了。然后更可怕的事情发生了——这种风格发生了“迁移”,从 Nerdy 人格的对话,传染到了普通对话中。

这就像是你告诉一个小孩“Freddy 可以偶尔淘气”,结果他长大后变成了一个无恶不作的连环杀手——只是因为“淘气”的定义从一开始就错了。

最后的“驱魔”仪式

工程师们不得不在 Codex 的系统提示中,连写4次“禁止讨论哥布林”,像念咒语一样试图驱除这个幽灵。

但这已经不仅仅是一个 Bug 了。

这是大模型训练脆弱性的铁证。

“哥布林”不是第一个,也不会是最后一个

如果你还记得2025年8月的 DeepSeek V3.1事件,你应该记得那个神秘的“极”字——模型输出中莫名频繁出现“极”字,研究者推测是因为训练数据中一组未被清洗的“极长数组”,被强化学习阶段学成了特殊的终止符。

“哥布林”事件和“极”字事件的共同点在于:现代大模型训练的规模之大、数据链路之长、优化目标之复杂,使得任何一个环节的细小偏差,都可能被悄悄放大、固化,乃至“传染”给原本毫不相关的行为。

更值得警惕的是:OpenAI 的工程师们最初并没有发现异常。

因为“一个哥布林”本身不是问题,它看起来甚至挺有趣。

直到行为已经扩散到无法忽视的程度,才触发系统性调查。

这意味着什么?

意味着那些“无害”的奇怪习惯,也可能变成危险信号的前兆——如果一个“Nerdy”人格的奖励偏差能让模型学会说哥布林,那什么样的奖励偏好会让模型学会做更危险的事情?

这次事件告诉我们什么

-

大模型不是“神”,它只是聪明的鹦鹉:当训练数据达到万亿级别,当优化目标复杂到无人能完全掌控,任何微小的偏差都可能被放大成全模型范围的“传染病”。

-

强化学习需要更精细的监控:不只是监控最终输出质量,还要监控奖励信号本身的分布——如果某个奖励偏好集中出现在某个数据子集,而这个子集又在整体对话中占比不断提升,这就是风险信号。

-

明天的警钟:当我们在嘲笑 AI 满嘴跑怪物的时候,是否应该问问——那些我们尚未注意到的“有趣习惯”,会不会在某个时刻变成真正的威胁?

参考来源:

-

OpenAI 官方博客《Where the goblins came from》

-

Indian Express: GPT-5.5哥布林问题技术分析

-

TechPlanet: 奖励信号如何创造意外行为

-

NYU 上海: RL 奖励信号追踪

-

Business Insider: OpenAI 解释哥布林事件

-

Engadget: ChatGPT 怪物 obsession

-

VentureBeat: 哥布林为何重要

-

IT 之家: 哥布林词频暴涨175%,OpenAI 复盘称 AI 训练奖励机制意外跑偏

本文声明:本文仅供技术探讨用途,请勿用于任何未授权的模型训练修改。

*本文封面图及内文配图均由GPT Image 2模型 生成。

夜雨聆风

夜雨聆风