新手如何用OpenClaw自动监控知识星球更新内容?

做投资,最怕的不是没有信息,而是太多了——知识星球、研报、公众号、微信群、公告、会议纪要……不看,怕错过;全看,又根本看不过来。

最后很容易变成一种状态:白天看盘,晚上刷消息。刷完一圈,感觉很努力,但真问今天有什么值得跟踪的新线索,又说不清楚。

所以最近越来越觉得,投资很重要的一件事,就是做减法,不是再多加几个信息源,而是建立一个适合自己的信息过滤系统——用AI搭建一个适合自己的信息过滤系统:

重要的东西,自动送到我面前。不重要的东西,自动过滤掉。

我用openclaw接飞书监控知识星球内容一个多月了,之所以想弄这个东西,是因为加入的星球有好几个,每天更新几百条,看不过来。

下面分享一下,新手如何用OpenClaw等AI 工具搭一个知识星球监控系统,把重点内容自动推送到飞书。

————

开始前,准备四样东西

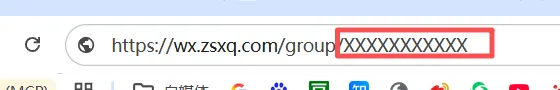

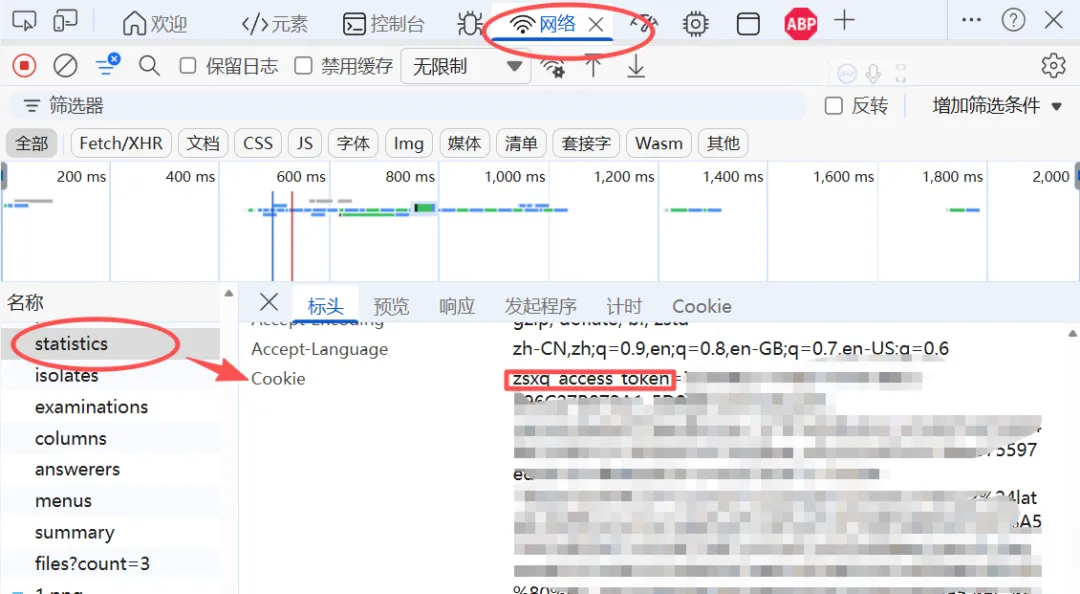

cookies怎么拿,登录知识星球之后,按F12,找到上面的网络,随便点一个文件,找到右边列表 zsxq_access_token这行,整个复制就行。

先让 Claude/Codex 写第一版脚本

请帮我写一个Python脚本,用于自动监控知识星球并推送到飞书,要求如下:

我要监控的星球ID列表:【这里填你第二步记下来的ID,用逗号隔开,每个ID加上星球名称备注】

功能要求:

用zsxq_access_token作为Cookie登录,每次只抓取上次运行时间之后的新帖子,时间记录在last_run.txt过滤掉超过5000字的文档类帖子按关键词打优先级:P0(持仓股XX)、P1(含算力/GPU/HBM/大模型/光模块/人形机器人/半导体/商业航天,可以自行调整)……可以设置更多。检测同一关键词在2个以上星球同时出现(共振信号)调用DeepSeek API对每条帖子生成30字核心逻辑+看多/看空/中性判断推送到飞书Webhook所有配置(token、飞书地址、Key)放在脚本顶部变量里,方便修改依赖只用requests库

请直接给我完整可运行的Python代码,文件名为 zsxq_monitor.py。

————

再交给 OpenClaw 落地

这是一个知识星球监控任务脚本。请你帮我在本地测试是否能正常运行。

要求:

1. 检查配置项是否完整。

2. 测试能不能抓到知识星球内容。

3. 测试能不能调用 DeepSeek 做摘要。

4. 测试能不能推送到飞书。

5. 如果报错,帮我逐步修复。

6. 最后帮我设置成 Windows 定时任务,每 1 小时运行一次。

这一步很关键。不要指望一次就完美。第一版大概率会有各种问题:股票名识别错、摘要太长、飞书格式不好看、重复推送、知识星球 token 失效……这些都正常,自动化工具不是一次写好的,是一点点磨出来的。

————

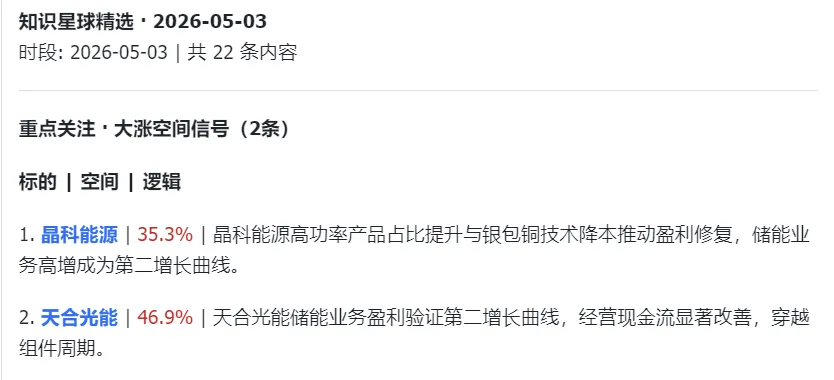

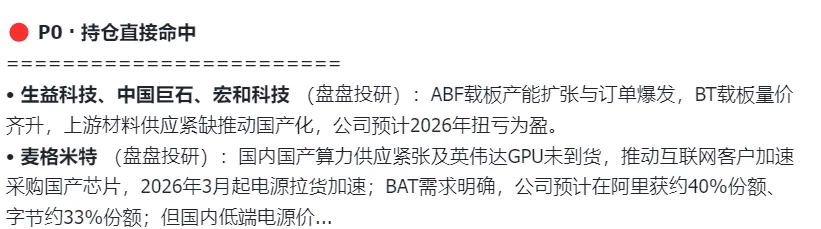

最终效果大概是什么样

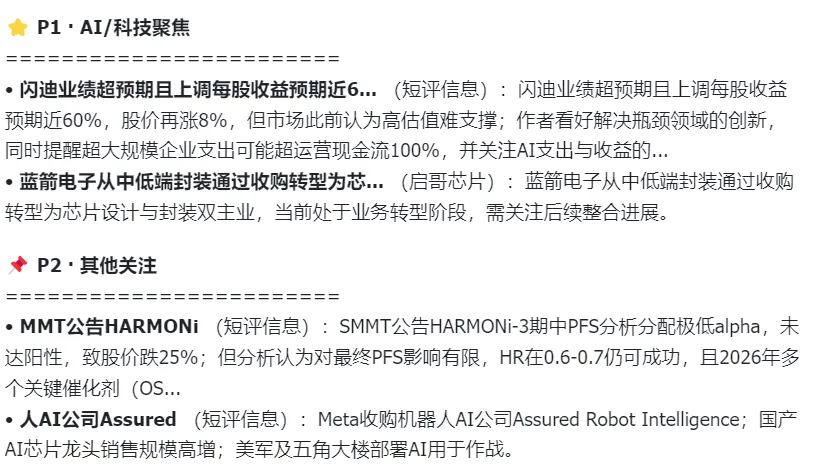

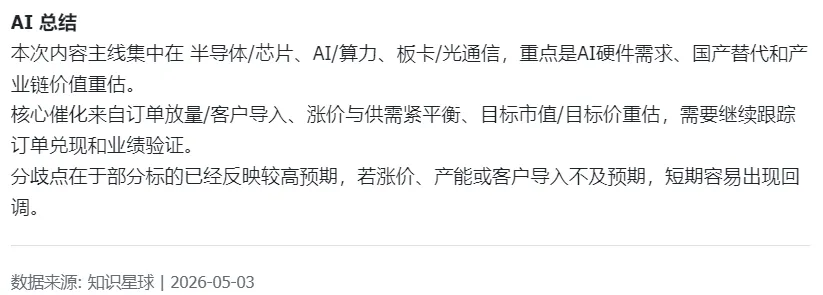

效果是这样的:包括重点关注(主要提醒一些卖方比较看好、空间比较比较大的股票和逻辑)、p0(持仓相关帖子)、P1(关键字相关帖子,比如 AI、算力、芯片、光模块、PCB、机器人)……最后是AI总结。

当然,这个是我的模板,想展示什么内容,什么样式,细节你们可以慢慢让openclaw调。

接下来,每天交易的时候,打开飞书看推送消息就行。当然你也可以设置30分钟推一次,这频率更高一些。后面就没啥事了,就是zsxq_access_token 几周会过期一次,定期换一下就行。

最后总结:拿星球token → 找要监控的星球ID → 建飞书机器人 → Claude/Codex生成脚本→ 发给OpenClaw部署。

————

最后说一句

你以为每天在看,其实错过的远比看到的多。不是你不努力,是人的注意力本来就是有限的,无法同时守着多个地方。

AI 工具的意义,不是替代你判断,是让你更快进入判断环节。它帮你把信息收集、整理、归纳、推送做好。你再基于这些信息,做自己的决策。这才是比较实用的 AI 投资方式。

在信息过载的现在,投资长期拼的不是灵感,而是借助AI投资工具,替你守着那些你守不过来的地方。真正值得花时间的事,是看完AI总结的内容,脑海里浮起的那个念头。

那个念头,机器给不了你。

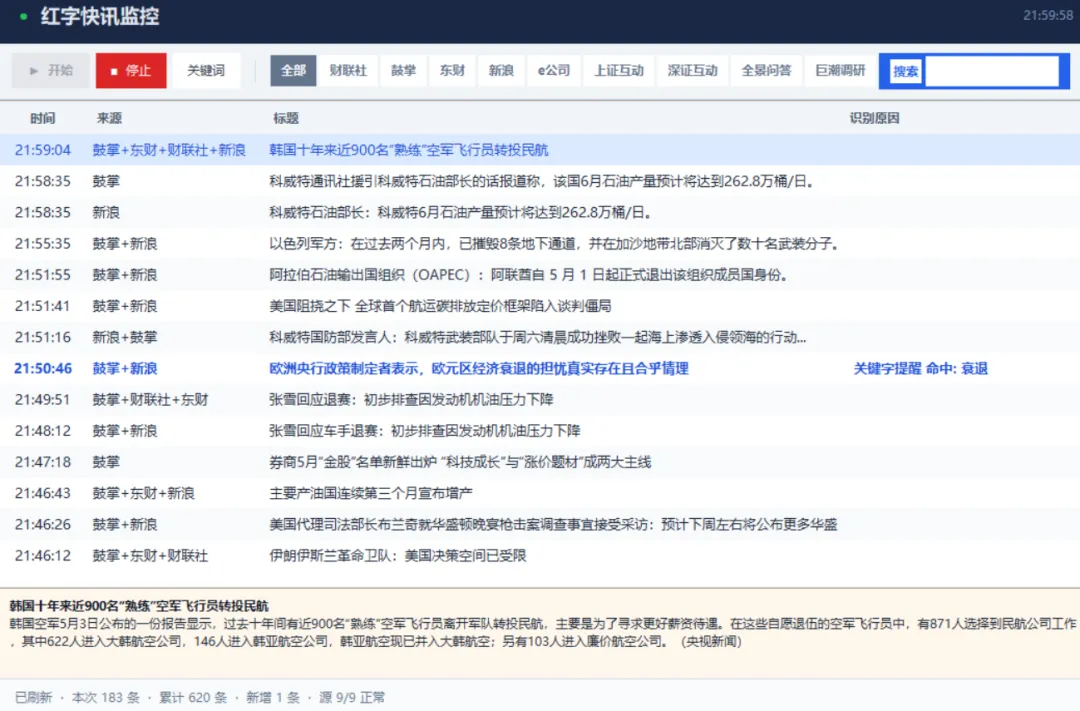

PS:现在正在做一个快讯监控系统,监控多个信源,除了常用的财联社、东财等,还有互动和调研。虽然有些网站实现了多个信源聚合,比如鼓掌财经,但没法做到触发关键字或者自选股弹窗提醒,也没法扩大监控范围,更没法同时搜索这些网站……完全不懂代码的我,看到AI做出了这个东西,直呼神奇。后面做好后,再分享一下。

夜雨聆风

夜雨聆风