养虾之路——本地土生小龙虾(openclaw)(二)

讲完了DEV模式下运行openclaw,再介绍一下如何使用正常的openclaw(非开发模式dev)

首先,在wsl下进入openclaw文件夹,先安装openclaw(上文说了,我下载的实际上是源码),按照AI的指令执行下列代码:

pip install -e .

执行后可能会发现,没有pip命令,这是由于没有安装pip工具,需要接着执行下述命令:

apt update

apt install python3-pip -y

安装完毕后验证一下pip3的版本:

pip3 –version

执行完毕后会显示pip的版本。

重新运行安装命令(pip install -e .),仍然报错,然后AI让我下载pipx:

apt install pipx -y

然后用pipx安装openclaw:

pipx install .

安装完成后仍然有问题,一通折腾后,AI让我输入以下命令给它看:

cd~/openclaw

ls -la

ls openclaw/ 2>/dev/null || echo “openclaw 目录不存在”

cat pyproject.toml | head -30

然后我把输出的东西给了AI去看,它终于明白了问题:

我git clone的OpenClaw 不是 Python 项目,而是 Node.js 项目!

从输出可以看到:

有 node_modules/ 目录(Node.js 依赖)

有 koffi 等 Node.js 原生模块

没有 openclaw/ Python 包目录

AI又给了我命令让我执行后把结果给它看:

cd ~/openclaw

# 1. 查看项目类型

cat package.json | head -30

# 2. 查看可用脚本

cat package.json | grep -A 15 ‘”scripts”‘

# 3. 查找编译后的文件

ls -la dist/ 2>/dev/null || echo “无 dist 目录”ls -la build/ 2>/dev/null || echo “无 build 目录”

# 4. 查找入口文件

find . -maxdepth 3 -name “*.js” | grep -E “(gateway|cli|index|main)” | head -5

我把执行后的内容粘贴后发给AI,它给了最终的确认:

OpenClaw 是 Node.js 项目,已经编译好了(有 dist/ 目录)

入口文件是 openclaw.mjs(根据 package.json 中的 “bin”: {“openclaw”: “openclaw.mjs”})

dist 目录已存在且包含大量编译后的文件

然后,给我正确的启动命令:

cd ~/openclaw

# 使用 Node.js 直接运行

node openclaw.mjs –version

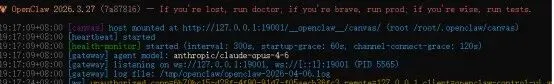

我终于看到了我的小龙虾版本号:OpenClaw 2026.3.27 (7a87816)。

运行启动网关命令:

node openclaw.mjs gateway run

启动后发现端口被占用,于是调用命令:

node openclaw.mjs gateway stop

Stemd中自动执行的任务被终止,端口释放。(Stopped systemd service: openclaw-gateway.service)

然后,重新执行启动网关命令:

node openclaw.mjs gateway run

这下正常运行了:

为了方便使用,创建别名:

# 添加到 ~/.bashrc

echo ‘alias openclaw=”node ~/openclaw/openclaw.mjs”‘ >> ~/.bashrc

source ~/.bashrc

现在可以直接使用:

openclaw –version

openclaw gateway run

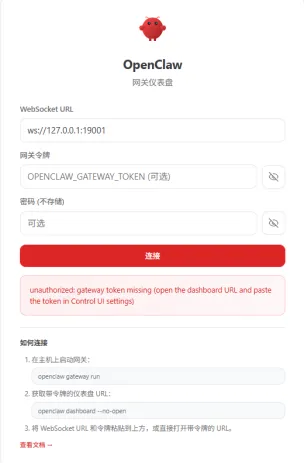

这时候打开UI(windows下http://127.0.0.1:19001),可以先到下面的界面:

距离成功很近了。

新开一个wsl命令窗口,在openclaw目录下输入下述命令:

node openclaw.mjs dashboard –no-open

你可以得到一个token:

Dashboard URL: http://127.0.0.1:19001/#token=xxxxxxxx

Copied to clipboard.

把红色部分粘贴到上面截图部分的网关令牌内,点击连接,就进入到了龙虾的运行界面。

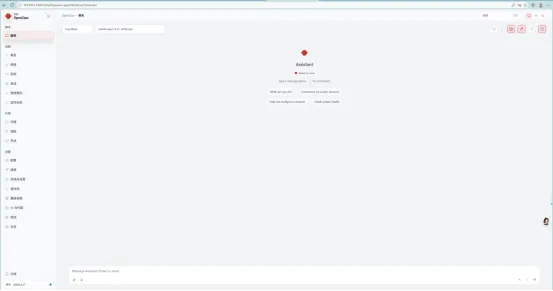

可以看到,默认大模型还不是我们本地的ollama。

有两种方法可以解决这个问题,一是运行下面命令:

cd ~/openclaw

node openclaw.mjs configure

系统会弹出图型化的配置界面:

│ ● Workspace (Set workspace + sessions)

│ ○ Model

│ ○ Web tools

│ ○ Gateway

│ ○ Daemon

│ ○ Channels

│ ○ Skills

│ ○ Health check

│ ○ Continue

└

选择MODEL就可以开始设置选择的大模型:

◇ Select sections to configure

│ Model

│

◇ Model/auth provider

│ Ollama

│

◇ Ollama base URL

│ http://127.25.176.1:11434

◇ Ollama mode

│ Local

│

◇ Models in /model picker (multi-select)

│ 1 items selected Config overwrite: /root/.openclaw/openclaw.json , backup=/root/.openclaw/openclaw.json.bak)

Updated ~/.openclaw/openclaw.json

│

另一种方法就是直接在/.openclaw/openclaw.json 修改默认的配置参数,把大模型换成本地下载的大模型,比如:

“models”: [

{

“id”: “qwen3-vl:8b-instruct-q8_0“,

“name”: “qwen3-vl:8b-instruct-q8_0“,

“reasoning”: false,

“input”: [

“text”

],

对openclaw.json修改完成后,可以启动gateway了:

node openclaw.mjs gateway run

如果发现19001端口被占用,那就杀掉进程重新启动。

kill -9 xxx

node openclaw.mjs gateway run

在Windows打开 http://127.0.0.1:19001,我们就可以和我们的小龙虾对话了。(完结)

夜雨聆风

夜雨聆风