AI只能点点点控制软件?这个开源工具说不

AI只能点点点控制软件?这个开源工具说不

你用过AI Agent帮你在电脑上操作软件吗?

大概率踩过坑。要么是屏幕识别出错点了错误按钮,要么是API残缺根本没法调用。AI控制桌面软件这件事,行业普遍的做法是视觉锚点加坐标点击——听起来很美,实际上脆弱得像纸糊的。

这个问题,被一个开源项目终结了。

一句话解释它是什么

CLI-Anything是一个自动化框架。它的核心能力是:给任意桌面软件生成一个完整的命令行接口,让AI可以通过CLI精准控制软件的一切操作。

不是屏幕点击,不是坐标定位,是真正可编程的、输出确定的JSON结果的接口。

它怎么做到的

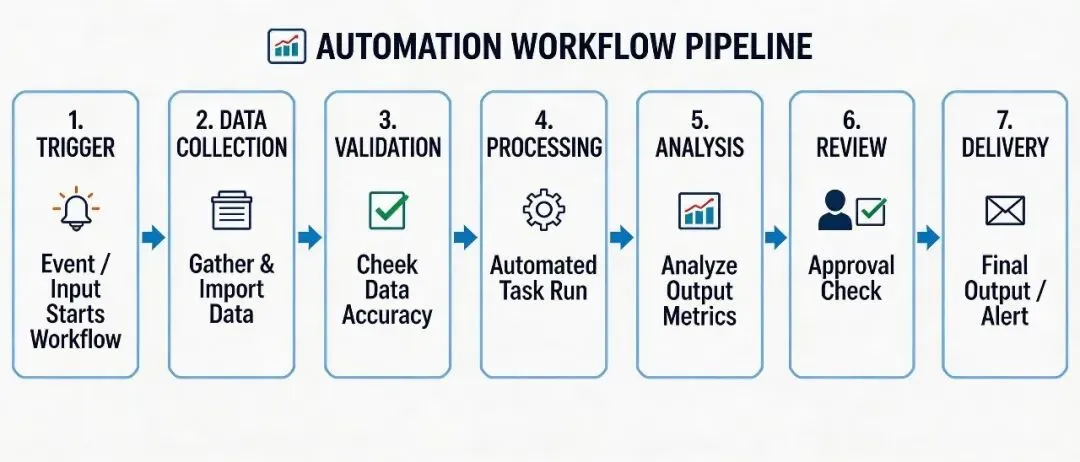

项目作者设计了一套7阶段自动化流程:

第一阶段:代码分析。读取目标软件的完整源代码,理解其GUI架构。

第二阶段:操作映射。将用户通过GUI执行的操作(点击按钮、输入文字、选择菜单)一一映射到对应的底层代码调用。

第三阶段:CLI生成。基于映射结果,生成一套完整的命令行接口规范。

第四阶段:参数封装。每个CLI命令的参数、返回值、错误码全部标准化,输出确定性JSON。

第五阶段:验证测试。自动跑一遍所有命令,确保映射准确、输出稳定。

第六阶段:文档输出。生成人类可读的API文档。

第七阶段:Agent集成。输出符合MCP协议的集成接口,AI Agent可以直接调用。

整个流程跑下来,AI获得的不再是看起来像按钮的东西,而是精准的、可复现的、有确定输出的编程接口。

为什么这事值得关注

AI Agent真正落地最大的卡点之一,就是最后一公里:模型再强,控制不好软件就等于零。

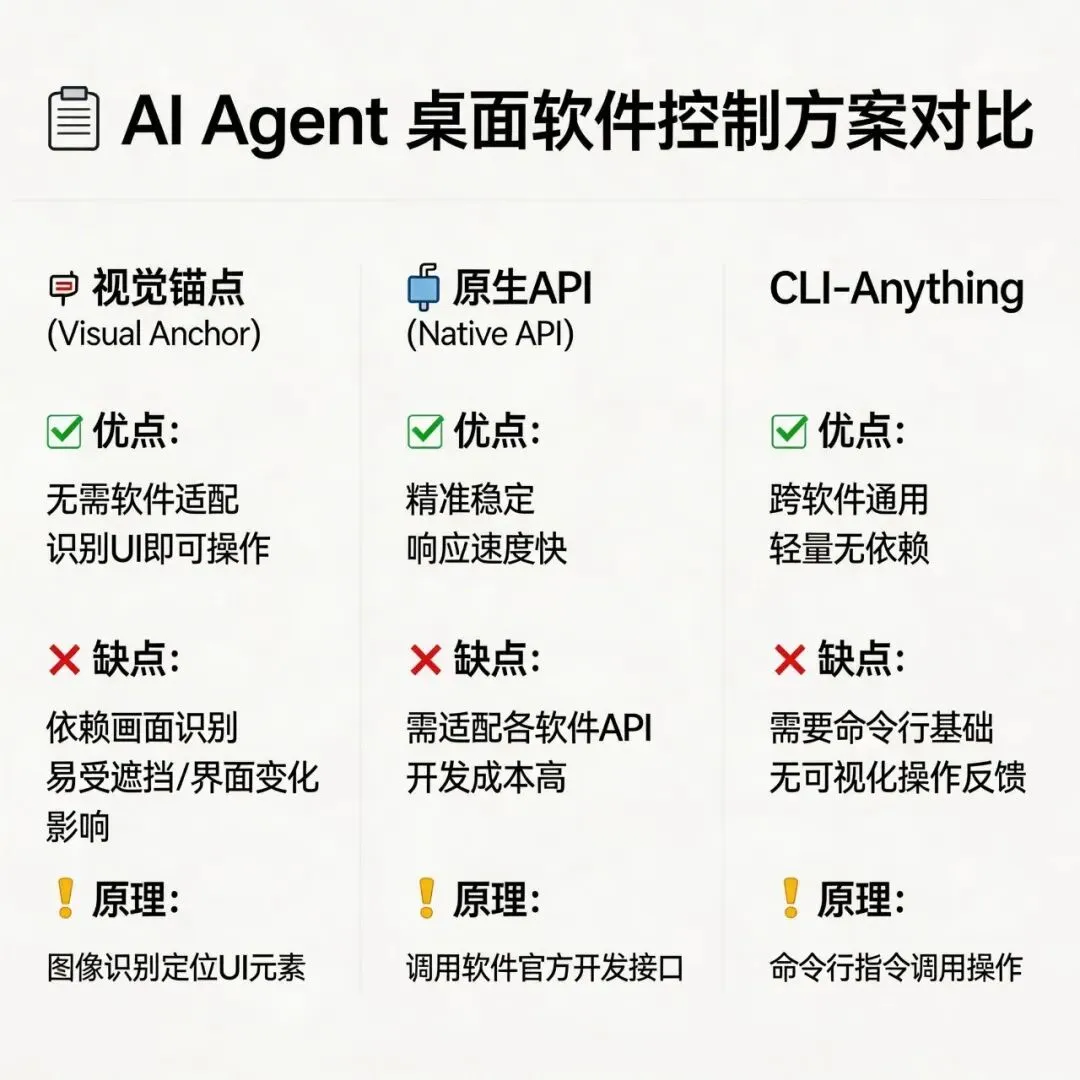

现有的几条路:

- 视觉+坐标:脆弱,屏幕分辨率一变就废

- 原生API:大部分软件根本没提供,或者接口设计得没法用

- OS-level辅助功能:Accessibility API,勉强能用但覆盖面窄

CLI-Anything提供了第四条路:不依赖软件官方接口,不依赖屏幕识别,从源代码层面直接构建可控接口。

这是一条更难但更彻底的路。

我的判断

它解决的是一个真实痛点。任何尝试过用AI操控桌面应用的人,都懂点错位置的崩溃。CLI-Anything从根上绕开了这个问题。

门槛不低。你得有目标软件的源代码,这对闭源软件无效。所以它的适用范围目前主要是开源项目和内部工具。

思路值得借鉴。不管CLI-Anything本身能不能成,它验证了一条路线:让AI控制软件,最可靠的方式是从代码层面构建接口,而不是在UI层面猜猜猜。

留一个问题

CLI-Anything目前依赖源代码,这意味着它解决不了那些没有源代码的闭源商业软件。

如果一个商业软件既没有开放API、又不开源,你怎么让AI精准控制它?

这个问题没有标准答案。但它正在成为AI Agent落地必须面对的一道坎。

夜雨聆风

夜雨聆风