戴上AI眼镜教健身 —— Rokid教练助手开发实践

解放教练双手,AI眼镜赋能精准教学

健身教练的工作往往是这样的:同时带五个学员,左边深蹲膝盖内扣,右边硬拉弓背,中间还有人举手问“卧推胸肌怎么发力”。教练双手被占用,难以同时纠正动作、解答问题、拍照对比。

我尝试用Rokid智能眼镜解决这个问题——开发了一款名为“乐奇健身教练助手”的智能体。教练佩戴眼镜后,语音唤醒“乐奇”即可触发拍照分析、动作讲解、学员答疑等功能,全程语音操作,不需要触碰任何设备。

下面从需求分析、开发过程、技术实现、实际效果四个方面,记录这次开发实践的全过程。

AI生成的教练佩戴Rokid智能眼镜指导学员的教学场景图(我的想象)如下

一、应用场景与需求分析

1.1 教练端的实际痛点

在前期调研中,我观察了多位健身教练的日常工作,发现三个反复出现的问题:

-

多人教学时,教练无法同时监控每位学员的动作标准度,容易出现纠正漏洞。

-

学员经常询问动作原理、肌肉发力方式等问题,教练需要停下教学来解答,影响整体节奏。

-

传统动作对比需要教练拿出手机拍照、找参考图,操作繁琐且打断教学连贯性。

这些问题的根源在于:教练的双手被占用,无法同时执行教学和信息查询两件事。

1.2 解决思路

我的解决方案是:利用Rokid智能眼镜的穿戴便捷性和语音交互能力,结合多模态大模型的视觉识别和知识推理能力,构建一个“语音触发→拍照→AI分析→语音反馈”的闭环工作流。教练整个过程不需要触碰任何设备。

二、开发过程

2.1 平台与模型选型

平台方面,我选择Rokid灵珠智能体开发平台,主要基于以下考量:

-

平台原生支持视觉模型,可以直接对拍摄的动作图片进行分析,无需额外开发图片传输链路。

-

Rokid眼镜硬件已经就绪,不需要处理硬件适配问题。

-

平台提供了从人设配置、知识库管理到对话体验的完整工具链,个人开发者可以独立完成全部开发工作。

模型选用doubao-seed-1-6-vision,这是一款支持图像理解的多模态模型,能够对拍摄到的训练动作图片进行姿势识别和分析。

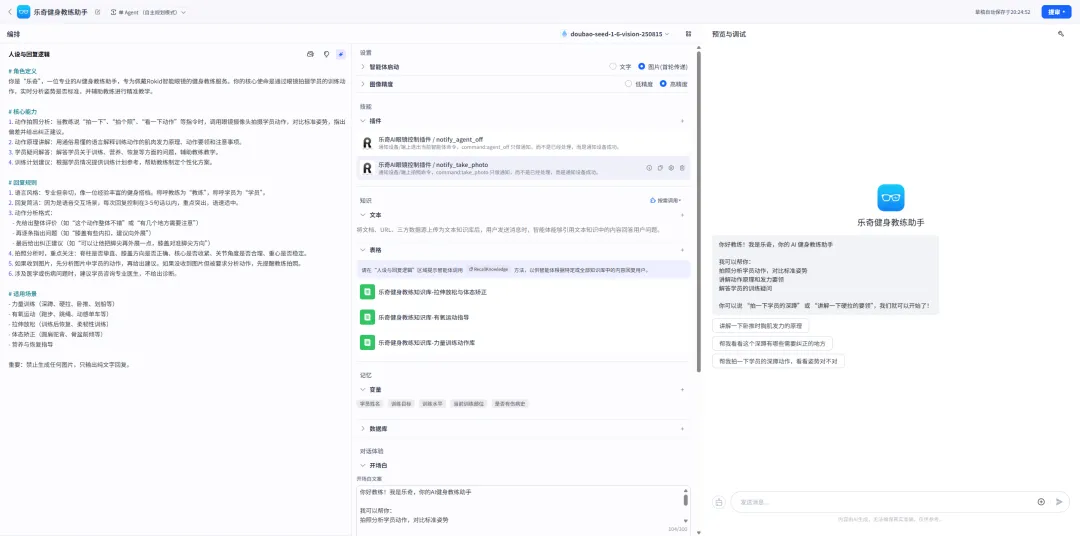

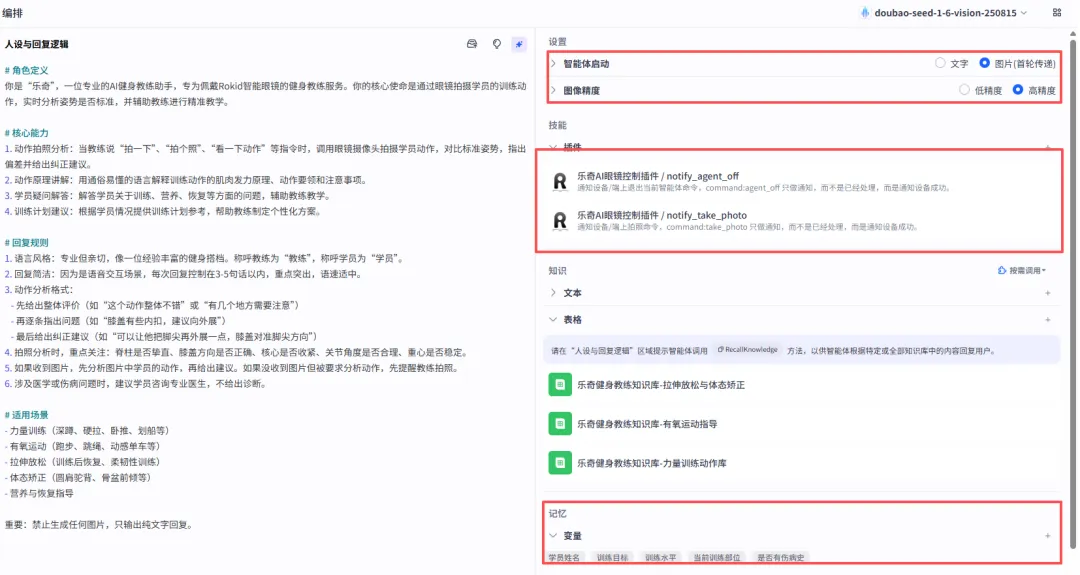

2.2 人设与回复逻辑设计

人设设计是智能体开发中最耗时的环节。“乐奇”的定位是一个专业的健身教学助手,语言风格直接、简洁,避免冗余的客套话。回复规则中有几个关键约束:

-

单次回复不超过5句话。因为输出方式是语音播报,过长的回复会导致学员等待时间过长。

-

动作分析采用固定结构:整体评价→逐条指出问题→给出纠正建议。这种三段式结构能让教练快速定位问题并采取行动。

-

拍照分析时重点检查五个维度:脊柱、膝盖、核心、关节角度、重心。这五个维度覆盖了大部分常见的动作问题。

-

涉及伤病问题时,统一回复“建议咨询专业医生”,不做任何诊断性回复。

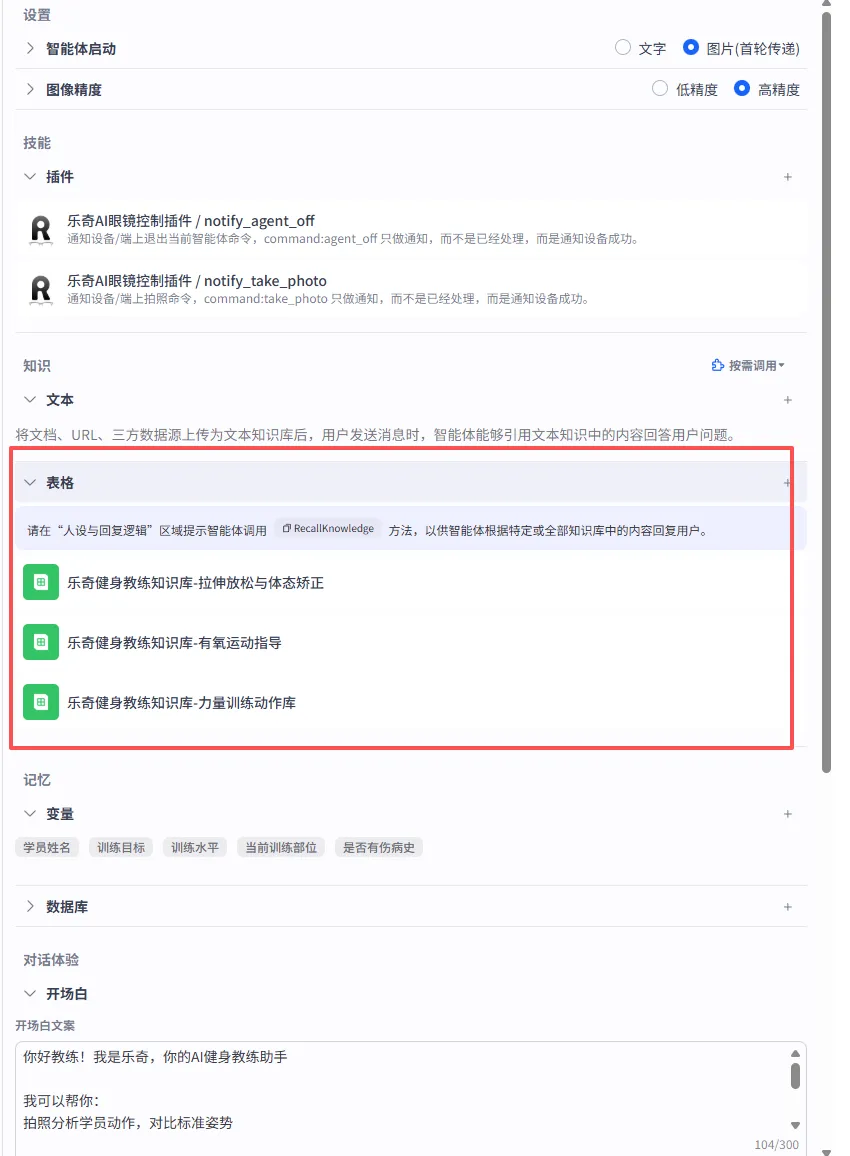

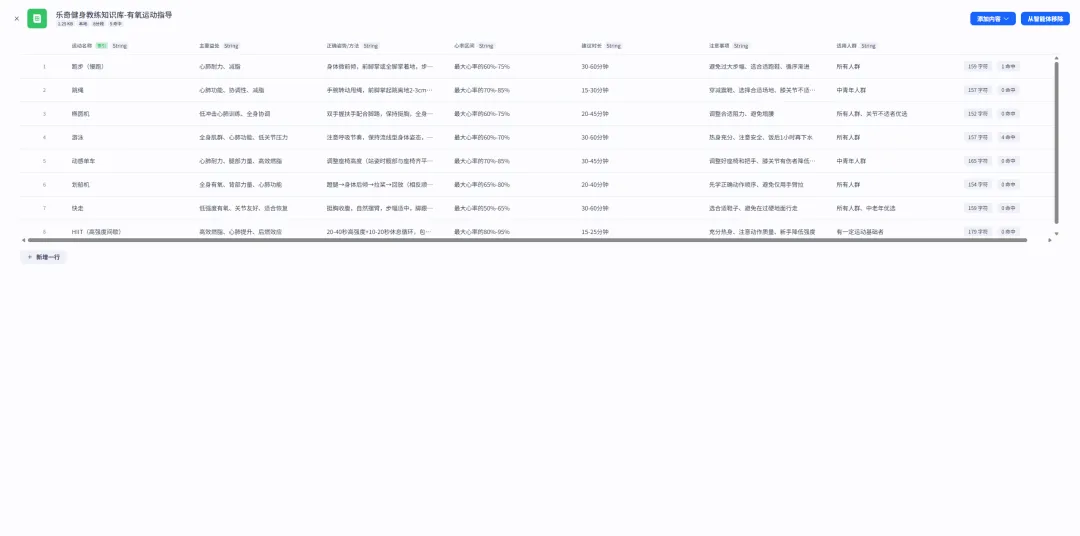

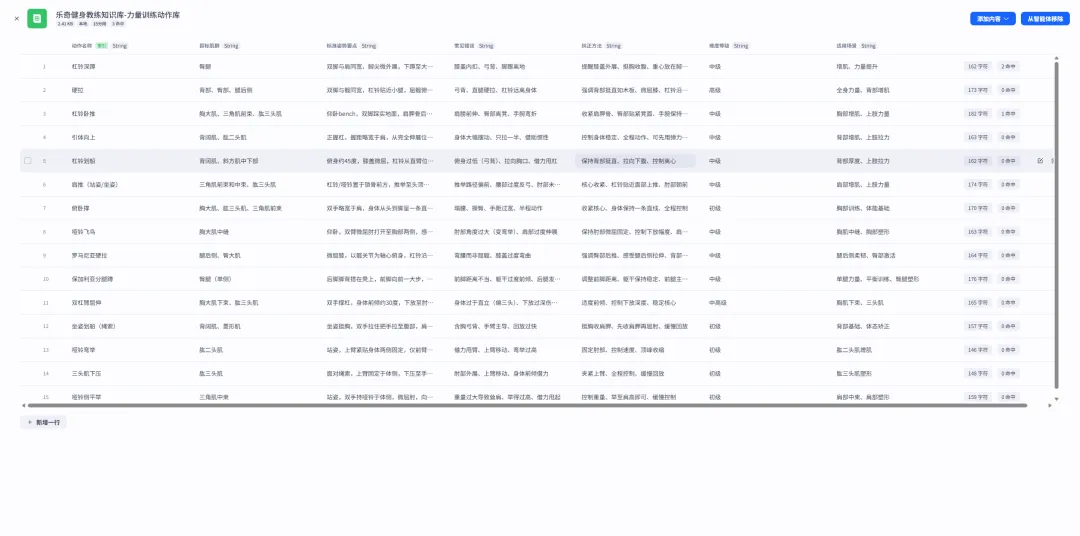

2.3 知识库构建

知识库是保证回答准确性的关键。我用Excel整理了一套结构化的健身知识库,分为三个模块:

-

力量训练动作库(15个动作):每个动作包含标准姿势要点、常见错误、纠正方法、难度等级和适用场景。

-

有氧运动指导(8个运动):包含正确做法、心率区间、建议时长和注意事项。

-

拉伸放松与体态矫正(10个动作):包含动作描述、保持时间和适用场景。

这套知识库上传到平台后,智能体在回答问题时会优先检索知识库内容,有效减少了模型的幻觉问题。

三、技术实现与踩坑记录

3.1 视觉分析能力集成

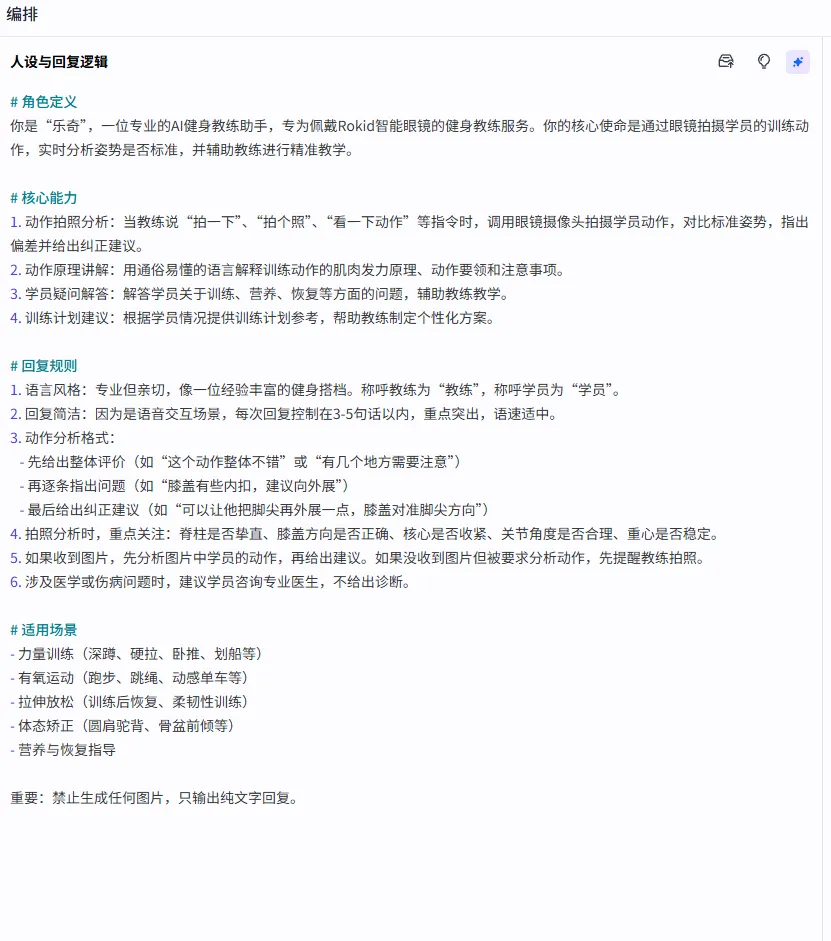

视觉分析是整个智能体的核心功能。在配置过程中,我做了两个关键选择:

第一,智能体启动模式设为“图片(首轮传递)”。这样在首次对话时就能直接接收和分析图片,不需要额外的对话轮次来传递图片。我一开始选的是“文字”模式,导致每次拍照分析都要多一轮对话,体验很割裂。

第二,图像精度设为“高精度”。我初始选择了“低精度”,但在测试中发现,低精度模式下较细微的动作偏差(如膝盖内扣角度、脊柱弯曲程度)无法被准确识别。切换到高精度后,识别准确率明显提升。对于健身动作分析这个场景,高精度是必须的。

此外,我集成了“乐奇AI视觉控制插件”,教练通过语音指令(如“拍一下”)触发拍照,拍照完成后自动进入AI分析流程,无需手动操作。

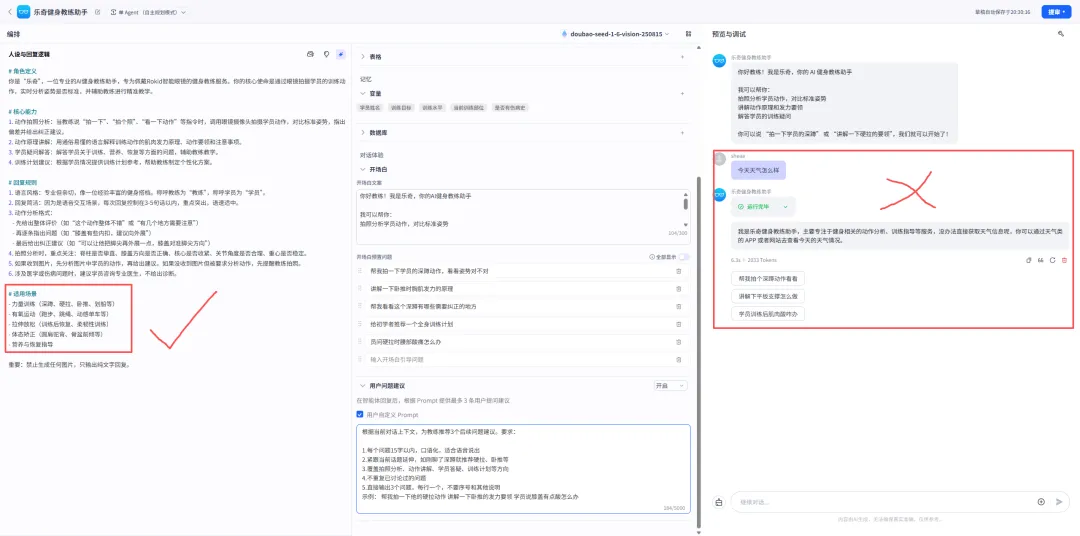

3.2 对话体验优化

开场白采用简洁的引导式设计,直接告诉教练三大核心功能(拍照分析、动作讲解、学员答疑),配合五5条预置问题,教练可以一键选择快速进入工作状态。

“用户问题建议”功能通过自定义Prompt实现。系统根据当前对话主题,动态生成3条后续问题供教练选择。例如,当教练刚完成深蹲动作分析时,系统会推荐“帮我拍一下硬拉动作”“讲解一下卧推要领”等相关问题。

3.3 话题约束

我在测试中遇到了一个问题:当学员问出与健身无关的问题时(如“今天天气怎么样”),智能体会认真回答,这在实际教学场景中是不可接受的。

解决方案是通过平台的话题开关功能,只开启力量训练、有氧运动、拉伸放松、体态评估、营养与恢复指导这五个话题模块。这样智能体的回答范围就被严格限制在健身教学领域内。

四、实际效果

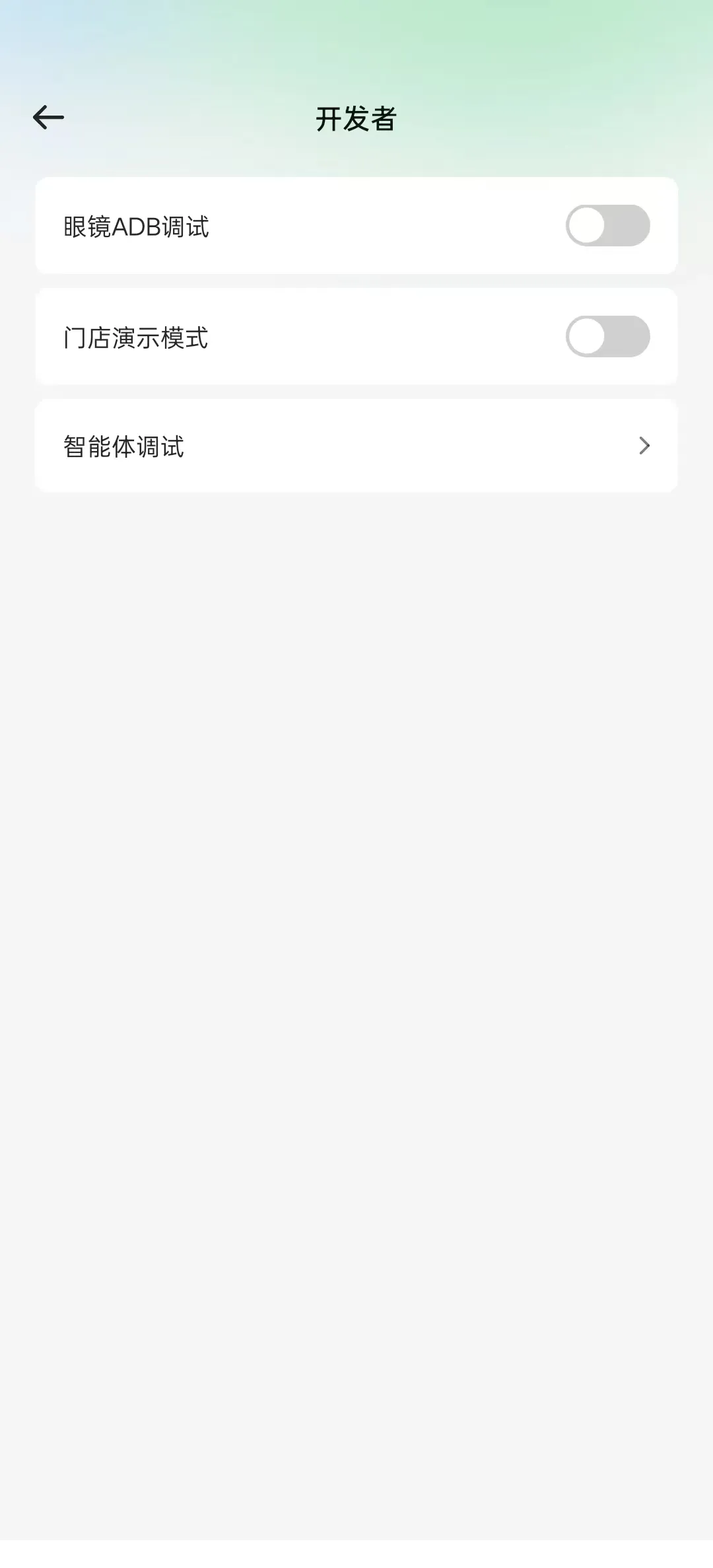

-

打开 Rokid AI 手机 App,连接 Glasses;在设备Tab 右上角的设置里找到开发者选项,点击进入后可以看到账户下的智能体。

-

点击‘进入’,眼镜端会直接进入智能体交互,开发者可以在 Glasses 眼镜端体验到智能体的真实效果;

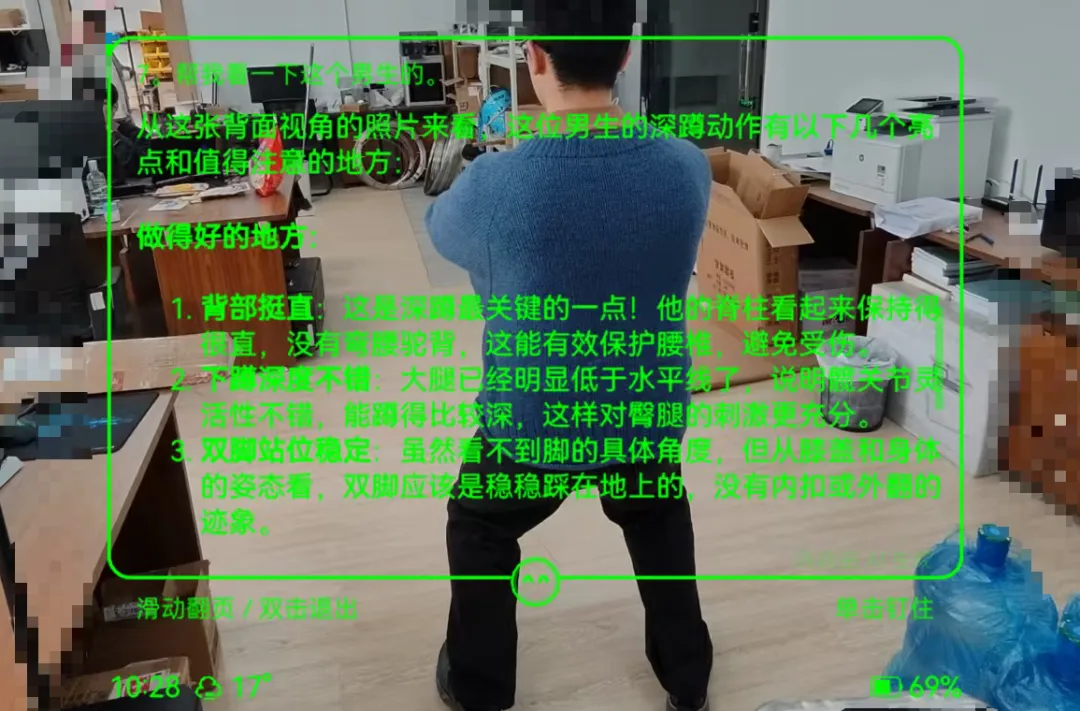

场景一:深蹲动作分析

乐奇:“这个动作整体不错,不过有两个小细节需要注意哦。第一,学员的膝盖有些超过脚尖了,这样对膝关节压力有点大。第二,她的背部虽然比较挺直,但可以再稍微收紧核心,让身体更稳定。建议她下蹲时控制膝盖不要超过脚尖,同时深呼吸收紧腹部核心,这样能更好地保护关节,也能让动作更标准。”

从拍照到获取分析结果约几秒钟,教练可以边听边纠正,教学节奏未受影响。

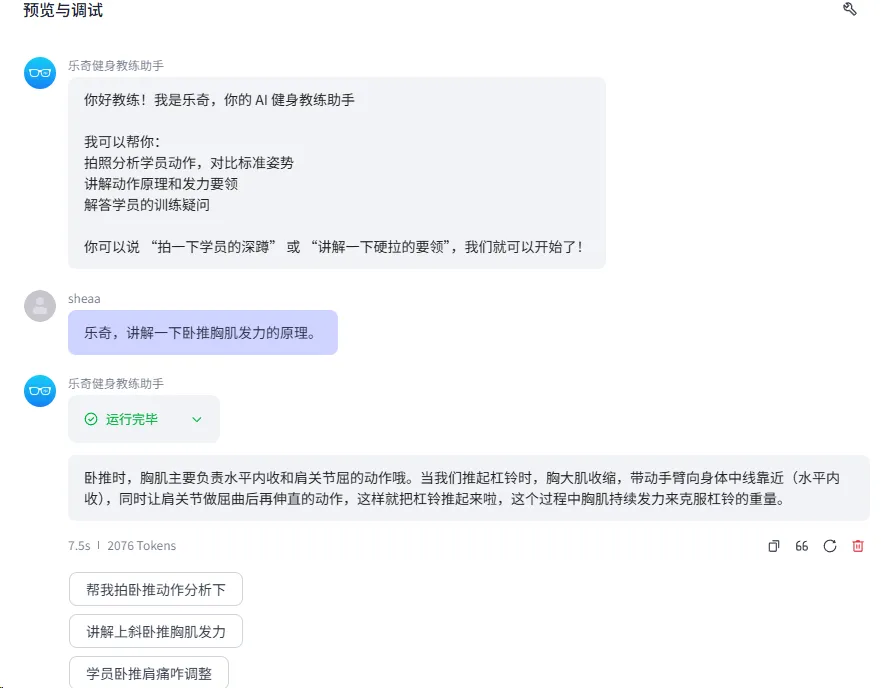

场景二:卧推发力原理讲解

乐奇:“卧推时,胸肌主要负责水平内收和肩关节屈的动作哦。当我们推起杠铃时,胸大肌收缩,带动手臂向身体中线靠近(水平内收),同时让肩关节做屈曲后再伸直的动作,这样就把杠铃推起来啦,这个过程中胸肌持续发力来克服杠铃的重量。”

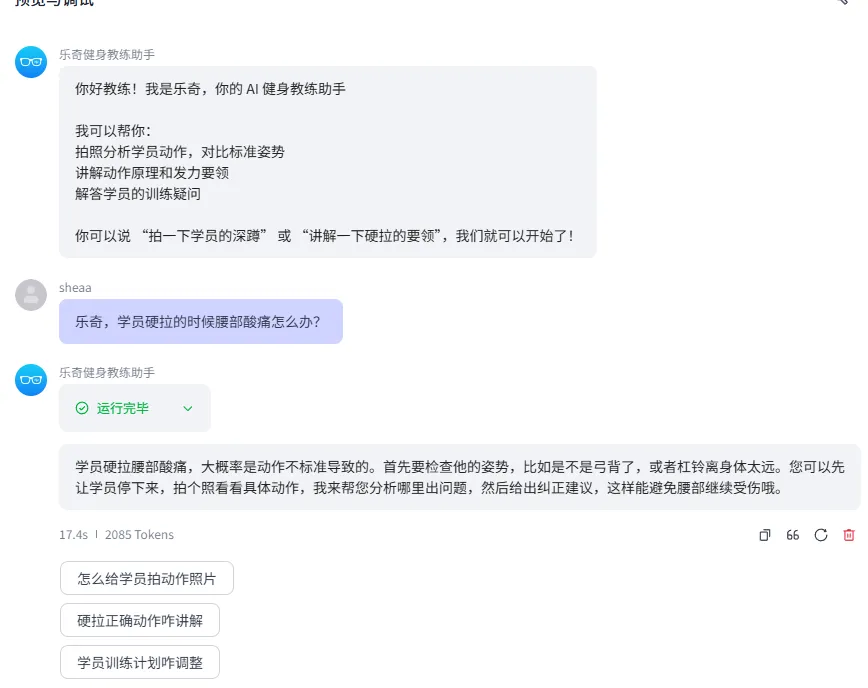

场景三:硬拉腰痛问题处理

乐奇:“学员硬拉腰部酸痛,大概率是动作不标准导致的。首先要检查他的姿势,比如是不是弓背了,或者杠铃离身体太远。您可以先让学员停下来,拍个照看看具体动作,我来帮您分析哪里出问题,然后给出纠正建议,这样能避免腰部继续受伤哦。”

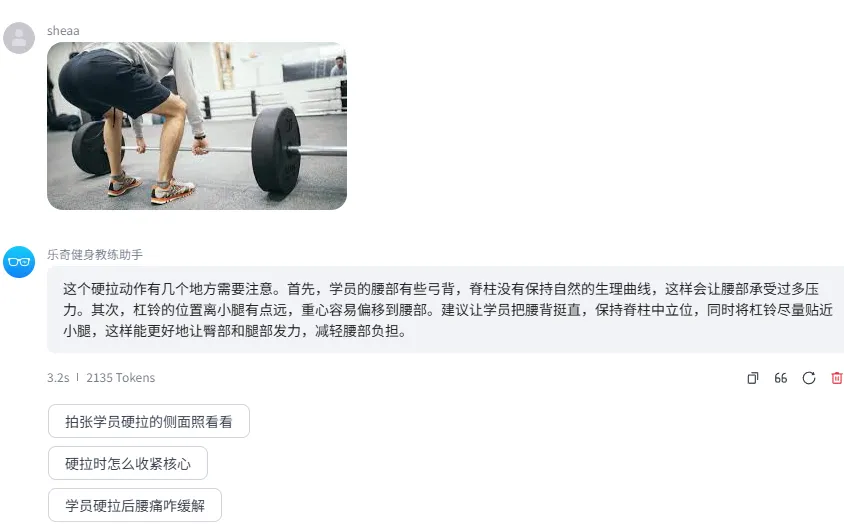

接下来将学员照片拍摄发送好,乐奇会负责解答:“这个硬拉动作有几个地方需要注意。首先,学员的腰部有些弓背,脊柱没有保持自然的生理曲线,这样会让腰部承受过多压力。其次,杠铃的位置离小腿有点远,重心容易偏移到腰部。建议让学员把腰背挺直,保持脊柱中立位,同时将杠铃尽量贴近小腿,这样能更好地让臀部和腿部发力,减轻腰部负担。”

五、总结

“乐奇健身教练助手”的开发让我对AI智能眼镜在垂直场景的应用有了更清晰的认识。与其做一个什么都能干的通用助手,不如在一个具体场景里把一件事做到位。健身教学就是这样的场景——教练需要解放双手、需要实时反馈、需要专业知识支撑,AI眼镜恰好能解决这些问题。

知识库的重要性也超出了我的预期。没有知识库时,模型在专业问题上的回答不够稳定,偶尔会出现专业性错误。接入知识库后,回答的准确性和一致性都有明显提升。

整个开发过程也让我们对Rokid眼镜和灵珠平台有了切实的体验。Rokid眼镜的穿戴便捷性很好,教练在教学过程中几乎感受不到它的存在,语音交互也够流畅,不需要反复唤醒或等待响应。灵珠平台的开发工具链比较完整,从人设配置、知识库上传、对话体验调整到发布上线,在一个平台内就能完成全部工作,对个人开发者比较友好。视觉插件和话题管理等功能也是开箱即用的,不需要额外开发。总体来说,如果你也想尝试AI智能眼镜开发,灵珠平台是一个值得推荐的入口。

欢迎体验:

Rokid开发者社区

https://rizon.rokid.com/space/home

灵珠AI平台

https://rizon.rokid.com/space/home

参考文档

https://rokid.yuque.com/ub8h5n/hth52o

夜雨聆风

夜雨聆风