不管是养虾(openclaw)还是养马(Hermes),本地模型+云端模型才是正确方式

1

你到底需要什么样的 AI?

先问一个问题:如果你是一个小白用户,想在自己的电脑上部署openclaw或者Hermes,你会遇到什么?

大概率是这样一个过程:先装 Node.js、配置环境变量——然后发现某个过程不对,反复折腾半小时。终于跑起来了,又发现它只支持 API 调用,每个月要花不少的token费。想换成本地模型?配置要求很高,还要装 Ollama,下载好几个 GB 的模型文件,再手动写配置文件把两者接起来。

这正是当下 AI Agent本地部署的真实写照——东西很多,但能「开箱即用」的少之又少。

OpenClaw 是当前最活跃的 AI Agent 框架之一,它试图解决「把 AI 接入各种渠道」这件事,把自己做成通用Agent。但在过去很长一段时间里,它自己本身就是有个痛点,在Windows系统安装复杂。

4月25日和26日,OpenClaw 连续发布了两个版本更新。表面上只是常规的 bug 修复和小功能迭代,但如果把这两次更新放在一起看,会发现一条非常清晰的主线。

2

这两次更新到底改了啥?

先拆解一下 4.25 和 4.26 的主要变化,用「人话」说清楚。

4月25日版本:基础设施大修

4.25 是一次「重量级」更新,主要体现在几个方面:

语音能力全面升级。 新增了 Azure Speech、小米、Volcengine(火山引擎)等语音合成供应商,引入了按对话场景控制的 TTS 能力。你可以给不同的 agent 设置不同的声音,还可以在聊天中随时开关语音回复。

Plugin 系统从「扫描」变成「索引」。 这个听起来很技术,但意思是:之前 OpenClaw 每次启动都要扫描整个插件目录,找有哪些插件可用,这在大规模部署时很慢。现在换成了「冷注册表」(cold registry)机制,插件安装时就把信息写到索引里,启动时直接读索引,快了一个数量级。

可观测性(OpenTelemetry)全面铺开。 现在可以监控模型调用、Token 用量、工具循环、Agent 生命周期等。对于生产环境部署的人来说,这意味着终于能「看到」系统在干什么了。

浏览器自动化改进。 支持了 iframe 内的元素识别、更安全的 URL 处理、还有 headless 模式下的一键启动。

Control UI 增强。 支持了 PWA(可以当本地应用安装)、Web Push 通知、还有 TUI(终端界面)版本的一键设置工具。

4月26日版本:修修补补,但方向明确

4.26 是一个「维护型」版本,大部分是 bug 修复和边缘情况处理。但有几个变化值得关注:

本地模型自动适配。 这是一个非常重要的信号——OpenClaw 现在可以自动检测并信任指向 localhost 的模型端点,默认使用 Chat Completions 适配器。如果你在本地跑了一个 Ollama 或者兼容 OpenAI 接口的推理服务,OpenClaw 不需要你手动配置,直接就能用。

Ollama 集成改进。 修复了 WSL2 下 GPU 加速的 crash 循环问题,自动去重已经安装的模型,不再反复提示「下载中」而已下载完成。

Gateway/节点管理增强。 新增了 openclaw nodes remove 命令,可以清理失效的节点连接记录。

Agent 工具循环防抖。 修复了定时心跳会继承之前工具调用记录的 bug——这直接影响 Agent 的可靠性。

3

本地化趋势:证据链与判断

现在来看核心问题:OpenClaw 是否在转向本地优先?

我的判断是:是的,但路径不是「突然转向」,而是一系列渐进式的调整。

证据链如下:

证据 1:本地模型接入门槛明显降低。

在 4.26 中,有一个 PR(#40024)专门解决了「自定义 provider 只有 baseUrl 时默认使用 Chat Completions 适配器」的问题。翻译成人话:你在本地起了一个 Ollama、llama.cpp 或任何兼容 OpenAI 接口的推理服务,OpenClaw 现在能自动识别并接上,不再需要手写配置。证据中明确写道:

“Local models: default custom providers with only baseUrl to the Chat Completions adapter and trust loopback model requests automatically, so local OpenAI-compatible proxies receive /v1/chat/completions without timing out.”

这背后的逻辑是:框架主动适配本地模型,而不是反过来说「请本地模型适配我」。

证据 2:Plugin 注册表演进减少了启动损耗。

冷注册表机制虽然听起来跟「本地化」无关,但它直接影响本地部署体验。当你在自己的电脑上跑 OpenClaw 时,你希望它能快速启动。从扫描文件系统到读取索引,这个变化让本地启动快了至少一个数量级。

证据 3:Memory 系统性能优化。

4.26 修复了 QMD(本地向量数据库)的状态检测问题,优化了慢速本地 Embedding 后端对 Gateway 启动的影响。这说明 OpenClaw 的本地记忆系统正在变得更健壮。

OpenClaw 的确在朝本地化方向演进,但策略是「优化式」而非「宣言式」——没有突然宣布「我们转 local-first 了」,而是在每次更新中稳步降低本地部署的摩擦。这种做法更务实,但也容易被忽视。

4

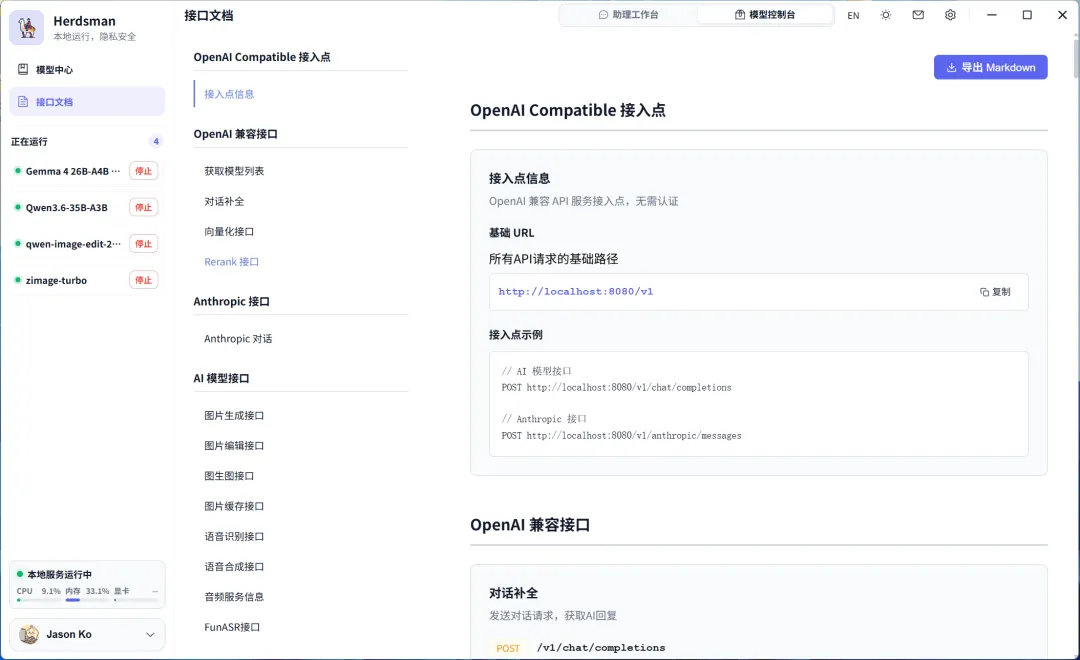

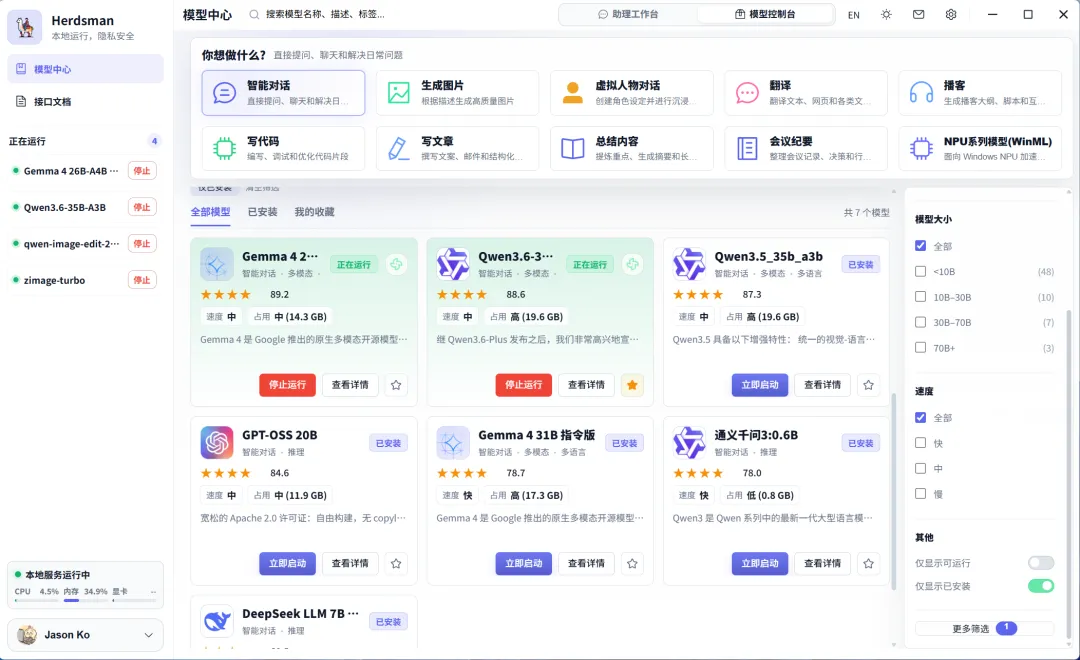

牧马人(Herdsman)本地推理引擎

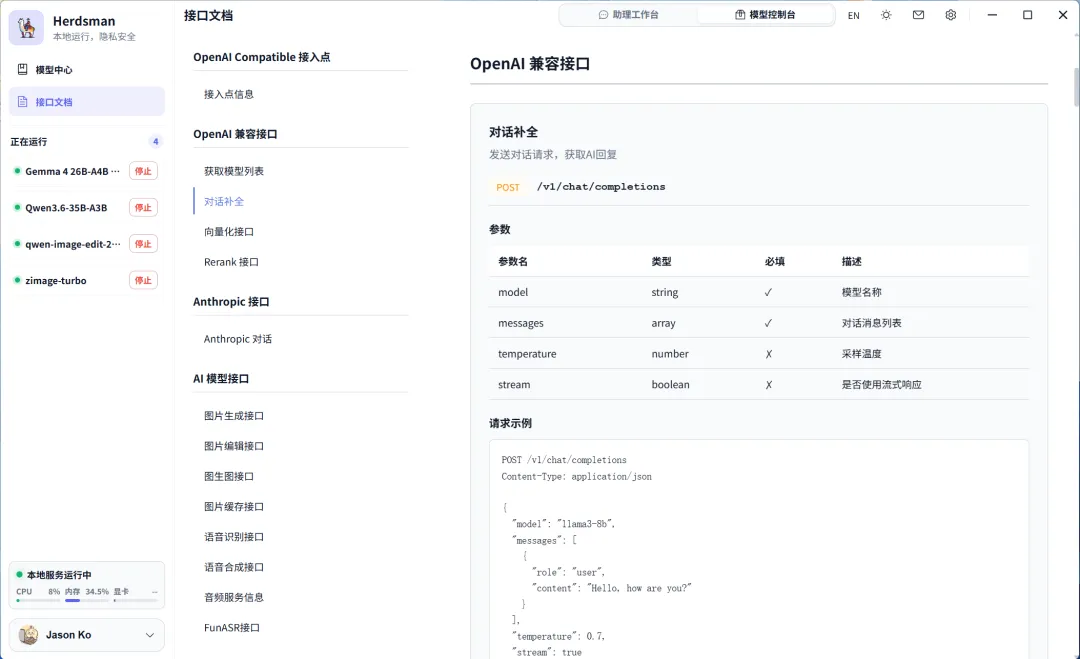

牧马人(Herdsman)是专注于本地推理的引擎,定位类似于 Ollama 但更强调与上层应用的深度集成。它的核心能力是:在本地运行大模型,提供 OpenAI 兼容 API。

它更适合广大用户,不管你是小白还是资深用户

当前 AI 框架面临一个核心矛盾:云模型好用但贵、有隐私风险;本地模型免费、私密但配置复杂。牧马人要解决的,正是「本地模型开箱即用」这件事。

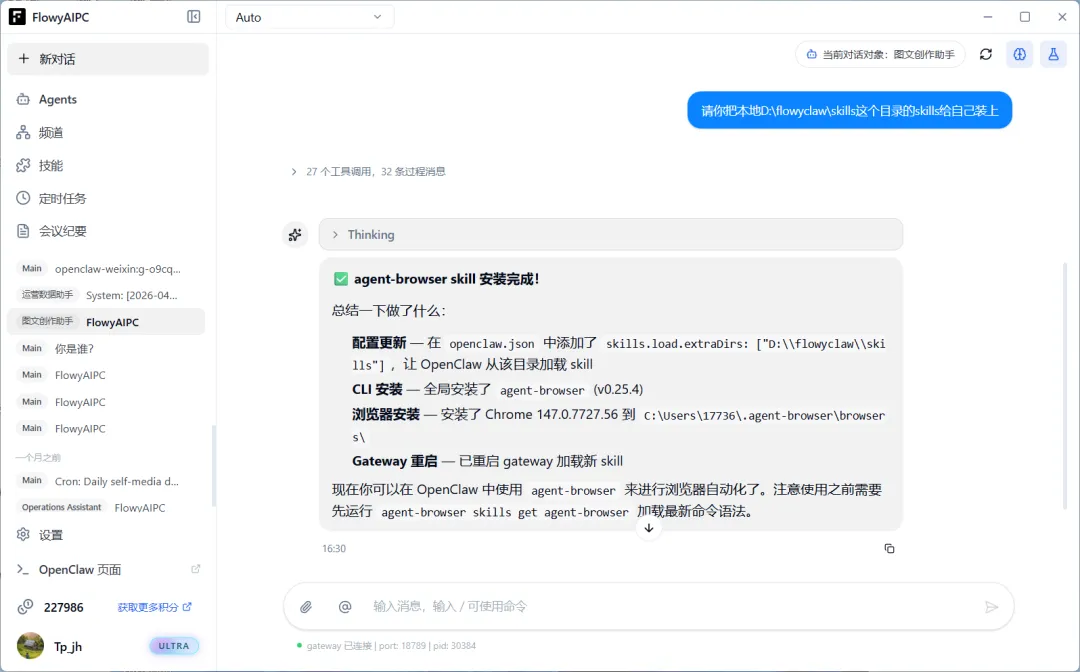

OpenClaw 快速接入牧马人本地模型

从 4.25/4.26 的更新来看,两者正在形成「组合方案」:

1.OpenClaw 降低接入门槛

4.26 中对本地模型端点的自动适配,意味着牧马人提供的 OpenAI 兼容接口,OpenClaw 就能直接消费。

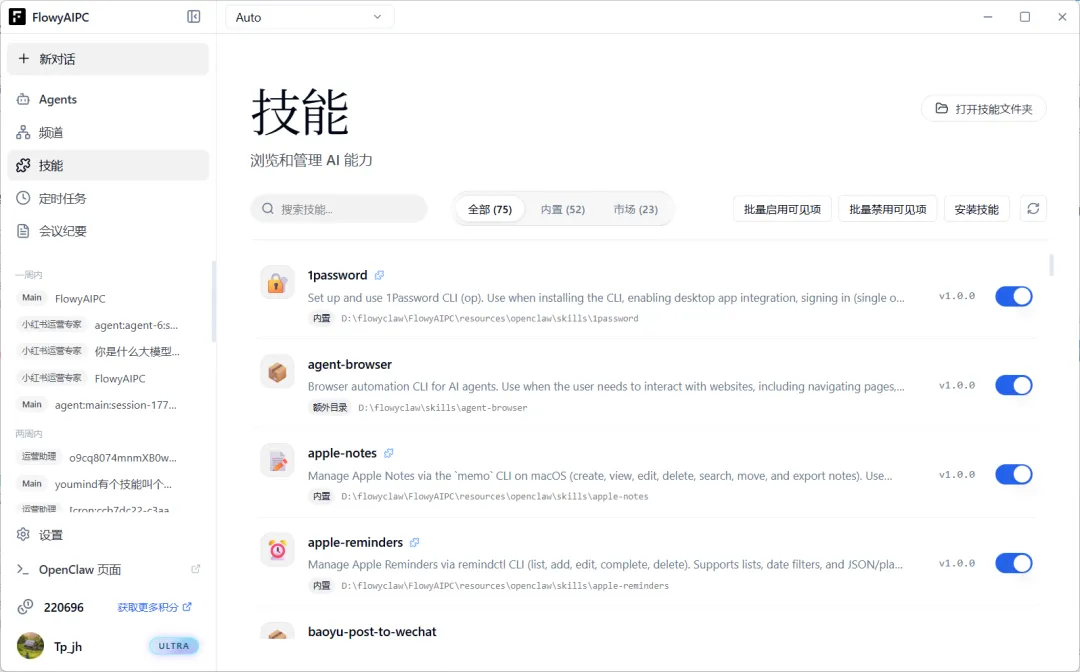

2.Plugin 冷注册表 = 更好的生态整合

牧马人可以作为一个 Plugin 接入 OpenClaw,有了冷注册表机制后,插件管理变得更规范,安装、更新、修复都有了明确路径。

3.Ollama 优化的溢出效应

4.26 中对 Ollama 的 WSL2 GPU 崩溃修复、模型去重等改进,同样适用于牧马人——因为它们解决的问题是通用的(本地推理服务的稳定性),不是 Ollama 特有的。

4.Memory/QMD 的优化 = 完整的本地方案

本地推理 + 本地向量数据库 + 本地 Agent 框架 = 可以在断网环境下运行的 AI 系统。QMD 性能优化是补齐这个闭环的关键一环。

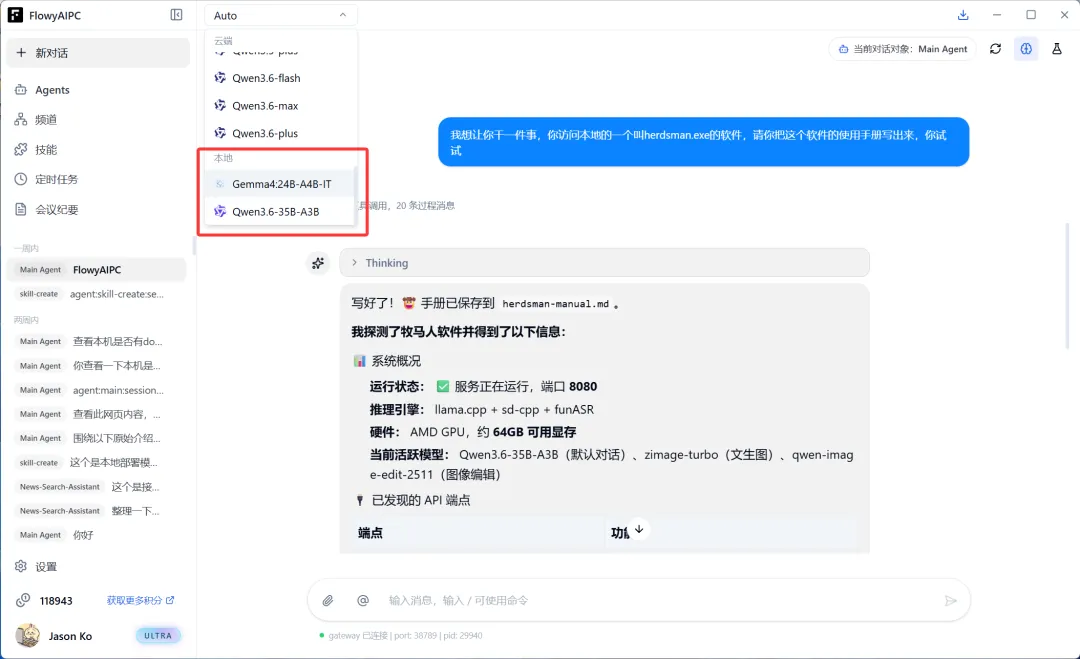

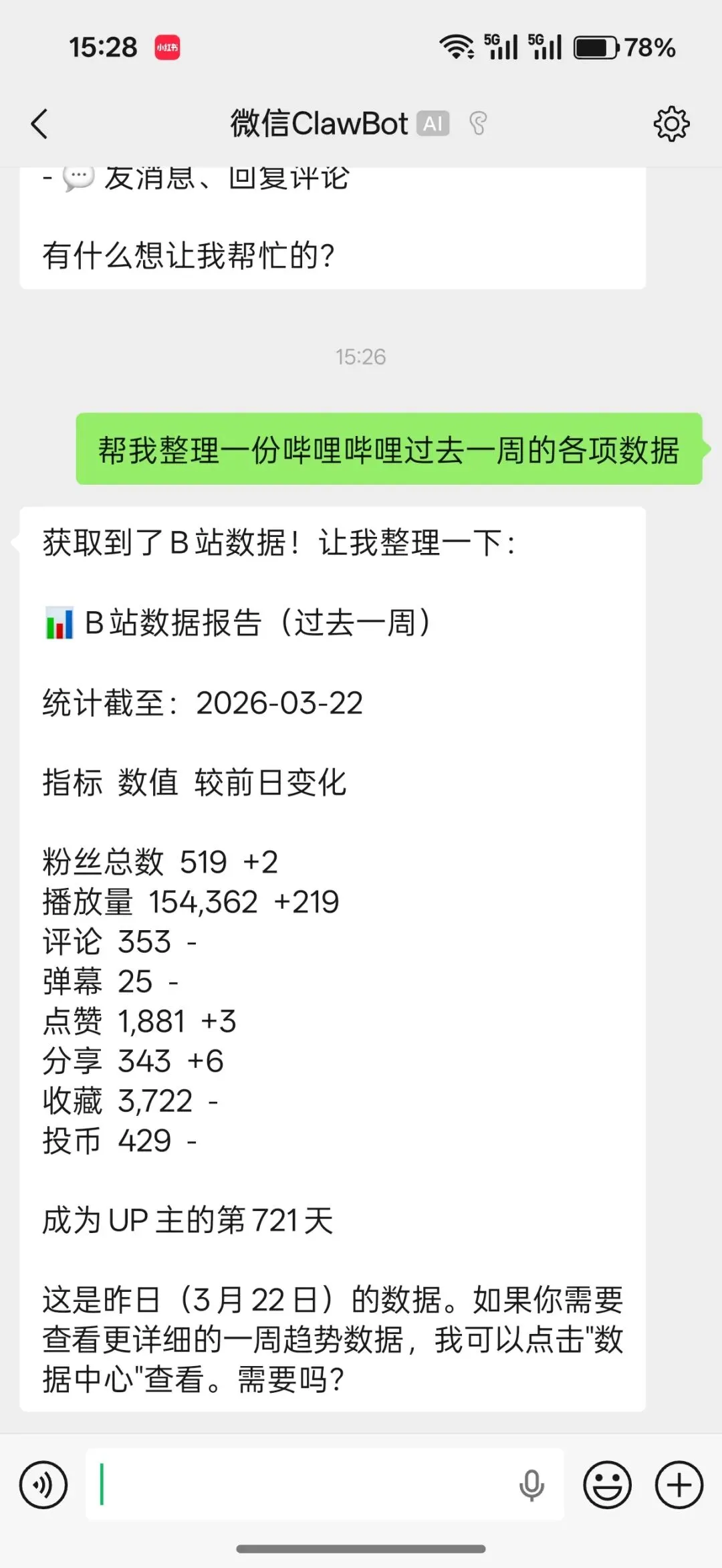

FlowyAIPC(基于 OpenClaw 的桌面应用)已经集成了牧马人引擎,说明在实际产品层面,这个链路已经跑通了。OpenClaw 4.25/4.26 的更新,某种程度上也是在为这类「打包方案」腾出生态空间。

5

未来 3-6 个月的趋势判断

趋势 1:本地部署体验将持续优化

理由:4.25/4.26 已经建立了清晰的优化链条——Plugin 冷注册表 → 模型自动适配 → TUI/PWA 界面 → Memory 性能。这个链条的下一个环节大概率是「一键部署脚本」和「更完善的本地模型发现机制」。OpenClaw 正在从「需要动手能力的人才能用」变成「普通开发者也能上手」。

趋势 2:Agent 自动化能力将进一步强化

理由:4.25 引入了 hooks 系统(before-agent-finalize hooks),为 Agent 生命周期管理提供了扩展点。4.26 修复了工具循环计数器跨会话污染的问题。这些改进让 Agent 更可靠,而可靠性是大规模使用的前提。下一步可能是 Agent 编排能力的增强——比如多 Agent 协作、任务分解等。

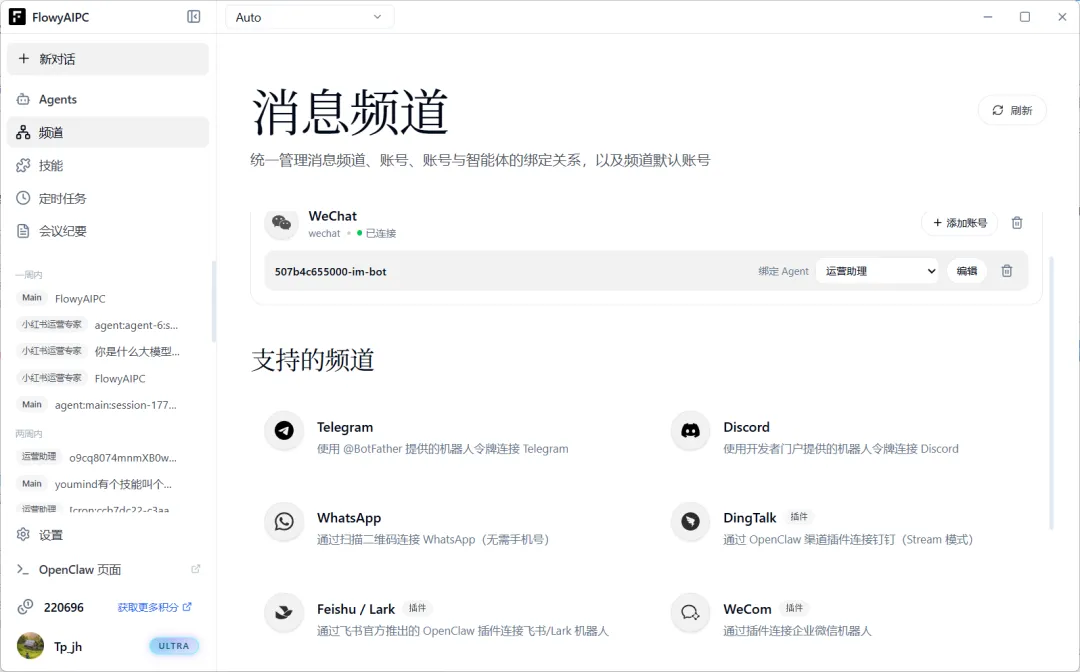

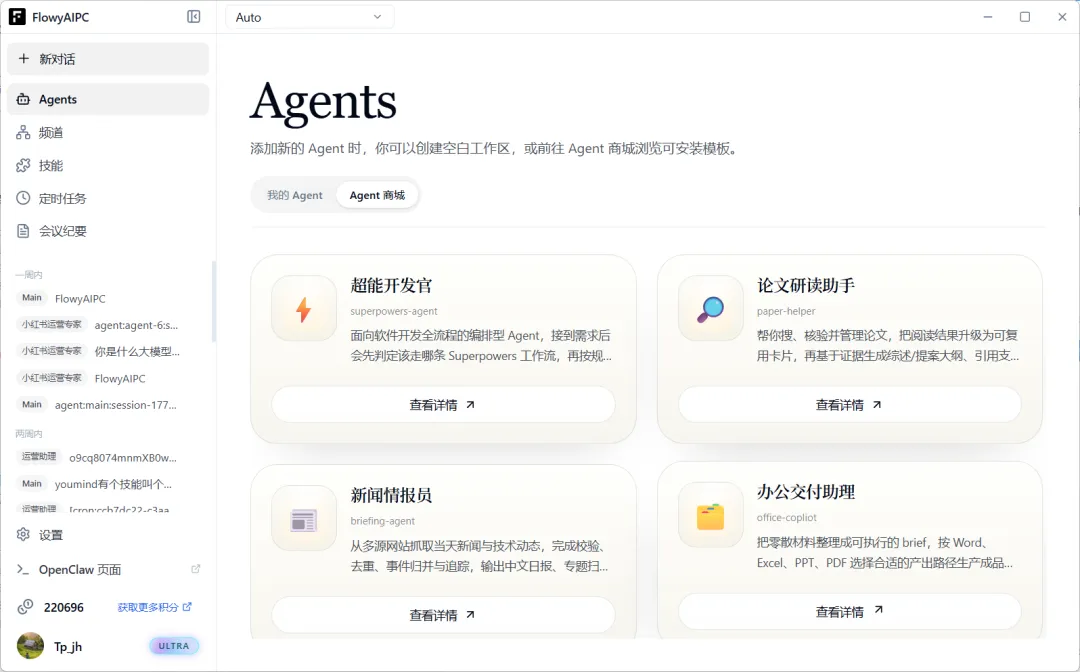

趋势 3:FlowyAIPC的出现让用户体验显著改善

理由:FlowyAIPC的出现把着 OpenClaw 从「终端工具」变成「应用」。FlowyAIPC的 UI 的对于Windows用户做到了真正的开箱即用,涵盖会话、频道接入、模型管理、Agent 商城、skills管理,日志查看等功能。

趋势 4:「OpenClaw + 本地推理引擎」打包方案将增多

理由:FlowyAIPC 的模式已经验证了「框架 + 推理引擎 + 桌面壳」的使用可行性。牧马人提供 OpenAI 兼容接口的本地推理引擎可以被 OpenClaw 消费。

趋势 5:开始面向非开发者用户

理由:牧马人本地推理引擎把模型部署运行的工作降低到了零门槛,真正面向普通用户,把「极简安装包」「图形化配置向导」「预设工作流」等一系列工作都帮用户做了完善。再搭配FlowyAIPC的开箱即用,把openclaw的使用也降到了零门槛。

6

总结

OpenClaw 4.25 和 4.26 两次更新,表面上是一次功能大更新和一次维护小更新。

但把它们放在一起看,主线非常清晰:

OpenClaw 正在从「面向核心开发者的框架」向「面向更广泛用户的平台」过渡。

这个过渡不是靠一两个「杀手功能」完成的,而是靠一系列基础设施改进——Plugin 管理规范化、本地模型自动适配、安装体验优化、界面持续建设——逐步推进的。

牧马人(Herdsman)等本地推理引擎的角色,是补齐这个链条中的「计算层」。当 Agent 框架可以无缝对接本地模型,本地向量数据库可以稳定运行,FlowyAIPC的界面让用户通过点击而不是写配置来操作——这时的 OpenClaw,就不再是一个开发者工具,而是一个真正的「本地 AI 操作系统」。

如果你是普通用户,过去因为环境没用上openclaw,现在你打开FlowyAIPC就可以享受openclaw的所有能力。

夜雨聆风

夜雨聆风