一边写代码一边看视频和 PDF:GPT-5.3 Codex 对上 Gemini 3 Pro,这次该怎么选?

大家好,我是易安,AI超级个体,大厂程序员二孩奶爸。

一边写代码一边看视频和 PDF:GPT-5.3 Codex 对上 Gemini 3 Pro,这次该怎么选?

写在前面

现在再看 AI 模型对比,已经不能只盯着“会不会写代码”了。

真正拉开差距的,越来越像是两种完全不同的工作方式:一种是把模型当强执行力的编程 Agent,重点看代码生成、调试、工程落地;另一种是把模型当超大上下文的信息处理器,重点看它能不能同时吃下整套代码库、文档、图片、音频、视频,然后继续稳定推理。

这也是 GPT-5.3 Codex 和 Gemini 3 Pro 这组对比最有意思的地方。表面上它们都在争“下一代 AI 开发工具”的位置,但真落到使用场景里,一个更像工程执行专家,一个更像多模态大脑。问题不是谁绝对更强,而是:你手上的任务,到底更偏“交付代码”,还是更偏“处理复杂信息再做决策”?

真正该看的,不只是代码能力,而是模型正在接管哪一段工作流

很多人现在还习惯拿 benchmark 当最终答案,但对开发者和团队来说,benchmark 最多只能回答“它大概有多强”,回答不了“它适不适合你的工作流”。

这一轮对比里最值得注意的,不是 OpenAI 和 Google 又各自发了个新模型,而是两边明显在押不同方向:

-

• OpenAI 继续把 Codex 往工程执行层推,强调编程任务、调试、跨文件改动、软件构建。 -

• Google 则把 Gemini 3 Pro 往信息处理和生态协同层推,强调超长上下文、多模态理解,以及和 Google Workspace 的深度结合。

说白了,一个更像“能把活干完的工程 Agent”,一个更像“能把大量材料都吃进去再一起分析的认知引擎”。

如果你的团队已经开始把 AI 接进真实开发流程,那这个差异会非常实际。因为以后决定效率上限的,不只是模型智力,而是你把它接在工作流的哪一环。

GPT-5.3 Codex 在做什么:继续强化“工程执行”这条线

先看 OpenAI 这边。GPT-5.3 Codex 在这篇对比里被放在“编程专用模型”的位置上理解,这个定位其实很清楚:它不是泛用聊天模型顺手会写代码,而是专门往软件工程任务上靠。

文章里提到,它支撑像 Codex app 这样的工具,可以做跨文件重构、独立构建和调试软件,也可以通过 API 接进你自己的开发工具链。对开发者来说,这种能力最有价值的地方不在于“能不能生成函数”,而在于它开始接手完整工程动作。

更关键的是企业侧条件。OpenAI 给出的卖点不只是代码能力,还有更偏落地使用的那一套:

-

• SOC 2 Type 2 合规 -

• API 数据不用于训练模型 -

• 在特定行业里可谈 BAA / HIPAA 这类要求

这意味着如果你处理的是内部代码、企业知识、医疗或受监管数据,Codex 这一侧的吸引力不只是“模型聪明”,而是“它更像一个能进入正式流程的工具”。

Gemini 3 Pro 在做什么:把“超大上下文 + 多模态”推到更前面

再看 Gemini 3 Pro,它走的是另一条路线。

Google 给它的核心标签不是“写代码专精”,而是 multimodal + long context。也就是说,它不是只擅长文字推理,而是原生支持文本、图片、视频、音频、PDF 这类多种输入,并且能在一个超大的上下文窗口里同时处理大量信息。

这篇文章里给出的关键数字是 1,048,576 token 上下文窗口。这个数字真正有意义的地方,不是拿来炫配置,而是代表它能把许多过去要拆很多轮才能做的事,一次性装进去处理。比如:

-

• 把一整套代码库喂进去找跨模块 bug -

• 把多年合同、法务材料一次性读进去追溯某个案例 -

• 把用户历史工单、聊天记录、附件一起整合分析 -

• 直接对视频、音频内容做理解和归纳

如果你的工作不只是“产出代码”,而是经常要面对大量异构资料,Gemini 3 Pro 的价值就会变得很具体。

它的另一个优势是生态。对已经深度使用 Gmail、Docs、Workspace 的团队来说,Gemini 往往不是“额外接一个工具”,而是更自然地长在现有工作环境里。

把能力放到一起看:Gemini 赢在更宽的信息面,Codex 赢在更稳的工程落地感

代码与软件工程:Gemini 3 Pro 略强,但差距不是碾压式的

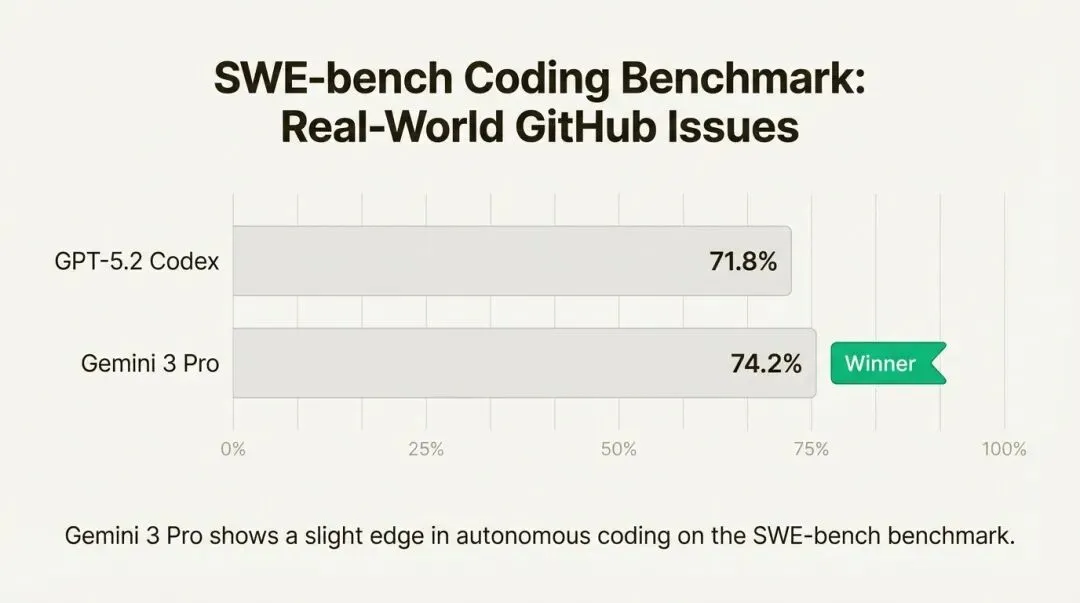

文章引用了 SWE-bench 的公开结果。这里要注意一个细节:对照表里 OpenAI 一侧使用的是最新可比模型 GPT-5.2 high reasoning,不是直接给出 GPT-5.3 Codex 的官方 SWE-bench 分数。

表里的结果是:

|

|

|

|

|

|---|---|---|---|

|

|

|

74.2% |

|

这说明什么?

-

• 如果只看高难软件工程 benchmark,Gemini 3 Pro 目前略占上风。 -

• 但 OpenAI 一侧并没有被甩开,71.8% 依然是很强的工程成绩。 -

• 真正的使用体感未必只由这几个点决定,尤其你如果更在意工具链成熟度、执行稳定性和企业合规,结论就不会只是“谁分数高就选谁”。

所以更靠谱的理解是:Gemini 3 Pro 在公开工程 benchmark 上有优势,但 Codex 仍然处在强可用区间,而且更偏成熟工程交付路线。

长上下文推理:Gemini 3 Pro 的优势非常明确

这部分几乎没什么悬念。Gemini 3 Pro 的 1,048,576 token 上下文窗口,是整篇对比里最醒目的卖点之一。

上下文窗口更大,不只是“能塞更多文本”,而是意味着模型在分析超大规模材料时,少了很多切分、检索、拼接、重复提示的动作。对复杂任务来说,这种差别非常实际:

-

• 少做很多人工分段 -

• 少掉很多上下文丢失 -

• 更容易在全局材料里发现跨文档、跨模块关系

如果你常做大型代码库分析、架构迁移、长文档研判、知识库问答,Gemini 3 Pro 的优势会比单纯看聊天体验更明显。

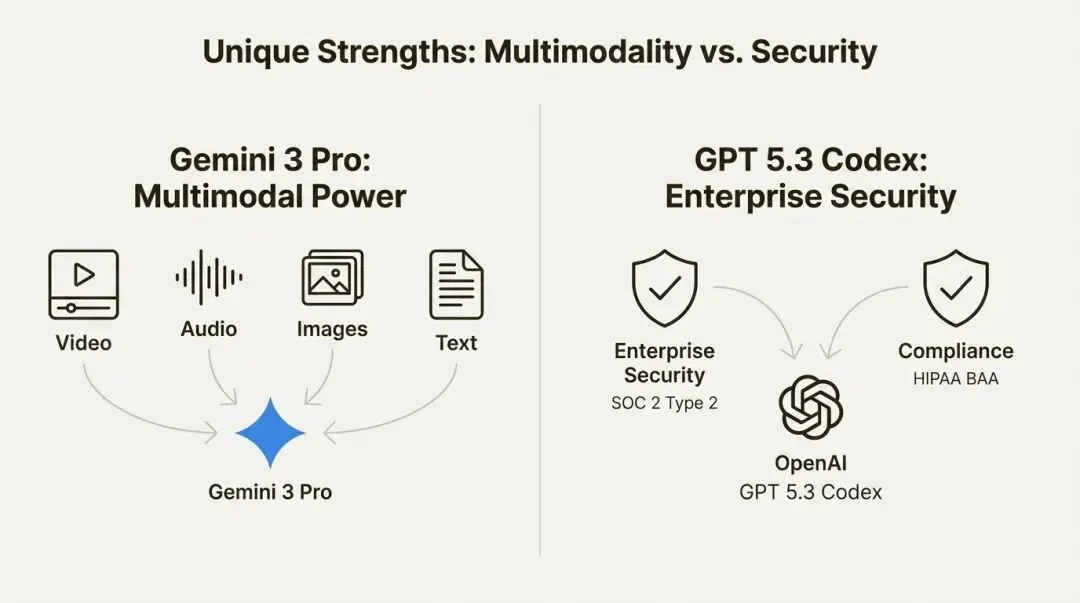

多模态与企业安全:两边强项不同,取舍非常清楚

Gemini 3 Pro 的原生多模态能力,是它和很多编程导向模型拉开差异的关键。它能直接处理视频和音频,这会打开一些以前很麻烦的场景:

-

• 分析用户会话录屏 -

• 会议录音转录与总结 -

• 图文混合材料统一推理 -

• 带附件和截图的问题分析

但企业选型很少只看“功能酷不酷”。OpenAI 这一侧更有吸引力的,是更明确的企业级安全叙事,比如 SOC 2 Type 2,以及对受监管行业更友好的合规能力。

所以这部分没有绝对赢家,只有非常清晰的取舍:

-

• 你需要视频、音频、PDF、截图一起进模型,Gemini 3 Pro 更有优势。 -

• 你更在乎明确的企业安全认证、合规采购和内部治理,Codex 这边更好谈。

体验层的差异,也是在选“工作方式”

Gemini 更像长在 Google 生态里的 AI

如果你的团队已经重度依赖 Google Workspace,那 Gemini 的优势很自然。它不是一个完全独立的新工作台,而是更像嵌进日常办公链路里的 AI 能力:邮件、文档、资料协作,本来就在那套环境里。

这种体验的好处是摩擦小。很多人不是不会用 AI,而是懒得再开一个系统、再学一套流程、再做一轮集成。Gemini 在这件事上,天然吃生态红利。

ChatGPT / Codex 更像专门调用的“专业执行者”

OpenAI 这边的体验则更偏专用工具路线。ChatGPT 是一个更独立、更聚焦的交互环境,而 Codex 代表的是把这种能力进一步往开发者工具里推进。

这类模式通常更适合:

-

• 专门处理复杂推理和工程问题 -

• 把模型接入自己的开发流程或内部工具 -

• 希望围绕 API 自己做更强的定制化

也就是说,Gemini 更像“在你现有环境里无处不在”,Codex 更像“当你需要时叫来的专业选手”。

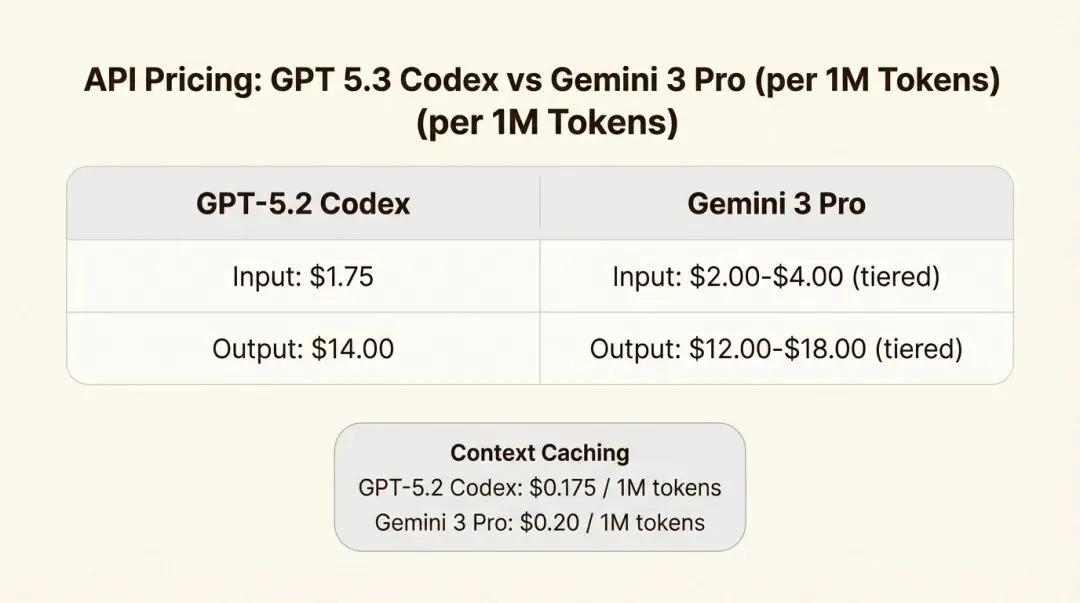

价格怎么对比:Gemini 更看上下文规模,OpenAI 更平直

API 定价差异

文章给出了一张比较实用的 API 对照表:

|

|

|

|

|---|---|---|

|

|

|

1.75 美元 |

|

|

12 美元(≤ 20 万)

|

|

|

|

|

|

这个价格结构很能体现两边思路:

-

• OpenAI 的价格更平,适合预算模型简单、调用模式稳定的场景。 -

• Gemini 3 Pro 在较短上下文时输出更便宜,但一旦 prompt 超过 20 万 token,成本会明显上跳。 -

• Google 的 Context Caching 对重复查询同一大文档会比较有用,适合长文档反复提问的场景。

所以如果你的任务本身就建立在超长上下文之上,Gemini 的价格要结合使用方式一起算,不能只看表面单价。

免费版和订阅路径

原文还提到,两边都提供“先试再深用”的路径:

-

• ChatGPT 免费版通常能接触到基础模型,但高阶模型和更稳定额度需要 business plan 或更高档位。 -

• Gemini 免费版更多是轻量模型体验,想稳定使用 Gemini 3 Pro 的完整能力,通常也要进入付费订阅或 API 路径。

这也意味着,如果团队还在探索期,关键不只是“模型贵不贵”,而是试用门槛、后续接入成本、以及内部推广阻力高不高。

到底怎么选?先看你需要的是“代码执行器”还是“多模态大脑”

如果你的核心目标是:

-

• 更成熟的开发者生态 -

• 偏软件工程和编程执行的稳定体验 -

• 更明确的企业安全与合规能力 -

• 把 AI 接进正式的内部开发流程

那 GPT-5.3 Codex 这一侧更值得重点看。

如果你的核心目标是:

-

• 超大上下文推理 -

• 视频、音频、PDF、图片等多模态材料一起处理 -

• 大型代码库或大型知识库的一次性分析 -

• 更自然地融入 Google Workspace

那 Gemini 3 Pro 会更对路。

一句话总结这组差异,大概可以这么说:

-

• Codex 更像工程执行型选手 -

• Gemini 3 Pro 更像信息处理型选手

GPT-5.3 Codex 到底是什么?普通开发者能拿它做什么?

如果你之前只把 Codex 理解成“OpenAI 的代码模型”,那现在这个理解已经有点窄了。

它更接近一个能承担真实软件工程动作的 Agent:可以围绕编程任务工作,处理跨文件修改、代码重构、调试和构建,并通过 API 接进更完整的工具链。对开发团队来说,这类模型的价值不只是生成代码,而是把一部分工程执行工作外包出去。

更实际的使用场景通常包括:

-

• 按明确需求完成代码实现 -

• 做跨文件修改和重构 -

• 协助调试与问题定位 -

• 把模型接进内部开发工具或工作流

官方使用路径也比较清晰:你可以通过 ChatGPT / OpenAI 的相关产品形态体验,也可以通过 API 接入。上面表格里的 API 定价可以作为公开参考:输入约 1.75 美元 / 百万 token,输出约 14 美元 / 百万 token,并支持 context caching 一类能力。

不过说实话,官方服务对国内用户不算省心——支付、网络环境、账号稳定性都可能是门槛。如果想少折腾一点,也可以看看 Code80,真实订阅帐号转 API,换个 endpoint 就能直接用,体验跟官方一样。详情可以到官网了解:code.ai80.vip

常见问题

Q1:GPT-5.3 Codex 和 Gemini 3 Pro,最大的区别到底是什么?

A:核心差别不是“谁更聪明”,而是擅长的工作流不同。Codex 更偏软件工程执行,Gemini 3 Pro 更偏超长上下文和多模态信息处理。

Q2:单看代码 benchmark,谁更强?

A:这篇来源文章引用的公开表格里,Gemini 3 Pro Preview 在 SWE-bench Verified 上是 74.2%,略高于 OpenAI 可比模型 GPT-5.2 的 71.8%。但这不等于所有真实开发任务都一定由 Gemini 胜出。

Q3:为什么很多人会被 Gemini 的 100 多万 token 上下文吸引?

A:因为它解决的不是“小聊天更长”,而是大型代码库、长文档、多来源材料能不能一次性放进同一个推理过程里处理。这对复杂分析任务很重要。

Q4:企业选型时,安全和合规该怎么看?

A:如果你所在行业对合规要求高,OpenAI 这侧更明确地强调了 SOC 2 Type 2、API 数据不训练,以及特定行业协议支持。Gemini 也强调数据隐私,但侧重点更偏能力和生态。

Q5:如果团队已经深度使用 Google Workspace,是不是更适合 Gemini?

A:通常会更顺。因为 Gemini 的优势之一就是和 Gmail、Docs、Workspace 的结合更自然,部署和推广阻力可能更小。

Q6:国内用户如果想更省事地用上这些模型,有什么办法?

A:如果不想折腾支付和网络,国内用户可以通过 Code80 更方便地使用。

大家好,我是易安,AI超级个体,大厂程序员二孩奶爸。

关于 code80

写这篇文章的时候想到一个问题——上面这些自定义指令、工作流配置、部署脚本,对我来说是近一年迭代的结果,但对刚接触 AI 编程的人来说门槛不低。

这也是我做 code80AI编程巴士 的原因之一。code80 上会逐步整理这些工具和工作流的教程,包括可以直接复制使用的指令模板。如果你对 Claude Code 的自定义指令感兴趣,可以关注一下。

写在最后

Vibe Coding 不是拍脑袋写 prompt,而是用工程化的思维管理 AI 编程的流程。自定义指令是这个流程的骨架:

-

• /commit标准化了提交流程 -

• /upstream让分支同步和冲突处理变成了两分钟的事 -

• /progress-save+/progress-load解决了上下文断裂的问题 -

• /deploy把手动部署变成了一键操作 -

• /gitsync让多项目之间的代码同步不再遗漏 -

• /review和/bug-add保证了质量和经验积累 -

• /parallel-epic实现了多 Agent 并行开发

这些指令本身都是 markdown 文件,语法简单,十分钟就能写一个。但组合起来的效果是,你可以把精力集中在”要做什么”上,”怎么做”交给 Claude。

如果你也在用 AI 编程,欢迎交流,微信:20133213可以找到我。

易安致力于为高T提供稳定可靠的纯血Claude,GPT,Gemini 模型服务,节省你们的时间,无需魔法极速访问,而且是纯血帐号,无逆向,无倍率,性价比拉满。

夜雨聆风

夜雨聆风