做 RAG,为什么 PDF 解析不能只停留在“提取文本”?

关于LangChat Pro

LangChat Pro 是基于Java生态构建的企业级AIGC应用开发平台商业版,为企业提供完整的AI大模型集成解决方案。基于Spring Boot 3和Vue 3构建,支持快速构建智能知识库、多模态AI应用和智能工作流,助力企业实现AI驱动的数字化转型。

产品官网: http://langchat.cn/

开源版地址: https://github.com/tycoding/langchat (基础功能体验)

商业版咨询: 添加微信 LangchainChat (备注:公司名称 + [具体咨询内容])

做 RAG,为什么 PDF 解析不能只停留在“提取文本”?

很多团队在做知识库、企业问答、文档助手时,第一步都会遇到 PDF。

看起来,PDF 只是一个“文件格式”问题,似乎把文字抽出来、切成 chunk、做 embedding 就结束了。但真正落地后,问题往往马上出现:

-

双栏论文顺序错乱,前后句拼不起来 -

标题、正文、页眉页脚混在一起 -

列表结构被打散,语义边界丢失 -

表格被压平成一串字符,核心信息无法检索 -

图片、说明、公式完全脱节

这也是为什么,PDF 在 RAG 场景里一直是“看起来容易,实际上最容易翻车”的文档类型。

如果只是把 PDF 当成纯文本来源,最后做出来的知识库,通常检索效果、答案引用、来源定位都会明显打折。

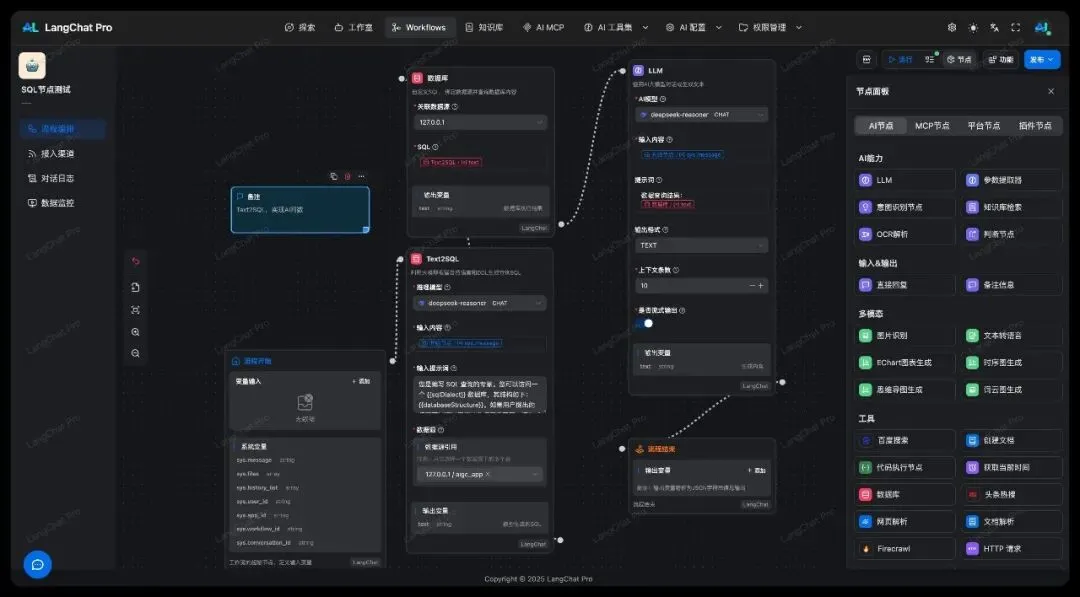

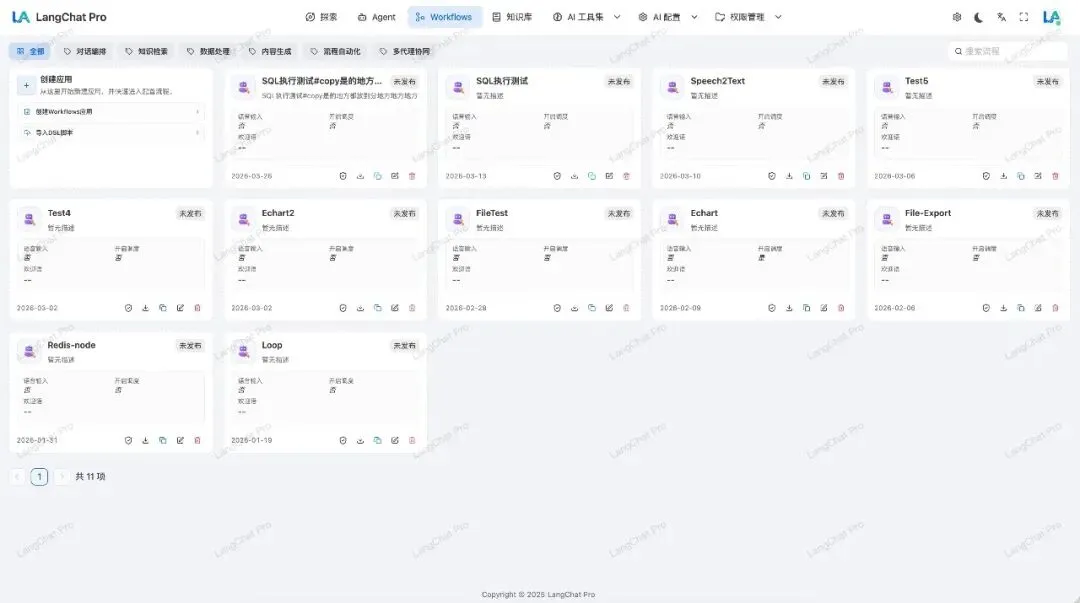

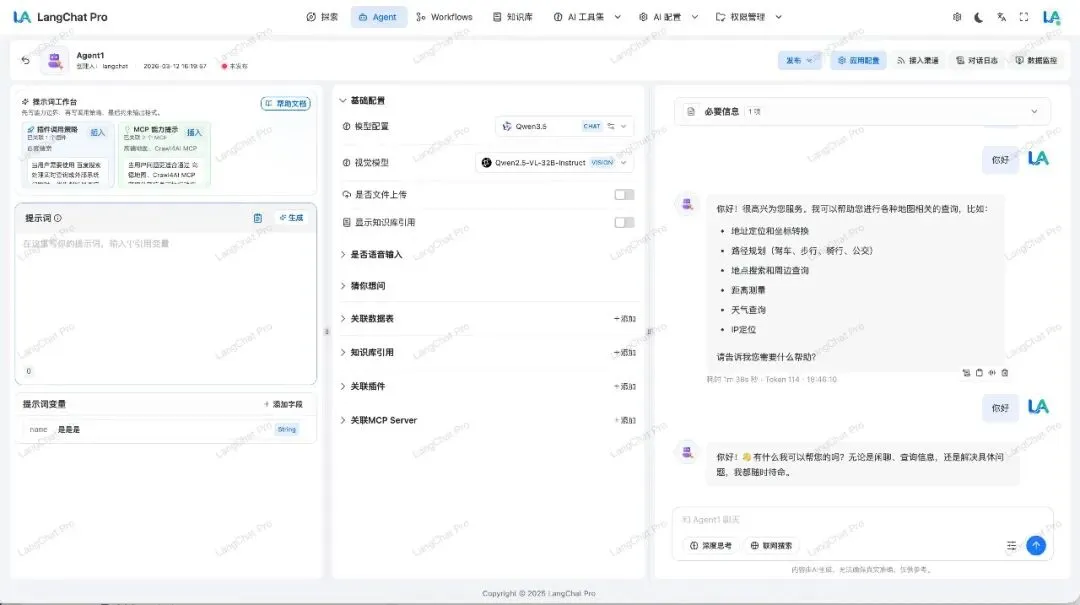

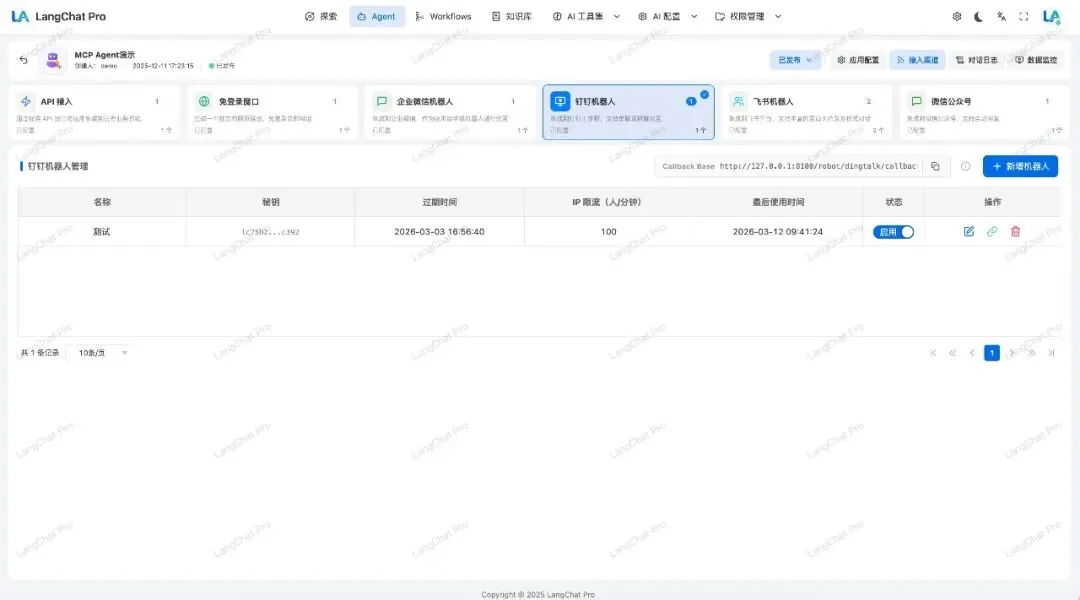

LangChat 快速预览

PDF 增强,真正要解决的不是“能不能读”,而是“能不能读对”

在 Java 技术栈里,很多人对 PDF 的第一反应是 PDFBox。它当然是一个成熟、可靠的底层能力库,但如果目标是做 RAG,仅仅完成“文本提取”还远远不够。

RAG 真正需要的是:

-

正确的阅读顺序 -

稳定的段落边界 -

可识别的标题层级 -

不被破坏的表格结构 -

可回溯的页码与定位信息 -

适合后续切块的语义块输出

换句话说,RAG 关心的不是 PDF -> text,而是:

PDF -> semantic blocks -> retrieval-ready chunks

这中间最核心的一层,就是 PDF 增强解析。

一种更适合 Java RAG 的 PDF 增强思路

基于对 OpenDataLoader PDF Core 1.11.0 的分析,可以把这类方案理解为:

它不是一个普通的 PDF 读取工具,而是一个“文档结构恢复器”。

它做的事情,远不只是把字符抠出来,而是尝试把一份 PDF 重新理解成有结构的文档:

-

恢复阅读顺序 -

识别段落 -

识别标题和层级 -

识别列表 -

识别表格 -

关联图片与 caption -

提取公式 -

清洗噪声内容 -

输出 Markdown、HTML、JSON 等结构化结果

如果从 RAG 视角看,这类能力的价值非常直接。

如果你想快速上手,基础代码可以怎么写

对于 Java 项目来说,第一步不是急着写复杂逻辑,而是先把 PDF 解析结果稳定跑出来。

1. 先引入依赖

<dependency><groupId>org.opendataloader</groupId><artifactId>opendataloader-pdf-core</artifactId><version>1.11.0</version></dependency>

2. 最小调用方式

从公开入口看,最核心的调用非常直接:

import org.opendataloader.pdf.OpenDataLoaderPDF;import java.io.File;public class PdfDemo {public static void main(String[] args) {File pdf = new File("/data/demo/企业知识库样例.pdf");// config 为解析配置对象,按你的输出格式和处理策略进行设置Object config = buildConfig();try {OpenDataLoaderPDF.processFile(pdf, config);} finally {OpenDataLoaderPDF.shutdown();}}private static Object buildConfig() {// 这里只做示意,真实项目中可配置输出目录、输出格式、图片策略等return new Object();}}

这段代码本身并不复杂,但它背后的意义不是“把 PDF 跑一遍”,而是把 PDF 交给一个结构化解析器,而不是普通文本提取器。

3. 更推荐的接入方式:优先拿结构化结果

如果目标是做 RAG,通常更建议优先输出 JSON 或 Markdown,而不是直接拿一整段纯文本。

原因很简单:

-

JSON 更适合作为中间结构 -

Markdown 更适合做人工排查和调试 -

纯文本最方便,但最容易丢结构

一个更符合知识库场景的思路可以写成这样:

File pdf = new File("/data/demo/manual.pdf");// 伪代码:按实际配置对象设置输出策略Config config = new Config();config.setOutputJson(true);config.setOutputMarkdown(true);config.setOutputDir("/data/output/pdf-parse");OpenDataLoaderPDF.processFile(pdf, config);OpenDataLoaderPDF.shutdown();

上面这段属于示意代码,重点不是配置项名字本身,而是接入思路:

-

先把 PDF 转成结构化产物 -

再基于结构化产物做 chunk -

最后再进入 embedding 和检索链路

这比 PDF -> 全文字符串 -> 固定长度切块 更适合知识库。

为什么这套方案更适合知识库场景

1. 先恢复结构,再切块

很多知识库效果不稳定,不是模型不行,而是 chunk 在进入向量库之前就已经“语义受损”。

比如:

-

原本属于同一节的内容被切散 -

表格标题和表格内容被拆开 -

双栏页面被错误串联 -

页眉页脚混入正文,造成 embedding 污染

如果前面先把 PDF 解析成标题、段落、列表、表格等语义块,后续 chunk 就能围绕文档结构来组织,而不是只能按固定字数硬切。

这对召回准确率和答案 grounding 的提升,通常是非常明显的。

2. 表格类知识终于能真正“进库”

业务文档里最关键的信息,经常就在表格中:

-

产品参数表 -

合同清单 -

报价表 -

医疗报告 -

财务报表

传统的纯文本提取,往往会把表格打碎成一串没有结构的字符流。但一旦能恢复行列、单元格、标题、甚至跨页关系,表格就不再是“损坏内容”,而是可以参与检索的知识对象。

对于企业知识库来说,这个差别非常大。

3. 来源引用和页面定位更容易做

高质量的 RAG,不只是“答出来”,还要“说得清从哪来的”。

如果解析阶段就保留页码、结构 ID、边界框等信息,后续做这些能力会顺很多:

-

答案来源引用 -

原文片段展示 -

页面跳转 -

高亮定位

这类能力对于企业级产品尤其重要,因为它直接影响用户是否信任答案。

4. 对复杂版式更友好

现实中的 PDF 不是都长得很规整。

常见复杂场景包括:

-

双栏排版 -

混合图文 -

多级标题 -

列表嵌套 -

图表说明 -

复杂表格

如果底层解析没有“结构理解”能力,后面不管怎么做 chunk、rerank、prompt,都只能在错误输入上补救。

做 RAG 时,基础实现应该长什么样

如果从工程接入角度看,一个比较稳妥的做法通常分三步。

第一步:解析 PDF,拿到结构化结果

ParseResult result = pdfParser.parse(file);这里的 ParseResult 可以理解成:

-

标题块 -

段落块 -

列表块 -

表格块 -

图片说明块 -

页码、结构 ID、定位信息

重点不是类名,而是你不要在这里就把所有内容压扁成一个大字符串。

第二步:基于语义块做 chunk

List<Chunk> chunks = new ArrayList<>();for (SemanticBlock block : result.getBlocks()) {Chunk chunk = new Chunk();chunk.setText(block.getContent());chunk.setPageNumber(block.getPageNumber());chunk.setType(block.getType());chunk.setStructureId(block.getId());chunks.add(chunk);}

这里真正重要的是元数据保留。因为后面你做检索、引用、高亮、回显时,都要靠这些信息回查。

第三步:再进入向量化和知识库索引

for (Chunk chunk : chunks) {embeddingService.embed(chunk.getText(), chunk.getMetadata());vectorStore.add(chunk.getText(), chunk.getMetadata());}

这个顺序不能反。

如果前面 PDF 解析就已经错位,后面的 embedding、召回、rerank 都是在为错误内容“精修”。

这类方案和传统 PDF 解析的差别,到底在哪

可以简单理解为:

-

传统方式更偏“底层文本抽取” -

增强方案更偏“面向知识库的文档理解”

前者解决“把内容拿出来”,后者解决“把内容变成可检索资产”。

这两者并不冲突,但如果目标是做企业知识库、智能问答、RAG Agent,那么后者更接近真实需求。

LangChat 围绕 PDF 增强的方案定位

围绕知识库接入,LangChat 对 PDF 的思路并不是把它当成一个普通上传文件,而是把它看成 RAG 数据治理中的关键入口。

LangChat 这套 PDF 增强方案,重点解决的是三件事:

-

让 PDF 内容进入知识库之前,先完成结构化整理 -

让 chunk 尽量贴近真实语义边界,而不是机械切分 -

让检索结果在回答阶段具备更好的引用与可解释性

也就是说,LangChat 关注的不是“能不能解析 PDF”,而是:

-

PDF 进入知识库后,检索质量是否更高 -

表格、标题、段落是否还能保留业务语义 -

回答时能不能更自然地附带来源信息

这是一个典型的“面向 RAG 结果负责”的思路。

如果用一段非常抽象的伪代码来描述 LangChat 围绕 PDF 的方案链路,大致会是这样:

File pdf = uploadFile;// 第一步:做增强解析StructuredDocument doc = pdfEnhancer.parse(pdf);// 第二步:生成更适合检索的 chunkList<Chunk> chunks = chunkBuilder.fromStructuredDocument(doc);// 第三步:写入知识库索引knowledgeIndexer.index(chunks);

这里有意没有展开内部实现,因为 LangChatPro 是商业产品。但从方案层面看,核心思想是清晰的:

-

不直接拿 PDF 原文硬切 -

先做结构恢复 -

再做知识库索引 -

最后服务于检索与问答

为什么说它适合做 LangChat 的 PDF 增强底座

从方案特征来看,这类增强解析非常适合放在知识库导入链路的前半段,承担“文档理解预处理层”的角色。

它的价值不是替代向量库、重排模型或大模型,而是把最前面的文档输入质量拉起来。

可以把它理解成:

-

上游负责把 PDF 变成结构化内容 -

中游负责做语义切块、索引、向量化 -

下游负责检索、重排、回答、引用展示

这样一来,整个 RAG 链路会更稳,尤其是在处理制度文档、技术手册、产品资料、合同文件、行业报告这类 PDF 为主的数据源时。

关于 LangChatPro:为什么会把这类能力作为御用方向

这里需要说明一点:

LangChatPro 是商业产品,它的核心实现、内部链路与工程细节不适合公开展开。但从产品能力方向看,LangChatPro 会优先采用这类“面向知识库效果”的 PDF 增强思路,而不是停留在传统的纯文本提取。

原因很简单:

-

企业客户真正关心的是知识库效果,不是底层库名字 -

PDF 是企业文档里占比极高的一类数据源 -

一旦 PDF 解析错位,后面所有 RAG 环节都会被放大污染

所以,从产品设计角度,这类 PDF 增强方案更像是 LangChatPro 在知识库场景里的“御用能力方向”:

-

面向企业知识库 -

面向复杂 PDF -

面向结构保留 -

面向检索质量 -

面向引用可信度

它不是为了炫技,而是为了让最终问答结果更稳定。

一个更实际的判断标准

做 PDF 知识库时,可以用一个很简单的标准来判断方案是否靠谱:

不是看“能不能解析出文字”,而是看下面这些问题能不能处理得更好:

-

标题能不能保住 -

表格能不能保住 -

页码能不能保住 -

语义边界能不能保住 -

检索出来的内容像不像原文里真正该被召回的那一段

如果这些问题解决了,RAG 的体验通常就会上一个台阶。

结语

在 Java 生态里,PDF 解析从来不只是一个文件读取问题。对于 RAG 而言,真正有价值的,是把 PDF 从“难处理的输入格式”变成“结构稳定的知识来源”。

这也是 LangChat 围绕 PDF 增强方案想解决的核心问题:

-

不只抽文本 -

更要恢复结构 -

不只为了导入 -

更要为检索和回答负责

如果你的目标只是“读 PDF”,基础方案已经够用。但如果你的目标是“把 PDF 真正用在知识库里”,那 PDF 增强这一步,基本就是绕不过去的基础设施。

关于LangChat Pro

LangChat Pro 是基于Java生态(Spring Boot 3 + Vue 3)构建的企业级AIGC应用开发平台商业版,为企业提供完整的AI大模型集成解决方案。

核心能力:

-

🤖 Agent智能体应用: 快速构建各类AI智能应用 -

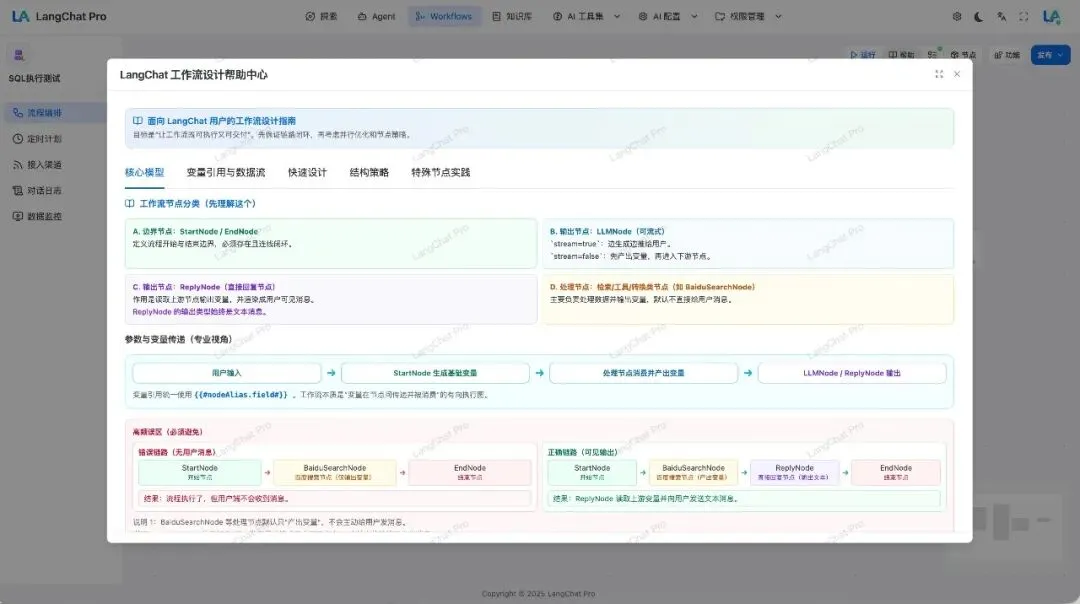

🔄 Workflows工作流引擎: 可视化编排复杂业务流程、Loop 循环节点、子流程、分支节点… -

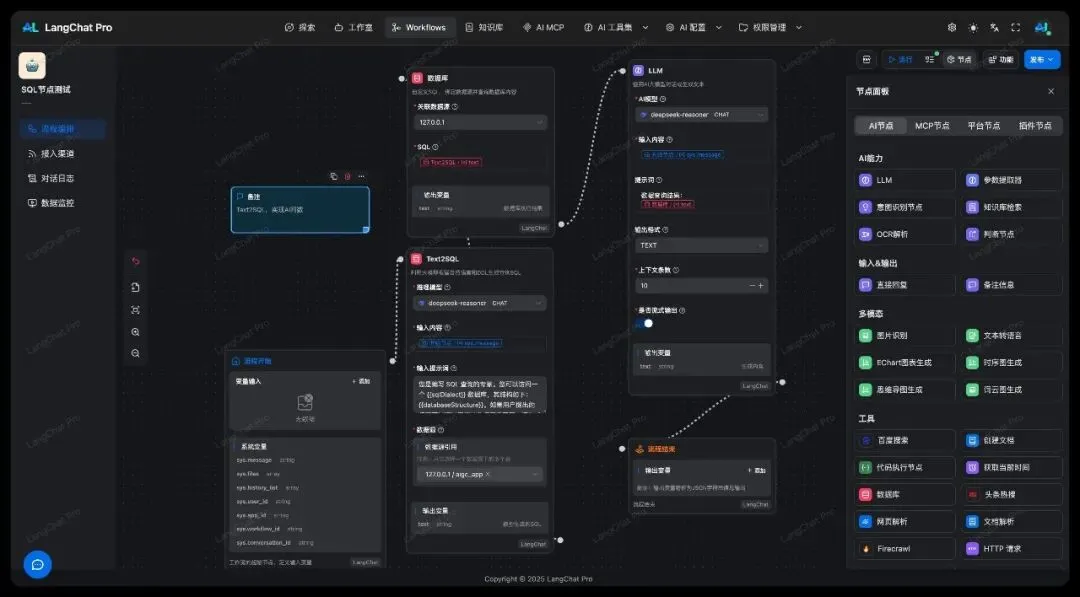

📚 RAG知识库: 基于RAG的企业知识管理、混合检索、人工标注、增强索引 -

🗄️ Text2SQL: 自然语言查询数据库、自定义 SQL -

📊 模型消耗监控: 精细化AI成本管理、可视化面板 -

🎨 多模态AI能力: 文生图、OCR、TTS、ASR… -

🔌 开放集成: MCP服务、Function Call、自定义插件、第三方平台

技术优势:

-

✅ 纯Java技术栈,与企业现有系统无缝集成 -

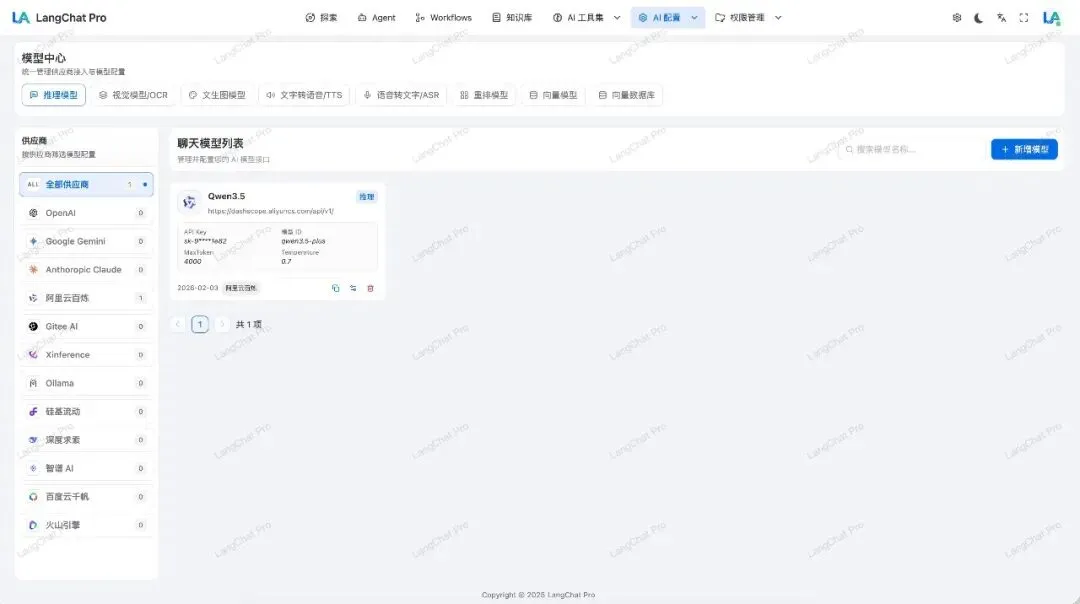

✅ 支持国内外主流大模型接入 -

✅ 企业级权限管理和安全保障 -

✅ 完善的技术支持和服务

联系我们:

📧 产品官网: http://langchat.cn/🔗 开源版地址: https://github.com/tycoding/langchat (基础功能)💬 商业版咨询: 添加微信 LangchainChat (备注:公司名称 + [具体咨询内容])

夜雨聆风

夜雨聆风