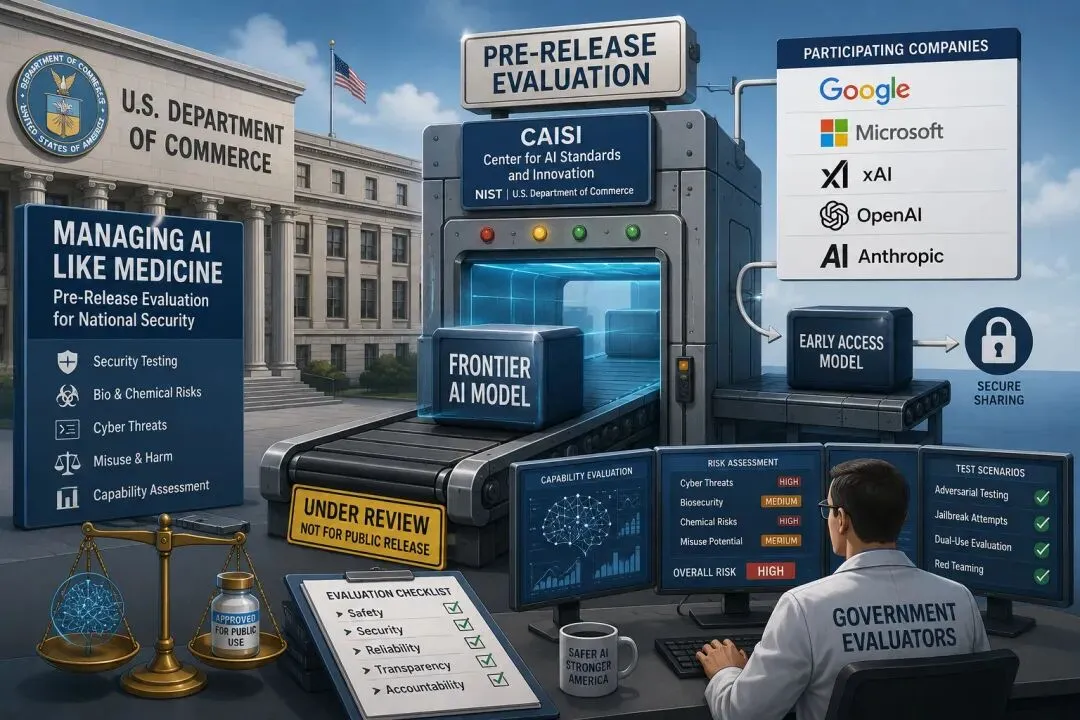

效仿新药审批模式,美国推AI模型"发布前审查"

美国政府正加速建立对 AI 的“发布前监管”框架。

根据路透社、《华盛顿邮报》等报道,Google、Microsoft以及xAI已同意向美国政府提供尚未公开发布的 AI 模型,以便在正式发布前接受国家安全层面的评估,这也标志着全球AI治理体系正在从事后监管,向前置审查转变。

根据相关安排,美国商务部下属机构

Center for AI Standards and Innovation

(CAISI)

将获得这些模型的早期访问权限,在产品推向市场前对其能力边界及潜在风险进行系统性测试。

该机构前身是 2023 年成立的U.S. AI Safety Institute(AI安全研究所),2025 年被重组和更名为现在的 CAISI。

该测试的评估重点,已不再局限于数据隐私或算法偏见,而是扩展至网络攻击能力、生物与化学安全风险,以及大规模信息操控等更具战略意义的领域。

就此,微软发布声明称,公司将与美国政府科研人员合作,以探测未知异常行为的方式对人工智能系统开展测试。

微软表示,双方还将共建通用测试数据集与标准化工作流程,用于自家AI模型的安全检测。

声明同时透露,微软已与英国人工智能安全研究所签署同类合作协议。

值得注意的是,参与评估的模型通常会在部分安全限制被弱化的条件下提交,以便技术人员能够在接近真实威胁环境的情况下识别潜在滥用路径,例如生成恶意代码或辅助复杂攻击链条。

这一测试方法反映出监管思路的变化,即从“验证合规性”转向“压力测试极限风险”。

OpenAI与Anthropic早在此前白宫推动的“自愿AI安全承诺”框架下,已与美国政府建立类似合作机制,其模型也曾被纳入发布前测试与安全评估流程之中。

该机制并非孤立举措,而是美国近年来逐步推进的AI治理路径的一部分。

CAISI通过与头部模型开发者建立常态化协作,已累计完成 40 多项针对前沿模型的评估,其中包括尚未公开发布的系统。

这意味着,“模型发布前测试”正逐步演变为类似医药临床试验或航空适航认证的标准流程。

近几周,包括 Anthropic Mythos在内的多款先进人工智能系统陆续问世,其可大幅赋能黑客攻击的能力,在全球范围内引发热议,也引起美国政府及本土企业的高度关注,迫使监管从被动应对转向主动介入。

值得注意的是,对于前沿 AI 模型可能带来的风险,行业也开始行动了起来。

就在前两天,Anthropic与亚马逊云科技、苹果、博通、思科、CrowdStrike、谷歌、摩根大通、Linux基金会、微软、英伟达和派拓网络等,共同宣布了一项名为“Project Glasswing”的新倡议。

AI挖出27年漏洞后,惶恐的硅谷科技巨头们启动了”玻璃翅”项目

据此,各大科技巨头联合起来,用前沿AI的能力,为全球最关键软件提供防御。

尽管当前仍以自愿合作为主,尚未形成具有强制力的法律框架,但其政策信号意义显著。

有分析认为,这种模式可能成为未来正式立法的过渡形态,即在不直接干预企业发布决策的前提下,构建一套事实上的行业准入标准。

而随着美国在该领域的制度探索不断推进,类似机制亦可能被其他主要经济体借鉴,从而推动全球范围内形成更趋一致的前沿AI监管范式。

夜雨聆风

夜雨聆风