告别命令行!这款开源神器让 AI 助手配置像搭积木一样简单

本文作者 凯哥亡命天涯 是阿里云天池”千模百炼”全球 AI 开发者系列锦标赛——OpenClaw 养虾挑战赛的参赛者。

还在手动编辑 JSON 配置文件?还在命令行里启停服务?这款基于 Tauri 2.0 + React + Rust 打造的跨平台管理工具,让你用图形界面轻松管理 AI 助手——配置 AI 模型、对接消息渠道、监控服务状态,一站式搞定!

一、为什么做这个工具?

如果你正在自建或私部署 AI 助手(比如对接 Telegram Bot、飞书机器人、Discord Bot 等),你大概率遇到过这些痛点:

-

❌ 配置文件散落在各处,改个 API Key 要手动编辑 JSON/YAML -

❌ 服务启停要敲命令行,出了问题翻日志找半天 -

❌ 想换个 AI 模型? 改配置、重启服务、测试连接……一套流程下来效率极低 -

❌ 多个消息渠道的配置格式各不相同,记不住参数名

OpenClaw Manager 就是为了解决这些问题而生的。它提供了一个统一的图形界面,让 AI 助手的配置和管理变得像用普通 App 一样简单。

二、功能概览

📊 实时仪表盘

打开应用就是仪表盘界面,核心信息一目了然:

-

服务状态:运行中 / 已停止,实时刷新 -

进程信息:PID、监听端口(默认 18789)、内存占用 -

快捷操作:一键启动 / 停止 / 重启服务 -

实时日志:内置日志查看器,支持自动滚动刷新,出问题不用再去翻终端

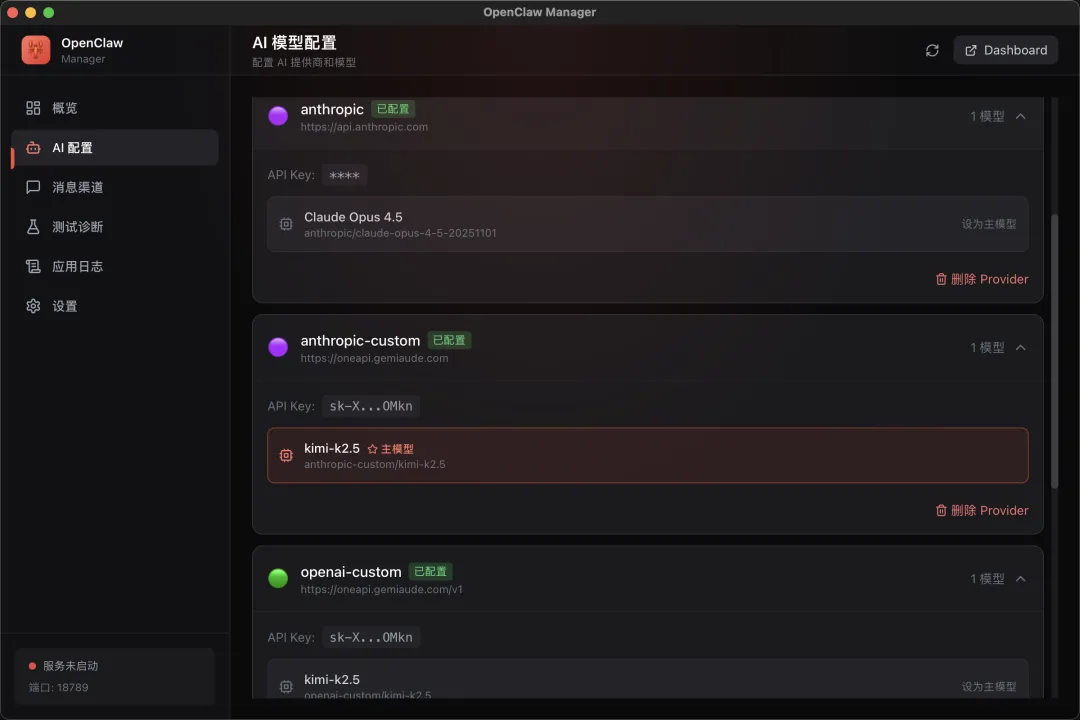

🤖 AI 模型配置

支持 14+ 主流 AI 提供商的图形化配置:

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

亮点功能:

-

✅ 自定义 API 端点——兼容所有 OpenAI 格式的第三方服务(如 one-api、new-api 等中转站) -

✅ 一键设置主模型,多模型快速切换 -

✅ 内置连接测试,配置完成即可验证是否可用 -

✅ API Key 脱敏显示,安全管理密钥

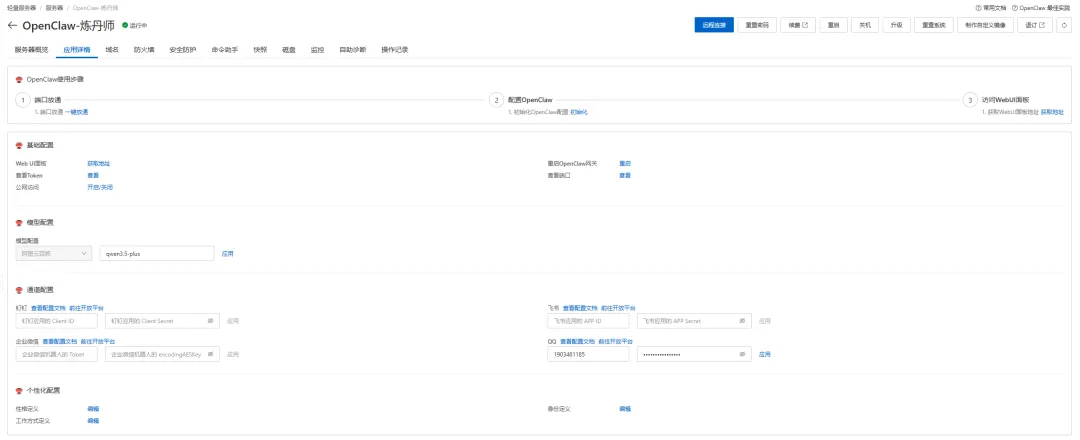

📱 消息渠道配置

连接多种即时通讯平台,打造全渠道智能助手:

-

Telegram — Bot Token、私聊/群组消息策略配置 -

飞书 — App ID / Secret、WebSocket 连接、多部署区域支持 -

Discord — Bot Token 配置 -

更多渠道 — Slack、WhatsApp、iMessage、微信、钉钉

每个渠道都有独立的配置面板,填完参数保存即可,无需手动编辑配置文件。

🧪 测试与诊断

内置一套完整的诊断工具:

-

环境检查:自动检测 Node.js 版本、OpenClaw 安装状态、配置目录 -

AI 连接测试:验证 API Key 是否有效、模型是否可用、响应延迟 -

渠道连通性测试:确认各消息渠道的连接状态

三、技术架构

这是一个典型的 Tauri 2.0 应用,采用前后端分离架构:

┌─────────────────────────────────┐│ React 前端 (UI) ││ React 18 + TypeScript + Vite ││ TailwindCSS + Framer Motion ││ Zustand 状态管理 │├─────────────────────────────────┤│ Tauri 2.0 IPC 桥接 ││ invoke() ←→ #[command] │├─────────────────────────────────┤│ Rust 后端 (Core) ││ 服务管理 │ 配置读写 │ 进程控制 ││ 系统诊断 │ Shell 调用 ││ Tokio 异步运行时 │└─────────────────────────────────┘为什么选择 Tauri 而不是 Electron?

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Tauri 的优势很明显:更小的包体积、更低的内存占用、更强的安全模型。Rust 后端在处理进程管理、文件操作、Shell 调用等系统级任务时性能优异。

前端技术选型

-

React 18 — 成熟稳定,生态丰富 -

TypeScript — 类型安全,重构友好 -

Zustand — 轻量级状态管理,比 Redux 简洁得多(整个 store 不到 100 行) -

TailwindCSS — 原子化 CSS,暗色主题开发效率极高 -

Framer Motion — 页面切换和元素动画,提升交互体验 -

Lucide React — 精美的开源图标库 -

Vite — 毫秒级 HMR,开发体验丝滑

Rust 后端核心模块

src-tauri/src/├── main.rs # 应用入口 + Tauri Builder 配置├── commands/ # Tauri Command(前端可调用的后端函数)│ ├── service.rs # 服务启停、状态查询(端口检测 + 进程管理)│ ├── config.rs # 配置文件读写(JSON 序列化/反序列化)│ ├── process.rs # 进程管理(跨平台 PID 查询、Kill)│ ├── installer.rs # 自动安装/更新 OpenClaw│ └── diagnostics.rs # 系统环境诊断├── models/ # 数据结构定义(Serde 序列化)└── utils/ # 工具函数 ├── platform.rs # 跨平台路径适配 ├── shell.rs # Shell 命令执行封装 └── file.rs # 文件操作几个值得一提的实现细节:

-

服务状态检测:通过检测端口占用(Windows 用 netstat -ano,Unix 用lsof -ti)判断服务是否运行,简单可靠 -

跨平台进程管理:Windows 下使用 CREATE_NO_WINDOW标志启动子进程,避免弹出黑色控制台窗口 -

Release 构建优化:开启了 LTO、单 codegen-unit、strip symbols,最大程度压缩二进制体积

构建产物

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

四、项目结构

openclaw-manager/├── src/ # React 前端│ ├── App.tsx # 根组件 + 路由 + 全局状态│ ├── components/│ │ ├── Layout/ # 侧边栏 + 顶栏布局│ │ ├── Dashboard/ # 仪表盘(状态卡片 + 快捷操作 + 系统信息)│ │ ├── AIConfig/ # AI 提供商配置(增删改 + 测试)│ │ ├── Channels/ # 消息渠道配置│ │ ├── Service/ # 服务管理│ │ ├── Testing/ # 测试诊断│ │ ├── Logs/ # 日志查看器│ │ └── Settings/ # 全局设置│ ├── hooks/ # 自定义 Hooks│ ├── lib/ # 工具库(日志、Tauri 桥接)│ ├── stores/ # Zustand 状态管理│ └── styles/ # 全局样式│├── src-tauri/ # Rust 后端│ ├── src/│ │ ├── main.rs│ │ ├── commands/ # IPC 命令│ │ ├── models/ # 数据模型│ │ └── utils/ # 工具函数│ ├── Cargo.toml│ └── tauri.conf.json # Tauri 配置│├── package.json├── vite.config.ts└── tailwind.config.js五、快速上手

环境要求

-

Node.js >= 18.0 -

Rust >= 1.70 -

pnpm 或 npm

运行开发版

git clone https://github.com/miku8miku/openclaw-manager.gitcd openclaw-managernpm installnpm run tauri:dev # 启动开发模式(前端热重载 + Rust 自动编译)构建发布版

npm run tauri:build# 产物在 src-tauri/target/release/bundle/ 下⚠️ macOS 用户注意

如果遇到”已损坏,无法打开”的提示,这是 macOS Gatekeeper 的安全机制导致的(未签名应用)。执行以下命令即可:

xattr -cr /Applications/OpenClaw\ Manager.app六、设计理念

-

🎨 暗色主题优先:毛玻璃效果 + 渐变色彩,护眼且现代 -

✨ 动画反馈:页面切换、按钮交互均有流畅动画,提升操作手感 -

📖 零学习成本:所有配置项都有清晰的标签和说明,不看文档也能上手 -

🔒 安全第一:API Key 脱敏显示、Tauri 白名单权限控制、Rust 内存安全

七、后续计划

-

🔮 多实例管理:同时管理多个 OpenClaw 服务实例 -

💾 配置导入/导出:一键备份和迁移配置 -

🔌 插件系统:支持自定义扩展 -

🌍 国际化:多语言支持

💡 使用建议

-

首次使用:先运行环境诊断,确保 Node.js 和 Rust 版本符合要求 -

配置 AI 模型:建议先配置一个常用模型(如 DeepSeek 或通义千问),测试连接成功后再添加其他 -

消息渠道:根据实际需求选择渠道,Telegram 和飞书配置相对简单,适合新手 -

定期备份:配置文件建议定期导出备份,避免意外丢失

🔗 参考资料

-

原文地址:【凯哥亡命天涯】openclaw-manager 小白用来管理 openclaw 的 AI 和消息渠道配置管理面板 https://tianchi.aliyun.com/forum/post/1001386 -

作者主页:凯哥亡命天涯 – 天池 https://tianchi.aliyun.com/home/science/scienceDetail?userId=1095280245306 -

关联比赛:”千模百炼”全球 AI 开发者系列锦标赛:OpenClaw 养虾挑战赛 https://tianchi.aliyun.com/competition/entrance/532462/introduction -

GitHub 仓库:https://github.com/miku8miku/openclaw-manager

本文整理自天池技术圈用户分享,版权归原作者所有。

关注公众号,获取更多 AI 实战技巧!

夜雨聆风

夜雨聆风