当一切皆可伪造:AI时代,我们还能相信什么?

你接过一个视频电话。屏幕那头是你多年的老同学,面容、声音、甚至说话时微微皱眉的习惯,都和你记忆中的一模一样。他说有个急事需要借钱周转,语气焦急,眼神恳切,你正要答应。

等等。这是真的吗?

这不是假设。2024年,香港一家跨国公司发生了一起涉案金额达2亿港币的诈骗案。犯罪分子利用AI深度伪造(Deepfake)技术,合成了公司CFO的形象,在视频会议中向员工下达转账指令。没有人怀疑,因为那张脸、那个声音,“一看就是他”。

这才是问题真正可怕的地方:我们曾经用来判断真假的最可靠工具——亲眼所见、亲耳所闻,正在被AI系统性地瓦解。

看见,不再等于相信

Deepfake这个词出现才几年,但它进化的速度已经超出了大多数人的想象。

最初,它只是娱乐版的花边——把明星的脸换到电影片段里,搞笑但粗糙,漏洞百出。现在呢?一段几秒钟的音频样本,就能复刻一个人的声音,语调、停顿、口头禅,一应俱全。一张静态照片加上几分钟的视频素材,就能生成一段以假乱真的动态影像。

消费级的AI换脸工具,几百块就能买到,操作界面”傻瓜化”,不需要任何技术背景。制造一条以假乱真的虚假视频,成本已经从专业人员几天的工作量,降到了几分钟。

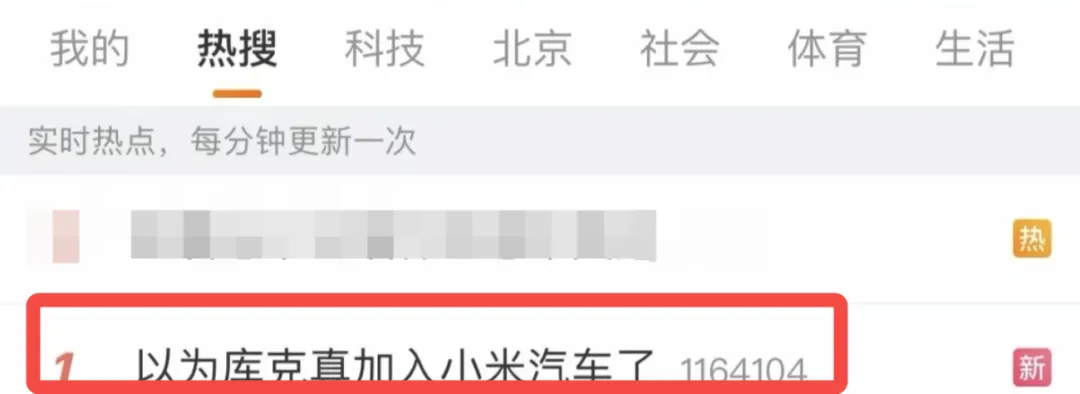

一张GPT-image-2生成的假图,一度冲上了微博热搜第一。

这不是技术问题,这是信任问题。

算法正在替你决定,你该相信什么

如果说Deepfake是直接摧毁”看见”的信任,那么算法推荐就是在更深一层动摇”判断”的信任。

你打开任何一个内容平台,系统都会给你推荐它认为你会喜欢的内容。它越来越懂你——知道你关心什么议题,倾向什么立场,对什么话题有强烈的情绪反应。它甚至能在你开口之前,就把你想看的东西推到你面前。

这叫”信息茧房”。

信息茧房里没有谎言,但有比谎言更隐蔽的东西——它只让你看见世界的一个角落,然后把那个角落放大成全部。你以为自己的观点来自独立思考,其实可能只是算法在反复强化你已经相信的东西。

更吊诡的是,生活在茧房里的人,往往感觉不到茧房的存在。他们真诚地相信,自己看到的就是真实的全部。

Facebook前工程师Frances Haugen曾披露:平台算法倾向于推送让人愤怒和焦虑的内容——不是因为愤怒的内容是真实的,而是因为愤怒的内容更容易留住用户。算法不在乎真假,只在乎参与度。

那个”真人”,去哪了?

再来看看日常。你打过客服电话吗?

现在的很多客服,第一句话是:”您好,我是智能客服,很高兴为您服务。“你描述问题,它礼貌地回应;你追问细节,它精准地答非所问;你要求转人工,它告诉你”当前排队人数较多,请稍等”——然后你等了二十分钟,终于等到一个真人,对方却已经失去了处理复杂问题的权限。

问题不在于AI客服本身。问题在于,当真人被系统性地移除,我们失去的不只是”解决问题的效率”,更是一种根本的信任感,是那种”我在和一个真正在意我的人对话”的信任。

信任的锚点,正在松动

Deepfake让我们不再相信”看见”;算法推荐让我们不再相信”判断”;AI客服让我们不再相信”被重视”。三个维度同时在松动一个东西——我们对这个世界的基本信任。

而更深的危机在于,这种松动是系统性的,不是偶发的。整个技术逻辑在朝这个方向演进:降低成本、提高效率、优化体验——但信任,不在优化的目标函数里。

于是我们看到了一种集体性的焦虑:人们开始怀疑一切。信任的崩塌是缓慢的,但一旦开始,就很难停下来。

重建:不是回到过去,是找到新的锚点

第一,锚定”不可伪造的东西”。

真实的互动。那些需要时间积累的东西——你和一个人长期相处形成的默契,你对一个人行为模式的了解,你在真实关系中积累的判断力。把时间投资在那些需要真实在场的关系上。这听起来很老派,但可能恰恰是抵抗虚假的最好方式。

第二,重建”主动信任”,而不是被动接受。

主动信任的意思是:在相信之前,先问一句”我凭什么相信”。看一条新闻,想想消息源;遇到一个观点,想想立场和利益;收到一条求助,想想对方的行为逻辑是否一致。

这种审慎不是冷漠,而是一种对自己判断力的尊重。AI可以制造假象,目前还不会主动伪造一整套逻辑自洽的背景。

第三,守住判断力——这是最后的防线。

AI在进化,伪造技术在进化,但人的判断力也应该进化。判断力是需要训练的。它来自大量接触真实信息、独立思考、与人面对面交流的过程中。算法越想替你做判断,你自己越需要亲自去做这件事。

信任从来没有容易过。

农业时代,我们信任宗族和土地;工业时代,我们信任机构和规则;互联网时代,我们信任平台和算法。

AI时代不同的地方在于:这一次的威胁直接指向了人类最基本的认知工具。

但正因如此,重建才更有必要。

面对一个越来越难以辨别真假的世界,我们能做的,不是等别人给我们一个确定的答案,而是自己成为那个能够做出判断的人。

这不是逃避,这是我们手里,为数不多的、真正属于自己的东西。

夜雨聆风

夜雨聆风