别急着卸载 OpenClaw——这套组合拳,让它真正帮你干活

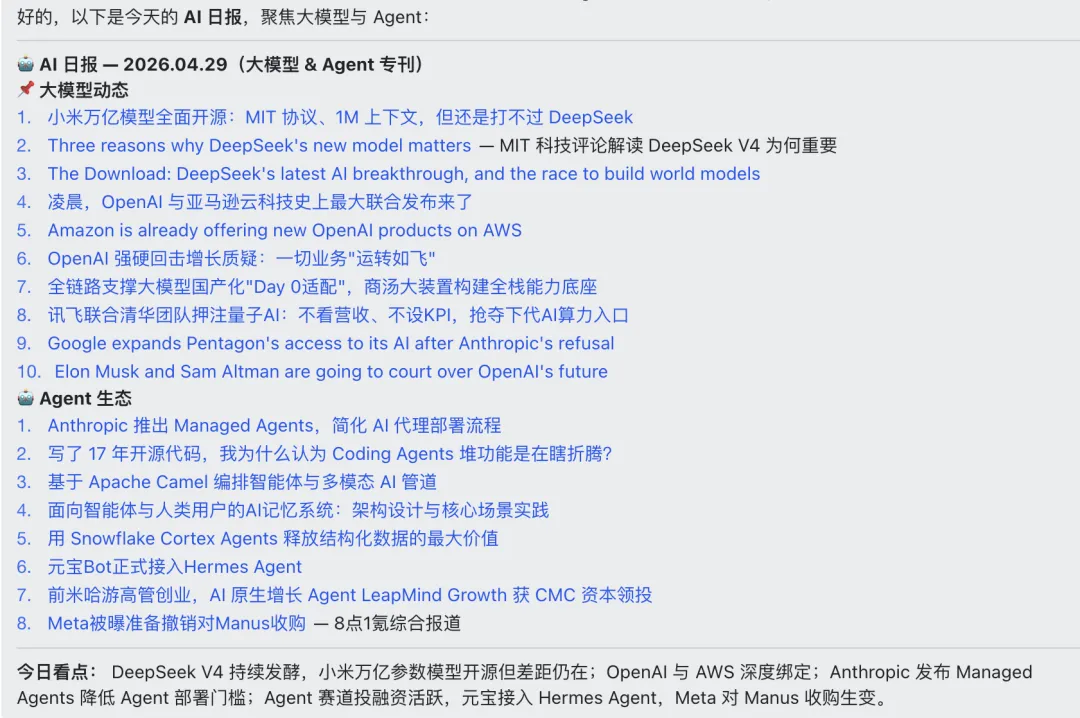

最近AI圈最火的事情是什么?DeepSeek V4

仿佛一夜之间,大家的注意力又从Agent回到基础模型,其实在这背后是Token的消耗。

你换个角度看就会发现,所谓的「Token革命」,本质上是大家被Token账单逼急了。

最先被压垮的是谁?是Agent。说一个事实:OpenClaw 确实在退潮。

今年1月它还是GitHub上增长最快的开源项目,25万star,人人都在聊。

现在最常见的吐槽变成了:装了,玩了两天,然后呢?

这个”然后呢”才是真问题。大多数人把OpenClaw当成一个更酷的ChatGPT来用——打开,聊两句,关掉。这样用,它确实没什么存在的必要。

这里我说两个我在深度用了OpenClaw、Claude code、Hermes等各种Agent之后的两个暴论:

Claude code是当下最优雅的Agent框架,不接受反驳,非常适合干活;相比之下,OpenClaw有点像AI时代的Linux,它的潜力在于具有非常大的想象力,如果你愿意花时间调教,它几乎可以在当下AI生态里帮你完成任何事。

在OpenClaw退潮之下,我身边还是有一大批人不仅没卸载,反而越用越深。区别在哪?

不是在”用OpenClaw”,而是把它当中枢,串起了一整套自动化工作流。

OpenClaw单独用是玩具。但当你把它和本地模型、自动化技能包、消息平台、记忆系统组合在一起,它就变成了一个24小时待命的数字员工——能帮你盯热点、做运营、出初稿,而且越用越聪明。

先来给大家看看我的工作流

每天早上,我的飞书都会自动收到一份「今天写什么」的选题简报。

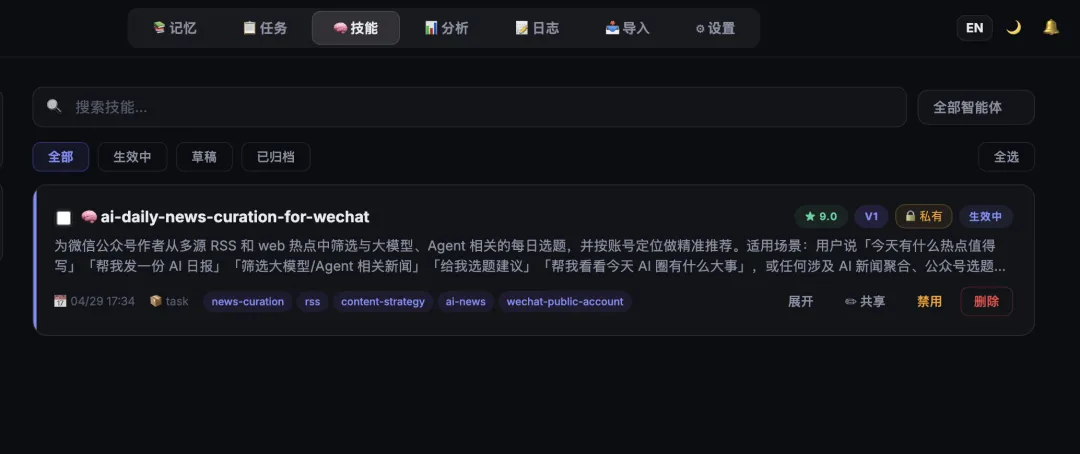

我的实现过程是这样的:OpenClaw + ClawHub上的news-daily技能 + MemOS。一个记得你写过什么、知道你擅长什么的选题助手。

安装就一行命令:

clawhub install news-daily

配一个飞书的webhook地址,搞定。30秒。

第一天的体验是这样的。每天早上8点,你的飞书群收到一份分类简报,AI行业的技术、行业事件10条热点,标题可点击跳转原文。

还行。但这不就是个高级RSS阅读器吗?

别急。用了一周之后,画风变了。

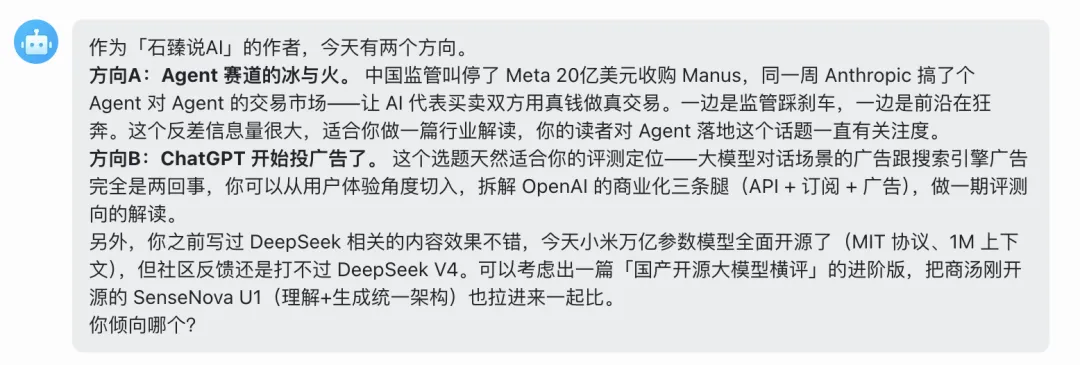

你问,今天有什么值得写的?

可以看到,对选题进行了分析、要点标记打分,所有的消息,一目了然。这些就是我安装了MemOS之后和它长期聊天结果。目前,我可以用日报、选题等不同的关键词让它给出不同的结果。

并且,它还会对选题进一步进行分析。

你感觉到区别了吗。它不只是推热点,它在结合你的历史内容、账号定位、过往数据表现来给你做推荐。大家可能感受不深,在我最初使用news-daily还没有MemOS的时候,它给出来的选题非常杂乱,很多都不符合我的需求,随着和我聊天的深入,我觉得它是真的在“越来越懂我”。

说真的,选题这事儿,最累的不是找信息,是判断。判断这条热点跟我有没有关系,判断我写这个角度有没有人看过了,判断这个方向值不值得投入三个小时。

这些判断需要上下文。而上下文,恰恰是原生OpenClaw最先丢掉的东西。

这就是我今天要跟大家介绍的一个openclaw记忆插件——MemOS。

MemOS,把「大脑皮层」塞进OpenClaw

AI记忆这块的项目我没少折腾,mem0、supermemory、memU都试过一圈。但MemOS是少数让我愿意一直留着的那个,原因主要三个。

第一,它的本质在本地部署一套非常轻量的向量库,你和 AI 的所有对话都会存进去。从此以后 AI 再也不会忘记你说过的话。

跟本地方案完全不是一个路子。向量化、检索、记忆管理这些最吃资源的活,它全丢到云端去了。本地不用下GGUF,不用常驻重型进程烤风扇,就一个Plugin,几行配置,装完就能跑。

第二,MemOS有个激活记忆机制。它不是把所有历史对话一股脑灌给模型,而是通过向量化、语义分割、记忆管理等方式对记忆进行预处理。当你工作的时候,只找跟你当前问题最相关的记忆,精准注入,其他的一概不管。

记忆不是越多越好,而是越准越好。

第三,它开始「认识你」了。用一段时间你会发现,Agent不是变聪明了,是开始记事了。你的偏好、项目背景、之前做过的决策,它都接得住,不像以前每开一个新会话都像失忆,得从头交代一遍。

官方在PrefEval-10上的数据,MemOS比OpenAI Memory高43.70%。

10分钟极简安装MemOS

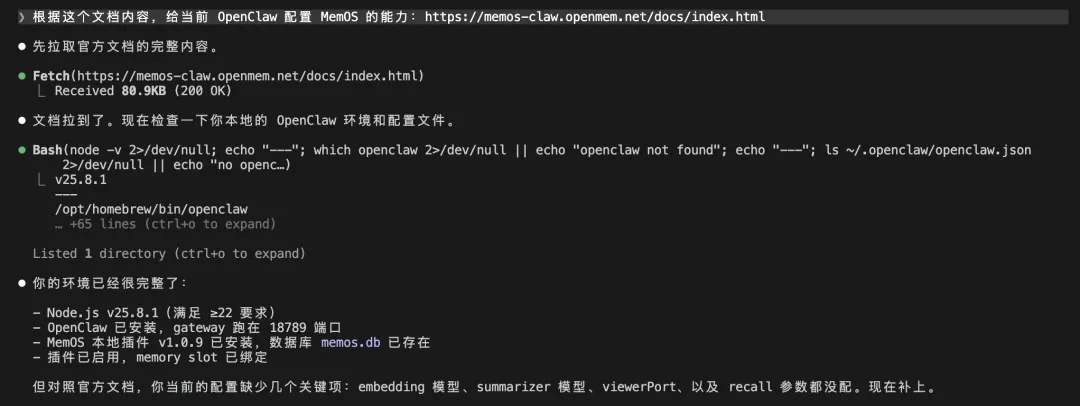

讲到这里,可能有朋友想试一下了。装MemOS非常简单,这里必须要跟大家说一个AI时代生存小技巧。

——当你遇到自己解决不了的问题或者配置不好的开发环境,最好的办法就是用一个AI调试另一个AI

我这里用的是Claude code来安装,大家用别的也可以。直接参考这个提示词即可:

设置过程很简单,官方演示视频里就三步:

根据这个文档内容,给当前 OpenClaw 配置 MemOS 的能力:<https://memos-claw.openmem.net/docs/index>

可以看到它帮我找出了问题,并且接手了我干了一半的工作

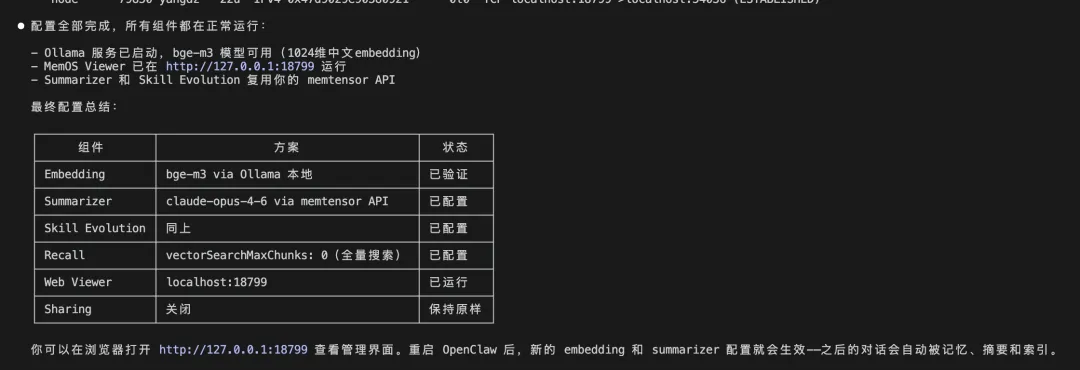

很快,它搞定了一切。全程我没怎么动,就看着它跑了十分钟

配置完成后,浏览器直接访问:http://127.0.0.1:18799

在主面板可以看到你之前的记忆、任务、日志,它还能自动分析之前的对话,形成技能

可以看到我的对话有1600+条,这些记忆,可以直接一键同步到 MemOS 里。

然后MemOS就可以发挥作用了

这个技能就是我给了一个初版news-daily skill,然后多轮对话之后的结果,并且随着对话的加深,它是跟着你的工作“进化”的

你只管跟龙虾正常对话、正常完成任务。

MemOS 会在背后默默把你的经验沉淀成技能。

而且如果后来你找到了更好的方法,它还会自动升级已有的技能。版本号递增,新经验合并进去。

你的龙虾,是真的在越用越聪明。

OpenClaw为什么会变吞金兽

到这里必须讲一个对普通用户最痛的点——烧Token。

花100-200块买一个coding plan,一周多就烧完,这肯定不是我们想要的。

傅盛之前在节目里做过测算,要让AI真正变成生产力,一个人一天花在买Token上的钱大概是10美金。这还是他压低预算之后的数。

10美金一天,普通用户哪付得起。

一句话总结,在大模型这件事上,Context即成本。

原生OpenClaw默认把所有对话全塞进上下文。你聊得越久,每次新对话拖着的历史就越多,Token消耗指数级增长。更糟的是,噪点一多,模型注意力分散,开始出现幻觉。

烧钱、错乱、出幻觉。

这才是大多数人卸载OpenClaw的真实原因。

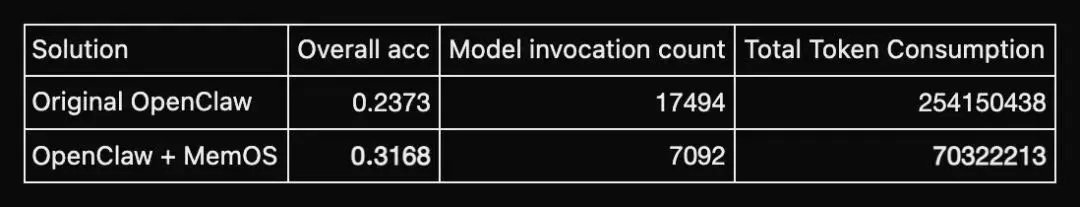

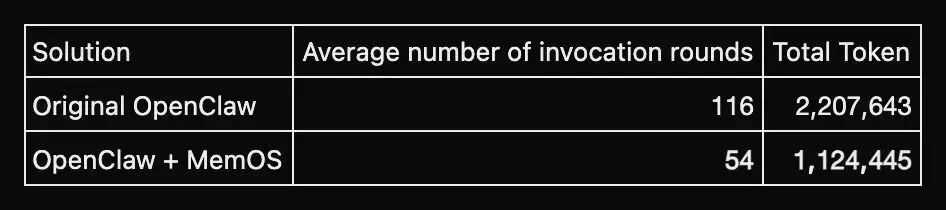

MemOS官方做了一个完整的对比测试:

几个关键数据:

-

Token 消耗下降 72%——同样的任务,花的钱直接打了三折 -

模型调用频率下降 59.5%——龙虾不用反复试错、反复确认了,一次就能找到对的记忆 -

记忆准确率从 23.73% 提升到 31.68%——找到的记忆更准了,回答质量自然更高

OpenClaw退潮了吗?

前两天我刷到一条推。一个海外开发者晒账单,他用OpenClaw跑Claude Opus写一个Python脚本,单次会话烧掉47美元Token。配图是他对着账单一脸懵。评论区第一条高赞回复就一句话,「我也卸了」。

这种吞金速度,别说跑应用了,多聊几句都心疼。

但有意思的来了。

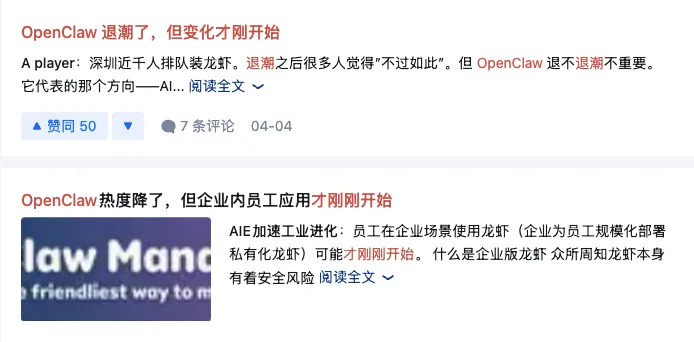

这两天有一篇文章,标题让我停下来想了很久,「龙虾没有凉,它只是变成了大气压」。知乎上一个2万赞的答主跟着写,「OpenClaw退潮了,但变化才刚开始」。

我也有同样的感觉,未来的工作流一定是多步骤的、在Agent里面的。OpenClaw的退潮恰恰是删选出来一群真正在用Agent的人。

因为你的工作不是只发发邮件、生成个word文档这么简单,OpenClaw的意义其实有点像当年的Linux。它给你一个开放的框架,至于在上面能做出什么,看你愿意花多少时间研究,看你想让这只龙虾介入工作的深度。Linux刚出来那会儿,会用它的人也只是少数程序员。

门槛会随着时间往下沉。但先用起来的,永远是那批愿意翻文档、愿意调配置、愿意把工具串成系统的人。

顺便说两点我自己的行业观察。

一是Token涨价是一个阶段性问题,它的单价一定会越来越便宜。因为算力在涨、模型数量在涨,价格不可能不降。

二是个人用户对于Token的付费意愿和总投入会增加。因为算力消耗在增加,并且能干活。以前用AI就是开个对话框聊几句,现在是接Agent、跑工作流,一周左右一个coding plan就烧完了。多步骤Agent是趋势,AI要变聪明、要替人干活,它就得长出手和脚。

两件事叠在一起,单价在降,你的总账单反而可能在涨。所以DeepSeek这种「模型能力在线 + 低价」的基础模型,行业意义就大了。有点像当年手机从功能机变智能机,话费是贵了,但你的手机能发图片、能刷视频了。

模型在变便宜,工作流在变复杂。两件事叠加起来,单位任务的总成本可能反而在涨。这时候,谁能让Agent少走弯路、少塞废话、少重复交代背景,谁就赢了下一轮。未来AI的竞争,不在于模型参数多大,而在于上下文管理和记忆能力多强。

OpenClaw加上MemOS给我的就是这个感觉,它成了目前唯一能把本地模型、自动化技能、消息平台、记忆系统串起来的开源中枢。

很多朋友可能在犹豫,现在还值得入坑吗。

如果你只是想装个新鲜玩意发朋友圈截图,不值得。真的不值得。

但如果你愿意在其中花时间,认真搭一套属于自己的工作流,把选题、运营、远程协作这些每天重复的事情自动化掉,那这只龙虾,可能是你2026年最值得投资时间的开源项目。

MemOS目前GitHub上8600+ Star,Apache 2.0协议开源,值得长期关注。GitHub地址, https://github.com/MemTensor/MemOS

最后,我call back一下开头那句话:OpenClaw是这个时代的Linux,它具有无限大的可能性,前提是需要花时间。

所以,以上分享,也只是我在养虾的一点点心得,我的虾会一直在进化期,大家如果有好用的玩法,请多多分享~

夜雨聆风

夜雨聆风