AI往事 · 第一篇:冬天里的人

AI往事:一个关于AI的系列

—— ◆ ——

2026年4月,加州奥克兰联邦法院。

马斯克站在证人席上,对面坐着Altman。他们曾经一起创立了OpenAI——以“确保AGI造福全人类”为使命的非营利机构。十年后,一个说对方掠夺了非营利资产,一个说对方只是嫉妒。法庭外,另一场战争也在进行:Anthropic的Dario Amodei拒绝让AI为军方服务,OpenAI拿下了五角大楼合同,全球250万用户发起了#QuitGPT运动。

事情怎么就走到了这一步?

2022年ChatGPT上线的时候,所有人都在欢呼。两年后,DeepSeek用1/1800的价格做到了GPT-5.5的90%,算力过剩的信号开始浮现。我写过《藏锋者藏不住了—— Deepseek是否来到了IPO边缘》,写过《GPU紧缺,算力过剩 —— 算力的账谁来算》,写过《估值1.75万亿背后 —— 福特的幽灵正在马斯克帝国游荡》——每一篇都在追问同一个问题的不同侧面:AI正在往哪里去?

但逐渐意识到:追问“往哪里去”之前,得先搞清楚“从哪里来”。

AI不是某一天突然出现的。它经历了70年的等待、两次寒冬、三代人的坚持,以及无数次的分叉。1956年达特茅斯的那群人,以为一个夏天就能解决问题。2012年辛顿的AlexNet,让沉睡了30年的神经网络重新苏醒。2015年马斯克和Altman握手成立OpenAI,承诺永远非营利。2017年8个谷歌工程师写了一篇叫“Attention Is All You Need”的论文,5年后它长出了ChatGPT。

然后,创始人们开始打口水仗、商业仗、司法仗了。

这个系列叫《AI往事》,概要讲述AI的过去(或许还有现在、将来)——那些被遗忘的冬天、被嘲笑的坚持、被背叛的承诺。造出AI的人,有的成了首富,有的上了法庭,有的在坚持安全,有的在加速商业。他们从同一个起点出发,走向了似乎不同的方向。

初步策划全系列共五篇:第一篇《冬天里的人》,讲AI的两次寒冬和三个守夜人;第二篇《点火者》,讲深度学习如何从游戏显卡上苏醒;第三篇《分叉路口》,讲OpenAI的初心与商业化;第四篇《两种信仰》,讲Altman与Dario的价值观之战;第五篇《AI的账单》。当然,后续篇章的标题和内容可能会随着写作深入和事件发展进行调整。

现在一起进入系列第一篇:冬天里的人。

—— ◆ ——

冬天里的人

AI往事·第一篇

这里的“冬天”,不是季节。

是学术和产业意义上的冬天:经费被砍、项目终止、研究者转行,主流机构不再投入,主流期刊不再发表,主流学者不再提及。

这个领域经历过两次这样的冬天。第一次持续了将近十年,第二次更久。两次之间,是一次短暂的、虚假的春天。

讲冬天之前,我先讲那个以为没有冬天的夏天。

—— ◆ ——

一、达特茅斯的夏天

1956年夏天,美国新罕布什尔州达特茅斯学院。

约翰·麦卡锡28岁,是达特茅斯的数学助教授。马文·明斯基29岁,刚从哈佛拿到博士学位。克劳德·香农40岁,已经是贝尔实验室的传奇人物——他1948年那篇《通信的数学理论》创立了信息论,1950年又发表了《为计算机编程下国际象棋》,是机器博弈的先驱。纳撒尼尔·罗切斯特是IBM的信息研究主管,设计了IBM 701——IBM第一台通用计算机。这四个人是被称为开启AI纪元的达特茅斯会议的主要发起人。

(图1:参加1956年达特茅斯会议的部分人员合影)

在这之前的1955年8月,麦卡锡等人起草了一份提案,寄给洛克菲勒基金会申请资助。提案的标题是:“达特茅斯夏季人工智能研究项目”——这是“人工智能”(Artificial Intelligence)这个词第一次出现在正式文件上。

(图2:关于发起达特茅斯会议的1955年提案)

麦卡锡后来解释过为什么要发明这个词。当时学术界描述相关工作的术语有好几个:诺伯特·维纳的“控制论”(Cybernetics),侧重反馈与控制;纽厄尔和西蒙的“复杂信息处理”(Complex Information Processing),侧重符号操作;还有“自动机理论”(Automata Theory),侧重形式模型。麦卡锡一个都不想用——“控制论”跟维纳绑得太紧,“复杂信息处理”太模糊,“自动机理论”太窄。他要一个新词,既中性又精确,能把这些不同方向统到一面旗下。他选了“Artificial Intelligence”——人造的智能。

洛克菲勒基金会批了申请金额的一半:7500美元。会议计划持续8周,从6月18日到8月17日。

实际来的人大约20个,但大多数人来去不定,日常在场只有3到8人。只有麦卡锡、明斯基和雷·所罗门诺夫三个人全程参加了。

参会者里有几个后来改写了各自领域的人。艾伦·纽厄尔和赫伯特·西蒙从卡内基理工学院赶来,他们带来了Logic Theorist(逻辑理论家)——一个用符号推理从公理出发自动搜索证明路径的程序。它成功证明了罗素和怀特海《数学原理》第2章52个定理中的38个,其中一些证明比原书更简洁。这是世界上第一个真正运行的”智能”程序。

阿瑟·萨缪尔带来了他的跳棋程序——一个能通过自我对弈不断改进的程序,是机器学习的早期雏形。奥利弗·塞弗里奇展示了模式识别的工作。亚历克斯·伯恩斯坦展示了国际象棋程序。

还有一个当时不太起眼的名字:约翰·纳什。是的,就是那个博弈论的纳什、后来的诺贝尔经济学奖得主。他当时对机器能否做非数值计算感兴趣,来听了几天就走了。

8周的会议没有产生任何重大突破——麦卡锡原本期望“一个精心挑选的科学家小组,在一个夏天里,就能在若干核心问题上取得重大进展”,这个目标显然没有实现。但会议做了一件更重要的事:它给一个领域命了名,把散落各处的探索统一到了一个旗帜下。

他们以为命了名,就离解决问题不远了。

他们错了。接下来是漫长的、漫长的冬天。

—— ◆ ——

二、第一次冬天(1966-1975)

达特茅斯会议之后,这个新命名的领域迎来了第一次黄金期。美国国防部高级研究计划局(ARPA)是最大的金主——1960年代中期,ARPA对相关研究的年资助额超过300万美元,占当时全美该领域研究经费的绝大部分。MIT、斯坦福、CMU纷纷建立实验室,从业者从几十人膨胀到上千人。

但承诺兑现不了。1966年,美国国家科学院下属的自动语言处理咨询委员会(ALPAC)发布报告,结论是机器翻译的质量远不如人工,成本却更高。报告建议削减经费。这是该领域第一次遭遇权威机构的否定评估。

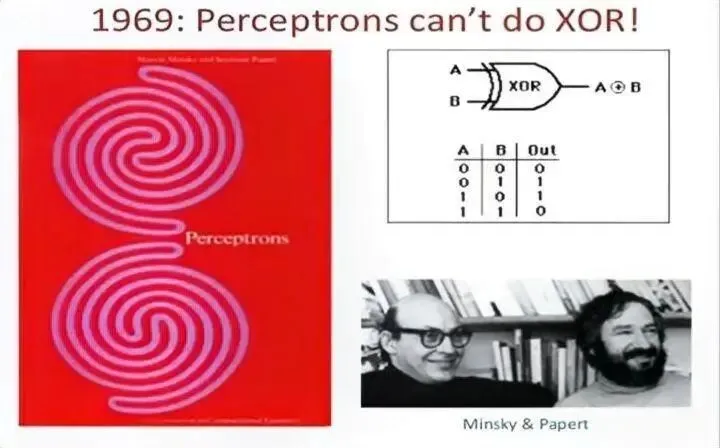

更大的打击来自1969年。明斯基和帕佩特出版了《感知机》一书,从数学上证明了单层神经网络连简单的异或问题都解不了。这本书的影响远超学术范畴——它被资助机构解读为“神经网络没有前途”,美国的主要资助方因此砍掉了几乎所有神经网络方向的经费。

整个子领域,因为一本书,被抹掉了。

(图3:《感知机》封面及其作者)

致命一击来自1973年。英国科学家詹姆斯·莱特希尔受政府委托,对该领域的研究进行全面评估。他的结论是:相关技术在可控场景下的成就被严重夸大,在现实世界中几乎没有可用成果。报告发布后,英国砍掉了经费——爱丁堡大学和萨塞克斯大学的实验室被关停。美国紧随其后,ARPA的预算在1974财年被大幅削减,从峰值滑落了超过60%。

这就是第一次冬天,账面冷峻:经费砍掉六成,实验室关停,研究者转行。

莱特希尔报告的核心论点:在“积木世界”里表现优异,但在真实世界里几乎一事无成。这个判断,在50年后依然有回响——今天的大模型在基准测试上表现惊艳,但在真实场景中仍然频繁出错。

但冬天,也总有人在雪地里走。

—— ◆ ——

三、专家系统的泡沫(1980-1987)

1980年代,行业迎来第二春。这一次,救星是专家系统。

专家系统的逻辑很简单:把人类专家的知识编码成规则,让机器按规则推理。它的底层哲学是符号主义——认为智能的本质是符号操作,只要把规则写够,机器就能推理。XCON是DEC公司开发的计算机配置系统,每年为公司节省数千万美元。DENDRAL是斯坦福开发的化学分析系统,能从质谱数据推断分子结构。MYCIN能诊断血液感染,准确率超过一些人类医生。

商业成功引发了狂热,但狂热的形态跟今天很不一样。1980年代的风投行业全年募资规模大约40亿美元——不到今天的1/30。真正驱动这轮热潮的不是VC,而是三股力量:大公司自建、政府拨款、以及少数几家专家系统公司的IPO炒作。

大公司纷纷下场。DEC、杜邦、通用汽车、美国运通都组建了内部团队,用专家系统解决业务问题。政府层面,日本在1982年启动了“第五代计算机”计划,10年累计投入约540亿日元(约4亿美元),目标是造出能推理、能理解自然语言的智能计算机。美国和欧洲不甘落后——1983年,十多家美国公司联合成立了MCC(微电子与计算机技术公司),年预算约7000万美元,其中1500万专门用于对抗日本的第五代计算机。

资本市场也炒了起来。Symbolics——一家从MIT AI实验室分拆出来的LISP机器公司——1986年上市后股价飙升,峰值年营收1.14亿美元。IntelliCorp 1983年IPO时年营收仅10万美元,但市场按预期定价。1984年《商业周刊》预测专家系统市场将从2000万美元暴涨至1993年的25亿美元。

泡沫的终点是1987年。25亿美元的市场没有到来。专家系统的致命缺陷暴露了:规则是人写的,写完了就不能变。世界在变,规则不变,系统就废了。维护成本远超收益,企业开始退货。Symbolics从峰值滑落,1989年股价跌至1美元。日本第五代计算机计划在1992年悄然终止。

然后,第二次冬天来了。

读到这里,如果你看过我上一篇文章《从〈规模〉到〈技术革命与金融资本〉》,也许会问:AI作为第六次技术革命的起点不是2012年之后吗?1980年代的专家系统泡沫应该算是AI的一次假启动:结构上,它完美复刻了佩蕾丝描述的狂热阶段——资本涌入、预期脱离现实、泡沫破裂;但本质上,它不是真正的技术革命,底层的符号主义路线走不通。

—— ◆ ——

四、第二次冬天(1987-1993)

第二次冬天比第一次更冷,冷在信用破产。

第一次冬天只是经费缩减,学术研究还在继续。第二次冬天是整个领域的信用破产——专家系统的失败让投资人和学术界彻底丧失了耐心。“人工智能”这个词变成了禁忌,研究者在申请经费时不敢用,只能说“机器学习”或“模式识别”。产品厂商也急着换标签——“专家系统”被重新包装成“决策支持”、“知识管理”、“客户机/服务器”——任何词都行,不能叫AI。

到1990年代初,美国和欧洲的经费几乎归零。MIT的AI实验室改名,CMU的机器人研究所大幅缩编,斯坦福的AI组散了一半。

在最冷的日子里,整个领域的活跃研究者可能不到几百人。前一年还有几千人的会议,现在一个报告厅都坐不满。

但第二次冬天里还有一个更深的裂痕,比经费断裂更深:范式之争。

1980年代的主流是符号主义——规则、逻辑、知识库。但一直有一条被压在底层的暗线:连接主义——神经网络,让机器自己从数据中学习,而不是由人编写规则。符号主义自上而下,连接主义自下而上。两条路线的根本分歧在于:智能到底是“写出来的”还是“长出来的”?

明斯基1969年那本《感知机》,杀死的不仅是经费,更是连接主义的话语权。此后近20年,符号主义是正统,连接主义是异端。1986年,鲁梅尔哈特和麦克莱兰出版了《并行分布式处理》(PDP)两卷本,从理论上复兴了连接主义,但这本书在主流社区引起的反应是质疑多过认可。

后来的图灵奖得主杨立昆(Yann LeCun)回忆那个年代:“我们做神经网络研究的人,在学术会议上就像异教徒。主流社区看我们的眼神,就像看一群还在相信地球是平的人。”

但就是在这样的冬天里,有三个“异教徒”还在走。

—— ◆ ——

五、冬天里的人

杰弗里·辛顿(Geoffrey Hinton),1947年生于英国伦敦。他的曾曾祖父是布尔代数的发明者乔治·布尔,家族中还有一位逻辑学家查尔斯·道奇森——笔名刘易斯·卡罗尔,写了《爱丽丝漫游奇境记》。神经网络不只是辛顿的研究方向,几乎是他家族的遗产。另外,辛顿有一个堂姑是曾长期定居在中国并获得中国“绿卡”第一人的美核物理学家寒春。

1970年代,辛顿在爱丁堡大学读博士,研究神经网络。他的导师希金斯建议他换个方向,因为“神经网络没有前途”。辛顿没有换。他的理由很简单:大脑是一台神经网络,既然大脑能思考,神经网络就应该能思考。问题不是神经网络不行,是我们还没找到训练它的方法。

毕业后,辛顿在美国和英国辗转了多所大学,始终无法获得永久教职——因为没有人愿意给一个研究“死路”的人终身职位。直到1987年,他收到了多伦多大学的邀请。加拿大是少数几个还在资助相关研究的国家,多伦多成了他30年的根据地。

杨立昆(Yann LeCun),1960年生于法国巴黎郊区。少年时代在父亲的电子工作台旁长大,对机器如何“学习”充满好奇。1980年代在巴黎读博期间,他读到了辛顿的论文,认定这就是方向。1988年,他加入了贝尔实验室——AT&T的研究机构,少数几个还愿意资助神经网络的地方。在贝尔实验室,他做出了LeNet-5——一个识别手写数字的卷积神经网络,被美国银行用来识别支票上的手写字体。这是神经网络第一个真正的大规模商业应用。但几乎没有人在意。人们说:识别数字算什么智能?

约书亚·本吉奥(Yoshua Bengio),1964年生于法国巴黎,在蒙特利尔长大。他的路径比辛顿和LeCun更孤独——连贝尔实验室的庇护都没有,一直在蒙特利尔大学默默做研究。2003年,他开创了神经语言模型的方向——用神经网络来建模语言。这个方向后来演变成了大语言模型,但在2003年,没有人觉得语言模型有什么前途。

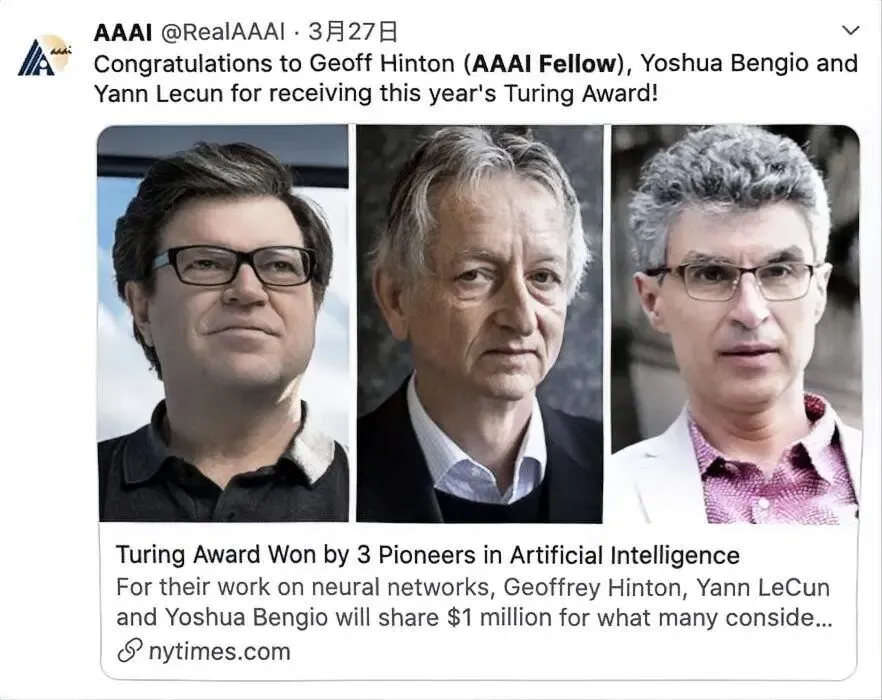

三个人,三个国家,一条被所有人放弃的AI思想和技术路线。辛顿在多伦多坚持反向传播,LeCun在贝尔实验室推进卷积网络,本吉奥在蒙特利尔开辟语言模型。30年里,他们各自的成果几乎没有被主流社区引用过。

(图4:Hinton、LeCun、Bengio获得2018年图灵奖)

他们是连接主义的三个守夜人——在符号主义的废墟上,守着一条主流都说走不通的路。

辛顿在2006年提出了“深度信念网络”的逐层训练方法,第一次让多层神经网络的训练变得可行。这篇论文没有引起轰动——那时行业还在第二次冬天的尾巴里,少有人能预见和相信如今神经网络的贡献。

辛顿在2012年获得ImageNet冠军后说:“我从来没有怀疑过这个方向。我只是不确定能不能在有生之年看到它成功。”那年他64岁。

—— ◆ ——

六、冬天结束了

2012年10月,ImageNet图像识别竞赛。

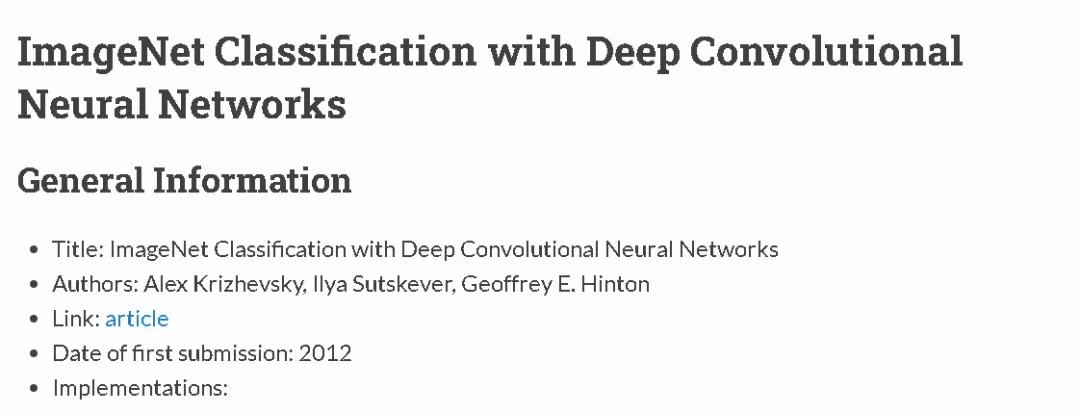

辛顿带着两个学生——亚历克斯·克里泽夫斯基和伊利亚·苏茨克维——提交了一个叫AlexNet的系统。它把图像识别的错误率从26%砍到了15.3%。第二名被甩开了10个百分点。

(图5:深度学习史上里程碑级论文——AlexNet的首页)

这不是进步,这是地震。

AlexNet用了一个关键技术:GPU。辛顿的团队发现,英伟达为游戏设计的显卡,恰好适合做神经网络的并行计算。两张GTX 580——当时最好的消费级显卡——训练了6天,就做到了此前所有人6年都没做到的事。

历史的偶然在这里交汇:一个被学术界遗弃了30年的方法,一个本来给游戏用的硬件,一个64岁的老人和他的两个学生——他们在2012年10月的那个夜晚,终结了第二次冬天。

更重要的是,AlexNet终结的不只是一个冬天,它终结的是一场持续了40年的范式之争。符号主义说智能是“写出来的”,连接主义说智能是“长出来的”。2012年之后的技术和产业发展给出来答案和方向。

谷歌是第一个反应过来的。2013年,谷歌收购了辛顿创办的DNNresearch公司——只有三个人,没有产品,没有收入,只有一篇论文和一种信念。辛顿从学术孤儿变成了科技巨头争抢的人。

更大的冲击波还在后面。

2012年之后,深度学习横扫了所有子领域:图像识别、语音识别、自然语言处理、机器翻译——一个接一个,此前的最好成绩被深度学习刷新。30年的等待,在一瞬间兑现。

然后,2015年12月,旧金山。一个叫马斯克的人和另一个叫Altman的年轻人坐在一张桌子前,签下了一份文件。文件上写着:“OpenAI的目标是确保通用人工智能造福全人类。”

那个夜晚,他们充满希望。

十年后,他们在法庭上再见。

—— ◆ ——

结语

冬天里的人等了30年。

或许这些人不是最聪明的人,比他们聪明的人转行了,去做了更“有前途”的方向。

他们也不是最幸运的人,辛顿64岁毕竟等到春天,而很多人根本没等到。弗兰克·罗森布拉特,1958年造出了“感知机”——第一个真正意义上的神经网络硬件(题外话,这台机器当时也成为明斯基攻击“神经网络”技术路线的靶子)。1971年在切萨皮克湾的一次划船事故中溺水身亡,年仅43岁。他甚至没活到第一次冬天最冷的时候。

达特茅斯的那群人呢?艾伦·纽厄尔1992年去世,正是第二次冬天最深的年份。赫伯特·西蒙2001年去世,神经网络还没复苏。约翰·麦卡锡2011年去世——离AlexNet只差一年。他给这个领域命了名,等了55年,差一年没看到答案。香农是最长寿的,2001年去世,他晚年很少谈论AI。

不是每个坚持的人都能等到春天。有些人倒在了冬天,有些人死在了黎明前最后一刻的黑暗里。

所以说,偏执的人也有幸运的时候。辛顿相信大脑是一台神经网络,一定能思考。这个信念支撑了他40年。从1970年代的学术异端,到2012年的ImageNet冠军,再到2024年的诺贝尔物理学奖——他没有动摇。

但冬天结束之后,新的问题开始了。

火被点燃了。但点火者很快发现,火不归他们管。

2015年OpenAI成立时,辛顿的两个学生之一——伊利亚·苏茨克维——加入了。他是OpenAI的研究核心。9年后,他会亲手发起一场政变,试图开除Altman。然后他会后悔,然后他会离开。

正如 ImageNet 缔造者李飞飞说的“AI 的关键,不是人工智能,而是人类的智慧与价值”。AI 的推动者如普洛斯修斯,用人类的意志、智慧和追求点燃火把。

冬天的故事讲完了。接下来的故事,正是关于火——谁点了火,火怎么烧起来的,以及火烧起来之后,点火者之间的那场战争。

—— ◆ ——

资料参考

1. McCarthy, J. et al. (1955). A Proposal for the Dartmouth Summer Research Project on Artificial Intelligence

2. McCorduck, P. (2004). Machines Who Think (2nd ed.). A K Peters

3. Minsky, M. & Papert, S. (1969). Perceptrons. MIT Press

4. Lighthill, J. (1973). Artificial Intelligence: A General Survey. UK Science Research Council

5. National Research Council (1966). Language and Machines: Computers in Translation and Linguistics (ALPAC Report)

6. Rumelhart, D., McClelland, J. et al. (1986). Parallel Distributed Processing. MIT Press

7. Barr, A. & Tessler, S. (1995). Expert Systems: A Technology Before Its Time

8. Krizhevsky, A., Sutskever, I. & Hinton, G. (2012). ImageNet Classification with Deep Convolutional Neural Networks

9. Hinton, G., Osindero, S. & Teh, Y. (2006). A Fast Learning Algorithm for Deep Belief Nets

10. LeCun, Y. et al. (1998). Gradient-Based Learning Applied to Document Recognition

11. Bengio, Y. et al. (2003). A Neural Probabilistic Language Model

12. 卡萝塔·佩蕾丝《技术革命与金融资本》,中国人民大学出版社

13. 米切尔·沃尔德罗普《复杂:诞生于秩序与混沌边缘的科学》,中信出版社

14. 追溯开启AI元年的达特茅斯会议,坐在香农身边的神秘“第七人”是谁,澎湃新闻·澎湃号·湃客

夜雨聆风

夜雨聆风