手机直接跑大模型!Google 官方 App 下场,Gemma 4 离线多模态 Agent,2万人点赞疯传

【导读】Google 这次玩真的了——不是发个模型让极客折腾,而是直接在 App Store 和 Google Play 上架了官方应用,下载即用,离线运行,还能做多步 Agent 工作流。Gemma 4 发布三天,官方推文近710万次观看、2万人点赞,全网都在刷”手机上跑 AI Agent”。

你的手机,现在就是一台 AI 服务器

4月2日,Google DeepMind 官方账号发了一条推文,炸了。

“We just released Gemma 4 — our most intelligent open models to date. Built from the same world-class research as Gemini 3, Gemma 4 brings breakthrough intelligence directly to your own hardware for advanced reasoning and agentic workflows.”

「我们刚刚发布了 Gemma 4——迄今为止我们最智能的开放模型。基于与 Gemini 3 相同的世界一流研究成果,Gemma 4 将突破性智能直接带到你自己的硬件上,用于高级推理和智能体工作流。」

▲ Google 官方发布推文,近710万次观看,2万点赞,1万收藏

Apache 2.0 许可证——这三个词才是这条推文里最炸裂的部分。

懂行的人都知道,之前的 Gemma 系列用的是 Google 自家定制的许可证,商用限制一堆。这次直接切到 Apache 2.0,意味着:任何人、任何公司,都可以自由使用、修改、商业化分发。

Google 不是在做慈善,而是在抢生态位。

不只是聊天——手机上的 AI Agent 来了

发模型不算新闻,Google 这次真正的大招是另一个东西:Google AI Edge Gallery。

这是一个官方应用,同时上架了 iOS App Store 和 Google Play,Android 12+、iOS 17+ 就能装。打开 App,下载一个 2.5GB 的模型文件,然后——

你的手机就变成了一台完全离线的 AI 工作站。

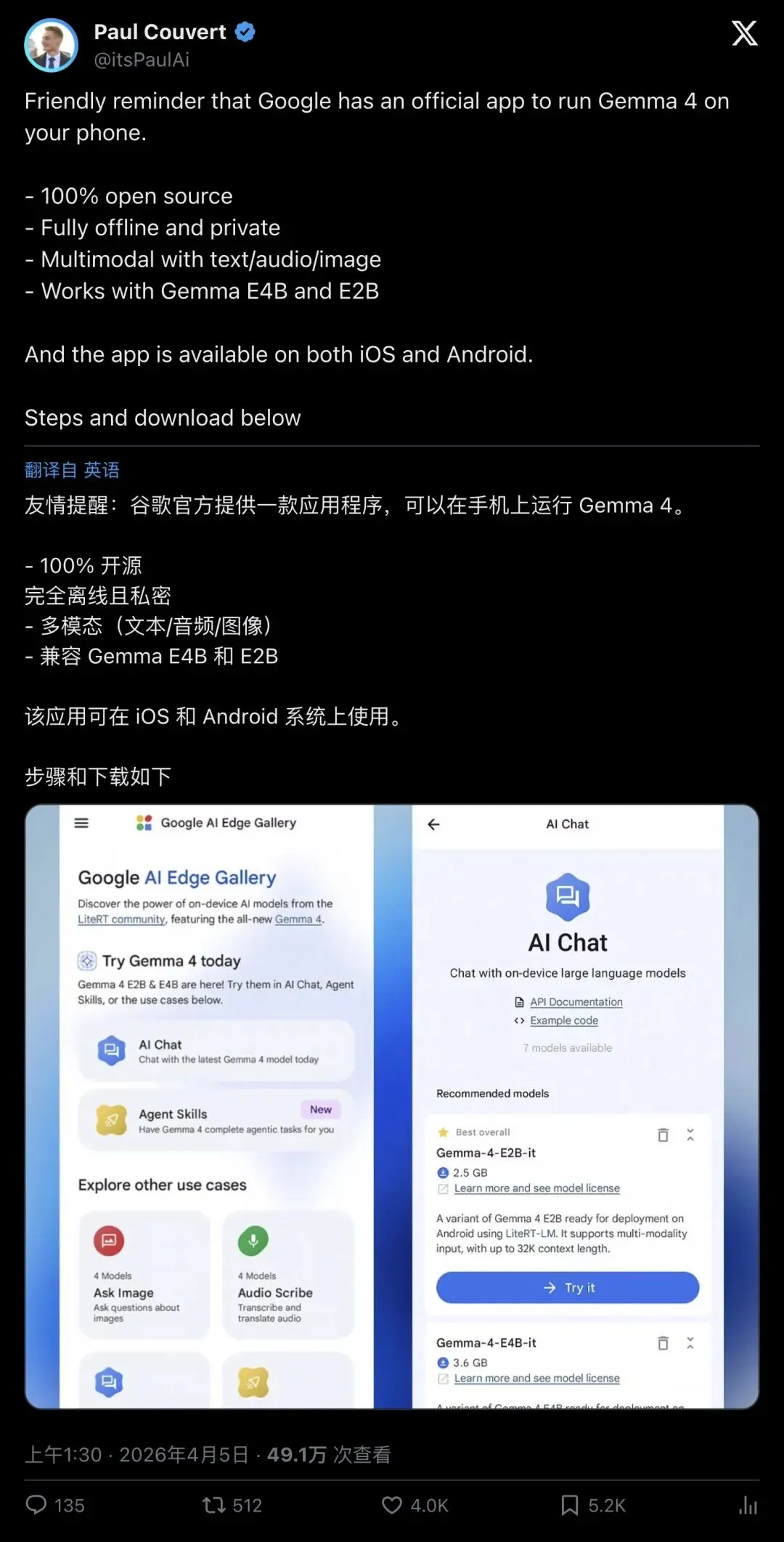

▲ @itsPaulAi 的”友情提醒”推文获得4000+点赞、5000+收藏,附带 App 界面演示

Paul Couvert 的这条推文把卖点总结得很到位:

“Friendly reminder that Google has an official app to run Gemma 4 on your phone. 100% open source. Fully offline and private. Multimodal with text/audio/image.”

「友情提醒:谷歌有一款官方应用,可以在手机上运行 Gemma 4。100%开源、完全离线且私密、支持文本/音频/图像多模态。」

但真正让人坐不住的,是 App 里那个标着“New”的功能入口——Agent Skills。

Agent Skills:端侧 AI 的「iPhone 时刻」

Google 官方博客用了一个非常大胆的表述:

“Google AI Edge Gallery … launch of Agent Skills … one of the first applications to run multi-step, autonomous agentic workflows entirely on-device.”

「Google AI Edge Gallery 推出 Agent Skills……首批在设备端完全运行多步骤、自主智能体工作流的应用之一。」

翻译成人话就是:你的手机可以在完全断网的状态下,让 AI 自己规划步骤、调用工具、串联工作流。

这不是简单的”离线聊天”。Agent Skills 能做什么?

- 查维基百科做知识增强

(离线预置的技能模块) - 生成交互式内容

:摘要、闪卡、数据可视化 - 组合其他模型能力

:语音转写、图像识别、TTS - 把复杂工作流用对话串起来

▲ 开发者 David Hendrickson 分享 AI Edge Gallery 界面,Agent Skills 标注为 “New”

你以为这就完了?

Google 同时还推了LiteRT-LM(跨设备推理运行时)和Android AICore Developer Preview(系统级 AI 优化),这说明 Google 的野心不只是做一个 App——他们在推一整套端侧 AI 基础设施。

四个模型,从手机到服务器全覆盖

Gemma 4 这次给了四个尺寸,覆盖面极广:

|

|

|

|

|---|---|---|

| E2B |

|

|

| E4B |

|

|

| 26B A4B |

|

|

| 31B |

|

|

这里有个技术细节值得说:E2B 和 E4B 的 “E” 代表effective parameters(有效参数),用了一种叫PLE(Per-Layer Embeddings)的架构——嵌入层参数量大但计算开销极低,所以能在手机上跑起来。

上下文窗口最高 256K,小模型也有 128K。多模态支持文本+图像,E2B/E4B 还原生支持音频输入。

更恐怖的是性能:官方数据显示,Gemma 4 E4B 在许多基准测试上击败了 Gemma 3 27B——一个不到50亿参数的模型,干翻了270亿参数的前辈。

中文圈炸了:「直接手机下载使用」

Gemma 4 发布后,中文圈的传播速度极快。

▲ 博主 @WY_mask 详细介绍了 Gemma 4 的函数调用和 Agent 能力,并附 App Store 直达链接

博主”无颜”写道:「谷歌最新开源模型 Gemma 4 可以直接手机下载使用。Gemma 4 支持在用户本地硬件上运行,同时具备函数调用的能力,意味着模型不仅能对话,还可以直接调用工具、浏览网页、执行代码甚至接入 API,具备 AI 代理的能力。」

不需要配环境,不需要装 Python,不需要搞 Docker——App Store 搜一下,下载,点开,用。

这在端侧大模型的历史上,前所未有。

全球开发者:「离线就是新的高级」

这几天最火的一个观点来自 Martin Szerment:

▲ @MartinSzerment 称”离线才是新的高级体验”,展示 Gemma 4 E2B 在 iPhone 17 Pro 上以约40 tokens/s 运行

“The on-device AI story just flipped. Cloud scaling is no longer the bottleneck — hardware locality is. Gemma 4 E2B runs on iPhone 17 Pro at ~40 tokens/s using MLX optimized for Apple Silicon. 128K context, full offline mode, SOTA reasoning. This kills the ‘you need the cloud’ narrative.”

「设备端 AI 的格局彻底改变了。云扩展不再是瓶颈——硬件本地化才是。Gemma 4 E2B 在 iPhone 17 Pro 上以约40 tokens/s 运行。128K 上下文,完全离线模式,SOTA推理能力。这彻底否定了”你需要云服务”的说法。」

离线才是新的高级体验(Offline is the new premium)——这句话值得所有做 AI 产品的人好好品味。

而 @AIxCrypto101 则看到了更深层的信号:

▲ “如果 Gemma 4 能够在手机本地离线运行……有用的 AI 不必存在于云端”

“Google’s AI Edge Gallery may be one of the clearest signs that on-device AI is going mainstream. If Gemma 4 can run locally on phones, offline, private, and multimodal, the default assumption changes: useful AI doesn’t have to live in the cloud.”

「Google 的 AI Edge Gallery 可能是设备端 AI 走向主流的最明显标志之一。如果 Gemma 4 能够在手机本地离线运行,并支持私密和多模态应用,那么默认假设就会改变:有用的 AI 不必存在于云端。」

Google AI 官方的「本周战报」

Google AI 官方在这周发了一条汇总推文,Gemma 4 排在第一位:

▲ @GoogleAI 本周发布汇总,Gemma 4 排在首位,”性能甚至超越了体积是自身20倍的同类产品”

“Here’s everything we launched this week: — Gemma 4, bringing our most intelligent open models and breakthrough reasoning to your personal hardware and devices while outcompeting models 20x its size”

「以下是我们本周推出的所有内容:Gemma 4,将我们最智能的开放模型和突破性推理技术带到你的个人硬件和设备上,其性能甚至超越了体积是自身20倍的同类产品。」

20倍——这个数字不是 Google 随便说的。当一个能塞进手机的模型,开始在测试中碾压那些需要几十GB显存的大家伙,游戏规则就已经变了。

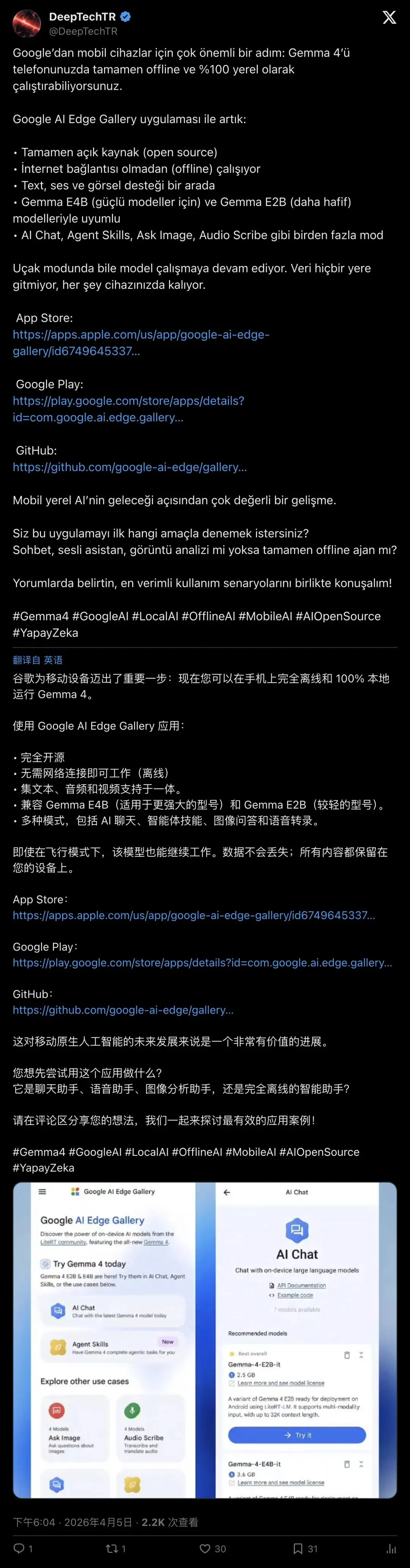

全球热度:从土耳其到日本,都在刷屏

▲ 土耳其科技博主 @DeepTechTR 用三种语言(土耳其/中文/英文)介绍了 AI Edge Gallery,附 App Store、Play Store、GitHub 链接

Gemma 4 的传播已经跨越了语言边界。土耳其博主详细列出了 App 的所有下载渠道,并用中文翻译强调了核心卖点:”完全开源””完全离线””支持多模态”。

一个来自 Google 的端侧 AI 应用,在全世界同时引爆——这本身就说明了市场有多饥渴。

写在最后:AI 的重心正在从云端滑向口袋

回顾一下 Google 这次做了什么:

- 开源模型

(Apache 2.0,真正的自由许可) - 官方应用

(双平台上架,下载即用) - Agent 能力

(不只是聊天,是多步工具链工作流) - 端侧运行栈

(LiteRT-LM + AICore,系统级支持) - 全尺寸覆盖

(从20亿到310亿参数,手机到服务器)

这不是一次普通的模型发布。这是 Google 在用一整套组合拳告诉行业:AI 的未来,不一定在云上。

当你的手机可以完全断网、完全私密地运行一个支持多模态、能做 Agent 工作流的 AI——你还需要把数据传到云端吗?你还需要按 token 付费吗?

端侧 AI 的时代,已经开始了。

— END —

夜雨聆风

夜雨聆风