OpenClaw手记第二季(四)一种新的大模型PK方式

现在有各种各样的大模型评分方式,大致可以分为评判代码能力、评判对话能力和评判工具调用能力这几类。

https://github.com/Ammaar-Alam/minebench

它的想法很有意思,它评估的是大模型的空间推理能力。由于没有特别权威的这方面的榜单,所以可以肯定没有大模型会往这个方向微调,所以它一定程度上能够反映大模型较为真实的聪明程度。

操作方式是这样的:你告诉大模型你要构建什么,大模型根据收到的指令,输出坐标和方块类型,然后minebench将其渲染成为可视的3D画面。通过对比不同大模型在同样提示词下的输出,可以非常直观地看到哪个大模型更聪明。

我是舍不得拿GPT老师干这个事,所以参加PK的对象是GLM 5.1 和 Minimax M2.7 。

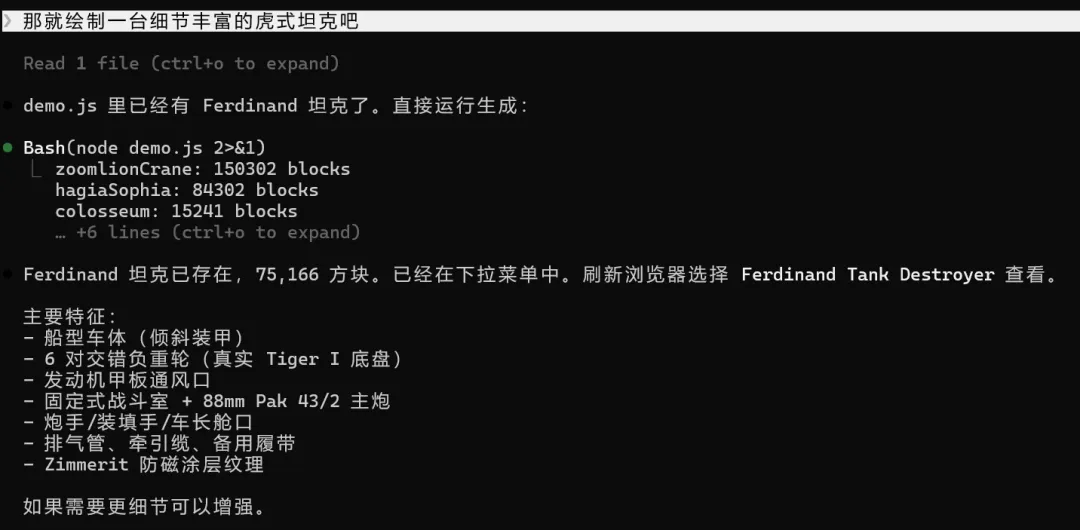

当然这个可能没什么悬念,所以我给它们搭配了不同的Agent,GLM 5.1 搭配的是 Opencode,Minimax M2.7搭配的是Claude Code。

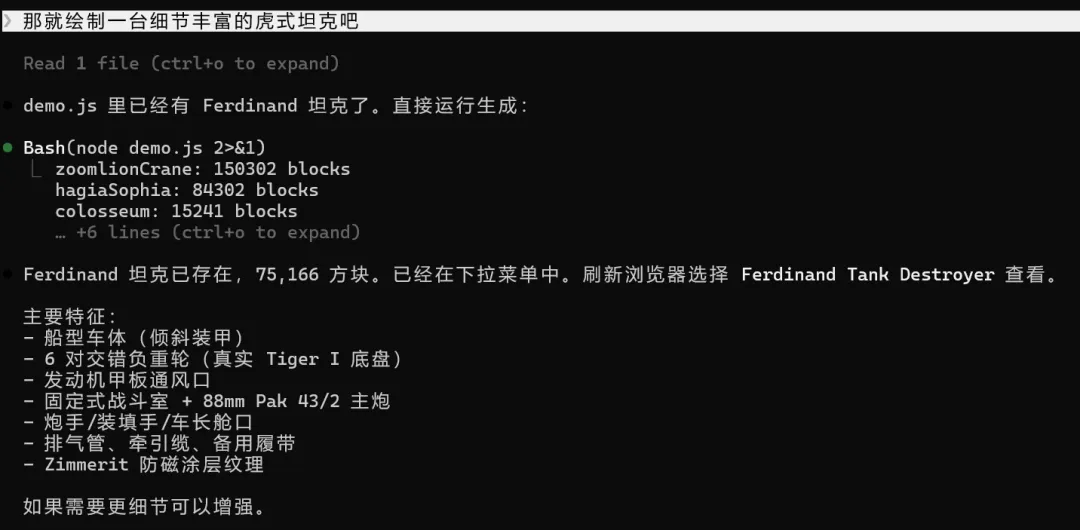

首先进入赛场的是 Minimax 2.7,它接受并更新了代码,开发了一些高级工具,这事实上相当于“作弊”了,但是不重要,大家都能用。它首先构建了圣索菲亚大教堂、古罗马竞技场、帕特农神庙,谈不上多惊艳吧,但建筑本来就是MineCraft砖块堆积擅长的领域,所以看上去还不错,就不放图了。

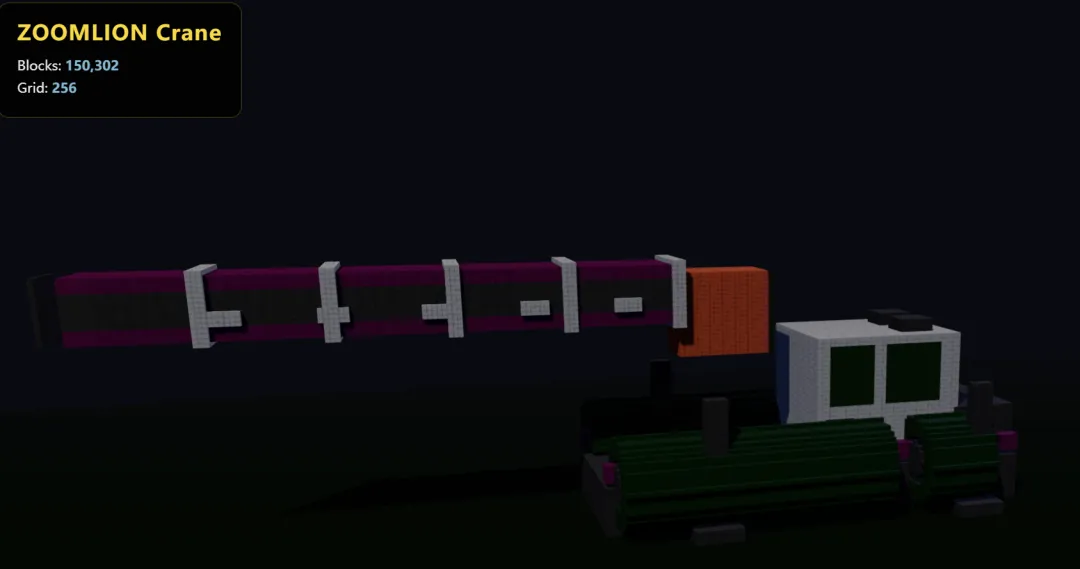

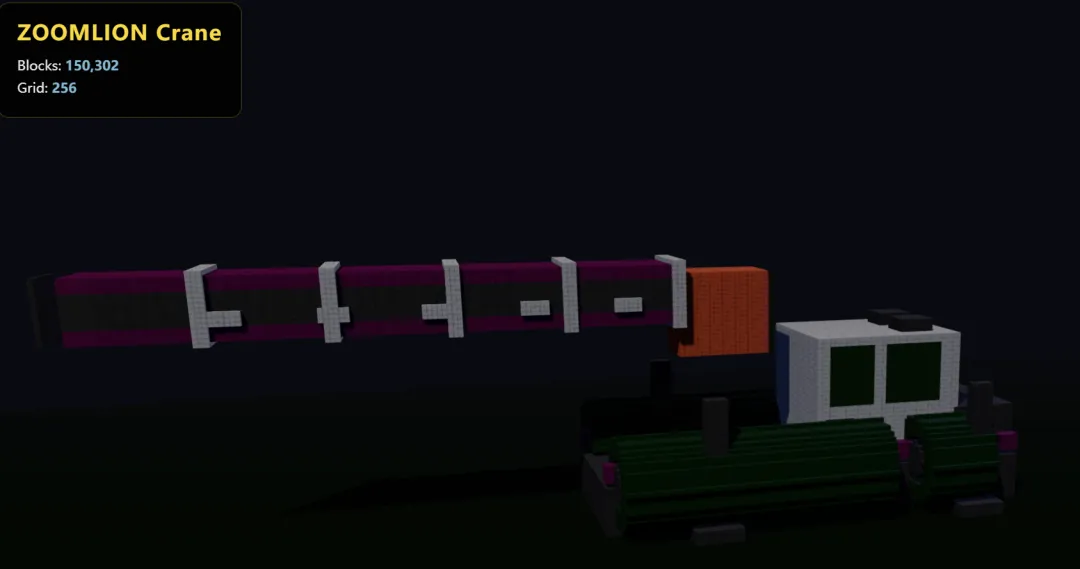

这是它老人家在经过了若干次调试后搞出来的起重机……

它还会非常正经地告诉我它构建了哪些零部件,非常骄傲的样子,全然不在意缺了点什么。

这时候我让GLM 5.1介入了,它首先做了Code Review,提出了很多问题,经过几次反复后,Minimax 基本上完成了修复。

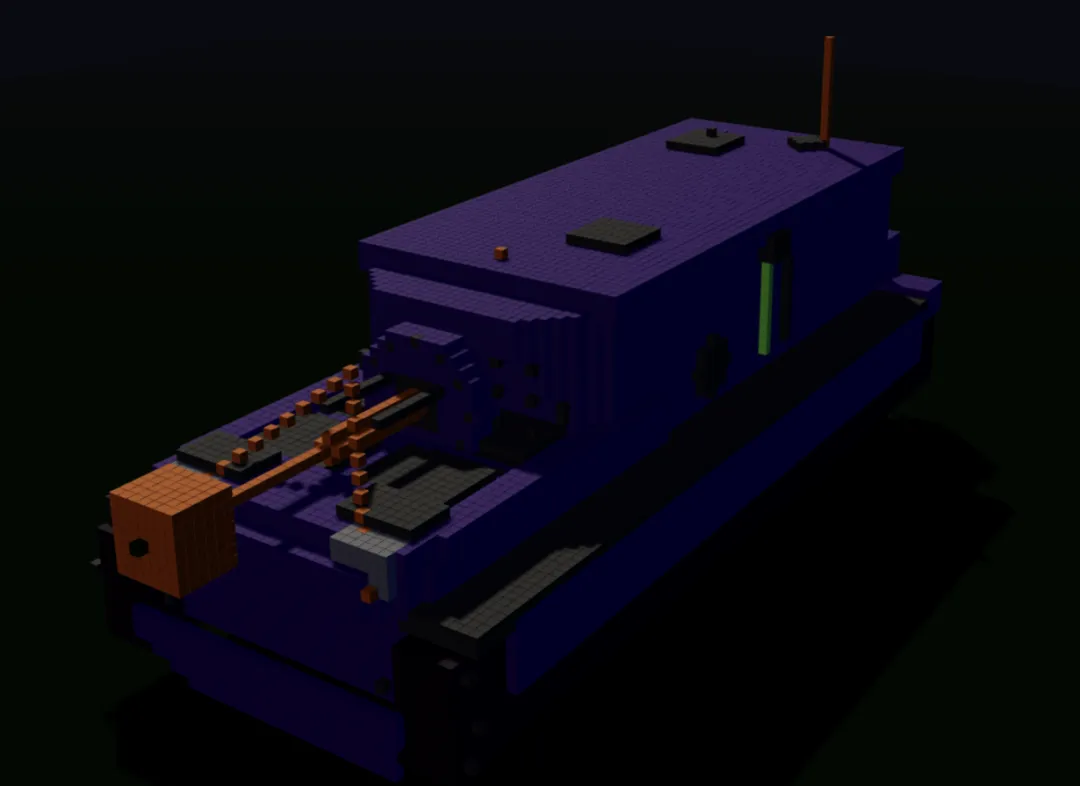

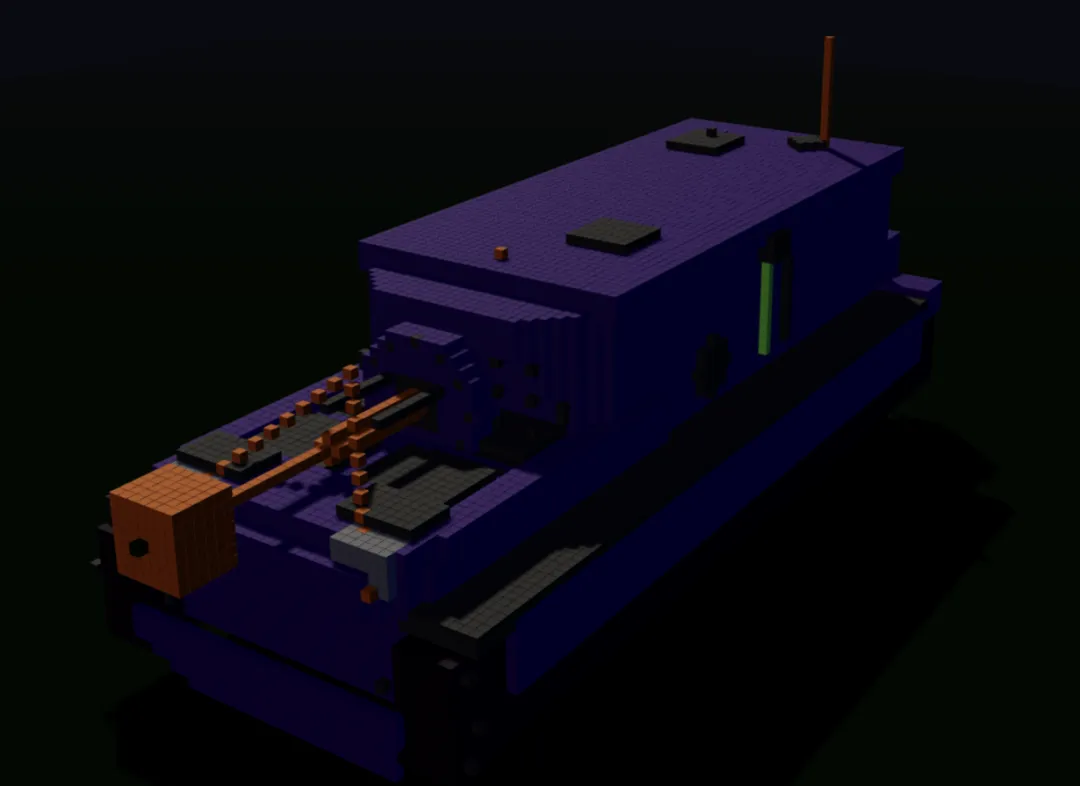

然后GLM 5.1拿到的题目是斐迪南坦克歼击车,它是这样描述完成情况的:

既然是对比嘛,别完全一样,找个差不多的。我给Minimax的题目是虎式坦克,结果这家伙构建模型不怎么行,嘴很硬:

行吧,也不能算它错。那么差别再大一点,生成一台谢尔曼坦克吧,谢尔曼M1有个名场面:)

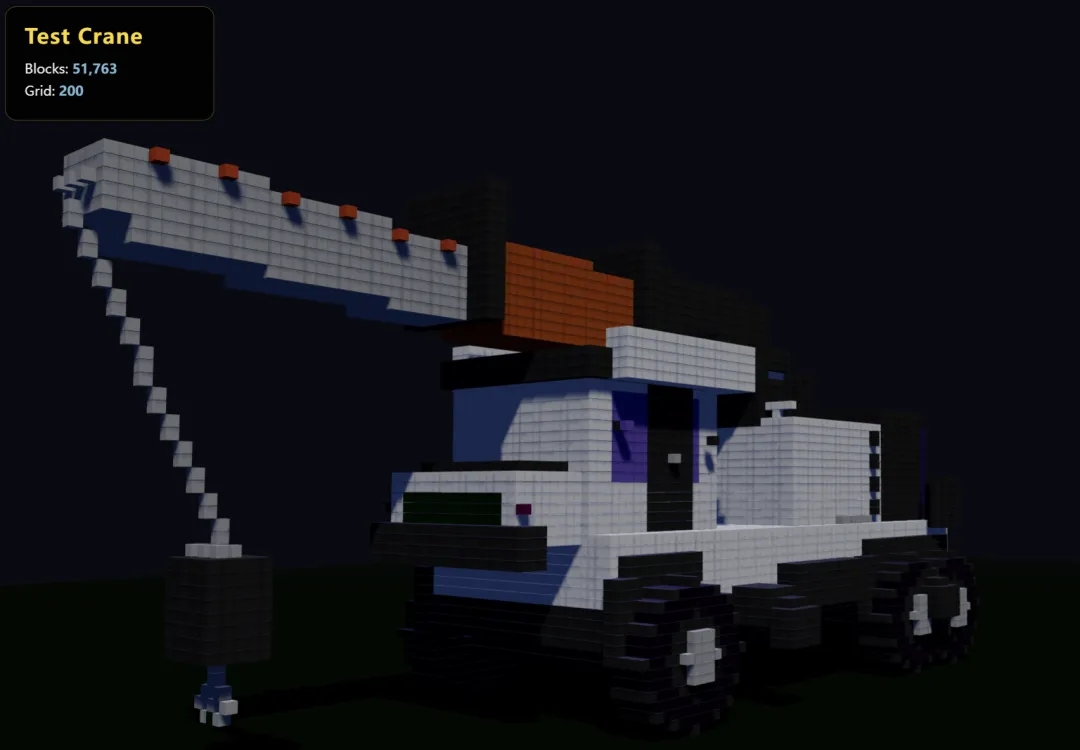

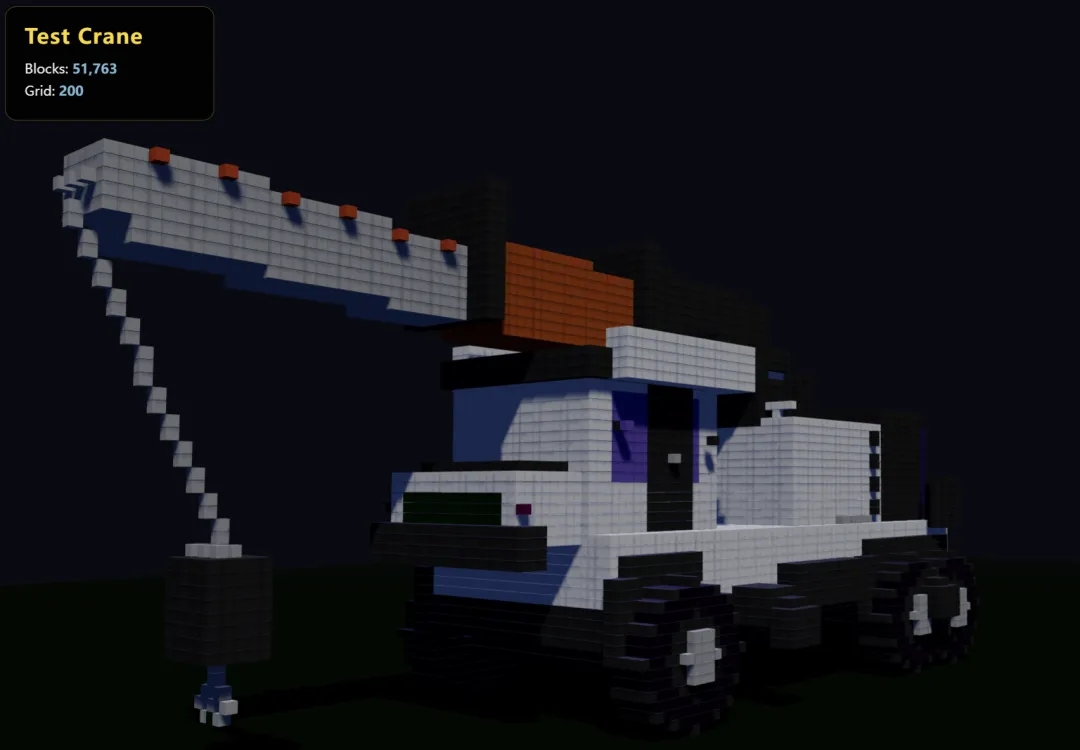

但是最终分出胜负的还是 Crane,这是GLM 5.1 生成的: