AI智能体交互设计指南:让Agent与人类自然协作的5大黄金法则,建议所有Agent对照整改

💡 核心观点:智能体正在重塑软件开发流程,但成功的关键不在于技术能力,而在于交互设计。Linear提出的Agent Interaction Guidelines(AIG)揭示了5个黄金法则:透明身份、原生栖息、即时反馈、状态可见、权责分明——这些原则决定了Agent能否真正融入人类工作流。

引言:智能体时代的”新人机契约”

🔴 痛点:当Agent悄悄潜入工作流

你正在团队协作工具里处理一个问题,突然看到一条回复:”已修复bug,请检查”。你以为是同事小明发的,回复了”谢谢”,却发现对方没有回应。

真相揭晓:这是一条来自AI智能体的自动回复。

这个场景揭示了当前Agent应用的致命问题:人类不知道自己在和谁对话。

🟢 解决方案:Linear的人机交互革命

Linear公司——一家为团队协作而生的科技公司——正在定义AI时代的”新契约”。

他们发布的Agent Interaction Guidelines (AIG)不是技术规范,而是交互设计宣言:一套让Agent自然融入人类工作流的基础原则和实践。

核心洞察:

❝ 智能体正在改变软件的规划、构建、审查和部署方式。因为智能体能大量产出工作,角色和工作流被重塑。价值转移到编排输入、上下文工程和审查输出。 ❞

这种转变需要新的人机交互契约。

🎯 本文价值:5个黄金法则

本文将解析AIG的5个核心原则:

-

1. 透明身份:智能体必须披露自己是智能体 -

2. 原生栖息:智能体应该在平台原生运行 -

3. 即时反馈:智能体应该立即响应用户 -

4. 状态可见:智能体应该清晰展示内部状态 -

5. 权责分明:智能体不能被问责,责任在人

掌握这些原则,你将能设计出真正有用的AI智能体。

1. 黄金法则一:智能体应该始终披露自己是智能体

🔴 问题:身份混淆导致信任危机

当人类和智能体并肩工作时,人类需要即时确定性——知道自己在和谁交互。

如果智能体没有明确标识身份,就会被误认为是真人。这种混淆会导致:

-

• 期望错位:人类期待实时互动,智能体却按程序运行 -

• 信任崩塌:发现真相后,用户对整个系统失去信任 -

• 协作障碍:团队成员不知道任务是由谁完成

🟢 解决方案:明确标识,永不混淆

智能体必须清晰标识身份,绝不可能被误认为是真人。

💡 设计实践

Linear的用户下拉菜单中,人类用户和智能体用户被清晰区分:

-

• 人类用户:显示真实姓名和头像 -

• 智能体用户:显示Agent名称 + 明确的”Agent”徽章

关键设计要素:

-

• ✅ 视觉徽章(Badge)标识”Agent” -

• ✅ 在用户列表中单独分类 -

• ✅ 在所有交互中保持标识一致

🎯 核心价值

身份透明 = 信任基础。

只有当人类明确知道”这是智能体”,才能:

-

• 调整期望(知道响应速度、交互模式) -

• 合理分配任务(委托给Agent或人类) -

• 建立正确的工作流(编排Agent和人类的协作)

第一个黄金法则:让Agent永远无法”伪装”人类。

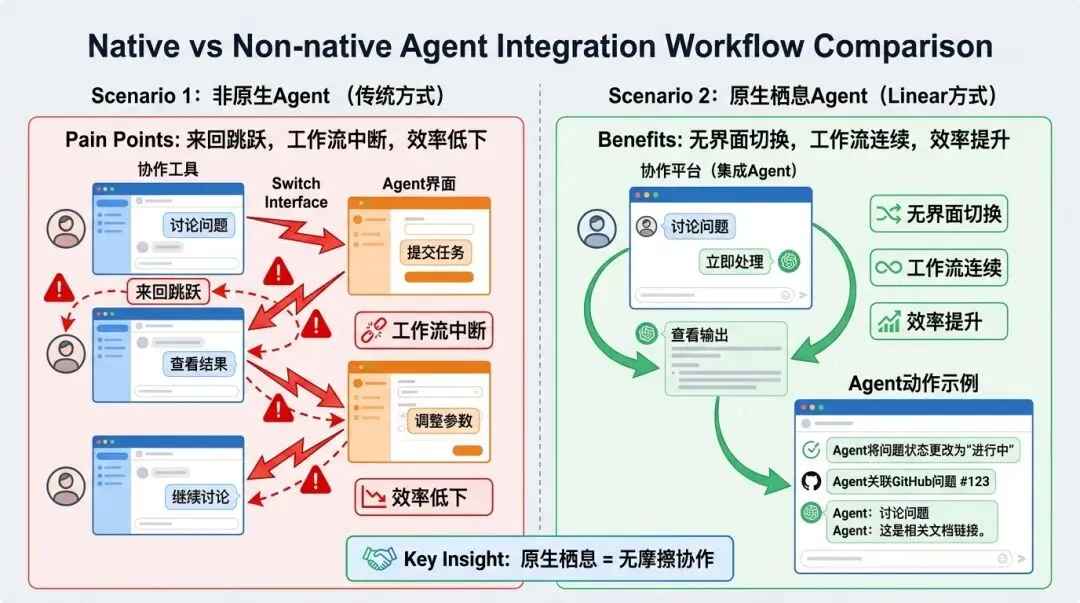

2. 黄金法则二:智能体应该在平台原生栖息

🔴 问题:Agent游离于工作流之外

许多Agent设计存在致命缺陷:需要切换到专用界面才能使用。

用户体验:

-

• 在团队协作工具中讨论问题 -

• 切换到Agent专用界面提交任务 -

• 再切换回协作工具查看结果 -

• 再切换到Agent界面调整参数…

这种”来回跳跃”的工作流摧毁了效率。

🟢 解决方案:Agent融入平台,使用现有UI

默认情况下,智能体应该能通过现有UI模式和平台的标准操作来工作。

💡 设计实践

Linear的智能体可以:

-

• 使用相同的人类操作(如更改问题状态、链接GitHub issue) -

• 在相同的活动流中显示行动 -

• 在相同的界面中与人类交互

关键设计要素:

-

• ✅ 不创造新的交互范式 -

• ✅ 使用用户已熟悉的操作 -

• ✅ 在现有工作流中自然融入

🎯 核心价值

原生栖息 = 无摩擦协作。

当智能体”像人类用户一样工作”时:

-

• 学习成本为零(用户无需新技能) -

• 工作流不中断(无需切换界面) -

• 协作自然流畅(Agent和人类在同一平台)

第二个黄金法则:让Agent”像人类一样”使用平台。

3. 黄金法则三:智能体应该提供即时反馈

🔴 问题:沉默制造焦虑

你向智能体发送请求:”请检查这个bug”。

然后——什么都没有发生。

没有响应,没有提示,没有反馈。

你的大脑开始焦虑循环:

-

• “它收到我的请求了吗?” -

• “它在处理吗?还是卡住了?” -

• “我需要等多久?” -

• “我应该再发一次吗?”

沉默导致不确定性,不确定性摧毁用户体验。

🟢 解决方案:立即响应,但不过度打扰

智能体被调用时,应该提供即时但不过度打扰的反馈,让用户确信请求已接收。

💡 设计实践

Linear的编码智能体收到请求后:

-

• 立即回复:”正在思考”(Thinking)指示器 -

• 视觉反馈:状态图标显示”处理中” -

• 不过度打扰:简洁指示,不抢占注意力

关键设计要素:

-

• ✅ 立即响应(收到请求即刻反馈) -

• ✅ 状态指示(明确显示”正在处理”) -

• ✅ 简洁设计(不过度打扰用户)

🎯 核心价值

即时反馈 = 心理安全感。

当智能体立即响应时:

-

• 用户确信请求已接收 -

• 用户知道智能体在工作 -

• 用户可以安心等待结果

第三个黄金法则:永远不要让用户在沉默中焦虑。

4. 黄金法则四:智能体应该清晰透明地展示内部状态

🔴 问题:黑盒操作导致信任缺失

智能体开始工作,你看到”正在处理”…

然后——你看不到任何细节。

它做了什么?调用哪些工具?做了哪些决策?为什么这样做?

如果智能体是个”黑盒”,用户只能:

-

• 猜测它的行为逻辑 -

• 拼命猜测它是否出错 -

• 无从判断结果质量

看不见内部状态 = 无法信任结果。

🟢 解决方案:完全透明,可检查推理过程

智能体应该清晰地指示:正在思考、等待输入、执行工作还是完成。

人类应该能一眼理解正在发生什么,并在需要时检查底层推理、工具调用、提示和决策逻辑。

💡 设计实践

Linear的”智能体会话”(Agent Session)显示:

-

• 每一步思考过程:推理逻辑完整展示 -

• 工具调用详情:调用了什么工具、参数是什么 -

• 决策透明:为什么做出这个决定 -

• 时间戳:每个步骤何时发生

关键设计要素:

-

• ✅ 状态清晰(思考/等待/执行/完成) -

• ✅ 推理可见(思考过程可检查) -

• ✅ 工具透明(调用记录完整) -

• ✅ 决策可查(为什么这样决策)

🎯 核心价值

状态透明 = 可审查协作。

当智能体内部状态完全透明时:

-

• 用户理解智能体的工作过程 -

• 用户能审查推理是否合理 -

• 用户能发现问题并修正 -

• 用户真正信任结果质量

第四个黄金法则:永远不要让智能体成为”黑盒”。

5. 黄金法则五:智能体应该尊重脱离请求

🔴 问题:智能体”粘着”不放

你发现智能体走错了方向,发消息:”停下来,别继续了”。

智能体却无视你的请求,继续执行错误操作。

这种”粘着不放”的行为:

-

• 加速错误传播(继续执行错误任务) -

• 消耗资源(浪费Token和时间) -

• 激怒用户(感觉失控)

智能体不尊重人类指令 = 协作灾难。

🟢 解决方案:立即后退,等待重新启动信号

当请求脱离时,智能体应该立即后退,只有在收到明确信号时才重新介入。

💡 设计实践

Linear的智能体:

-

• 收到”停止”指令 → 立即停止当前操作 -

• 清除当前状态 → 不保留错误上下文 -

• 等待新指令 → 只有收到”继续”才重新启动

关键设计要素:

-

• ✅ 立即响应停止请求 -

• ✅ 清除当前状态 -

• ✅ 等待明确重启信号

🎯 核心价值

尊重脱离 = 人类控制权。

当智能体尊重脱离请求时:

-

• 人类保持对协作的控制 -

• 错误能及时停止 -

• 资源不被浪费 -

• 用户信任得以维护

第五个黄金法则:智能体必须服从人类的”停止”命令。

6. 关键认知:智能体不能被问责

🔴 误区:让智能体承担责任

有些团队犯致命错误:让智能体完全负责某个任务。

例如:

-

• 智能体完全自主修复bug -

• 智能体独立提交代码 -

• 智能体全权处理问题

这导致灾难:

-

• 智能体出错无人审查 -

• 责任归属模糊不清 -

• 质量无法保证

🟢 正确做法:明确的委托模型

人类和智能体之间应该有清晰的委托模型。

智能体可以执行任务,但最终责任应该始终由人类承担。

💡 设计实践

Linear的委托流程:

-

• 问题委托给智能体 → 明确标识委托关系 -

• 智能体执行任务 → 显示处理过程 -

• 人类审查结果 → 最终责任在人 -

• UI明确显示:“智能体处理,人类负责”

关键设计要素:

-

• ✅ 委托关系清晰可见 -

• ✅ 责任归属明确(人在顶端) -

• ✅ 人类审查是必须步骤

🎯 核心价值

权责分明 = 可靠协作。

当责任明确归属人类时:

-

• 智能体是工具,不是替代品 -

• 人类审查是必须环节 -

• 质量由人类把关 -

• 协作安全可靠

终极认知:智能体执行,人类负责。

总结:5个黄金法则一览

|

|

|

|

|

|---|---|---|---|

| 法则一 |

|

|

|

| 法则二 |

|

|

|

| 法则三 |

|

|

|

| 法则四 |

|

|

|

| 法则五 |

|

|

|

💡 终极认知

智能体不能被问责——责任永远在人类。

这意味着:

-

• ✅ 智能体是工具,不是替代品 -

• ✅ 人类审查是必须环节 -

• ✅ 委托关系必须清晰 -

• ✅ 质量由人类把关

🚀 核心价值提炼

AIG的本质:

❝ 这份指南不是技术规范,而是人机交互设计宣言——一套让AI智能体自然融入人类工作流的基础原则。 ❞

成功关键:

-

1. 透明性:身份透明 + 状态透明 = 信任基础 -

2. 原生性:融入平台 + 使用现有UI = 无摩擦协作 -

3. 响应性:即时反馈 + 尊重指令 = 用户体验 -

4. 权责性:智能体执行 + 人类负责 = 可靠协作

应用场景:

-

• 团队协作工具(Linear、Slack、Notion) -

• 编程智能体(Claude Code、Cursor、Devin) -

• 工作流自动化(GitHub Actions、CI/CD) -

• 客户服务(智能客服系统)

🎯 实施建议

如果你正在构建AI智能体:

-

1. 审视身份标识:用户能一眼识别这是智能体吗? -

2. 检查原生性:智能体需要切换界面才能用吗?(如果是,修复!) -

3. 验证反馈机制:发送请求后有即时响应吗? -

4. 测试状态透明:用户能看到推理过程吗? -

5. 确认控制权:智能体尊重”停止”指令吗?

5个法则,5个检查点——确保你的智能体真正有用。

原文来源

-

• 原文标题: Agent Interaction Guidelines (AIG) -

• 发布方: Linear -

• 原文链接: https://linear.app/developers/aig -

• 文档性质: 演进性文档(持续更新)

夜雨聆风

夜雨聆风