当前时间: 2026-05-07 10:11:33

更新时间: 2026-05-07

分类:软件教程

评论(0)

这对AI路上的对手,同时给AI上了保护锁

2026年春天,地球两端的AI大国,在彼此激烈的竞争中,却同时都给智能体按下了暂停键。

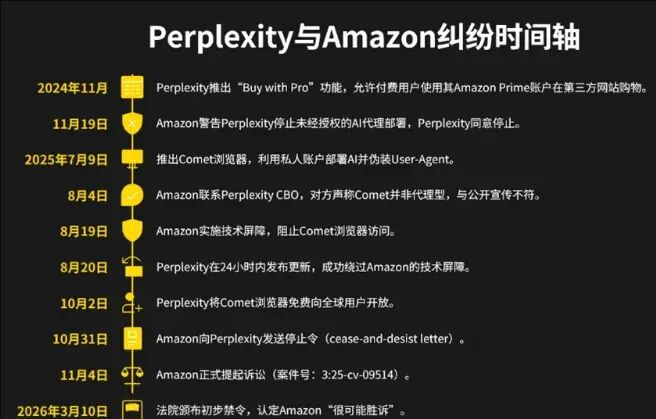

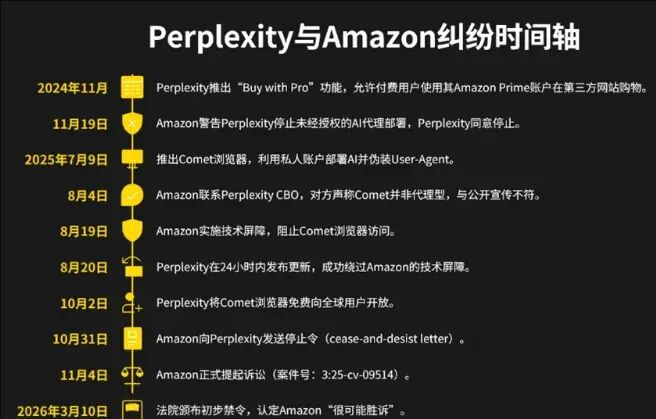

先是美国:3月9日,亚马逊诉Perplexity案有了结果,下达初步禁令,禁止Perplexity通过AI智能体访问亚马逊受保护的系统。

然后是我国,4月30日,我国首例AI智能体新型不正当竞争纠纷案也有了结果,涉事的科技公司被要求立即停止开发、运营针对第三方平台的智能体程序。

相信明眼人已经看出来了,除了时间上的接近,隔着一个地球的两个案子的焦点也一样,都是今年AI发展的主要方向:智能体。

但实际上,这两起案件连焦点的核心都一样:智能体的“双重授权”。

是什么,让这对对手放下竞争,同时选择对智能体出手?谜底就在谜面上。

现在很多人一说智能体,都会先提到它的功能:能写文档、能做PPT、能爬数据、能写程序、能点奶茶……

但是这些说法,都忽略了智能体真正的用处:替代用户操作软件。

智能体是在替人类操作PowerPoint做PPT、是在替人类操作word写文档,是在替用户操作各类软件执行各类操作。

这就出现了一个问题:在智能体运行的过程中,除了智能体本身,还涉及到了另外两个有独立权利主张的主体:用户和被操作软件。

有用户不愿意被AI替代,因为AI的替代不仅体现在操作环节,还有决策;

有软件不愿意被AI操作,因为AI的操作不仅是“用”,还有入口的掠夺。

这部分的独立权利主张,无论是从法律还是生态角度来看,都不应该被简化成一句轻飘飘的“大势所趋”。

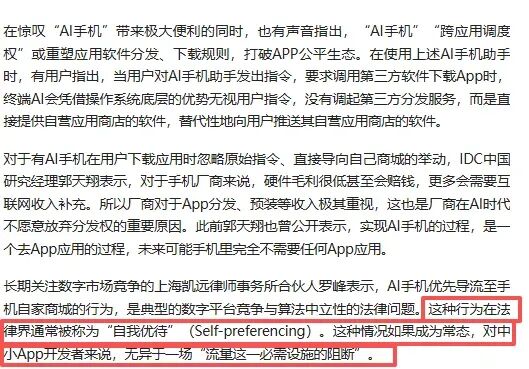

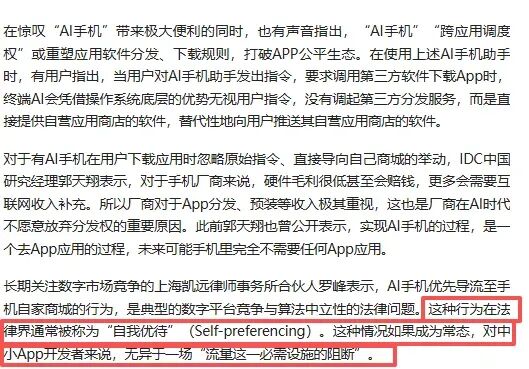

有用户发现,当自己让手机的AI智能体,从手机里已经安装的第三方商店里下载某App时,AI智能体却从手机自带商城里进行了下载。

从结果来看,智能体很好地完成了用户的目的:下载软件。

但从过程来看,却是对用户和某App的充满恶意的“坑”。

一是用户的决策权直接被替换了。我们不妨想一下用户为啥要从第三方软件里下载?

因为不少软件,在自有渠道更新更及时、功能更完善。甚至一些软件,如果从手机商店里下载,会默认进入渠道服,体验直接大打折扣。

移动互联网发展至今,生态是博弈后的结果,是目前对大家都算比较好的一个场面。手机自带商城是会和软件抽成的,抽成很高,对于中小厂商来说足以失去利润。但软件厂商博弈出了一个口子,那就是自有渠道或者第三方渠道。

但现在,AI智能体试图去掉第三方渠道,同时在操作过程中也剥夺了用户对App的感知。

这也是去年AI手机大行其道的时候,软件厂商却纷纷下场抵制的原因:不是逆AI,而是逆AI厂商的入口争夺。

但真正离谱的,还不是对生态的破坏导致的利益分配畸形,而是权责混乱。

前段时间用户里流传一句玩笑话:AI都能替我点奶茶了,怎么花的还是我的钱?

看似玩笑,却揭示了一个残酷的现实:AI不能替用户负关键的责任。

在AI智能体替你操作软件的过程里,有一个长期被刻意忽视的问题,那就是“如果智能体操作失误,导致了损失,谁来负责?”

然而这只是有原因的一厢情愿罢了。虽然移动互联网建立的生态,的确有给用户兜底的习惯。但这一习惯,被智能体给模糊了。

比如你用大厂的支付软件,误操作、遭遇诈骗后产生损失后,这些支付软件会给你止损甚至赔偿。但前提是只有你有权操作支付软件。密码、人脸、指纹等验证都是为了这一目的。

第三方软件不承认AI的主体性,毕竟AI自己也不承认,它只是替你办事,且默认得到了你的“委托”。这也是AI智能体还有一个名字“AI代理”的原因。

更别提智能体厂商普遍存在一个问题:刻意模糊权利边界。尤其是GUI路线的智能体,通过修改手机或电脑底层权限,实现持续读屏和模拟用户操作,让软件都无法鉴别这到底是AI在操作、还是用户在操作。

当初想尽办法花钱安装OpenClaw的用户,又去花钱去卸载。

原因就是替用户决策的智能体,是无可避免地会碰上导致用户损失的事情。只不过,龙虾本身是开源框架,默认用户都“有点技术”,也“有点意识”。用户只能怪自己莽撞。

但现在的问题是,大把和OpenClaw路线接近的智能体被默认装在了用户手机里,对用户的风险提醒不过是几行小字,用户一个误操作就能长期持续开启智能体在后台的持续运行。

前段时间AI出租车的例子就已经很残酷了,一个小小的bug,就因为对人类主体的替代以及当前AI本身的缺陷,直接导致了一场交通瘫痪。

手机上的智能体也是如此,如果明天AI写的系统更新包里有一个智能体的bug,推送给用户后,大批量用户手机自动拨打电话、发送短信,造成的损失远比交通瘫痪大。

那么你看,实际上,智能体的权责模糊虽然在前两年加速了AI的发展,但现在,已经是阻碍了。

用户不蠢,虽然习惯于权利换便利,但实打实的吃亏是会让大面积的用户拿脚投票的。

而解决这一问题的关键,就是这段时间实践中的双重授权的明确。

实际上,前两年就有专业人士注意到了AI智能体的权责模糊,甚至推动了规则的明确:我国软件行业协会2025年4月3日发布实施的团体标准《移动互联网服务可访问性安全要求》、广东省标准化协会2025年6月13日发布实施的团体标准《智能体任务执行安全要求》,都明确了智能体执行任务时要做到“双重授权”。

双重授权,意味着要先在明显的地方,对用户做出风险提示后获得用户授权,再和软件厂商沟通,获得软件厂商的授权。

授权看似只是“同意”,但同意背后的内容很重要。一是用户有了知情权,二是AI厂商和软件厂商的沟通博弈过程中,会加速新生态的建立。

比如现在A2A模式、MCP模式,就都是新生态的雏形,至少在这类生态中,因为流程清晰了,责任主体又被压回到了AI厂商和软件厂商,出问题不用倒霉的用户自行承担。

以前是立规矩,今年春天,地球两端的两起判决,看似不过是两个小事,看似是给AI按下暂停键,但实际上却是足以影响AI行业未来的定性级别的实践,同时也是为AI之后的发展加速扫清因模糊导致的壁垒。

AI合规元年在大众感知不强的地方,的的确确到来了。