清华大学:龙虾(OpenClaw)管理学

AI科普馆部分垂类内容转移至👆

【长三角人工智能联盟】公众号,快点进去瞧瞧!

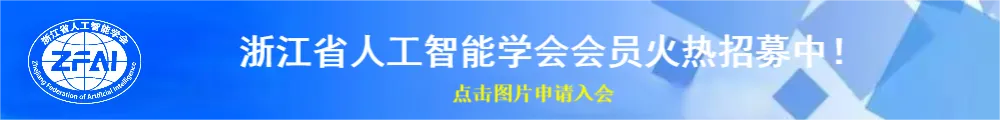

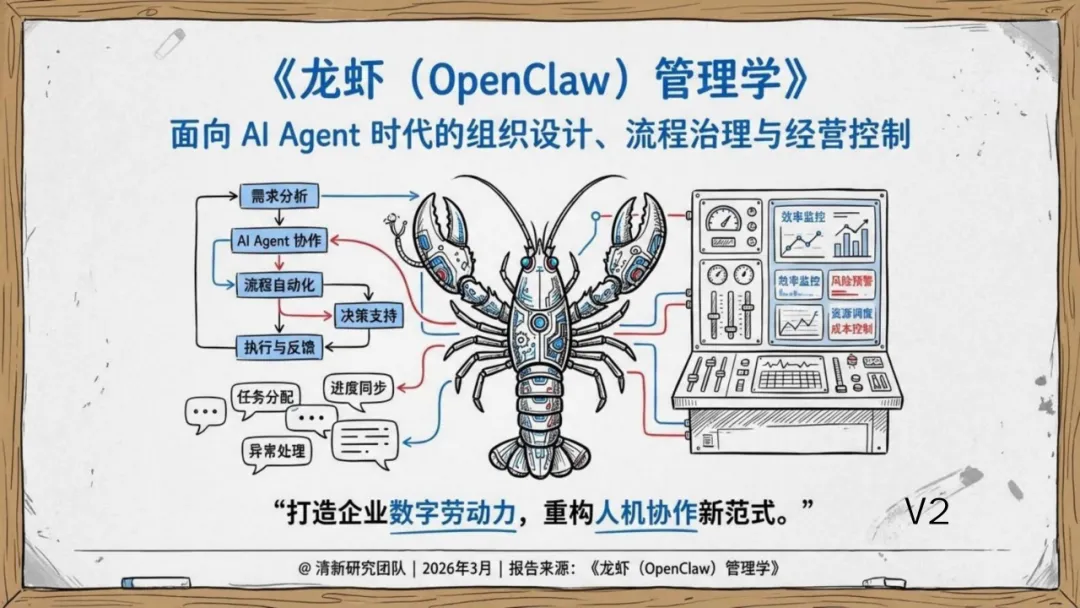

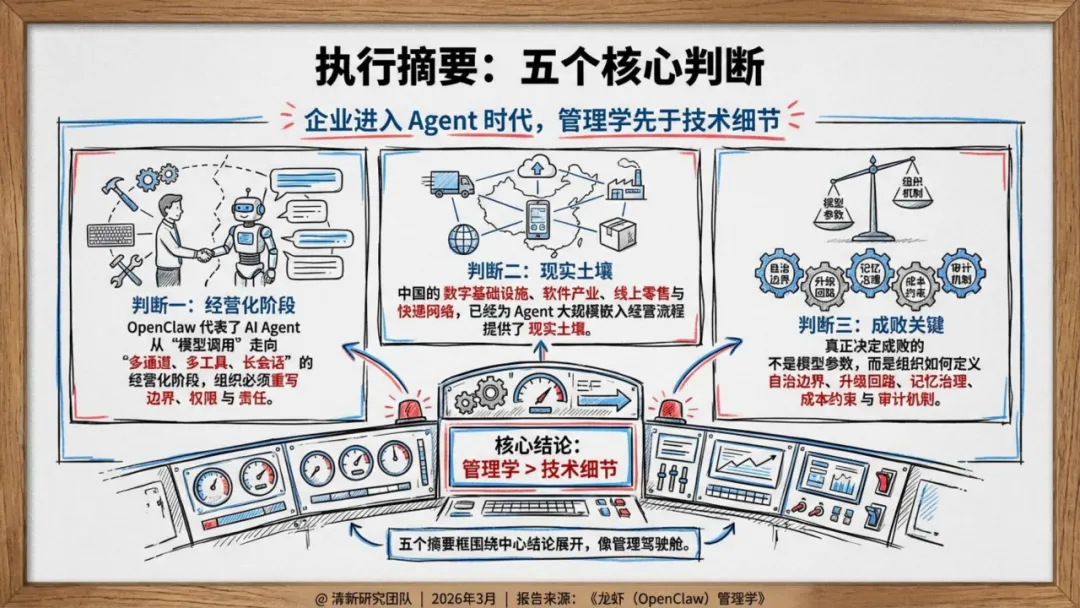

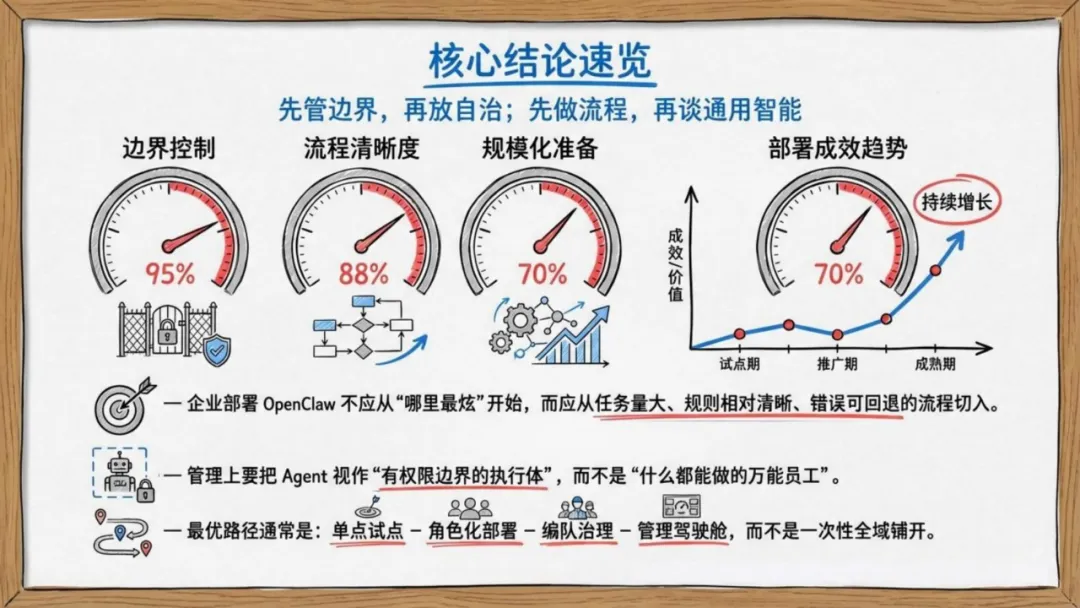

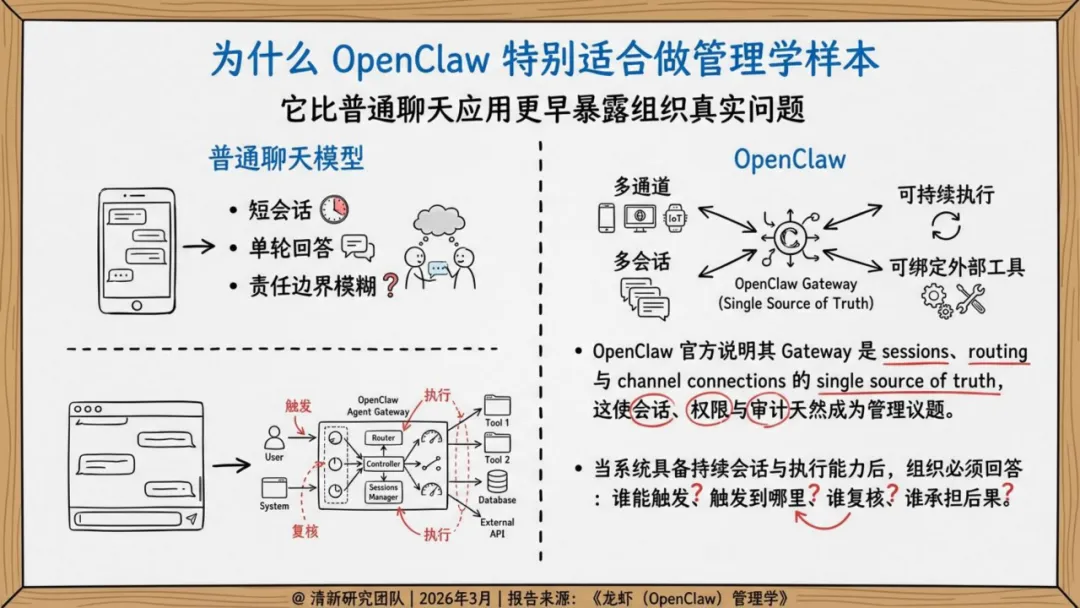

2025年以来,生成式AI的浪潮已经从“聊天”走向“行动”。在这一转折点上,清华大学沈阳教授团队发布的《龙虾(OpenClaw)管理学》报告,提出了一套面向AI Agent时代的组织设计、流程治理与经营控制框架。报告以OpenClaw为管理样本,试图回答一个根本性问题:当AI从会聊天的模型,变成能跨频道、跨工具、跨会话持续工作的Agent系统时,企业该如何管理这支“数字劳动力编队”?

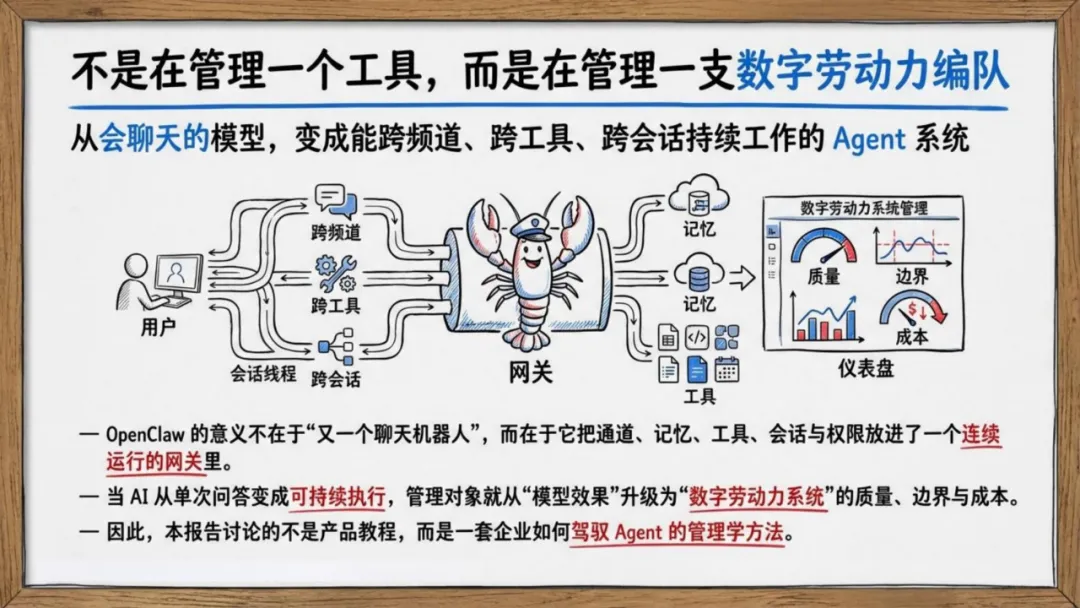

本文将从五个维度解读这份报告的核心思想:为什么是OpenClaw、管理学被重写的地方、八层治理模型、组织落地场景,以及风险与制度化路径。

一、为什么是OpenClaw?——一个管理学样本的诞生

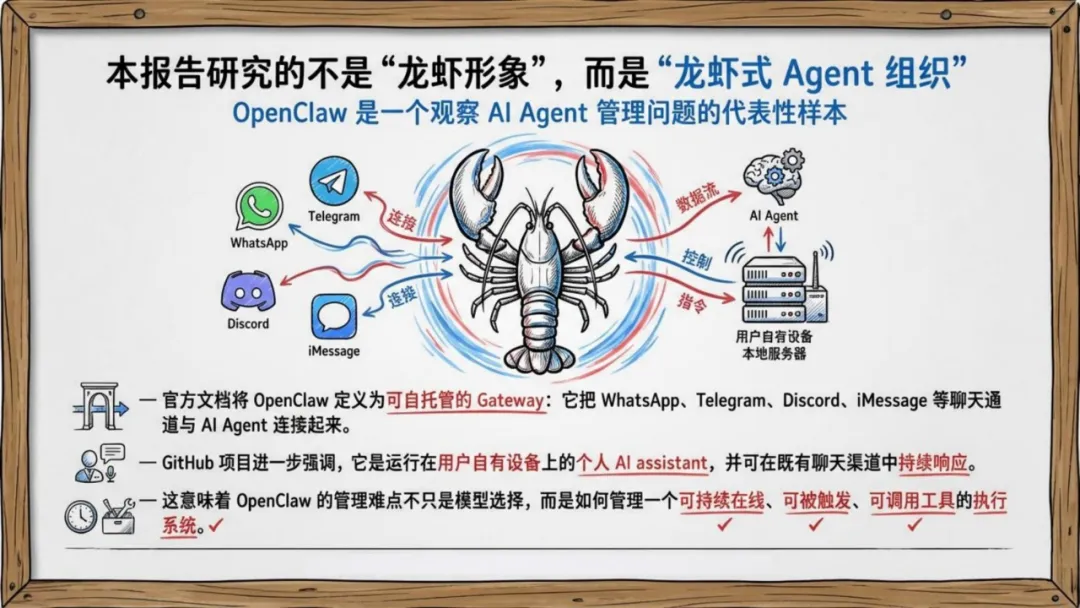

OpenClaw并非普通的聊天机器人,而是一个多通道、多工具、长会话的Agent网关。它能够统一管理会话、路由、工具调用与权限,具备持续执行能力。报告指出,OpenClaw的意义在于:它让AI从“单次问答”升级为“可持续执行”,从而将管理对象从“模型效果”升级为“数字劳动力系统”的质量、边界与成本。

正因如此,OpenClaw比普通聊天应用更早暴露组织真实问题:谁能触发?触发到哪里?谁复核?谁承担后果? 这些问题不再是技术问题,而是管理学的核心命题。

二、管理学被重写的地方:五个关键转变

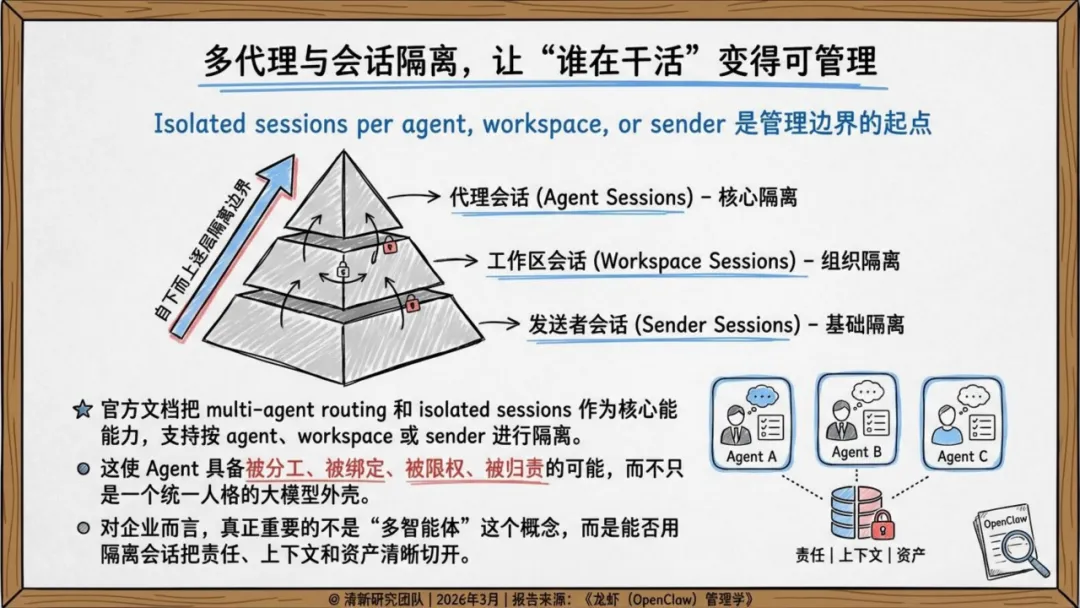

报告明确指出,Agent时代的到来,正在重写传统管理学的多个底层假设。

1. 从“软件使用”到“数字劳动力管理”

传统软件治理关注“谁能看、谁能改”,而Agent治理必须同时关注“谁能触发、触发后会做什么、出了错谁来兜底”。这意味着权限矩阵必须从静态的数据访问,扩展到动态的任务执行。

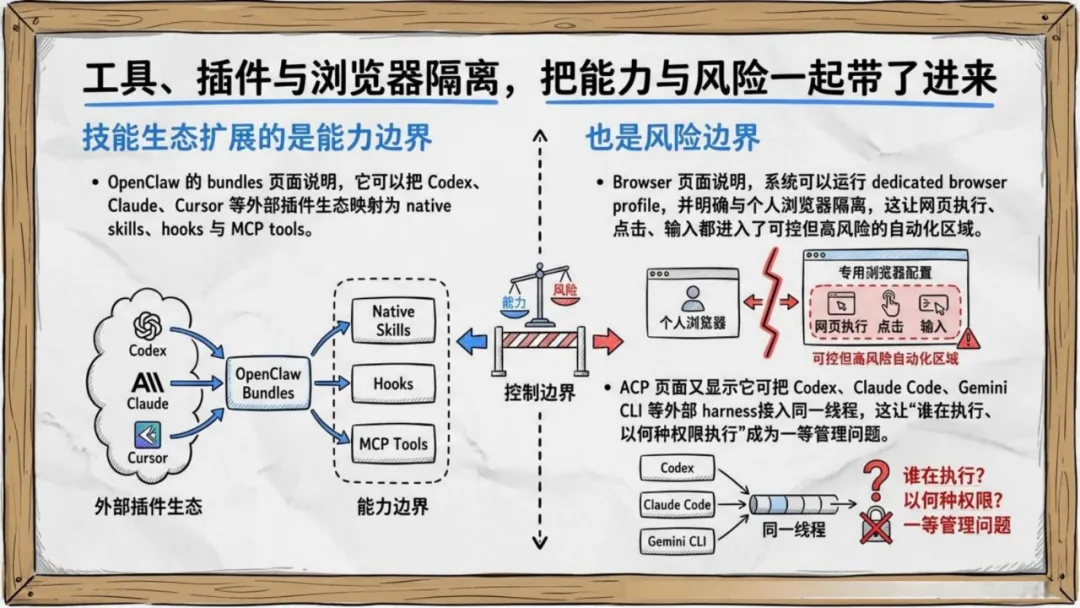

2. 没有边界的自治,就是高效率的失控

OpenClaw的价值在于跨频道、跨工具、跨会话连续工作,但这也放大了误触发、误执行与越权操作的代价。报告提出一个关键原则:先做“壳”,再放“爪”——先建立边界、权限、审计与升级制度,再开放自治能力。

3. 记忆不是越多越好,而是越旧越危险

长会话与长期记忆提升了连续性,但也会积累偏差与过期知识。报告强调:记忆必须可回收、可更新、可过期,否则会成为系统性风险的温床。

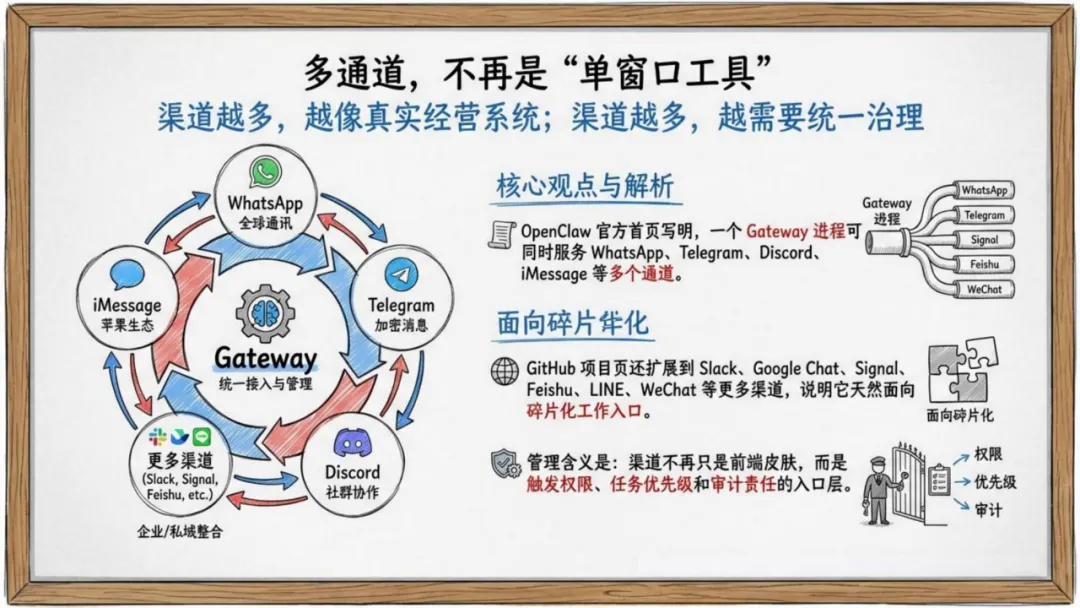

4. 渠道不是皮肤层,而是治理层

相同任务在群聊、私聊、企业IM、客服入口中的可信度与容错阈值完全不同。报告主张:高风险任务走高可信通道,低风险任务走高频低摩擦通道,渠道应被纳入治理分层。

5. 评价Agent不能只看“答得像不像”

管理层真正需要的不是“它看起来很聪明”,而是“它能否稳定交付、是否值得规模化”。因此,评价体系必须转向成功率、返工率、接管率与单任务成本等经营指标。

三、八层治理模型:把技术决策变成管理语言

报告的核心贡献之一是提出了Agent治理八层模型,将零散的技术决策转化为业务、法务、IT与管理层都能理解的语言:

-

战略层:先定义Agent是增长工具、效率工具还是控制工具。

-

通道层:不同入口必须有不同治理等级,能力随渠道分层。

-

流程层:Agent只应接入“可交接、可回退、可审计”的流程。

-

记忆层:记忆必须可治理、可过期、可追溯。

-

权限层:不以“模型聪明”授予权限,只以“任务可控”授予权限。

-

监督层:建立人工接管、异常升级与审计机制。

-

资产层:Prompt、Skill、Memory、Workflow都是企业资产,应版本化、角色化。

-

指标层:最终回到时间、质量、风险、成本与复用率五类经营语言。

这一模型的意义在于:它不是技术架构图,而是一张管理控制台,让企业可以在不深入模型细节的前提下,做出可执行的治理决策。

四、组织落地:从CEO办公室到现场管理

报告没有停留在抽象框架,而是给出了具体的场景切入路径。

场景一:CEO/创始人办公室的“议程与情报中枢”

高管最痛苦的并非复杂任务,而是大量碎片信息。OpenClaw在这里应做议程汇总、资料归并、跟催提醒与线程归档,而不是代替判断。这是一个风险低、价值显性的试点入口。

场景二:运营团队的“工单流转器”

运营工作充满跨表、跨群、跨角色的信息搬运。OpenClaw可以承担第一轮分流、标准回复、状态追踪与结果回写,前提是把流程节点和升级规则写清楚。

场景三:客服团队的“前置过滤器”

高质量做法不是全自动结案,而是让Agent完成意图识别、资料收集、知识匹配与工单预填。对于退款、赔付、投诉升级等高风险事务,Agent应作为前置过滤器,而不是终局裁判者。

场景四:研究与投研团队的“线程化资料台”

价值不在于一次性写长文,而在于持续追踪、归档与追问,形成可复用的知识线程。

场景六:从办公室走向现场管理

政策已将工业智能体写入行动文件,但现场更需要分层治理,Agent应在结构化区间内运行。

五、风险、合规与制度化:给龙虾装上壳

报告用一整章讨论风险与合规,强调:越接近真实业务,越要把边界、留痕、授权与数据规则制度化。

-

《数据安全法》要求数据处理与安全并重,Agent流程必须先做数据分类与访问边界设计。

-

最小必要原则应被写进Agent的默认行为。

-

《生成式人工智能服务管理暂行办法》要求服务稳定、可处置、可投诉,企业内部Agent也必须建立停止生成、人工接管与异常升级机制。

报告还提出了三个原创概念:

-

壳内自治:清晰边界 + 最小权限 + 可审计执行。只有先把壳做厚,组织才敢把爪放开。

-

责任回路:Agent可以是执行体,但不能成为责任主体。责任必须回到流程拥有者与业务owner。

-

出海换壳:渠道、模型、外部工具会变,但治理外壳必须保持连续。真正该被沉淀的是身份、权限、日志、升级与知识分类。

结语:龙虾不是玩具,而是组织的下一代接口

《龙虾(OpenClaw)管理学》报告给出的核心判断是:真正决定成败的不是模型参数,而是组织如何定义自治边界、升级回路、记忆治理、成本约束与审计机制。

在AI Agent时代,组织不再只管理人和系统,还要管理持续在线、可被触发、可调用工具的数字执行体。谁先把这些管理问题制度化,谁就更有可能把Agent从演示桌带进真实业务。

这不是一份产品教程,而是一套企业如何驾驭Agent的管理学方法。 对于任何正在或即将引入AI Agent的组织,这份报告提供了一个不可多得的起点。

以下是内容节选↓↓↓ 文末点击链接免费下载pdf,扫二维码加入交流群

AI科普馆:打开AI世界之窗

夜雨聆风

夜雨聆风