16个AI素养量表怎么选?研究者和学校的避坑指南

在填写一个性格测试量表时,遇到“我是一个容易交到新朋友的人”这样的题时,我总是不知道该填“基本同意”,“比较同意”还是“非常同意”。

关于AI素养的测试往往也是如此。

把真假难辨的AI生成的图片混在同类型的真实图片里,你可能分不出来——但你填写量表时候很有可能会地说自己能分出来。

测一个人 AI 素养的工具,目前绝大多数靠的也是自我评分:你说你懂,那就是你懂。

捷克学者 Tomáš Lintner 于2024年在 npj Science of Learning 发了一篇系统综述,把 2021 年以来出现的 16 个 AI 素养量表搬上检验台,用医学测量学最严的 COSMIN 标准逐项打分。结果是:没有一个量表可以在全部维度上拿到证据。

学校要开 AI 素养课、研究者要在论文里报告学生的 AI 素养水平、教师要找评估工具——这篇综述基本告诉你:每一个量表都有坑,问题只是哪个坑你能接受。

一、这个问题为什么现在变尖锐

短短三年里,AI 素养从一个新词变成了课程内容。中小学到大学都在加,韩国、欧洲多国甚至已经把它写进国家课程标准。研究者也在拿这个概念发文章,从信息技术教育到医学教育、教师教育都有。

可问题是:你怎么知道一个学生学完了之后“具备 AI 素养”?

直觉答案是用一个测评工具量一下,前后比较。但工具从哪儿来?

Lintner 把 Scopus 和 arXiv 上能找到的全部 5574 篇文献筛了一遍,最后剩下 22 项研究、16 个量表。最早的那个(MAIRS-MS)出生于 2021 年。

也就是说,整个领域的测量工具都还在襁褓期——最老的一个量表也才三岁,而它正在被全球的研究者和学校大量使用。

这是 Lintner 这篇综述真正的价值:它不是介绍量表,而是给这个还没站稳的领域,做了第一次外部体检。

体检的标尺叫 COSMIN(健康测量工具选择的国际共识标准),原本用于医学,后来扩展到心理学和教育学。

它把一个测量工具的质量拆成八个维度:内容效度、结构效度、内部一致性、跨文化效度、信度、测量误差、构念效度、反应度。再用 GRADE 把每个维度的证据强度分级。

按 COSMIN 的逻辑,最重要的维度是内容效度——你测的真的是 AI 素养,而不是别的什么吗?这个维度,恰恰也是现有量表最薄弱的地方。

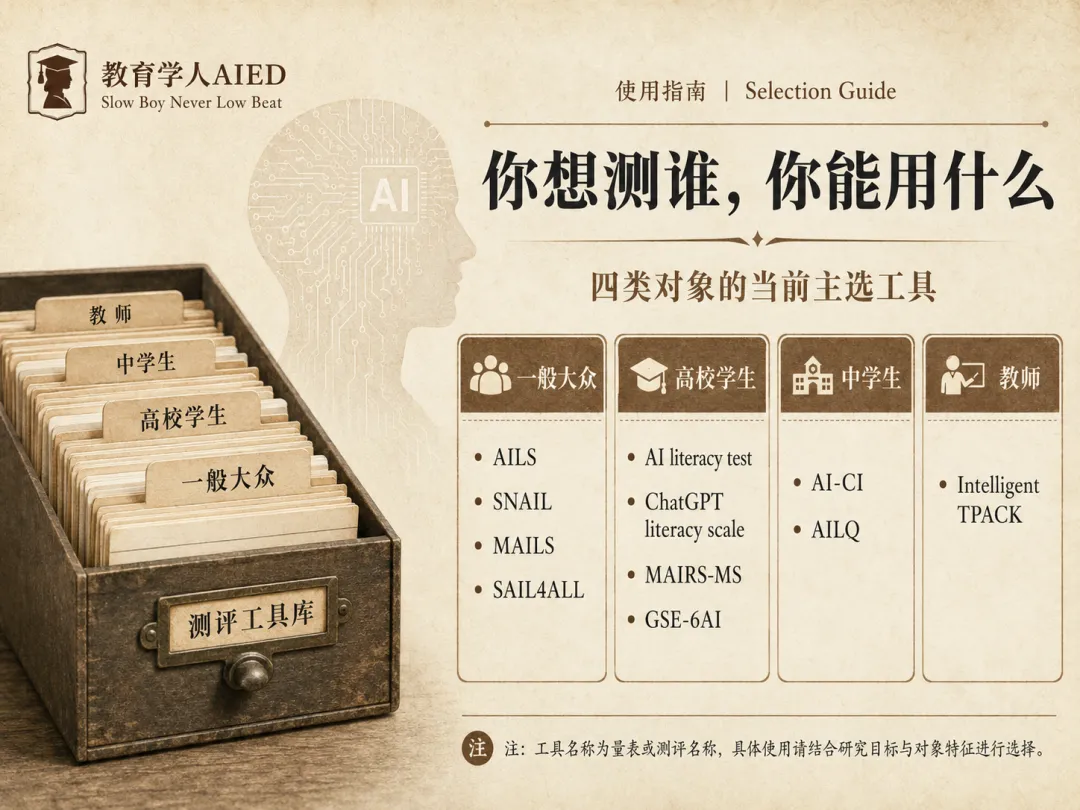

二、你想测谁,你能用什么

Lintner 最实操的贡献,是按目标人群把现有量表分了组,并对每组哪些证据最强、哪些短板未补做了排序。

(一)一般大众

最稳的是 AILS(AI Literacy Scale),Wang 等人 2022 年发表,从结构效度、内部一致性到构念效度都有较强证据,还在土耳其语境做过两次再验证(虽然没做正式的跨文化效度比较)。共 12 道 7 点 Likert 题,分四个因子:意识、使用、评估、伦理。

SNAIL 紧随其后,德国团队 Laupichler 等人开发,基于一项扎实的 Delphi 专家研究,目前是唯一公开了原始数据的量表(这点很重要,后面会说为什么)。被三次再验证过——土耳其语、德语,以及用作课程学习增益评估。短板是没在目标人群上做内容效度,且有“地板效应”:一半题目里有超过 15% 的人选了最低分,说明最低端的能力没被这把尺子真正覆盖到。

MAILS(Meta AI Literacy Scale)也很有潜力,8 因子模块化,可以单独测“AI 自我效能”“AI 自我感知”等子构念,而且基本没有地板/天花板效应。但同样,目标人群内容效度未做。

SAIL4ALL 是目前唯一面向一般大众的表现性量表(其他都是自评式 Likert),但其中“AI 能做什么”分量表的结构效度和内部一致性有些问题,使用前要谨慎。

(二)高校学生

证据最强的两个:AI literacy test(Hornberger 等,2023)和 ChatGPT literacy scale(Lee & Park,2024)。前者是目前唯一面向高校生的表现性测验,30 道多选题加 1 道排序题,内容覆盖从“识别 AI 在日常生活中的应用”到“区分监督学习与无监督学习”——基础常识到专业知识都有。

医学生有专门工具:MAIRS-MS(土耳其语原版,有波斯语再验证)、GSE-6AI(简版,只有 6 题,适合快速筛查)、SNAIL(也在医学生群体做过验证)。如果你研究医学教育中的 AI 素养,这三个是当前的主选。

(三)中学生

AI-CI(AI Concept Inventory)(Zhang 等,2024)是唯一面向中学生的表现性概念测验,基于一套配套的 AI 课程开发,有内容效度和反应度证据,适合用于课程评估前后测。

AILQ(吴子杰等,2023)采用 ABCE 框架——情感、行为、认知、伦理——四个学习维度,覆盖更广,但是自评式。

Kim & Lee 量表目前只有韩文版,中国研究者用不上。

(四)教师

只有一个选择:Intelligent TPACK(Celik,2023),在传统 TPACK 框架上加了 AI 伦理维度,测教师在教学中整合 AI 工具的自评水平。结构效度和内部一致性都过关,但内容效度没在教师群体上做。

如果你做的是教师 AI 素养相关研究,这是当前唯一选项,但用之前最好自己再补一轮认知访谈或专家审议,把量表对中国教师场景的适配性核一下。

三、共识背后共同的坑在哪

把 16 个量表的因子结构横向对照,会出现一个有意思的画面。

几乎所有量表都同意三件事属于 AI 素养核心——

-

技术理解(知道 AI 是什么、怎么工作)

-

社会影响(AI 对社会、就业、信息环境的影响)

-

AI 伦理(偏见、隐私、问责)。

从中学生量表到一般大众量表再到医学生量表,这三项都不缺席。

但是,另外两件可能更要命的事,16 个量表分裂了:

创造 AI 算不算 AI 素养?Ng 等人最早提出 AI 素养概念时,把“创造 AI”列为四大维度之一。但 MAILS 的 CFA 跑出来发现,“创造 AI”和其他维度并不属于同一个潜在因子——它是个相关但独立的构念。也就是说,你“懂 AI”和你“会做 AI”,在心理统计学上是两回事。AILQ 则坚持把“创造”当作 AI 素养核心维度,理由是中学生也应该具备改造 AI 的初步能力。

批判性评估 AI 算不算核心?多数量表把它当作核心子维度,但实际题目落到操作层面后非常稀薄——大多数自评题问的是“我能否判断 AI 输出是否正确”,而不是真的让你判断一段 AI 生成内容。换句话说,所谓的批判性评估,大多停留在“我觉得我能”这一层。

这两个分歧不是技术细节,而是关系到一个根本判断:AI 素养究竟是教人怎么“用好”AI,还是教人怎么“驾驭”甚至“重塑”AI?

-

如果三大共识就是答案的全部,那 AI 素养就是一种适应能力——让人在 AI 浸入的环境中不被动挨打。

-

如果两大分歧的天平倒向“是核心”,那 AI 素养就变成一种主体性能力——让人对技术的轨迹保持主动并塑造AI的未来。

目前这 16 个量表的总体倾向,是前一种。

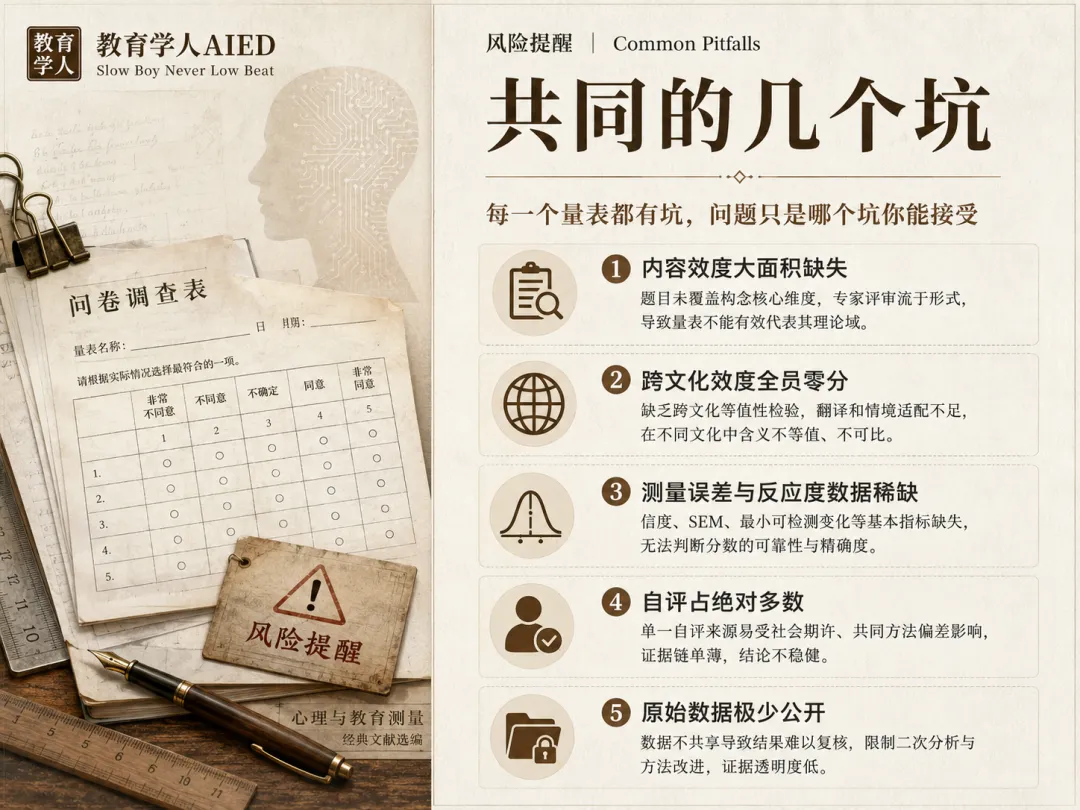

跳出“哪个量表更好”这个问题,Lintner 的体检报告其实指出了整个领域几条系统性短板,任何要使用这些量表的研究者和学校都要心里有数。

(一)内容效度大面积缺失。16 个量表里,真正在目标人群上做过内容效度验证的不超过 5 个。COSMIN 把内容效度列为最重要的测量学性质——它回答的就是“你这把尺子量的是不是你说要量的东西”。一个没在中学生身上做过内容效度的中学生量表,你拿来做研究,本质上是在赌它问的问题对中学生有意义。

(二)跨文化效度全员零分。16 个量表,没有一个做过严格的跨文化效度检验。AILS 有土耳其语再验证,SNAIL 有德语和土耳其语再验证,MAIRS-MS 有波斯语再验证——但再验证不等于跨文化等值检验:前者只是在新语境里重跑结构效度,后者要做多组测量不变性分析。

这意味着,一个中国研究者用 AILS 中文翻译版测出来的“AI 素养”,跟英文原版测出来的可能不是同一个东西。这是一个被严重低估的问题,尤其对中国语境的研究者。

(三)测量误差和反应度数据稀缺。大多数量表没报告最小可检测变化(SDC)——前后测的差异要多大才算“真的变了”,你不知道。课程评估、干预研究用这些量表测前后变化时,这个空白会让结论站不住。

(四)自评占绝对多数。16 个量表里 13 个是自评。前面说过,人在 AI 相关能力上自评并不可靠。

比如:我就不知道我用AI用得到底算好还是坏,订阅一个新的AI服务时,我会经历至少一周的试错期才能比较得心应手。

这意味着,研究者报告“AI 素养提升”时,可能测到的是自我感知的提升,不是能力的提升——而两者在 AI 这种新技术面前,差距可能比想象的大得多。

(五)原始数据极少公开。除了 Laupichler 团队的 SNAIL,几乎没有量表把原始数据放出来。这让独立的重分析、跨文化等值检验、地板/天花板效应核查都几乎不可能。这本身就是一个独立于工具质量之外的科研规范问题。

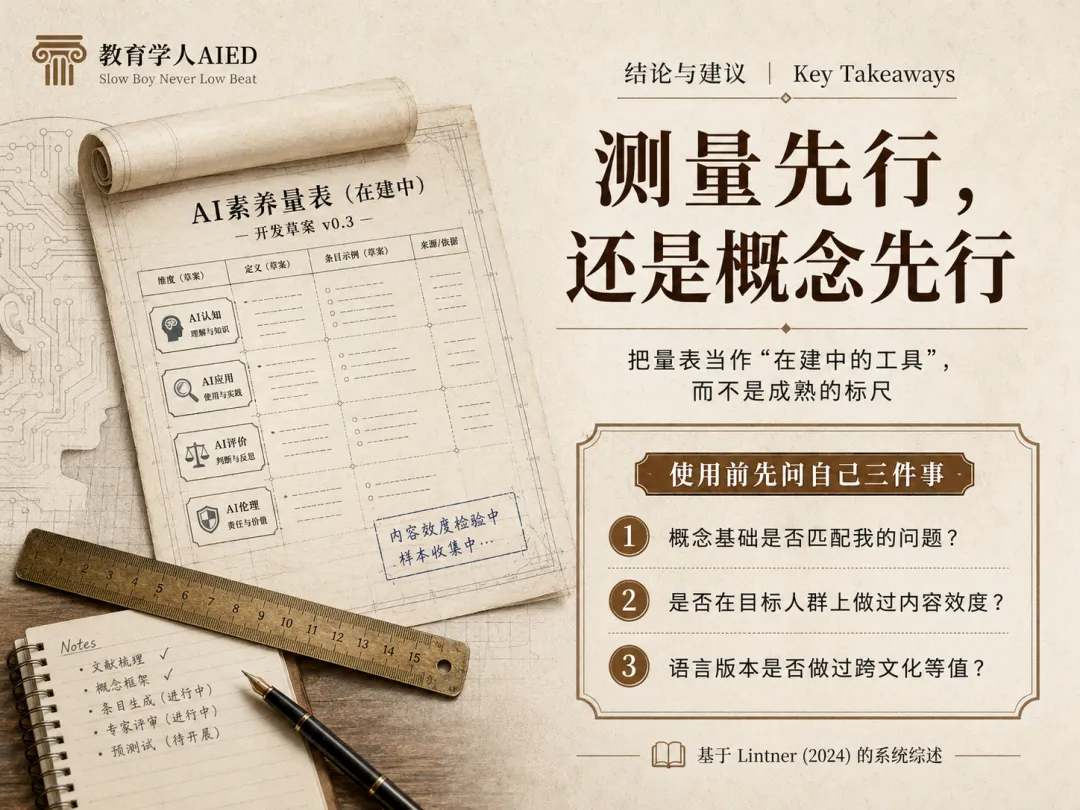

四、测量先行,还是概念先行

读完这篇综述,最难绕开的一个问题是:当我们都还没在概念层面真正搞清楚“AI 素养”是什么的时候,我们已经造了 16 个量表来测它了。

每个量表都基于自己的概念框架,概念框架之间又互相分歧,然后大家各自在自己的样本里跑出“良好”的内部一致性和结构效度——这种“良好”,有时候只是一种循环验证:你定义出什么样的因子,题目就按那个因子写,数据当然往那个因子偏。

这不是任何单个量表作者的问题,而是这个领域的发展节奏问题。AI 素养的概念发展速度,跟不上学校和政策机构部署AI的速度,更跟不上 AI 本身的发展速度。

所以“避坑指南”最终的那一条建议是:任何要用这些量表的人,都应该把它当作“在建中的工具”,而不是“成熟的标尺”。

用之前先问自己三件事:

-

这个量表的概念基础,跟我研究或教学场景里要回答的问题对得上吗?

-

它在我目标人群上做过内容效度吗?如果没做,我有没有时间、资源补做一轮?

-

它的语言版本是否做过跨文化等值?如果没有,我用它做出来的国别比较结论,能不能立得住?

如果三个问题的答案都是没有,那么最诚实的态度是——本次调研结果仅供参考。

参考文献:Lintner, T.(2024). A systematic review of AI literacy scales. npj Science of Learning, 9, 50.https://doi.org/10.1038/s41539-024-00264-4

本篇原始论文发表于2024年,因此,本“指南”同样仅供参考。

夜雨聆风

夜雨聆风