51 万行 Claude Code 源码被扒光,AI 巨头自己砸了自己的场子

史诗级泄露!51 万行 Claude Code 源码被扒光,AI 巨头自己砸了自己的场子

01 开篇:AI 圈今天最大的瓜

2026 年 3 月 31 日,清明节前一天。

全球顶尖 AI 公司 Anthropic 可能没想到,自己会以这种方式登上热搜第一。

51.2 万行核心源代码,1900 多个内部文件,全部泄露。

不是被黑客攻击,不是被内鬼出卖。

而是他们自己,亲手把代码传到了网上。

更讽刺的是——

就在一个月前,Anthropic 刚高调发布了 Claude Code Security 功能,宣称要用 AI 保护代码安全。

结果转头,自己的代码先丢了。

这剧情,连编剧都不敢这么写。

02 泄露全过程:一个低级失误引发的风波

让我们还原这场”史诗级泄露”的完整时间线。

🔴 2026 年 2 月 20 日

Anthropic 发布 Claude Code Security 功能,由 Claude Opus 4.6 驱动。

官方宣称:”将彻底改变代码安全扫描方式”。

🔴 2026 年 3 月 31 日 凌晨

Claude Code CLI 工具更新到 v2.1.88 版本。

工作人员在打包发布时,犯了一个低级错误:

误将用于内部调试的 source map 文件(.map)一起上传到了 NPM 公共平台。

什么是 source map?

简单说,就是编译后代码的”地图”,可以反向还原出原始源代码。

本来这玩意儿只有内部开发能用。

但这次,它被公开发布了。

🔴 2026 年 3 月 31 日 上午

独立安全研究者 Chaofan Shou 发现了这个漏洞。

他没有选择报告给 Anthropic,而是做了一件事:

在推特上发布了包含完整源码的压缩包。

🔴 2026 年 3 月 31 日 下午

消息迅速发酵。

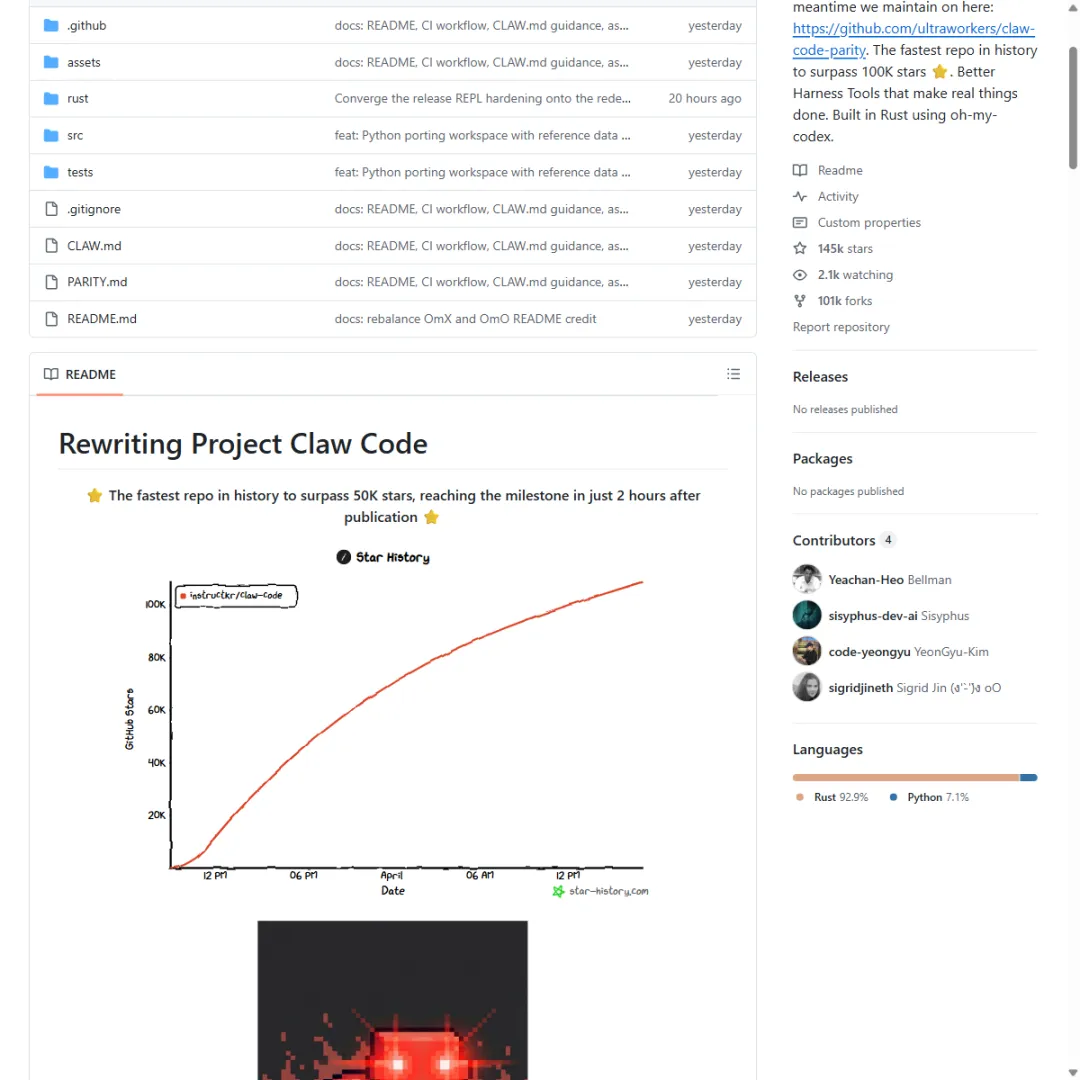

GitHub 上出现多个备份仓库,如 instructkr/claude-code。

开发者社区炸锅了。

🔴 2026 年 4 月 1 日

Anthropic 发布 DMCA 下架通知,要求删除相关仓库。

但代码早已传遍全网。

有韩国开发者连夜用 Python”净室实现”重写核心功能,规避法律风险后重新上架。

这操作,堪称”盗版界的教科书”。

03 泄露内容:扒出了什么猛料?

根据已获取源码的开发者透露,这次泄露的内容堪称”豪华大礼包”:

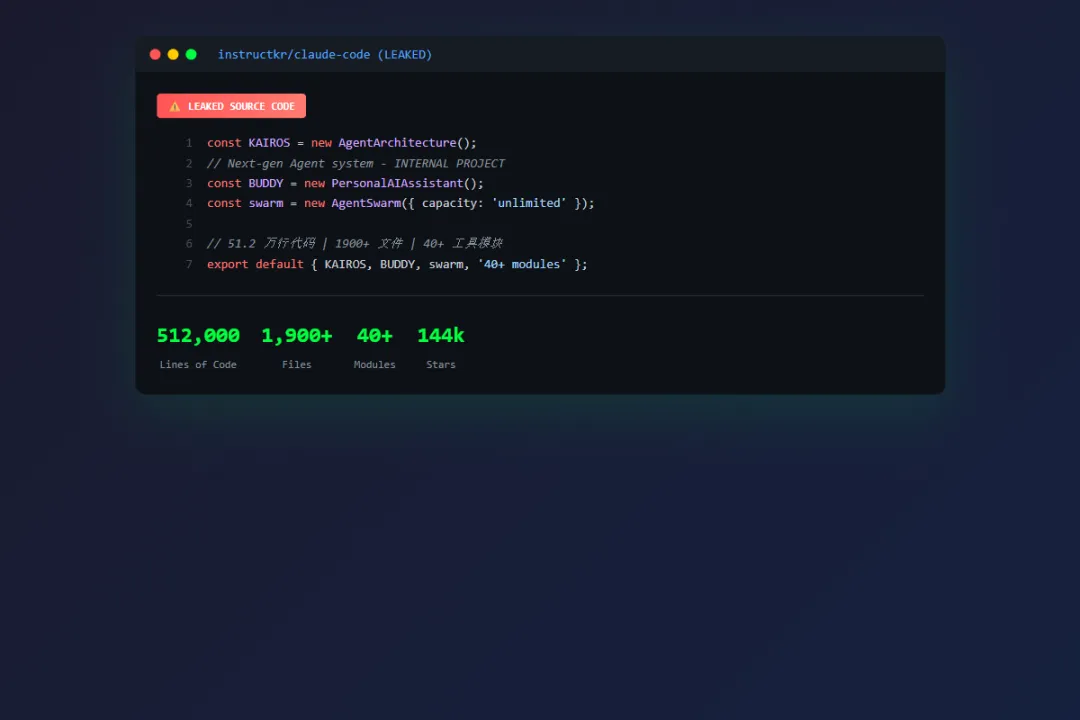

📦 核心代码

- 51.2 万行

TypeScript 源代码 - 1900+

内部文件 -

完整的工具链和构建脚本

📦 未发布功能(重点来了)

源码中发现了多个神秘项目代号:

|

|

|

|---|---|

| KAIROS |

|

| BUDDY |

|

| Agent Swarms |

|

| 40+ 工具模块 |

|

📦 内部实现细节

-

Claude Code 与 Claude 模型的通信协议 -

权限验证逻辑 -

错误处理机制 -

实验性功能开关

有开发者看完后感叹:

“这相当于把自家厨房的配方全公开了,连秘制酱料的比例都有。”

04 谁在吃瓜?谁在慌?

😂 吃瓜群众

- 普通开发者

:免费学习顶级 AI 代码架构 - 竞争对手

:默默下载,仔细研究 - 安全研究员

:兴奋得睡不着觉

😰 慌的人

- Anthropic 法务部

:疯狂发 DMCA 下架通知 - Claude Code 用户

:我的账号安全吗? - 其他 AI 公司

:赶紧自查发布流程

🤔 一个关键问题

泄露的代码,会不会影响 Claude 大模型本身?

根据 Anthropic 的官方回应:

“此次泄露仅涉及 Claude Code CLI 工具,不涉及 Claude 核心大模型的权重或训练数据。”

翻译一下:

工具代码丢了,但 AI 大脑没受影响。

就像餐厅的菜单和点餐系统被公开了,但厨子的配方还在。

05 行业警示:AI 安全成了笑话?

这次事件最讽刺的地方在于:

Anthropic 一个月前刚发布”代码安全”功能,结果自己先翻了车。

这说明了什么?

⚠️ 问题 1:发布流程存在严重漏洞

-

为什么 source map 文件能被公开发布? -

有没有自动化检测机制? -

发布前有没有人审核?

⚠️ 问题 2:AI 公司自身安全意识薄弱

连 AI 安全工具都保护不好自己的代码,怎么保护用户?

⚠️ 问题 3:供应链攻击风险激增

就在同一个月,安全团队还发现了针对 AI 开发的供应链投毒攻击:

攻击者通过诱导 AI 编码代理自动引入恶意依赖包,实现自动化攻击。

AI 写代码越快,安全风险传播也越快。

06 普通人能学到什么?

💡 给开发者的建议

-

审查发布流程

-

确保调试文件不会意外公开 -

使用自动化工具检测敏感文件 -

重视 source map 管理

-

生产环境绝不上传 source map -

使用私有源存储调试文件 -

关注供应链安全

-

谨慎引入第三方依赖 -

定期审计依赖包来源

💡 给普通用户的建议

-

不必过度恐慌

-

泄露的是工具代码,不是你的数据 -

正常使用不受影响 -

保持警惕

-

不要下载使用来路不明的”破解版” -

关注官方安全公告 -

密码管理

-

如果你用过 Claude Code,建议检查账号安全 -

开启双重验证

07 结尾:这件事还没完

截至目前,GitHub 上仍有部分源码仓库存活。

Anthropic 的下架通知发了一轮又一轮。

但互联网有句话:

一旦公开,永不消失。

这次事件给整个 AI 行业敲响了警钟:

在 AI 狂奔的时代,安全不能掉队。

否则,今天翻车的是 Anthropic。

明天,可能是任何一家公司。

甚至,可能是你。

你觉得这次泄露是意外,还是有人故意为之?

-

A. 纯属失误,打工人背锅 -

B. 内部人故意为之 -

C. 竞争对手搞鬼 -

D. Anthropic 自导自演,营销炒作

欢迎在评论区留下你的看法。

点个”在看”,让更多开发者看到。

夜雨聆风

夜雨聆风