AI做错因分析,真比老师更靠谱吗?快是快,别把“判断权”也交出去

正文四节:

AI为什么会让人觉得“它很懂错因”

错因分析最怕的,不是慢,而是“看错还很自信”

老师经验真正值钱的,不是归类,而是诊断后的教学动作

学校、教师、家长,分别该怎么把AI用对

正文

老师批作业久了,会形成一种“职业直觉”。

看到学生把二次函数最值题做成了代数搬运,就知道他不是不会算,是不会抓“顶点”;

看到几何压轴题写了一堆辅助线,就知道他不是不努力,是方向感出了问题。

这就是老师的经验。它不只是把错误贴个标签,而是能从错误里看见学生的思路轨迹。

可AI一进来,很多人心里都会冒出一个问题:

既然机器能一秒钟识别错题、分类错因、生成反馈,那老师这套经验,是不是很快就不值钱了?

我的判断是:不会。AI会放大老师经验,但还接不走老师经验。

一、AI为什么会让人觉得“它很懂错因”

先说句公道话,AI在错因分析上,确实有它的硬本事。

一个很典型的例子,是英国中学数学平台 Eedi。它有超过60,000 道诊断题,而且每道题不只是一个正确答案、三个错误选项那么简单;每个错误选项都事先映射到一种常见误解。学生一旦选错,系统就不是简单判个叉,而是能根据所选干扰项,推断背后的典型认知偏差,再把学生送到对应的讲解、提示和练习上去。教师端还能看到班级和个体层面的误解分布、努力程度和掌握情况。这个设计说明,AI最有优势的地方,不是“神奇”,而是结构化、规模化、可回看。()

从系统层面看,学校和教师也的确在更多地把AI用在这类工作上。OECD 2025年的报告提到,在参加调查的教师中,已经有不少人把AI用于生成教案、查看学生参与或表现数据,以及评估学生作业;在报告列举的数据里,使用AI来查看学生参与或表现数据的比例达到31%,用于评估或批改学生作业的比例达到27%。这说明一线教育现场已经把AI当成了“先看一遍数据、先做一轮归类”的工具,而不只是一个聊天玩具。()

所以第一句金句,可以这么写:

AI最先替代的,不是老师的专业判断,而是老师那些重复、费眼、费时的初筛动作。

二、错因分析最怕的,不是慢,而是“看错还很自信”

但问题也正出在这里。

错因分析这个活,最危险的不是慢,而是“错得像对的一样”。

2025年的 MathTutorBench 把“AI会不会教数学”这件事拆得很细。它不只看模型会不会做题,还看它会不会验证学生答案、定位错误位置、纠正错误、用问题和提示搭脚手架。结果很有意思:研究发现,模型的“解题能力”和“教学能力”之间存在明显张力。很多模型会解,但不会教;专门往“会教”方向训练后,解题准确率又可能掉下来。说白了,会算,不自动等于会诊断;会诊断,也不自动等于会引导。

更值得警惕的是,另一个关于“从手写数学作业诊断学生认知技能”的基准研究,评估了18个大模型,结果发现它们整体表现都不理想,F1都低于0.5;一旦证据变得模糊,性能就明显下滑,而且会出现几类典型问题:把模糊证据当成明确信号、对极少线索过度解读,甚至凭空补出并不存在的依据。研究者最后给出的方向很明确:这种工作更适合做成teacher-in-the-loop,也就是“老师在回路中”。()

再看一项更贴近数学作业现场的研究。2025年《Frontiers in Education》有篇文章专门看 GPT-4 Turbo 处理学生手写数学过程的表现。结果并不轻松:在20份有效手写解答里,模型只把4份无误地识别并数字化,其余16份都有不同程度的不准确;而且它不只是“没看清”,还会自己改学生原本写错的地方,甚至凭空捏造一整行原题里没有的式子。这就很麻烦,因为一旦输入阶段就错了,后面的错因分析再“聪明”,也是在错地基上盖房子。()

第二句金句:

错因分析不是分类游戏,它首先是一场证据游戏。证据不稳,判断就别太满。

三、老师经验真正值钱的,不是归类,而是诊断后的教学动作

很多人会低估老师经验,是因为只看见老师最后说的那句话,没看见前面脑子里已经转了多少圈。

OECD在2025年关于高质量教学的报告里,把形成性评价说得很清楚:教师工作不是简单地“看对错”,而是一个持续循环的过程——设定目标、诊断学生学习、给出反馈、再根据学生的思路调整教学。它特别强调,教师要能对学生的想法作出回应,并不断适配。也就是说,真正高价值的工作,不是把错误命名,而是根据这个错误决定下一步怎么教。()

这也是AI和老师的关键差别。

AI很像一个勤快的分拣员,能把“同类错误”迅速堆在一起。

老师更像一个临床医生,不只看症状,还要判断病因、轻重、时机和干预方式。

同样是“列方程列错了”,老师会继续追问:

你是题意没读懂,还是量之间关系没建立起来?

你是会列不会检验,还是一紧张就把“设”变成了“猜”?

你这次错,是偶发失误,还是这一类题一直都这样?

这几问,才是真正决定教学效果的地方。

UNESCO 也一直在提醒这件事:AI进入教育,必须有人类监督,尤其是涉及学生判断、教育决策和教师角色的地方,AI应当是补充,而不是替代。另一个UNESCO观点也很值得学校管理者警惕:很多AI系统容易把学习做成“一对一闭环”,看起来很高效,实际上可能把教育变成学生独自面对机器,削弱了真正重要的师生互动和共同建构。()

第三句金句:

老师最值钱的经验,不是看见学生错了,而是知道这次该提醒、该追问,还是该停下来重讲。

四、学校、教师、家长,分别该怎么把AI用对

说到底,争论“AI和老师谁更靠谱”意义不大。

真正该问的是:这活儿怎么分工,才最靠谱。

对学校来说,最稳妥的做法,不是让AI直接给学生“贴标签”,而是让它先做三件事。

第一,做错因初筛。把一批作业先按高频错误聚类,帮备课组快速看见共性问题。

第二,做趋势提示。比如本周“审题偏差”上升了,还是“步骤会做但表达失分”增多了。

第三,做讲评前准备。先生成若干种可能的错因解释和补救思路,供教师二次筛选。

这样用,AI是在给老师“备诊”;那种直接拿AI结论开家长会、排班级、判学生水平的做法,就走偏了。()

对教师来说,我建议保留一个很简单的“三步法”:

先看AI给出的错因类别;

再看学生原始证据;

最后由老师写出补救动作。

也就是:错因—证据—改法。

前两步可以借AI提速,最后一步不要外包。因为真正能改变学习的,不是“你错在第3步”,而是“下一次你该先检查哪一步”。

对家长来说,也别把AI当成作业保姆。

最好的用法不是“孩子不会,赶紧拍给AI”,而是让AI帮助孩子把自己的思路说出来。

比如让孩子先自己写三句话:

我卡在哪;

我觉得我为什么这样做;

我最不确定的是哪一步。

再让AI根据这三句话只提问、不直接给答案。这样,AI是在减轻家长陪作业时的情绪消耗,而不是把“想”这件事替孩子做掉。

否则,表面上省了力,实际上把最该练的思考肌肉练没了。

这里还可以补一个现实依据。前面提到的英国课堂研究里,使用人类监督下的AI辅导,在知识迁移上比只给静态提示更好,也比单纯人工在线辅导显示出更高的潜在优势;同时,AI支持下,导师可以同时支持更多学生,系统估算的每小时处理量也更高。这说明,AI确实能减负,但前提是它被设计进一个有人兜底、有结构约束的教学流程里。()

结尾

所以,AI做错因分析,比老师经验更靠谱吗?

我的答案是:

在“发现重复问题”这件事上,AI越来越靠谱;在“理解这个孩子为什么会这样错”这件事上,老师仍然更靠谱。

这不是一句客套话,而是教育的基本逻辑。

因为教育面对的从来不是一堆错误,而是一群带着情绪、习惯、信心和偏见的孩子。

AI擅长识别模式。

老师擅长理解人。

最适合转发的一句话,我给您这一句:

AI能把错误找出来,老师才能把学生拉回来。

也欢迎您在留言区聊聊:

您最认同哪一种用法——AI先筛、老师复核,还是AI只做练习陪伴?

您在批作业时,最希望AI替您省掉的是哪一步?

高搜索量热词摘要

AI错因分析、数学错因诊断、形成性评价、学习分析、教师经验、数学作业批改、AI家教、教师减负、教育AI治理、teacher in the loop、手写作业识别、误解诊断

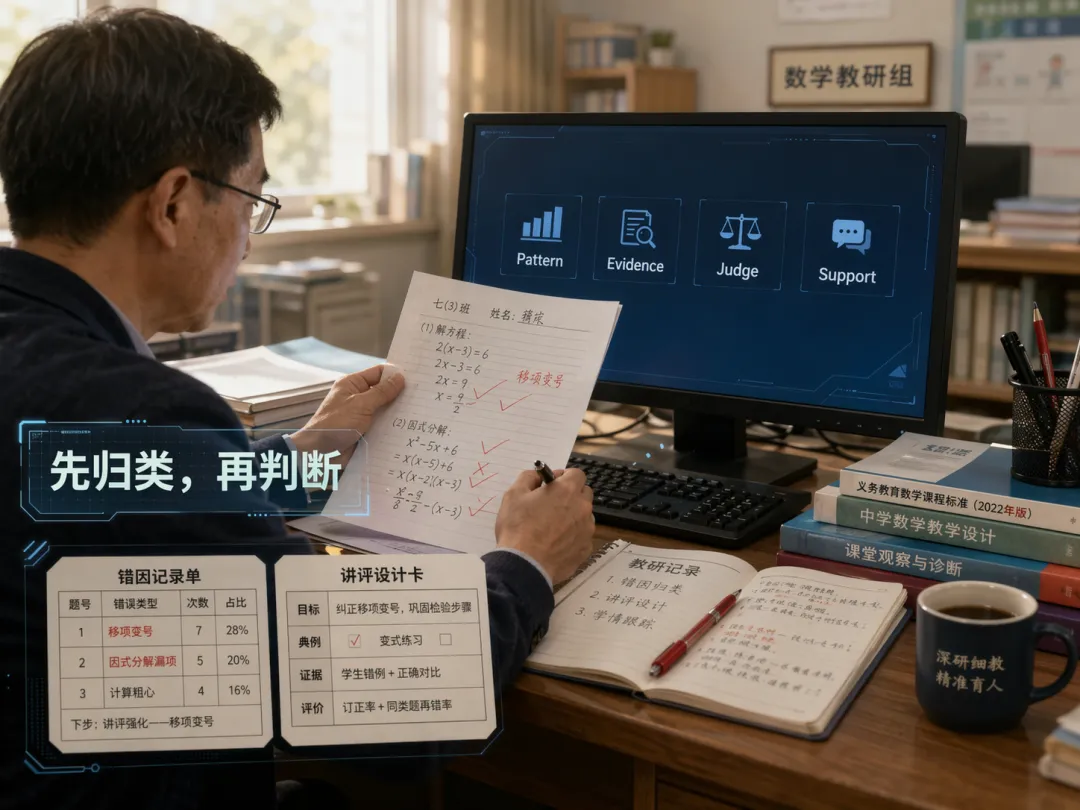

配图建议

风格:校园纪实 × 轻量科技HUD叠加

色调:暖白 × 深蓝 × 银灰高光

内容:真实中学数学办公室场景,一位老师在看学生作业,电脑屏幕上显示AI归类出的几类高频错误,但老师手里仍拿着一份学生原始草稿纸进行比对。桌上有“错因记录单”“讲评设计卡”和红笔。屏幕只显示简洁英文词:Pattern / Evidence / Judge / Support。

配图文字:先归类,再判断

相关AI提示词

中文提示词:

请你扮演一名中学数学教研组长。根据一组学生错题样本,先将错误按“审题偏差、概念混淆、步骤跳跃、计算失误、表达不规范、迁移失败”六类进行初步归类。然后对每一类分别写出:1)可能的真实原因;2)需要老师二次核验的证据;3)适合讲评课使用的追问句;4)一条补救训练建议。不要直接下结论,不要把AI判断写成最终结论,要保留“待教师复核”的提示。

English Prompt:

Act as a secondary school mathematics department lead. Given a set of student error samples, first cluster the errors into six categories: misreading the problem, concept confusion, missing steps, calculation mistakes, weak mathematical expression, and transfer failure. For each category, provide: (1) likely underlying causes, (2) evidence that still requires teacher verification, (3) a classroom-ready follow-up question, and (4) one remediation suggestion. Do not present the AI output as final truth; explicitly mark all conclusions as pending teacher review.

夜雨聆风

夜雨聆风