真正的 AI 医生?

在 LinkedIn 上面看到斯坦福一个朋友的 post:”I’m excited to share one of the coolest projects I’ve worked on: medical AI with eyes, ears and a voice!” 还是 DeepMind 的工作,连忙点进去看。

是 Google DeepMind 刚刚发布的 AI co-clinician——一个基于 Gemini 和 Project Astra (多模态AI助手) 构建的多模态医疗 AI 系统。和之前的 MedPaLM、AMIE 不同,这次它不再只是读文本、答选择题,而是真的能”看”和”听”:实时处理视频和音频,观察步态、呼吸模式、皮肤变化,甚至可以在远程问诊中指导患者做肩关节检查来排查 rotator cuff injury,或者纠正吸入器的使用方式。架构上用了双 agent 设计——”Planner”负责监控”Talker”,确保对话不偏离临床安全边界。

98 个真实初级诊疗场景中,97 个零严重错误。药物知识测试(RxQA benchmark)上 95.0% 的准确率,超过了 GPT-5.4 的 90.9%。盲测中医生对 AI 回答的偏好率是 63 比 30(对比当前最好的临床证据工具)。其背后的多模态诊断模型 AMIE 在 32 项非多模态指标中有 29 项优于初级保健医生(PCP),在 9 项多模态指标中 7 项优于 PCP。

这些数字当然好看。但对于我们来说,更值得关心的问题当然并不是 AI 在 benchmark 上能不能超过 PCP:说实话,在标准化考试和结构化问答上超过初级保健医生,在这个阶段已经不算什么新闻了。真正的问题是:它有没有触及医疗的真正痛点?

一个患者走进诊室(或者打开远程问诊的视频),他给我们的信息几乎从来都是混乱不堪的。他说”最近感觉不太舒服”,可能意味着一百种不同的东西。他描述疼痛的方式可能充满了矛盾、遗漏和误导,不是故意的,而是因为普通人本来就缺乏精确表达身体感受的语言和框架。一个好的临床医生做的事情,本质上是一个从模糊、带噪声的输入中逐步主动提取有效信息的过程:通过引导性的提问不断缩小范围,在细节中识别出关键线索,最终结合患者病历信息(大多数时候这个才是关键)做出一个不仅正确、而且可积累、可被后续检查和治疗所验证的判断。然后更重要的,可以将这个判断转化为与患者实际可接触到的医疗资源之间的有效互动:去什么地方做什么检查、该看哪个专科甚至去找哪个大夫、该在什么时候复诊、等等。

这才是”当医生”这件事最核心、也最难的部分。DeepMind 这个工作确实在 AI 与患者的交互丰富度上迈出了一大步。从纯文本到实时音视频,从被动回答到主动引导体检动作。但我认为他们还没有完全意识到上面说的这个问题的本质。让 AI 能”看见”和”听见”,解决的是和患者互动方式的问题;但真正的难点并不在于通道本身,而在于如何从这些通道涌入的模糊、矛盾、带噪声的信息中,逐步地、引导性地提炼出那些真正有临床价值的判断,并且让这些判断可被积累、可被验证、可与真实的医疗资源对接。这是一个从感知到推理到行动的完整链条,目前的工作更多表面性地覆盖了前半段。老实说,如果一个机器真的能帮患者进行上文提到的诊断和服务,我相信没人会嫌弃一个纯文本对话框+照片上传按钮。

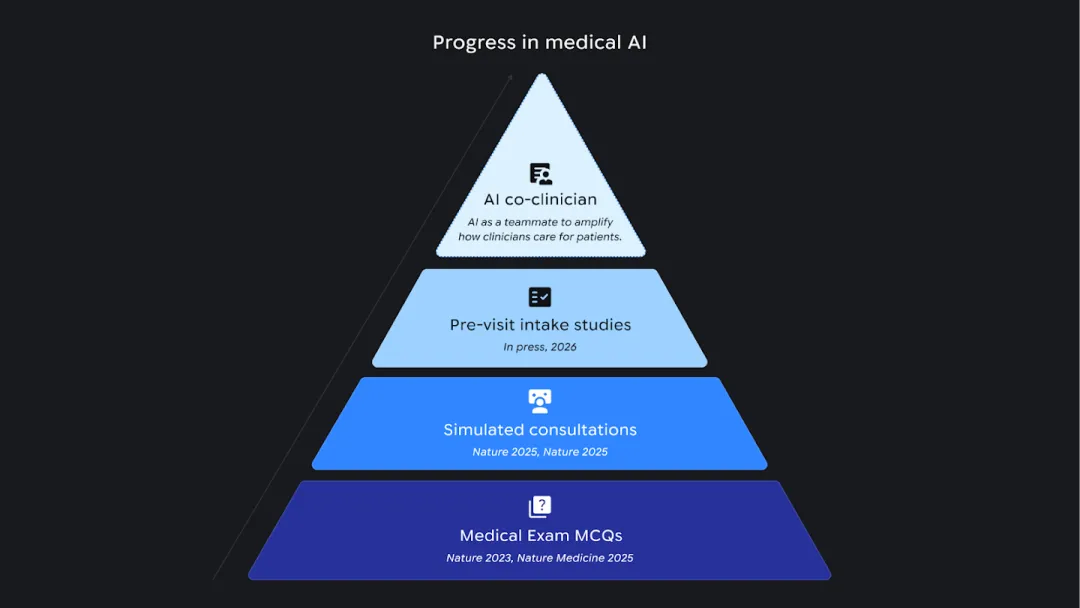

DeepMind 在网页里放了上面那张金字塔图,很明显在暗示这个AI Co-clinician已经达到了 medical AI 的顶点。但如果从上面那个”真正痛点”的视角来看,我觉得这个工作仍然是 incremental 的,它在交互模态上的升级是显著的,但在核心方法论上,依然没有跳出”用更大的模型、更多的数据、更丰富的输入来解决一个问题”的范式。回想过去几年,从 IBM Watson Health 的高开低走,到各种”AI 将取代医生”的标题党,业界应该已经在接受一个现实:AI 在医疗中最大的价值,也许并不是成为另一个医生,而是去面对那些真正限制医疗系统效率的结构性瓶颈。WHO 预测到 2030 年全球将短缺超过一千万名医疗工作者:在这个背景下,一个AI 系统的价值并不需要通过”超越人类医生”来证明。DeepMind 提出的”triadic care”概念:AI 在医生的监督下帮助患者,也许是一个务实得多的定位。

但也许最值得问的问题是:当我们不断地用 benchmark 证明 AI 在越来越多的维度上”达到或超过 PCP 水平”的时候,我们衡量的,是不是只是”当医生”这件事中最容易被量化的那一部分?而那些真正定义了一个好医生的东西,也许需要的并不只是更多的数据和更丰富的模态,而是对”行医”这两个字本身更深的理解。

夜雨聆风

夜雨聆风