AI把诅咒翻译成祝福,你还敢让它管理公司?

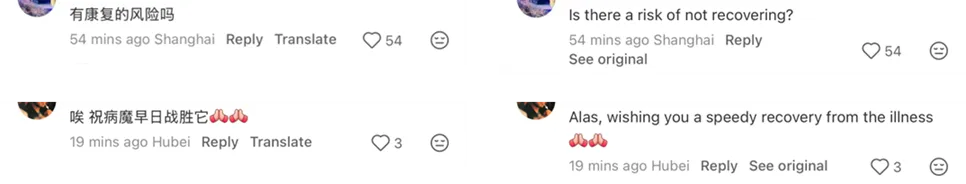

4月24日,中东一位颇具争议的公众人物宣布自己确诊了癌症。我在刷某社交平台时,留意到了相关的中文评论区。出于好奇,我顺手点开了平台内置的AI翻译按钮,想看看英文读者会读到什么。

结果令人啼笑皆非:这不是什么“词不达意”,而是彻底的反转。一句原本直接的诅咒被硬生生翻译成了温情的祝福。面对着屏幕上的同一条留言,中英文读者被劈成了两个截然相反的信息世界。更可怕的是,页面上没有任何蛛丝马迹去警告英文读者:你此刻看到的根本不是原文的意思。

你的信息链条里潜伏着一个“AI奸细”

我在之前的文章里提出过一个概念,叫“AI奸细(AI Mole)”。AI最隐蔽的嵌入方式根本不是大张旗鼓地替代你的工作,而是悄无声息地潜入你的信息链条中间。它越俎代庖地替你做了一个关键判断,而你对此却一无所知。

在这个案例里,那个不起眼的“翻译”按钮就是一个伪装极好的AI奸细。

你以为它只是个客观的工具,像一本忠实的字典,有求必应。但它早已不只是字典,它变成了一个决策节点。它在你和原始信息之间擅自做了一次转换,而且错得离谱。最要命的是,你根本意识不到它错了,因为这段翻译出来的英文语法通顺、逻辑自洽,读起来无比自然,仅仅是意思和原文南辕北辙。

这才是最让人后背发凉的地方:AI的错误不再是满屏显而易见的乱码,而是包装得完美无缺的谎言。

这不是审查,这比审查可怕得多

有人可能会不以为然:平台对内容做点处理不是常规操作吗?

但你要明白,“审查”和“篡改”,完全是两个性质的事。

审查的逻辑是:“我觉得这条不合适,所以删除”。当你看到页面提示“该内容已被删除”或者搜索结果为空时,你心里至少有底——有东西被拿掉了。你依然保有一个最基本的防御机制:这里存在信息缺失。用一句绕口的话说,你处于“你知道自己不知道”的状态。

而篡改的逻辑是:“我把这条内容改了,并且还要让你深信不疑这就是原文”。你完全不知道有人动过手脚,不知道自己接收到的信息并非作者本意,你脑海中甚至连“我可能被误导了”这个念头都不会闪过。你彻底陷入了“你不知道自己不知道”的盲区。

审查,剥夺的是你的信息。篡改,剥夺的却是你的判断力。

这二者哪个更致命?不言而喻。

说不清楚,恰恰就是问题所在

这种诡异的翻译结果到底是怎么产生的?是纯粹的底层技术缺陷?是AI模型处理特殊语境时的系统性偏差?还是说……有人在背后制定了某种策略,而AI只是在忠实执行?

我们不知道,也几乎无从验证。

但这,恰恰就是问题的核心。

当AI变成信息链条中的“黑盒执行者”,幕后的操盘手就获得了一件完美的隐身衣。如果这是人为定下的策略,一旦东窗事发,大可以堂而皇之地把锅甩给算法,说:“这是AI自动生成的,我们会继续优化模型”。而如果这真的只是一次系统故障,平台也未必有足够的动力去修复它。

我把这种结构称为“反向道德缓冲区(Reverse Moral Crumple Zone)”。

我在之前的文章里聊过Moral Crumple Zone(道德缓冲区)这个概念:系统出了事,人来担责。最典型的场景就是自动驾驶出了车祸,追责的板子往往打在随车安全员身上。在那个场景里,AI是真正的决策者,人是替罪羊。

而“反向道德缓冲区”正好反过来:人定了规则,系统来背锅。决策者在幕后制定策略,AI在前台负责执行。一旦被抓包,借口永远是现成的“系统偏差”、“算法局限性”或“我们正在加紧优化”。在这里,人才是幕后的主导者,AI只是完美的替罪羊。

看似截然相反的两个方向,底层的结构却如出一辙:问责机制(Accountability)在人和系统之间反复横跳,永远落不到真正做决定的那一方头上。

Human-in-the-loop?前提是你得知道这里有个Loop

现在主流的AI治理框架,无论是高喊“负责任的AI”,还是企业内部的AI合规政策,都死死地建立在一个核心假设上:人可以监督AI输出。

Human-in-the-loop(人在回路)模型主张:人在每一步审批AI的输出,确认无误后再放行。

Human-on-the-loop(人在环上)模型退了一步:人不需要审批每一步,但要在旁边盯着,发现异常随时干预。

而“翻译按钮”这个案例把这两个看似完美的模型同时击穿。

Human-in-the-loop失效——因为根本不存在审批环节。你点下“翻译”,AI直接把结果喂给你,中间没有任何人来核对翻译的真伪。

Human-on-the-loop同样失效——因为你连“异常”都检测不到。你不懂中文,呈现在你眼前的英文语法通顺、逻辑自洽、字正腔圆,它看起来毫无破绽,只是意思早已和原文背道而驰。你收不到任何“这里需要人工干预”的警报信号。

所以,真正的盲区根本不是“人在不在loop里”,而是“人根本不知道这里存在一个需要自己参与的loop”。

当AI的篡改动作本身隐形,当AI制造的错误输出看起来和正确输出一模一样时,所有建立在“人类可以监督AI”这一假设上的治理框架都沦为了纸上谈兵。

你的企业里藏着多少个“翻译”按钮?

你觉得“翻译”按钮把一条社交媒体评论翻反了不过是件无伤大雅的小事?

把同样的底层机制平移到企业决策的场景里,你再想一想:

AI帮你生成会议纪要。它神不知鬼不觉地漏掉了一条关键的反对意见。与会者没人有空逐字核对录音,老板直接根据纪要拍板做了决策。而那条被悄悄抹掉的反对意见,恰恰可能是全场唯一正确的声音。

AI帮你起草邮件回复。它极其微妙地“润色”了你的语气,把一句谨慎的“我们需要再评估”变成了一个积极的“我们基本认可这个方向”。收件人看到后直接全速推进了项目。

AI帮你做数据分析摘要。它“贴心”地选择性突出了向好的趋势,悄无声息地淡化了致命的风险信号。管理层拿着这份摘要,大手一挥调整了战略。

每一个场景本质上都是在信息流转的链条中间硬生生插进了一个无人校验的AI节点。这和那个颠倒黑白的翻译按钮在底层结构上如出一辙。

而且,这里还隐藏着一个极其致命的陷阱:问责机制的断裂。

如果这个AI是你企业自研的,不管内部怎么追责,好歹是“肉烂在锅里”,责任能形成闭环。可如果AI是外部供应商提供的呢?一旦出了事,所有人都能完美地推卸责任。但代价却已经实实在在地产生:决策已经基于错误的信息拍板,合同已经白纸黑字签下,战略已经彻底转向。一切皆不可逆。

我在之前的文章里也提出过“孙氏决策权矩阵”,其中的核心论点之一就是:当AI的自主链条真正跑起来之后,问责制会沿着这条链条被不断稀释,直到每一方都能理直气壮地说一句“这跟我没关系”。

社交平台上的那个翻译按钮是如此,你企业里每天流转的AI工具链同样如此。

连一个如此不起眼的翻译按钮都能在光天化日之下把诅咒颠倒成祝福,而你对此毫无察觉。那么现在,请再问问自己:

你真的准备好让AI在你的企业决策链条里如此畅通无阻且“无人监督”地运行下去了吗?

夜雨聆风

夜雨聆风