本地免费部署OpenClaw及FreeRide教程:免费调用30+主流大模型指南

想免费玩转AI但总被API费用和限流卡住?OpenClaw的FreeRide插件帮你搞定。它能自动调度30多个免费模型,智能切换、负载均衡,让你零成本拥有稳定AI助手。文章还手把手教你从阿里云到本地(Windows/Mac/Linux)的傻瓜式部署,附赠代码命令和避坑指南,帮你轻松搭起自己的免费智能体系统。

一、前言

在AI工具普及的今天,API调用成本、密钥管理、模型限流、服务中断等问题,一直困扰着个人用户与小型开发者。OpenClaw(Clawdbot)作为开源本地优先AI智能体框架,可为AI任务提供稳定的运行环境,而FreeRide则是专为其打造的免费模型调度插件,能够自动聚合、优选、切换超过30个免费可用模型,实现无感知降级、自动负载均衡,让用户永久免费使用AI能力。

本文将完整保留FreeRide的核心功能、使用逻辑、命令体系与技术原理,不改变原文原意,同时新增2026阿里云轻量服务器零基础部署OpenClaw、Windows11/MacOS/Linux本地全平台部署、阿里云千问大模型API配置、免费Coding Plan对接方案,同步提供可直接复制的代码命令、高频问题排查与避坑指南,助力用户从零搭建完全免费、稳定可靠的AI智能体系统。阿里云部署OpenClaw堪称全网最简单,仅需两步即可完成,详情👉访问阿里云OpenClaw一键部署专题页面了解。

二、FreeRide 核心介绍

FreeRide是面向OpenClaw生态开发的免费模型管理与自动路由工具,核心专注于聚合各类免费可用的模型接口,提供智能优选、自动切换、限流自动恢复、多备选兜底等实用能力,让用户无需付费、无需维护多个密钥,就能持续使用高质量的大模型服务。

核心功能

自动聚合30+免费模型

覆盖通用对话、代码生成、数学推理、长文本理解等多场景能力,无需用户手动逐一配置。

智能优选主模型

可自动筛选出当前可用、运行稳定且限流宽松的最优模型,设为默认模型,减少用户手动选择的麻烦。

多级兜底切换

当主模型出现限流、不可用等情况时,会自动切换至备选模型池,确保AI任务不中断、不卡顿。

不破坏原有配置

仅针对性更新模型相关配置,网关、通道、技能、权限等系统其他设置均保持不变,避免影响原有运行环境。

监控守护进程

可后台持续运行,实时检测所有模型的运行状态,一旦发现异常,自动触发模型轮换策略,无需人工值守。

三、2026 阿里云轻量服务器部署 OpenClaw(零基础最简流程)

阿里云轻量服务器是长期稳定运行OpenClaw+FreeRide的最优环境,支持7×24小时在线运行、公网远程访问,还能实现自动监控,非常适合个人及小型团队使用。

步骤1:创建实例

登录阿里云控制台,直接进入轻量应用服务器模块;

选择应用镜像→OpenClaw 2026稳定版;

地域优先选择中国香港/新加坡(免备案,网络连接更稳定);

配置推荐2核2GB、40GB云盘、5Mbps带宽(满足基础运行需求,性价比最高);

设置root登录密码,并妥善记录服务器公网IP(后续访问控制台需用到)。

阿里云用户零基础部署OpenClaw喂饭级步骤流程

第一步:点击打开访问阿里云OpenClaw一键部署专题页面。

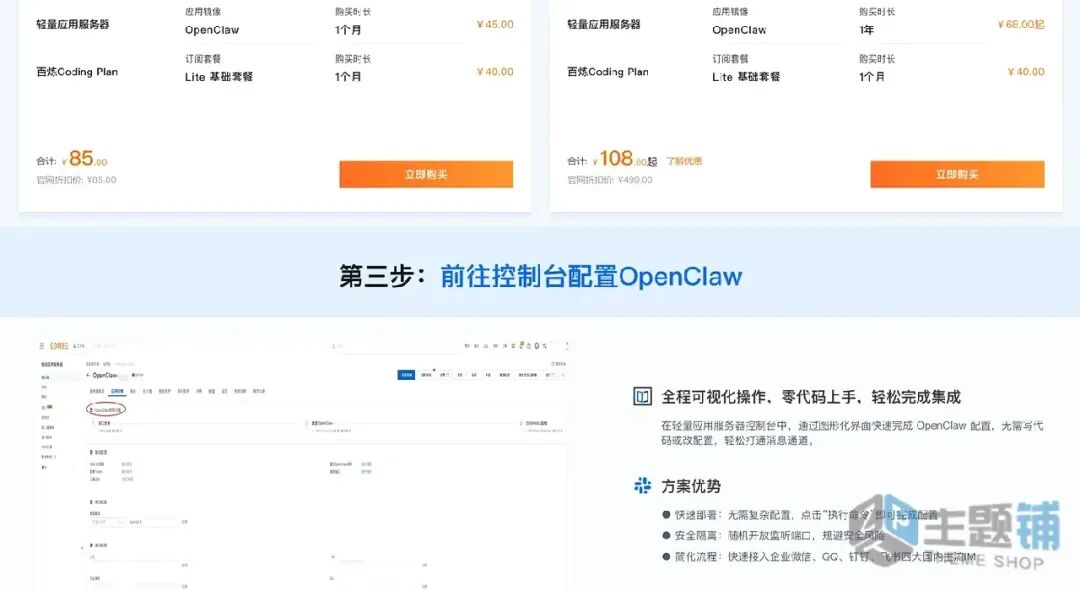

第二步:打开选择阿里云轻量应用服务器,配置参考如下:

镜像:OpenClaw(Moltbot)镜像(已购买服务器的用户,可通过重置系统重新选择该镜像);

实例:内存必须达到2GiB及以上(低于该配置会导致服务崩溃);

地域:默认美国(弗吉尼亚),目前国内地域(除香港外)的轻量应用服务器,联网搜索功能会受到限制;

时长:根据自身需求及预算灵活选择即可。

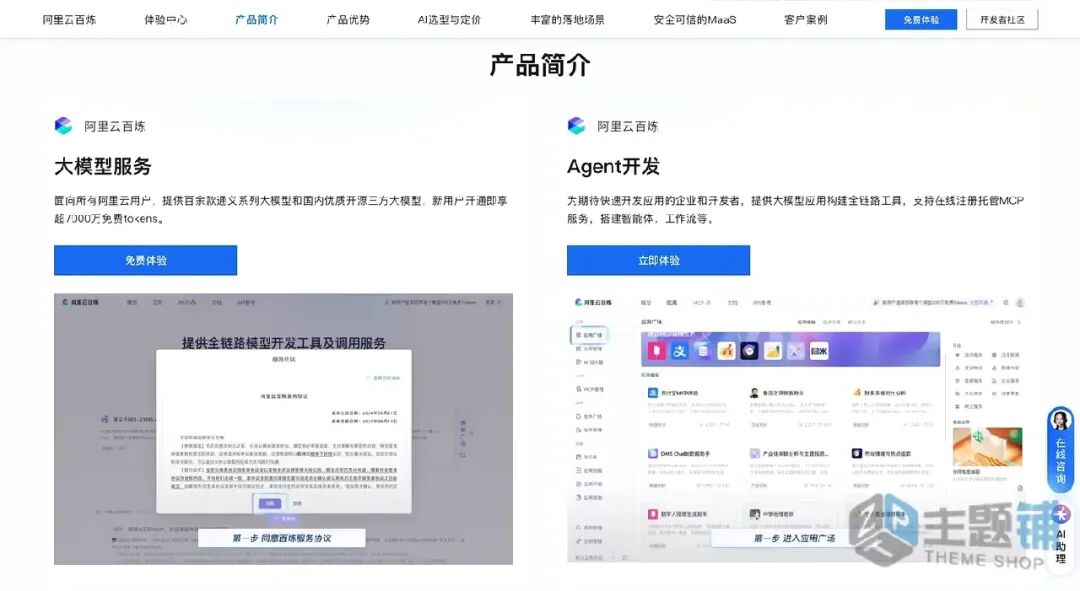

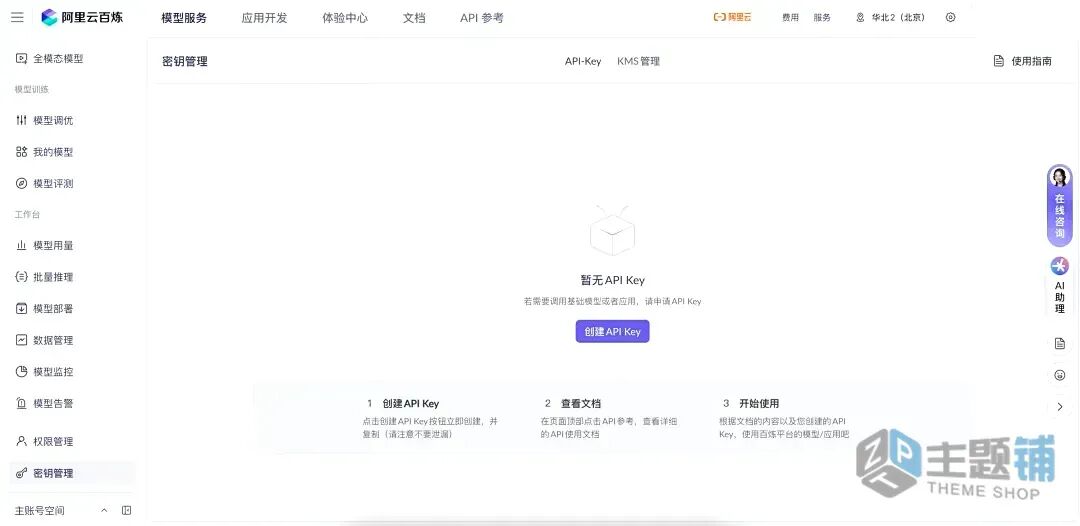

第三步:打开访问阿里云百炼大模型控制台,找到密钥管理模块,单击创建API-Key。

前往轻量应用服务器控制台,找到已安装好OpenClaw的实例,进入「应用详情」页面,完成18789端口放行、百炼API-Key配置、命令执行,最终生成访问OpenClaw的Token。

端口放通:需放行对应端口的防火墙,直接单击一键放通即可完成操作;

配置百炼API-Key:单击一键配置,输入已获取的百炼API-Key,再单击执行命令,将API-Key写入系统;

配置OpenClaw:单击执行命令,生成访问OpenClaw的Token(妥善保存,后续登录需用到);

访问控制页面:单击打开网站页面,即可进入OpenClaw对话页面,完成基础部署。

阿里云百炼Coding Plan API-Key 获取、配置保姆级教程:

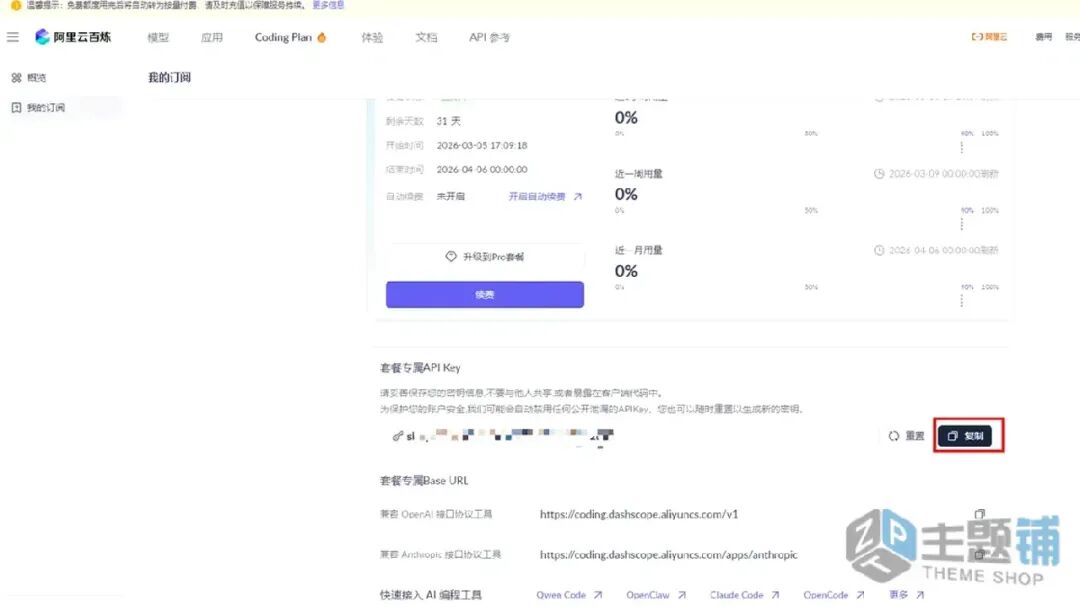

创建API-Key前,推荐访问订阅阿里云百炼Coding Plan,该服务每天会有两场抢购活动,已从按tokens计费升级为按次收费,能进一步节省使用成本。

购买完成后,在控制台生成API Key。注:此处需复制并妥善保存你的API Key,后续配置过程中会用到。

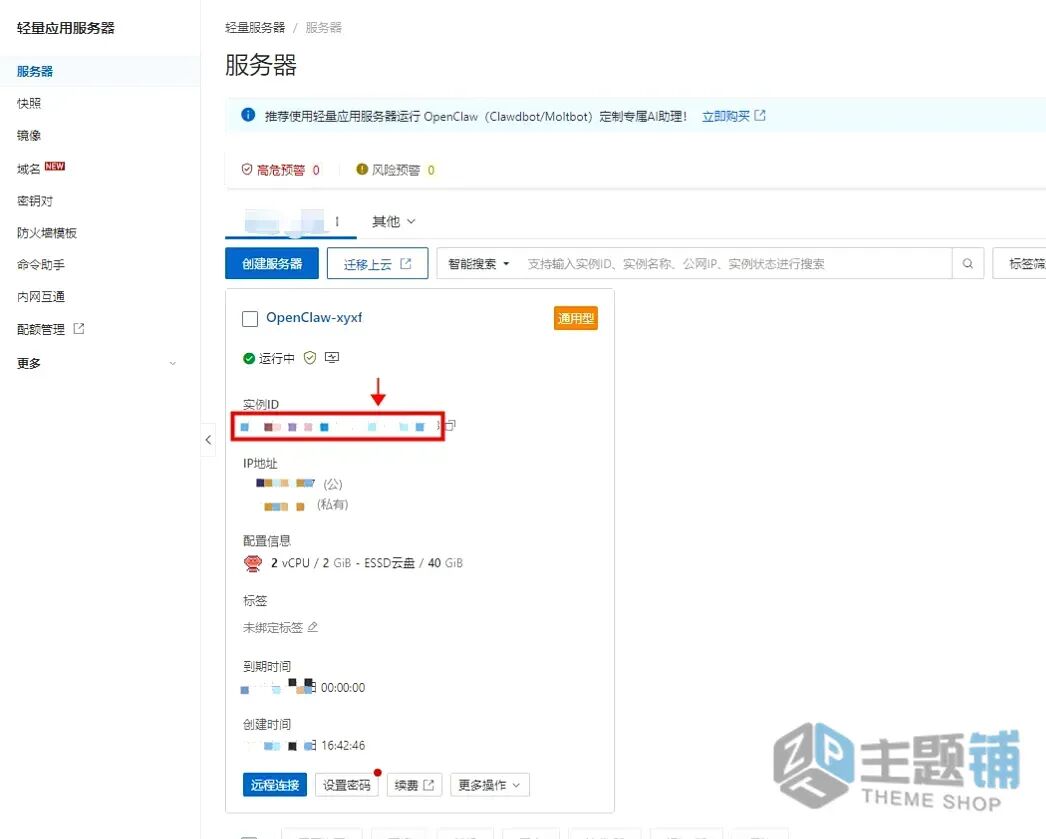

回到轻量应用服务器控制台,单击服务器卡片中的实例ID,进入服务器概览页。

在服务器概览页面单击应用详情页签,进入服务器详情页面。

端口放通:在OpenClaw使用步骤区域中,单击端口放通下的执行命令,即可开放获取OpenClaw服务运行端口的防火墙。

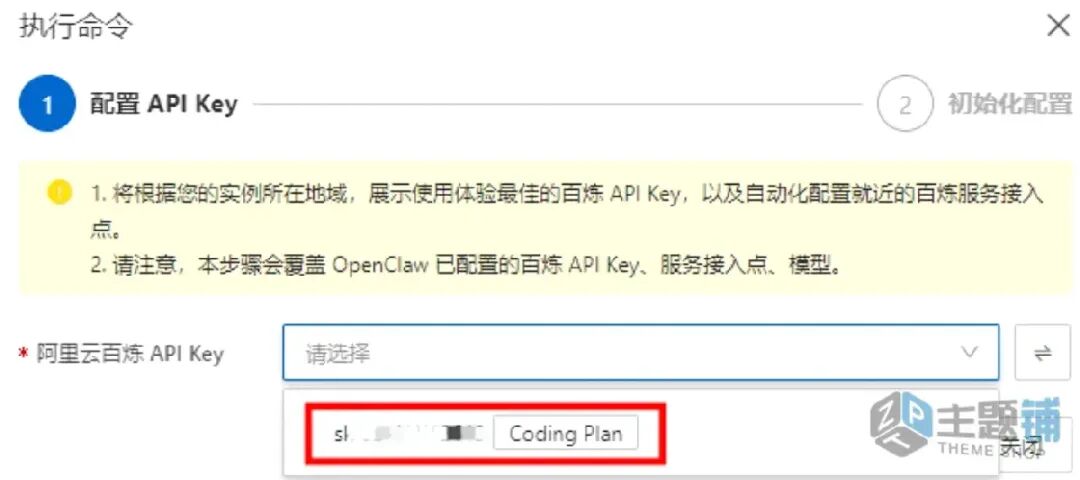

此处系统会列出第一步中创建的阿里云百炼Coding Plan的API Key,直接选择对应Key即可完成配置。

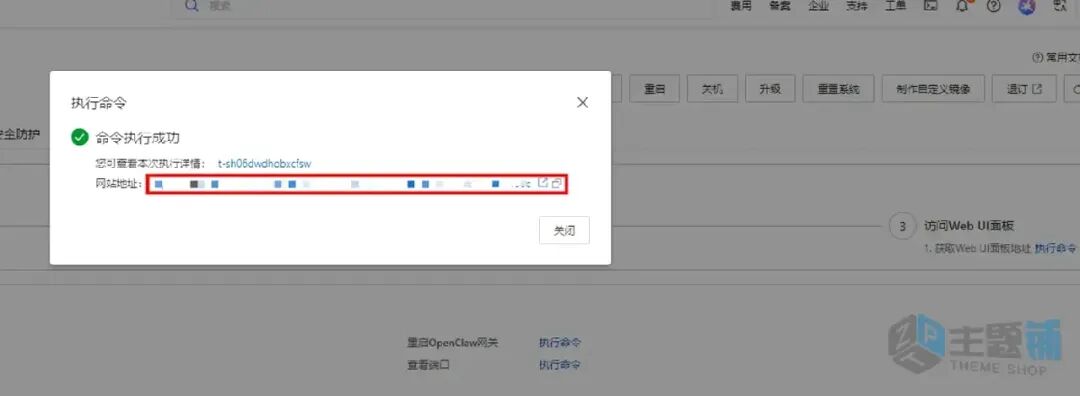

获取访问地址:单击访问Web UI面板下的执行命令,即可获取OpenClaw WebUI的访问地址。

步骤2:放行端口(关键步骤,不可省略)

firewall-cmd --add-port=18789/tcp --permanent

firewall-cmd --reload

firewall-cmd --list-ports | grep 18789

systemctl status docker

步骤3:初始化与启动

docker exec -it openclaw bash

openclaw init --full

openclaw --version

exit

docker update --restart=always openclaw

docker restart openclaw

步骤4:访问控制台

http://你的公网IP:18789

四、本地全平台部署 OpenClaw(Windows11/MacOS/Linux)

(一)Windows11 部署(以管理员身份运行PowerShell)

Set-ExecutionPolicy Bypass -Scope Process -Force

iwr -useb https://openclaw.ai/install.ps1 | iex

openclaw onboard --install-daemon

openclaw gateway start

访问:http://localhost:18789

(二)MacOS 部署

/bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)"

brew install docker node@22

open /Applications/Docker.app

docker pull openclaw/openclaw:2026.3.26

mkdir -p ~/OpenClaw/{

config,skills,logs,memory,workspace}

docker run -d \

--name openclaw \

--restart always \

-p 18789:18789 \

-v ~/OpenClaw/config:/app/config \

-v ~/OpenClaw/skills:/app/skills \

-v ~/OpenClaw/logs:/app/logs \

-v ~/OpenClaw/memory:/app/memory \

-v ~/OpenClaw/workspace:/app/workspace \

-e TZ=Asia/Shanghai \

openclaw/openclaw:2026.3.26

docker exec -it openclaw bash

openclaw init --full

exit

(三)Linux(Ubuntu/Debian)部署

sudo apt update

curl -fsSL https://get.docker.com | bash

sudo systemctl start docker

sudo systemctl enable docker

sudo mkdir -p /opt/openclaw/{

config,skills,logs,memory,workspace}

sudo chmod -R 777 /opt/openclaw

sudo docker pull openclaw/openclaw:2026.3.26

sudo docker run -d \

--name openclaw \

--restart always \

-p 18789:18789 \

-v /opt/openclaw/config:/app/config \

-v /opt/openclaw/skills:/app/skills \

-v /opt/openclaw/logs:/app/logs \

-v /opt/openclaw/memory:/app/memory \

-v /opt/openclaw/workspace:/app/workspace \

-e TZ=Asia/Shanghai \

openclaw/openclaw:2026.3.26

五、FreeRide 安装与配置(完整命令版)

1. 进入OpenClaw环境

docker exec -it openclaw bash

2. 安装FreeRide技能

cd ~/.openclaw/workspace/skills/

git clone https://github.com/openclaw-eco/free-ride.git

cd free-ride

pip install -e .

3. 配置OpenRouter API Key

# 临时生效

export OPENROUTER_API_KEY="sk-or-v1-你自己的密钥"

# 永久保存

openclaw config set env.OPENROUTER_API_KEY"sk-or-v1-你自己的密钥"

4. FreeRide 核心命令

# 自动最优配置(最常用)

freeride auto

# 保留主模型,仅更新备选

freeride auto-f

# 自定义备选数量(例如10个)

freeride auto-c 10

# 查看所有免费模型列表

freeride list

# 手动切换指定模型

freeride switch openrouter/free

# 查看当前运行状态

freeride status

# 刷新模型缓存

freeride refresh

# 启动监控守护进程

freeride-watcher --daemon

5. 重启网关生效

openclaw gateway restart

六、阿里云千问大模型 API 配置(可选付费稳定方案)

docker exec -it openclaw bash

openclaw config set models.providers.bailian.baseUrl https://dashscope.aliyuncs.com/compatible-mode/v1

openclaw config set models.providers.bailian.apiKey sk-你的千问API密钥

openclaw config set models.default.model qwen3-max

openclaw gateway restart

exit

七、免费 Coding Plan API 配置(零成本方案)

docker exec -it openclaw bash

nano /app/config/model.config.yaml

写入:

coding_plan:

enable: true

model: coding-free

api_key: 你的免费API Key

baseUrl: https://api.codingplan.ai/v1

timeout: 30

maxConcurrent: 5

openclaw gateway restart

exit

八、FreeRide 工作原理

1. 智能路由结构

primary:自动优选的最优免费模型(默认优先使用)

fallbacks:5–10个备选模型,实现自动降级,保障服务不中断

白名单:仅筛选并使用稳定可用的免费模型,剔除不稳定模型

兜底模型:openrouter/free(智能路由,确保极端情况下仍有模型可用)

2. 配置策略

FreeRide仅修改以下配置项,不会影响系统其他部分运行:

agents.defaults.model.primary

agents.defaults.model.fallbacks

agents.defaults.models

3. 缓存机制

模型列表默认缓存1小时,减少接口请求频率,提升运行效率

可强制刷新缓存:freeride refresh

避免频繁请求外部接口,减少限流风险

4. 限流自动恢复

当主模型触发频率限制时,系统会立即切换至下一个可用的备选模型

监控服务会持续检测主模型状态,一旦恢复正常,自动切回主模型

九、FreeRide 使用最佳实践

1. 新手推荐流程

部署OpenClaw → 安装FreeRide → 配置OPENROUTER_API_KEY → 执行freeride auto → 重启网关 → 启动监控:freeride-watcher –daemon

2. 模型选择策略

日常对话:优先选择通用免费模型,响应速度快、适配性强

代码任务:选择code-*系列模型,针对性更强,代码生成更精准

长文本:选用支持8k+上下文的模型,避免文本截断

数学推理:使用专用推理模型,提升计算准确性

3. 稳定性优化

备选模型数量建议设置5–10个,数量过少易导致频繁切换

务必开启监控守护进程,减少人工干预

每周刷新一次缓存,确保模型列表为最新状态

定期更新FreeRide插件,修复已知bug,提升稳定性

十、OpenClaw 常用运维命令

# 网关管理

openclaw gateway start

openclaw gateway stop

openclaw gateway restart

openclaw gateway status

# 日志查看

openclaw logs

openclaw logs -f

# 技能管理

openclaw skills list

openclaw skills reload

openclaw skills enable --all

# 系统修复

openclaw doctor --fix

openclaw cache clean

十一、常见问题解答(FAQ)

1. FreeRide 提示无可用模型

大概率是API Key未正确配置,或Key无效、权限不足

也可能是网络无法访问OpenRouter,可检查网络连接

执行freeride refresh刷新缓存,通常可解决该问题

2. 模型频繁切换、不稳定

核心原因是备选模型数量太少,无法实现有效兜底

可执行freeride auto-c 10,将备选数量增加到10个

启动监控守护进程,提升模型切换的稳定性

3. 无法安装FreeRide

常见原因:网络无法访问GitHub、缺少Python环境、权限不足

建议进入容器后再执行安装命令:docker exec -it openclaw bash

4. 配置后AI不回复

多数情况是未重启网关,执行openclaw gateway restart即可

也可能是模型仍在限流,可等待冷却后再尝试

查看错误日志:openclaw logs –error,定位具体问题

5. 控制台无法访问

检查18789端口是否放行,容器是否正常运行

排查防火墙是否拦截,公网IP是否填写错误

6. 本地部署重启后失效

未设置容器自启,或未正确挂载数据目录

重新执行带–restart always的启动命令,确保自启配置生效

7. 免费模型调用次数受限

这属于平台正常限流,是免费模型的通用限制

FreeRide会自动切换至备选模型,无需手动干预

也可等待模型限流冷却后,自动恢复使用

十二、阿里云部署避坑指南

必须使用OpenClaw应用镜像,不可使用纯净系统镜像(否则需手动安装大量依赖,极易出错)

18789端口必须放行,否则无法访问OpenClaw控制台,这是最易踩坑的步骤

内存必须≥2GB,低于该配置会导致服务启动失败或频繁崩溃

地域优先选择中国香港/新加坡,网络更稳定,且无需备案

开启容器自启,避免服务器重启后服务丢失,无需重新部署

不要随意修改容器内部系统配置,以免破坏运行环境,导致服务异常

十三、本地部署避坑指南

Windows部署必须使用管理员PowerShell,普通终端会提示权限不足

MacOS部署需先启动Docker.app,再执行后续命令,否则会提示容器启动失败

Linux部署必须加sudo提升权限,否则会出现目录创建、命令执行失败等问题

目录挂载必须完整,缺少任一挂载目录,会导致配置丢失、日志无法生成

需关闭防火墙或放行18789端口,否则本地无法访问控制台

内存至少2GB才能流畅运行,低于该配置会出现卡顿、崩溃等问题

十四、适用场景

个人开发者:项目原型验证、小型工具开发、代码辅助、AI能力测试

学生与教育用户:课程作业、论文辅助、编程教学、知识问答、学习实验

小型团队:低成本AI接入、测试环境使用、自动化流程搭建、文档处理

日常用户:文案生成、信息检索、内容总结、个人学习助手

十五、总结

OpenClaw与FreeRide的组合,构建了一套永久免费、稳定可靠、自动降级、无人值守的AI运行环境,让个人用户、学生、小型团队无需承担API调用费用,即可轻松使用30+顶级大模型能力。FreeRide的自动优选、自动切换、自动监控特性,彻底解决了API限流、服务中断、密钥管理繁琐等痛点,让OpenClaw从需要付费才能运行,转变为完全免费、可长期使用的AI工具。

本文完整覆盖阿里云与本地全平台部署流程、FreeRide安装配置、阿里云千问与免费Coding Plan双模型对接方案、核心命令体系、工作原理、使用最佳实践与故障排查方法,所有代码均可直接复制使用,即便是零基础用户,也能快速搭建属于自己的免费AI智能体系统。

夜雨聆风

夜雨聆风