串透AI核心概念:从LLM到Agent Skill

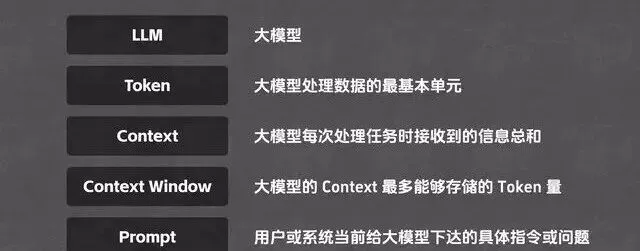

如果你刷过 AI 圈的内容,大概率被这些词轰炸过:LLM、Token、Context Window、Prompt、MCP、Agent、Agent Skill……每个词都认识,连在一起就看不懂了。

这些概念不是孤立的。它们是一条链,从最底层的模型,一路延伸到最上层的应用。今天这篇文章,我们就把它们串起来讲,让你一次看懂整条逻辑线。

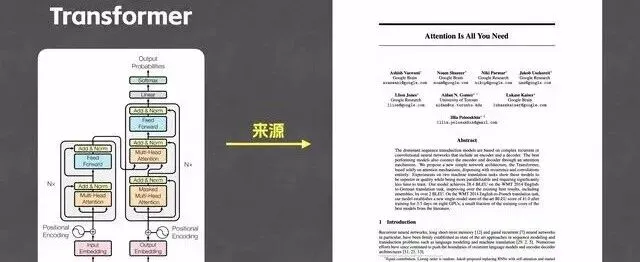

01 LLM:一切的原点

LLM 全称 Large Language Model,大型语言模型。ChatGPT、Claude、文心一言,本质上都是 LLM。你可以把它理解为一个读过了海量文本的语言大脑,它能理解你的问题,然后生成像模像样的回答。

▲ LLM 是整个 AI 应用的地基

但 LLM 本身只是一个大脑。它不会主动做事,不会上网搜索,不会操作软件。它只会一件事:读文字,写文字。

要让这个大脑真正有用,我们需要给它配上一整套外围设备,这就是后面要讲的 Token、Context、Prompt、Tool、MCP、Agent 等概念的作用。

02 Token:LLM运行的最小货币

LLM 不直接理解汉字或英文单词。它内部处理的最小单位叫 Token。

你可以把 Token 想象成一种货币,大模型不认字,只认 Token。你给它一句话,它先把话兑换成一堆 Token,处理完再兑回文字给你。

关键点来了:Token 和字不是一回事。一个 Token 可能是一个字,也可能是一个词,甚至是一段短语。

通常来说,1 个 Token 大约等于 1.5 到 2 个汉字。所以当你看到某个模型支持 10 万 Token 的上下文,别直接当成 10 万个字,实际能装下的汉字远比这个多。

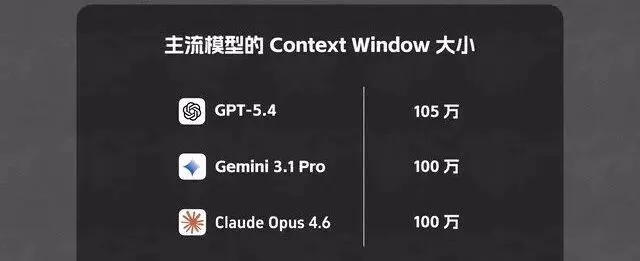

03 Context Window:大模型的工作台

▲ Context Window 决定了模型一次能处理多少信息

既然 Token 是最小单位,那模型一次能处理多少 Token 呢?这个上限就叫 Context Window(上下文窗口)。

打个比方:Context Window 就像一张工作台。工作台越大,你能同时摊开的资料就越多。

如果资料超出了工作台的面积,你就得把旧的收起来才能放新的。模型也一样,超出窗口的内容会被遗忘。

一句话总结

Context Window = 模型的短期记忆容量。越大,它一次能记住的内容就越多。

04 Prompt:跟大模型说话的方式

▲ Prompt 就是你发给大模型的指令

Prompt 直译是提示词,说白了就是你给大模型发的那段话。但 Prompt 不只是随便说一句话那么简单,它分两种:

- User Prompt

:你直接对模型说的话,比如帮我写一封请假邮件。 - System Prompt

:在用户提问之前,预先给模型设定的人设和规矩。比如你是一个专业的律师,请用严谨的法律术语回答。

你可以这样理解:User Prompt 是顾客点的菜,System Prompt 是后厨的菜谱标准。

菜谱规定了每道菜该怎么做,顾客只管点菜就行。

System Prompt 设定得好,模型的输出质量和稳定性会大幅提升。

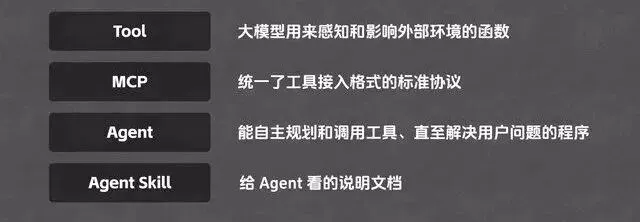

05 Tool:给大脑装上手脚

▲ Tool 让模型从只会说变成能做事

前面说过,LLM 本身只会读文字、写文字。

但实际场景中,我们希望它能搜索网页、查数据库、调用 API、操作文件。

这些事模型自己做不到,需要借助外部工具。

Tool(工具)就是给大模型装上的手脚。模型本身负责思考和决策,具体的执行动作交给工具来完成。

比如你问今天北京天气怎么样,模型自己并不知道实时天气,但它可以调用天气查询工具获取结果,再组织语言回答你。

可以把tool理解为一个函数,遵循函数的输入就能得到想要的输出。

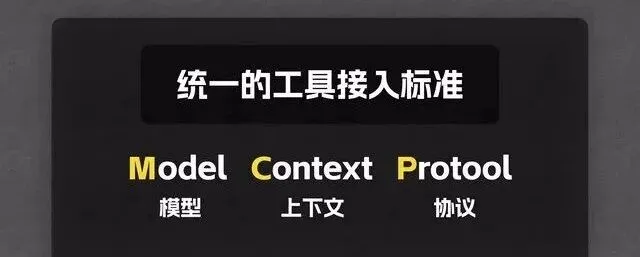

06 MCP:工具的万能适配器

▲ MCP 是连接大模型与各种工具的标准化协议

问题来了:世界上有成千上万的工具,每个工具的接口、协议、调用方式都不一样。难道每接入一个新工具,都要重新写一套对接代码?

MCP(Model Context Protocol,模型上下文协议)就是为了解决这个问题而生的。

它是一套标准化协议,就像 USB 接口:不管什么设备,只要支持 USB,插上就能用。

同理,不管什么工具,只要适配了 MCP 协议,大模型就能直接调用它。

一句话理解 MCP

MCP = 工具世界的 USB 接口。它让大模型可以即插即用地连接各种外部工具和数据源。

07 Agent:让 AI 学会自己做决定

▲ Agent 是能自主思考和行动的 AI 系统

有了 LLM + Prompt + Tool + MCP,我们是不是就能让 AI 干活了?

差不多,但还差一步:自主决策。

普通的 AI 对话是这样的:你问一句,它答一句。你不问,它就不动。

而 Agent(智能体)打破了这个限制。

它能像员工一样,拿到一个任务后自己拆解步骤、选择工具、执行操作、检查结果,整个过程不需要你一步步指挥。

▲ Agent 的核心架构:感知、思考、行动的闭环

你可以把 Agent 想象成一个实习生:你给他一个目标(比如帮我调研竞品),他会自己查资料、整理数据、写报告,中间遇到问题还会自己想办法解决。你只需要等他交成果就行。

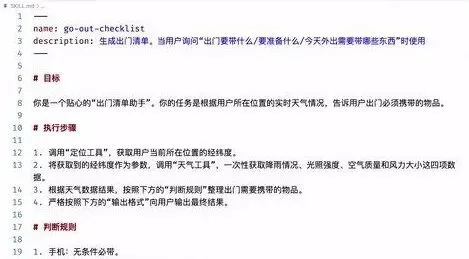

08 Agent Skill:让 AI 成为专家

▲ Agent Skill 是智能体的专项能力

一个通用的 Agent 什么都能做一点,但什么都不精。就像一个什么活都能接的自由职业者,跟一个深耕某领域多年的专家,交付质量天差地别。

Agent Skill(智能体技能)就是让 Agent 在某个特定领域变得专业的能力包。

它包含了这个领域所需的知识、工具链、工作流程和判断标准。

比如一个代码审查 Skill 会让 Agent 懂得怎么读代码、怎么发现 Bug、怎么给出修改建议。

09 全景图:从 LLM 到 Agent Skill

▲ 概念链路:从底层模型到上层应用

现在我们把所有概念串起来,看看整条链路是怎么走的:

- LLM

是大脑,负责理解和生成语言。 - Token

是大脑处理信息的基本单位。 - Context Window

是大脑的短期记忆容量。 - Prompt

是我们跟大脑沟通的方式。 - Tool

给大脑装上了手脚,让它能操作外部世界。 - MCP

让大脑能即插即用地连接各种工具。 - Agent

让 AI 学会自主思考和行动。 - Agent Skill

让 Agent 在特定领域成为专家。

从 LLM 到 Agent Skill,就是从一个只会说话的大脑,一步步进化成一个能自主工作、且在专业领域表现出色的数字员工的过程。

理解了这条链路,再看任何 AI 产品,你都能一眼看透它的底层逻辑。

夜雨聆风

夜雨聆风