AI大模型的中文税:你 unknowingly 多交了64%的钱

▲ tokenizer切分示意图

你每次用Claude写中文文案,可能 unknowingly 多交了64%的钱。

这不是阴谋论,是tokenizer(分词器)的设计偏见——英文模型以英文为默认优化目标,中文被拆得更碎。同样一段话,用中文输入比英文多花64%的token,也就是64%的费用。

好消息是:国产模型已经把这个问题解决了。

现象:同样的话,中文更贵

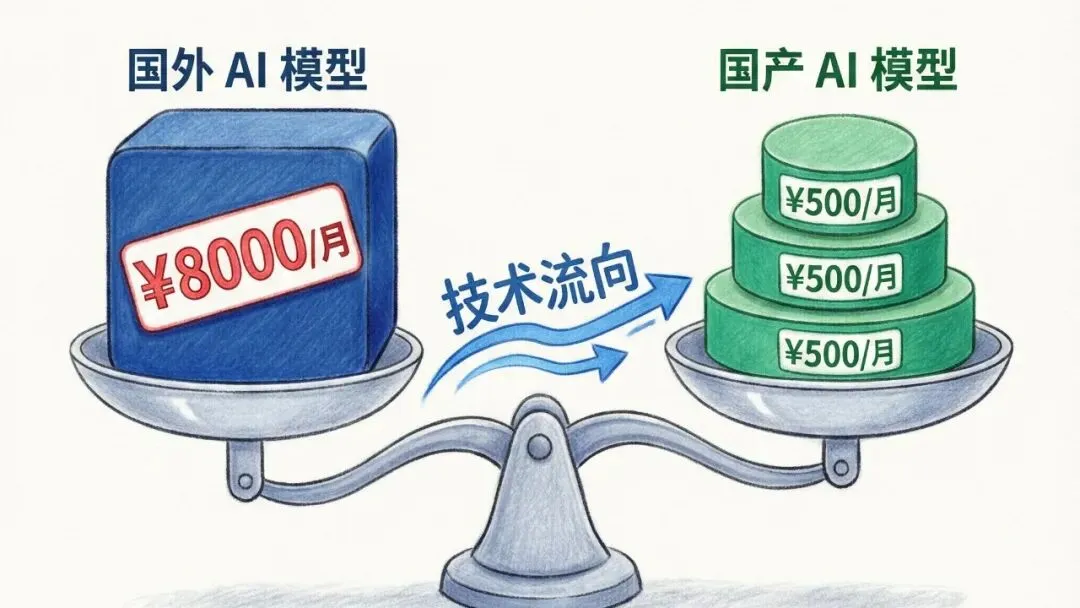

▲ 国产模型更省钱

先科普一下什么是token。

你可以把token理解为AI处理信息时的”最小单位”。英文里,一个token大约对应4个字母,或者半个单词。比如”hello”大概占1个token,”beautiful”占2个。

但中文呢?

在大多数英文模型里,一个汉字通常占1.5到2个token。”你好世界”4个汉字,可能要6-8个token。而”hello world”两个单词,只要3个token左右。

这意味着:表达同样的意思,中文输入需要更多token,花更多钱。

虎嗅网转载的极客公园文章里有个具体数据:一段200字的中文文案,用英文写只需要约120个token,用中文要接近200个token。差距约64%。

深度分析:为什么英文模型对中文”不友好”

▲ 精简提示词技巧

这不是模型”故意”歧视中文,是技术路径的副产品。

主流大模型(GPT、Claude等)的tokenizer是用英文语料训练出来的。英文有天然的优势:空格分词、词根词缀、语法结构清晰。tokenizer可以把英文切得很高效。

中文没有空格,一个字就是一个语义单元,上下文依赖强。用英文tokenizer处理中文,就像用切牛排的刀切豆腐——能切,但碎。

更深层的问题是:模型优化时,英文是默认假设。

Claude 4.7升级后,英文用户的账单暴涨2-2.7倍,网上一片哀嚎。但中文用户反而没什么感觉——因为中文在旧版已经被切到单字颗粒度,”可拆分的空间极小”。中文用户早就默默承担了最高成本,新版再涨也涨不到哪去。

这就像机票定价:经济舱已经满员了,商务舱涨价,经济舱乘客无感知。不是因为没涨价,是因为本来就贵到头了。

反常识:国产模型反而中文更便宜

这里有个反常识的发现:用国产模型(Qwen、DeepSeek)处理中文,token效率反而比英文模型高。

DeepSeek的中文token成本只有英文的0.65倍——不是中文贵,是中文更便宜。

为什么?因为国产模型的tokenizer是用中文语料训练出来的。它懂中文的切分逻辑:哪些字该放在一起(”人工智能”),哪些字该分开(”人/工/智能”在不同语境下)。

这不是”爱国滤镜”,是语言适配的基本道理。就像你用中文输入法打英文,肯定别扭;用英文输入法打中文,更别扭。

古文悖论:token越省,理解越难

还有个有意思的现象:古文在token层面极其”高效”。

“罔”一个字,可能只占1个token。但模型要判断它是”迷惑””被蒙蔽”还是”没有”,需要消耗大量计算资源去解压这个被压缩的语义。

所以token少不等于成本低。真正成本高的是语义压缩后的解压过程。

这解释了为什么有些模型处理古文时”懂字不懂意”——token是省了,但理解反而更难。

普通人怎么做:三招避开”中文税”

第一招:选模型时看tokenizer

不是看模型多新、多强,是看它对中文的友好度。国产模型(Qwen、DeepSeek、文心一言)在中文token效率上普遍优于英文模型。

如果你主要用中文和AI交互,选国产模型不是”支持国货”,是理性经济选择。

第二招:用英文写提示词,再翻译

有个取巧的办法:用英文写复杂提示词(英文token效率高),让AI输出中文。这样输入端省钱,输出端不影响。

但要注意:涉及文化语境的内容(比如写春节文案),英文提示词可能”词不达意”。这招适合技术类、通用类任务。

第三招:精简表达,避免冗余

中文本身有”信息密度高”的优势。同样意思,中文往往比英文短。但很多人和AI对话时,反而写得又臭又长。

试试这个原则:把提示词当成短信发,不是当论文写。每句话都有目的,没有寒暄和铺垫。

收尾:技术偏见无处不在,但可以被修正

“中文税”本质上是一个技术偏见:以英文为默认优化目标,其他语言被动适配。

这种偏见不是第一次出现。早期的互联网编码以ASCII为主,中文网站曾经是乱码重灾区。早期的编程语言以英文关键字为主,非英语国家的学习门槛更高。

但每次,最终都是本地化适配解决了问题。

大模型的tokenizer也一样。随着中文语料占比提升、国产模型崛起,”中文税”会逐渐消失。

但在那之前,作为普通用户,你能做的最实际的事是:了解这个机制,然后选一个对中文友好的模型。

不是每个新模型都值得追。有时候,”更适合你的语言”比”更强大”更重要。

你注意到过”中文税”吗? 欢迎在评论区分享——你用AI时,有没有发现中文和英文的成本/效果差异?

如果这篇文章帮你省了一笔 unknowingly 的开销,点个「在看」让更多人看到。

夜雨聆风

夜雨聆风