AI智算中心的南北向流量 vs 东西向流量,一篇讲清核心区别

在AI智算中心规模化部署、大模型分布式训练与推理普及的今天,“流量”早已不是简单的“数据传输”,而是支撑算力高效释放、模型稳定运行的核心命脉。

“智算系统的问题,一半出在流量上”。而其中,最容易让人混淆的,就是「南北向流量」和「东西向流量」——这两个看似抽象的概念,其实贯穿了每一个AI智算集群(GPU集群、训练节点、推理节点)的运行全过程,直接决定大模型训练速度、推理响应效率和算力利用率。

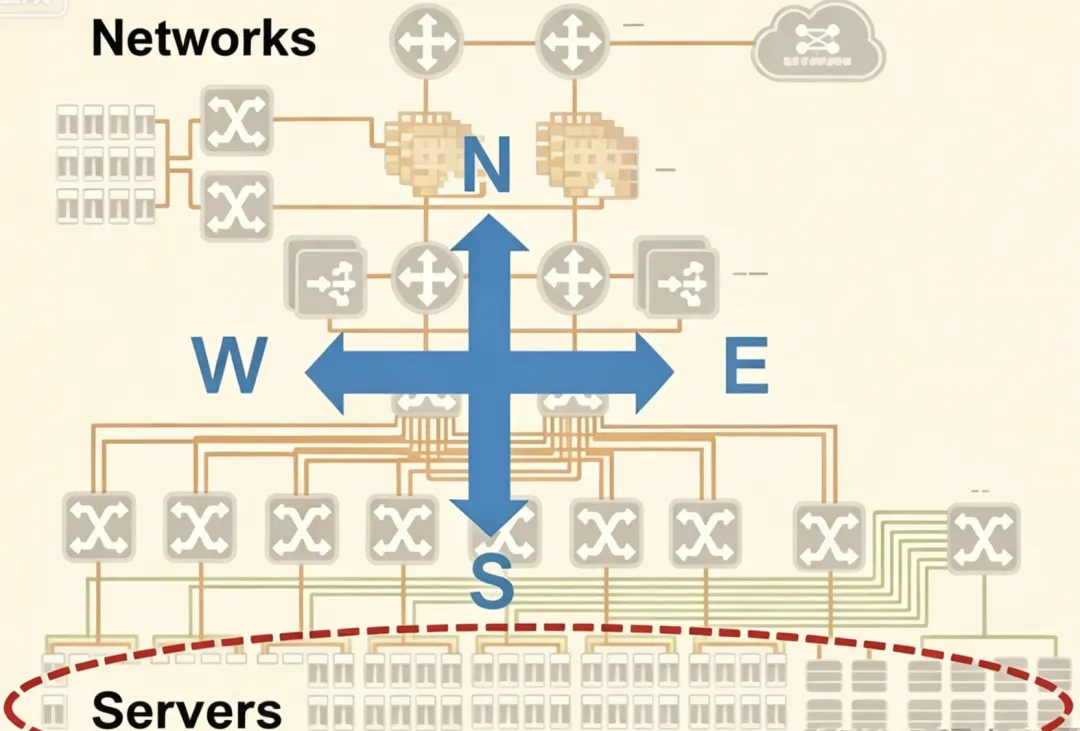

什么是AI智算中心的南北向、东西向流量?

其实不用被“南北”“东西”的方位词吓到,我们可以把整个AI智算中心想象成一座“智能算力城堡”,流量就是进出城堡、在城堡内部穿梭的“数据信使”,而城堡里的“房间”就是GPU服务器、算力节点、存储节点,“信使”承载的就是模型数据、梯度参数、推理请求等核心内容。

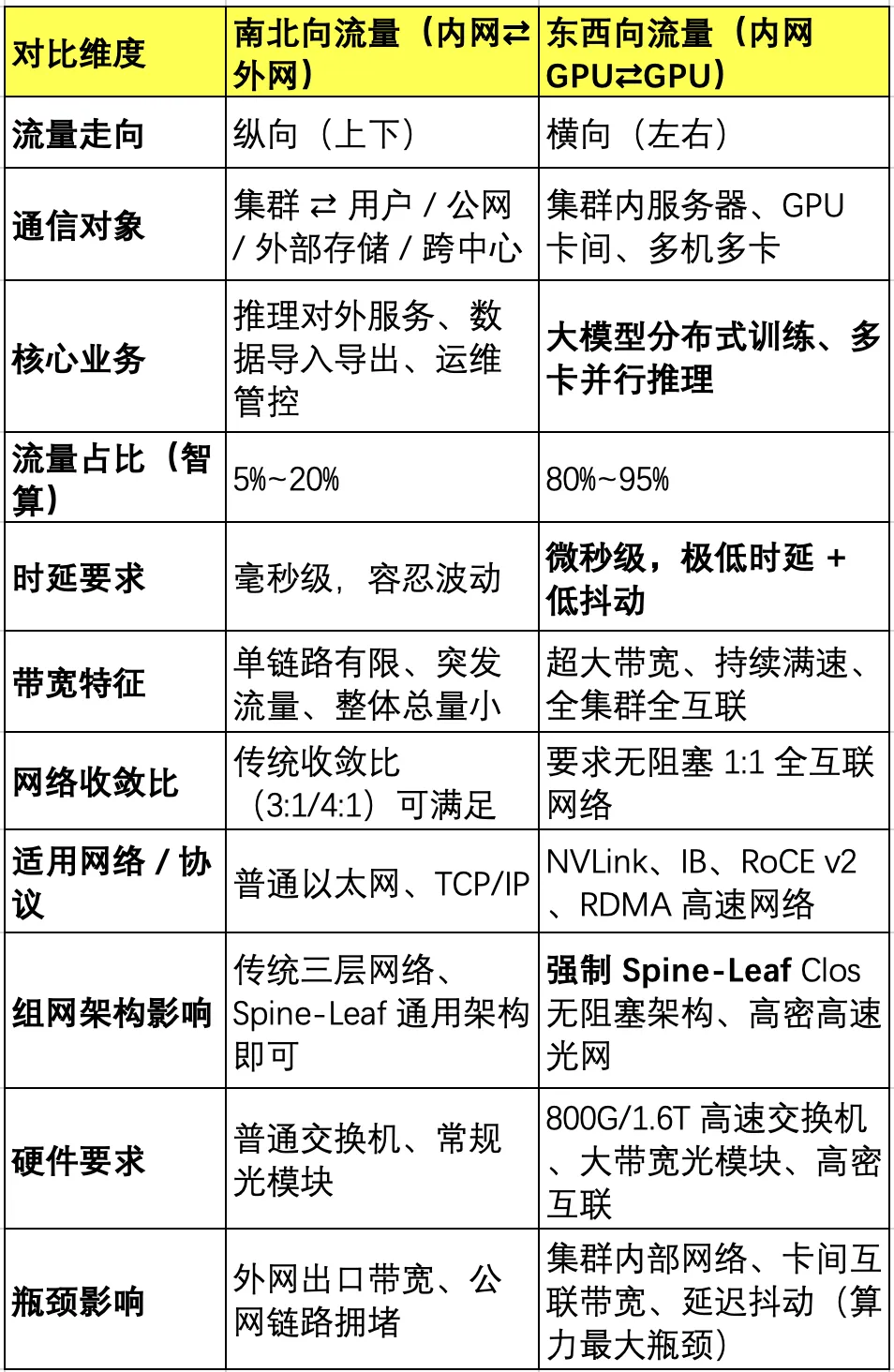

简单来说:南北向流量是“智算中心与外界的往来”,东西向流量是“智算中心内部算力节点的串门”,两者的流向、作用、流量特征和管理重点完全不同,且与传统云计算场景有显著差异。

一、南北向流量(North-South Traffic):智算城堡的“进出大门”

AI智算中心南北向流量的核心,是“跨边界”——也就是从智算中心外部进入内部,或者从智算中心内部流向外部的流量,相当于“数据信使”从城堡外进入,或从城堡内出发前往外界,是智算中心与外部交互的唯一通道。

核心定义:智算中心外部终端、异地存储、公网服务与中心内部算力集群(GPU服务器、训练/推理节点)之间的通信流量,通俗讲就是“外界找智算中心办事”“智算中心向外界交付结果”的流量。比如科研人员通过终端提交大模型训练任务、用户调用智算中心的推理API生成内容、从异地存储拉取训练数据集、导出训练完成的模型权重,这些都是典型的AI智算场景下的南北向流量。

-

必须穿过智算中心边界,一边是外部网络(互联网、异地智算中心、公网存储、用户终端),一边是内部网络(GPU集群内网、算力节点私有网络);

-

安全管控最严格——毕竟是“外来流量”,必须经过多重“安检”,防止恶意攻击、非法访问影响算力集群稳定,尤其要保护训练数据集、模型权重等核心资产;

-

流量路径相对固定,多为“用户终端/外部存储→智算网关→GPU集群/算力节点”的单向或双向流动,且流量呈现“低频、突发”特征,非持续满负载;

-

延迟容忍度较高,毫秒级延迟可接受,对算力释放影响较小。

常见组件:负责“安检”和“引导”的核心组件,比如智算API网关、负载均衡器、反向代理,还有防火墙、入侵检测系统(IDS)、数据脱敏设备等安全设备,都是南北向流量的“必经关卡”;此外,跨中心互联设备、公网出口带宽模块,也是支撑南北向流量的关键组件。

举个直观例子:科研人员通过实验室终端,向AI智算中心的GPU集群提交大模型训练请求,这个请求从实验室终端(外部)进入智算中心的内部算力网络,就是典型的南北向流量;训练任务完成后,智算中心将模型权重导出到科研人员的本地存储,也是南北向流量。这一过程中,API网关会验证科研人员的身份、审核训练任务权限,防火墙会拦截非法请求,确保算力资源和核心数据的安全合规,同时负载均衡器会合理分配外部请求,避免单节点过载。

二、东西向流量(East-West Traffic):智算城堡的“内部通道”

和南北向流量相反,AI智算中心的东西向流量完全“不跨边界”,只在智算中心内部的各个算力节点、GPU服务器、存储组件之间流动,相当于“数据信使”在城堡内部的不同房间(GPU节点、存储节点)之间穿梭,不走出城堡大门,是大模型训练的核心流量来源。

核心定义:智算中心内部各算力组件之间的通信流量,最典型的就是大模型分布式训练中,GPU服务器之间、多机多卡之间的通信,以及推理集群中各节点的协同流量。比如千亿参数大模型训练时,“GPU节点A”需要与“GPU节点B”同步梯度参数、交换训练分片数据,推理集群中各GPU节点拆分张量、互通中间结果,这些组件之间的通信,就是AI智算场景下的东西向流量。

-

全程在智算中心内部网络流动,不接触外部网络,看似“安全”,实则管控难度更高,其延迟、带宽直接决定算力利用率;

-

流量频率极高、路径复杂且持续满负载——大模型分布式训练中,一个训练任务可能涉及数十甚至上百台GPU服务器协同,流量会在各节点间高频穿梭,全程保持满带宽运行;

-

极易被忽视,却是智算中心的“命脉”:一旦东西向流量出现问题(比如延迟过高、带宽不足、链路阻塞),会直接拉低训练速度、导致GPU卡闲置,甚至引发训练任务失败,影响整个智算集群的运行;

-

对延迟和抖动要求极高,需达到微秒级,普通网络无法满足,必须依赖高速互联技术。

常见组件:负责“内部调度”和“监控”的组件,比如高速互联网络(IB、RoCE、NVLink)、服务网格(适配智算场景的定制化版本)、内部负载均衡器、分布式存储互联模块等,用来保障内部算力节点间通信的高效、低延迟和稳定;此外,800G/1.6T高速交换机、高密光模块,也是承载东西向超大流量的核心硬件。

随着大模型分布式训练、多卡并行推理的普及,AI智算中心中东西向流量的占比远超传统云计算场景,甚至达到压倒性优势——据行业统计,大模型训练为主的智算集群中,东西向流量占比可达80%~95%,其管控难度和网络优化水平,成为决定智算中心算力释放效率的关键。攻击者一旦突破南北向防护进入内部,也可能借助东西向流量扩散攻击范围,影响整个算力集群,因此内部防护同样不可忽视;同时,东西向流量的带宽、延迟优化,也是降低智算成本、提升训练效率的核心抓手。

夜雨聆风

夜雨聆风